今天给大家介绍stable diffusion webui的界面。

在介绍之前,请大家先安装好stable diffusion安装包,想要Stable diffusion一键安装包的小伙伴可以在文末扫码,我给大家免费安排!

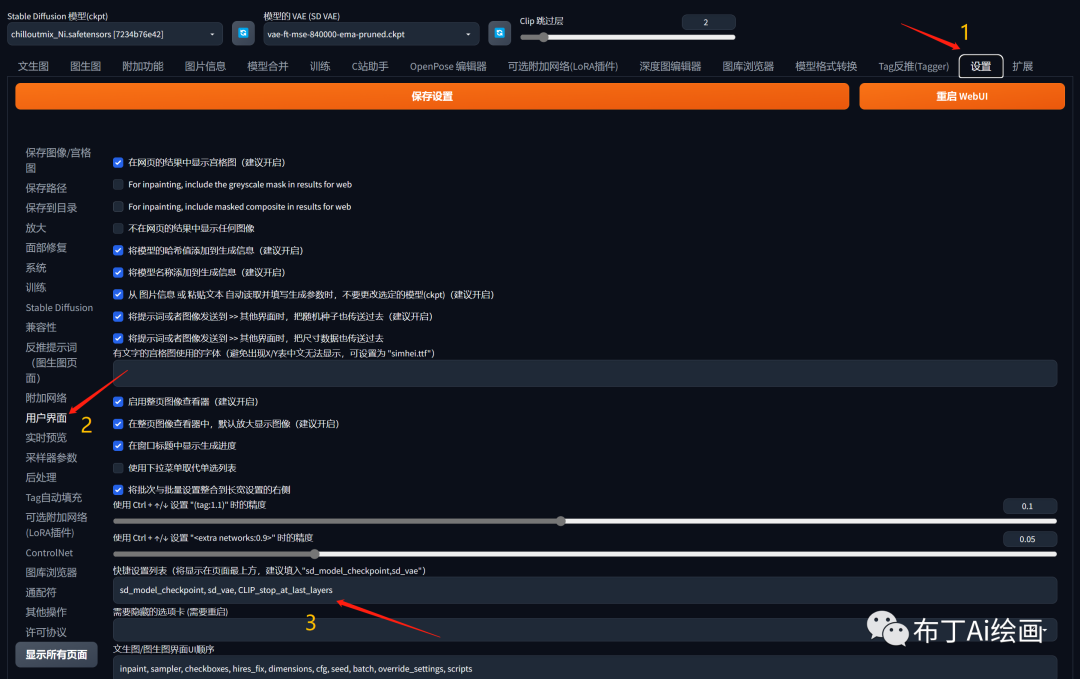

安装好之后,我们可以看到这样一个本地网页

(点击可放大图片)

我们按图上的数字编号依次给大家介绍一下

1、Stable Diffusion模型

这里是我们用来切换CheckPoint模型(cpt文件)的地方,就是我们通常说的切换大模型的地方,点开这里会看到你的Stable Diffusion(下文简称SD)已安装了哪些大模型,可以选择进行切换。

这些模型具体放在你的安装包的这个路径下面:

D:\novelai-webui-aki-v3\models\Stable-diffusion

(如果你下载的也是秋叶大佬的整合包,前面的novelai-webui-aki-v3文件名应该是一样的)

补充:

此处除了切换模型,还可以自己添加其他选项,比切换vae,CLIP skip等等,就是这里的参数:

打开设置-用户界面-快捷设置列表/Quicksettings list,添加参数就可。这个参数可以自己去config.json找。

2、正向提示词(Prompt)

顾名思义,这里就是通过输入文字,SD生成图片的地方。

其中数字2代表的区域是正向提示词,表示你希望图片中看到的元素;

例如想在图片中画一只小猫咪,输入:1cat,然后点击右侧的“生成”按钮,

然后你就会得到一张小猫咪的图片了。

3、反向提示词(Negative Prompt)

数字3代表的区域是反向提示词(也叫负面提示词),表示你不希望图片中出现的元素;

SD在绘画的过程中会存在很多不确定性,因此我们需要通过这些负面提示词来过滤掉一些我们不想要的内容,使我们的图片达到更加满意的效果,

例如:我们看到上面的猫咪是在室内,如果你想它在室外,除了通过给正面提示词添加:outdoors以外,你还可以给负面提示词添加:indoors

这样我们得到的图片,就会是在室外了。

随着你对SD了解的深入,这里通常是放一些图片质量修饰词了。

例如:low quality,worst quality。

通过这些修饰词一方面提高画质效果,另一方面就是上面讲到的规避不想看到的元素,特别是当你在画人的时候,总会出现一些意想不到的元素,那么就可以在这里进行规避。

有关提示词的语法,我将在后面再具体给大家讲解介绍。

4、采样迭代步数(Steps)

生成图片的迭代步数,每多一次迭代就会让 SD更接近我们的提示词。更高的步数需要花费更多的计算时间,步数越大,图像细节越多,默认是20步,如果你的显卡和CPU比较给力,数值可以往上调。

5、采样方法(Sampler)

就是SD进行绘画所使用的算法,常用的算法有三种,分别是Euler a,DPM++2S a Karras和DDI

5.1、Euler a

1)、Euler a是一种用于控制时间步长大小的可调参数,在Stable Diffusion中采用Euler时间步长采样方法。适当的Euler a值能够捕捉到细节和纹理,但如果值太大会导致过度拟合,生成图像出现噪点等不良效果。

2)、一句话概括:采样生成速度最快,但是如果说在高细节图增加采样步数时,会产生不可控突变(如人物脸扭曲,细节扭曲等)。

3)、适合:ICON,二次元图像,小场景。

5.2、DPM++2S a Karras

1)、采用 DPM++2S a Karras 采样方法生成高质量图像,该方法在每个时间步长中执行多次操作,同等分辨率下细节会更多,比如可以在小尺寸里绘画全身像,代价是采样速度更慢。

2)、适合:写实人像,复杂场景刻画。

5.3、DDIM

1)、DDIM 采样方法可以快速生成高质量的图像,相比其他采样方法具有更高的效率,想尝试超高步数时可以使用,随着步数增加可以叠加细节。

2)、适合:写实人像,复杂场景刻画。

当然大家也可以逐个尝试一下。

6、图片分辨率

这里是设置图片分辨率的地方,长宽的单位都是像素。通常如果你的显卡是入门级的,建议用默认的512*512的分辨率即可,如果你的显卡比较给力,可以提高分辨率,当前SD版本(SD v1.5)最高支持2048*2048的分辨率。

7、生成批次和每批数量(Batch&Num)

这里就是每次点击“生成”按钮时会根据你这里的设置输出多少张图片,图片的数量=生成批次*每批数量

当然生成的图片张数越多所消耗的时间越长,特别是显卡不怎么给力的就会更长。

8、提示词相关性(CFG Scale)

图像与你的提示的匹配程度,增加这个值将导致图像更接近你的提示,但它也在一定程度上降低了图像质量,过高的 CFG Scale 体现为粗犷的线条和过锐化的图像,这个值一般设置为 7~11。

9、随机种子(Seed)

这里是图片在生成时的所有随机性,它初始化了 Diffusion 算法起点的初始值。如果你想每次得到的都不一样,那么使用-1即可,如果你觉得某张图片的不错,可以通过生成的图片,查看它的随机种子值来指定。

例如:我们刚才生成室外的猫咪,在底部就会告诉你它对应的随机种子值是多少

10、插件

这里通常会显示我们常用的一些插件,SD是一款开源的AI绘画工具,拥有大量优质的插件,例如C站助手,OpenPose编辑器,MultiDiffusion等插件都很好用,能帮助大家解决一些特定的问题,这个我在后续的教程里也会给大家一一讲解。

11、ControlNet

它其实也是一个插件,但是这个插件的功能非常强大,特别是在绘画人物时,通过与OpenPose编辑器一起使用可以指定人物动作,给大家看下ControlNet官网的相关示例

其中Source层是我们提供的原始图片,ControlNet通过不同模型预处理成Input的相关内容,再结合我们的大模型和提示词就可以得到Output的相关内容了。

这里只是先简单给大家介绍一下,因为ControlNet涉及的内容实在是太多,可玩性也非常高,我们后续再通过多个篇幅讲解。

我已经为大家打包好了SD一键安装包、大模型、lora和关键词文件,无需自行查找,需要的小伙伴文末扫码获取

写在最后

AIGC技术的未来发展前景广阔,随着人工智能技术的不断发展,AIGC技术也将不断提高。未来,AIGC技术将在游戏和计算领域得到更广泛的应用,使游戏和计算系统具有更高效、更智能、更灵活的特性。同时,AIGC技术也将与人工智能技术紧密结合,在更多的领域得到广泛应用,对程序员来说影响至关重要。未来,AIGC技术将继续得到提高,同时也将与人工智能技术紧密结合,在更多的领域得到广泛应用。

感兴趣的小伙伴,赠送全套AIGC学习资料和安装工具,包含AI绘画、AI人工智能等前沿科技教程,模型插件,具体看下方。

一、AIGC所有方向的学习路线

AIGC所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、AIGC必备工具

工具都帮大家整理好了,安装就可直接上手!

三、最新AIGC学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、AIGC视频教程合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

若有侵权,请联系删除

若有侵权,请联系删除

825

825

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?