神经网络是一种模仿人脑神经元结构的计算模型,用于识别模式和处理复杂的数据。它是机器学习和深度学习领域的核心技术之一。

工作原理

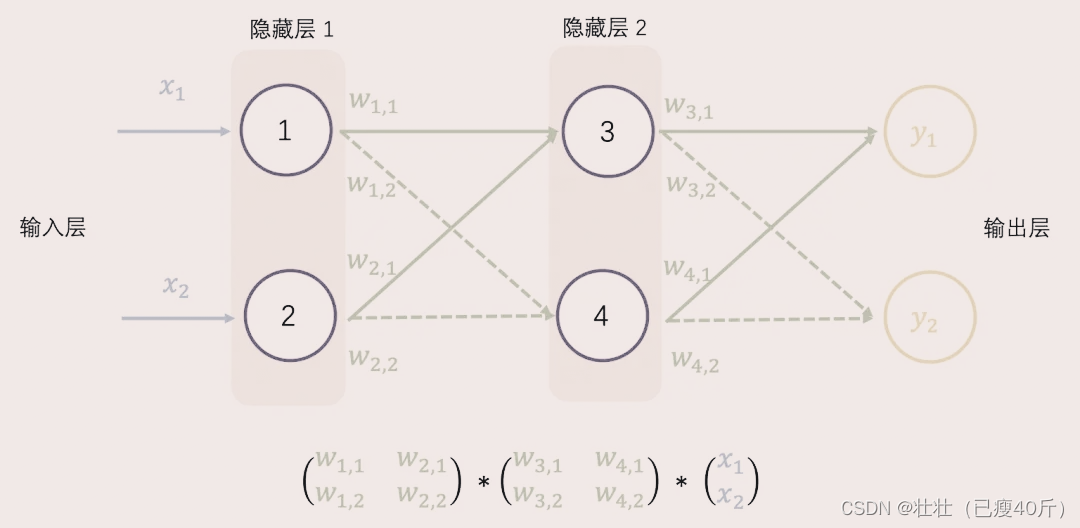

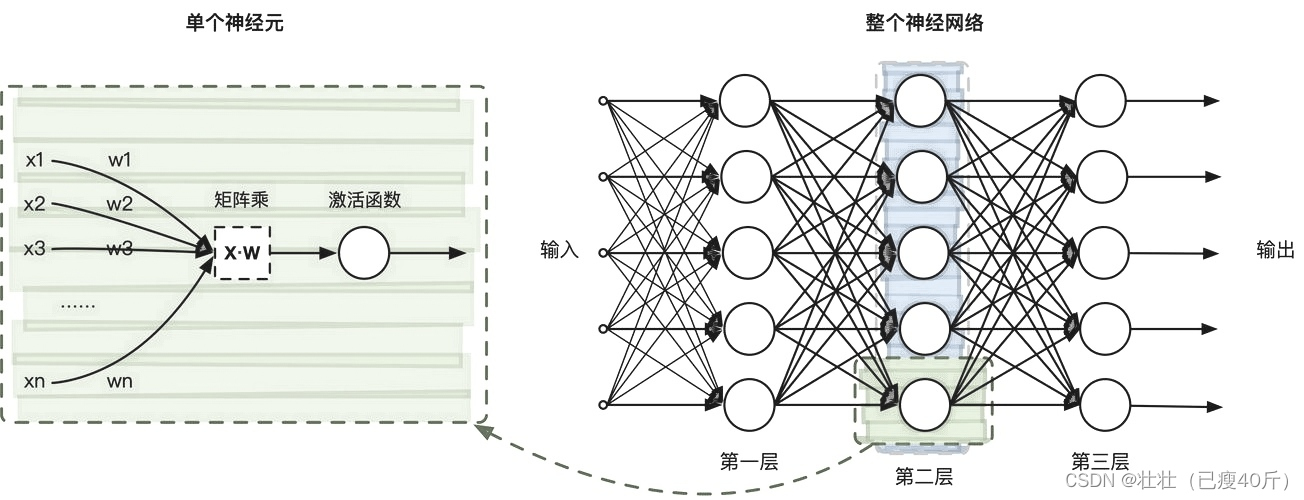

神经网络的工作原理基于神经元的连接和信息传递。每个神经元接收来自其他神经元的输入信号,这些信号通过权重(连接强度)加权后,在神经元内部累加。如果累加的结果超过了某个阈值,神经元就会被激活,并产生一个输出信号,该信号随后会传递给下一层的神经元。

神经网络通常由以下几种类型的层组成:

1. **输入层(Input Layer)**:负责接收输入数据。输入数据可以是图像的像素值、音频信号的波形、文本数据的词向量等。

2. **隐藏层(Hidden Layers)**:位于输入层和输出层之间,可以有多个。隐藏层负责从输入数据中提取特征和模式。隐藏层的神经元数量和层数会影响网络的学习能力和复杂度。

3. **输出层(Output Layer)**:提供网络的最终预测结果。输出层的设计取决于特定任务的需求,例如分类任务通常使用softmax函数来输出每个类别的概率。

激活函数

激活函数是神经网络中不可或缺的组成部分,它为网络引入非线性,使得网络能够学习和表示更加复杂的函数映射。一些常见的激活函数包括:

1. **线性激活函数**:`f(x) = x`,最简单的激活函数,不引入非线性。

2. **Sigmoid激活函数**:`f(x) = 1 / (1 + e^(-x))`,输出范围在(0,1)之间,常用于二分类问题的输出层。

3. **双曲正切激活函数(Tanh)**:`f(x) = (e^(x) - e^(-x)) / (e^(x) + e^(-x))`,输出范围在(-1,1)之间。

4. **ReLU激活函数**:`f(x) = max(0, x)`,在正区间内为线性,负区间内为0,可以有效解决梯度消失问题,是当前最常用的激活函数之一。

训练方法

神经网络的训练涉及到调整权重和偏置,以最小化预测误差。这个过程通常包括以下几个步骤:

1. **初始化参数**:使用随机值或特定的初始化方法(如Xavier初始化、He初始化)来设置网络中所有权重和偏置的初始值。

2. **前向传播**:输入数据通过网络,通过每一层的加权求和和激活函数,最终得到输出结果。

3. **计算损失**:根据输出结果和真实值,使用损失函数计算误差。

4. **反向传播**:通过计算损失函数关于每个权重的梯度,并使用链式法则将这些梯度传播回网络的每一层。

5. **参数更新**:根据梯度和学习率,使用优化算法(如梯度下降、Adam等)来更新网络中的权重和偏置。

训练方法的深入探讨

神经网络的训练是一个迭代的过程,目的是找到一组权重和偏置,使得网络的预测输出尽可能接近真实的目标值。这个过程包括以下几个方面:

1. **数据预处理**:包括归一化、标准化、去噪、增强等,以提高数据质量和模型的泛化能力。

2. **损失函数的选择**:不同的任务需要不同的损失函数。例如,二分类问题常用二元交叉熵损失,多分类问题常用分类交叉熵损失,回归问题常用均方误差损失。

3. **优化算法的选择**:梯度下降及其变种(如SGD、Adam、RMSprop等)是最常用的优化算法。它们通过调整权重来最小化损失函数。

4. **正则化**:为了防止过拟合,可以在损失函数中添加正则化项,如L1正则化、L2正则化或Dropout。

5. **超参数调整**:学习率、批量大小、隐藏层的数量和大小等超参数对模型性能有重要影响。通常通过交叉验证、网格搜索或贝叶斯优化等方法进行选择。

神经网络的应用细节

神经网络在实际应用中表现出色,以下是一些具体的应用细节:

1. **图像识别**:卷积神经网络(CNN)通过使用卷积层来提取图像的局部特征,能够有效地处理图像数据。CNN中的池化层用于降低特征的空间尺寸,减少参数数量和计算量。

2. **语音识别**:循环神经网络(RNN)特别适合处理序列数据,如语音信号。RNN的变体,如长短时记忆网络(LSTM)和门控循环单元(GRU),通过引入门控机制来解决长期依赖问题。

3. **自然语言处理**:Transformer架构通过自注意力机制(Self-Attention)来处理序列数据,能够捕捉序列内部的长距离依赖关系,已成为自然语言处理领域的主流模型。

4. **推荐系统**:协同过滤、基于内容的推荐和混合推荐系统等方法利用用户的历史行为和偏好,结合神经网络的学习能力,为用户提供个性化推荐。

5. **游戏AI**:深度强化学习算法,如深度Q网络(DQN),通过与环境的交互学习策略,使得神经网络能够在复杂的游戏环境中做出最优决策。

神经网络的深入研究和应用正在推动人工智能技术的发展,未来有望在更多领域实现突破。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?