MATLAB神经网络,支持向量机,随机森林,径向基函数,长短期记忆网络等

直接替换Excel数据即可。

包括12个回归,10个分类,10个时间序列的预测,共32套代码。如图3/4/5的序号和算法与发货文件对应。

文章目录

下面我将提供一些基础示例代码,用于在MATLAB中实现神经网络、支持向量机(SVM)、随机森林、径向基函数(RBF)网络和长短期记忆(LSTM)网络。这些示例假设你已经有了一个数据集,并且已经完成了必要的预处理步骤。

1. 神经网络

% 加载样本数据

load iris_dataset % MATLAB自带的鸢尾花数据集作为例子

inputs = meas';

targets = dummyvar(species');

% 创建并训练一个两层前馈神经网络

hiddenLayerSize = 10;

net = patternnet(hiddenLayerSize);

[net,tr] = train(net,inputs,targets);

% 使用网络进行预测

outputs = net(inputs);

2. 支持向量机 (SVM)

对于分类问题:

% 加载样本数据

load fisheriris % 使用另一个内置数据集

X = meas(51:end,3:4); % 只使用后两个特征

Y = species(51:end); % 仅使用两类

% 训练SVM模型

SVMModel = fitcsvm(X,Y,'KernelFunction','rbf','ClassNames',{'versicolor','virginica'});

% 预测新数据点

[label,score] = predict(SVMModel,newX);

3. 随机森林

MATLAB中没有直接提供随机森林的函数,但可以通过TreeBagger来实现:

% 加载样本数据

load fisheriris

X = meas;

Y = species;

% 创建随机森林

rng(1); % 设置随机种子以便结果可重复

Mdl = TreeBagger(100,X,Y,'Method','classification');

% 预测

[Yfit,scores] = predict(Mdl,X);

4. 径向基函数 (RBF) 网络

可以使用自定义的RBF网络或通过调整神经网络的隐层参数来近似实现:

% 加载样本数据

load simpleclass_dataset % 假设这是一个简单的分类数据集

% 定义RBF网络结构

net = newrbe(simpleclassInputs,simpleclassTargets,spread=1);

% 使用网络进行预测

outputs = net(simpleclassInputs);

请注意,newrbe是MATLAB中的一个函数,用于创建一个基于RBF的回归/分类网络。你需要根据你的具体需求调整输入和目标数据。

5. 长短期记忆网络 (LSTM)

% 准备序列数据

sequences = ...; % 序列数据

YTrain = ...; % 目标数据

% 定义LSTM网络架构

layers = [ ...

sequenceInputLayer(inputSize)

lstmLayer(numHiddenUnits,'OutputMode','sequence')

fullyConnectedLayer(numClasses)

softmaxLayer

classificationLayer];

% 指定训练选项

options = trainingOptions('adam', ...

'MaxEpochs',100, ...

'MiniBatchSize',50, ...

'InitialLearnRate',0.01, ...

'GradientThreshold',1, ...

'Verbose',0, ...

'Plots','training-progress');

% 训练LSTM网络

net = trainNetwork(sequences,YTrain,layers,options);

以上代码提供了基本框架,实际应用时需要根据具体的数据集和问题需求进行适当调整。例如,数据预处理、网络架构设计、超参数优化等都是影响模型性能的重要因素。希望这些示例能够帮助你开始在MATLAB中使用这些机器学习方法。

为了帮助你更好地理解如何在MATLAB中实现神经网络、支持向量机(SVM)、随机森林、径向基函数(RBF)网络和长短期记忆(LSTM)网络,并附上相应的代码示例,我将逐一提供这些模型的基本实现代码。

1. 神经网络

% 加载数据

load simpleclass_dataset % 假设这是一个简单的分类数据集

% 创建并训练一个两层前馈神经网络

hiddenLayerSize = 10;

net = patternnet(hiddenLayerSize);

[net,tr] = train(net,simpleclassInputs,simpleclassTargets);

% 使用网络进行预测

outputs = net(simpleclassInputs);

2. 支持向量机 (SVM)

% 加载数据

load fisheriris

X = meas;

Y = species;

% 训练SVM模型

SVMModel = fitcsvm(X,Y,'KernelFunction','rbf');

% 预测新数据点

[label,score] = predict(SVMModel,X);

3. 随机森林

% 加载数据

load fisheriris

X = meas;

Y = species;

% 创建随机森林

rng(1); % 设置随机种子以便结果可重复

Mdl = TreeBagger(100,X,Y,'Method','classification');

% 预测

[Yfit,scores] = predict(Mdl,X);

4. 径向基函数 (RBF) 网络

% 加载数据

load simpleclass_dataset % 假设这是一个简单的分类数据集

% 定义RBF网络结构

net = newrb(simpleclassInputs,simpleclassTargets,0.01);

% 使用网络进行预测

outputs = net(simpleclassInputs);

5. 长短期记忆网络 (LSTM)

% 准备序列数据

sequences = ...; % 序列数据

YTrain = ...; % 目标数据

% 定义LSTM网络架构

layers = [ ...

sequenceInputLayer(inputSize)

lstmLayer(numHiddenUnits,'OutputMode','sequence')

fullyConnectedLayer(numClasses)

softmaxLayer

classificationLayer];

% 指定训练选项

options = trainingOptions('adam', ...

'MaxEpochs',100, ...

'MiniBatchSize',50, ...

'InitialLearnRate',0.01, ...

'GradientThreshold',1, ...

'Verbose',0, ...

'Plots','training-progress');

% 训练LSTM网络

net = trainNetwork(sequences,YTrain,layers,options);

示例代码汇总

% 神经网络

hiddenLayerSize = 10;

net = patternnet(hiddenLayerSize);

[net,tr] = train(net,simpleclassInputs,simpleclassTargets);

outputs = net(simpleclassInputs);

% SVM

SVMModel = fitcsvm(X,Y,'KernelFunction','rbf');

[label,score] = predict(SVMModel,X);

% 随机森林

rng(1);

Mdl = TreeBagger(100,X,Y,'Method','classification');

[Yfit,scores] = predict(Mdl,X);

% RBF

net = newrb(simpleclassInputs,simpleclassTargets,0.01);

outputs = net(simpleclassInputs);

% LSTM

layers = [ ...

sequenceInputLayer(inputSize)

lstmLayer(numHiddenUnits,'OutputMode','sequence')

fullyConnectedLayer(numClasses)

softmaxLayer

classificationLayer];

options = trainingOptions('adam', ...

'MaxEpochs',100, ...

'MiniBatchSize',50, ...

'InitialLearnRate',0.01, ...

'GradientThreshold',1, ...

'Verbose',0, ...

'Plots','training-progress');

net = trainNetwork(sequences,YTrain,layers,options);

希望这些代码示例能够帮助你开始在MATLAB中使用这些机器学习方法。

为了帮助你更好地理解如何在MATLAB中实现神经网络、支持向量机(SVM)、随机森林、径向基函数(RBF)网络和长短期记忆(LSTM)网络,并附上相应的代码示例,我将逐一提供这些模型的基本实现代码。以下是一些基本的示例代码:

1. 神经网络

% 加载数据

load simpleclass_dataset % 假设这是一个简单的分类数据集

% 创建并训练一个两层前馈神经网络

hiddenLayerSize = 10;

net = patternnet(hiddenLayerSize);

[net,tr] = train(net,simpleclassInputs,simpleclassTargets);

% 使用网络进行预测

outputs = net(simpleclassInputs);

2. 支持向量机 (SVM)

% 加载数据

load fisheriris

X = meas;

Y = species;

% 训练SVM模型

SVMModel = fitcsvm(X,Y,'KernelFunction','rbf');

% 预测新数据点

[label,score] = predict(SVMModel,X);

3. 随机森林

% 加载数据

load fisheriris

X = meas;

Y = species;

% 创建随机森林

rng(1); % 设置随机种子以便结果可重复

Mdl = TreeBagger(100,X,Y,'Method','classification');

% 预测

[Yfit,scores] = predict(Mdl,X);

4. 径向基函数 (RBF) 网络

% 加载数据

load simpleclass_dataset % 假设这是一个简单的分类数据集

% 定义RBF网络结构

net = newrb(simpleclassInputs,simpleclassTargets,0.01);

% 使用网络进行预测

outputs = net(simpleclassInputs);

5. 长短期记忆网络 (LSTM)

% 准备序列数据

sequences = ...; % 序列数据

YTrain = ...; % 目标数据

% 定义LSTM网络架构

layers = [ ...

sequenceInputLayer(inputSize)

lstmLayer(numHiddenUnits,'OutputMode','sequence')

fullyConnectedLayer(numClasses)

softmaxLayer

classificationLayer];

% 指定训练选项

options = trainingOptions('adam', ...

'MaxEpochs',100, ...

'MiniBatchSize',50, ...

'InitialLearnRate',0.01, ...

'GradientThreshold',1, ...

'Verbose',0, ...

'Plots','training-progress');

% 训练LSTM网络

net = trainNetwork(sequences,YTrain,layers,options);

示例代码汇总

% 神经网络

hiddenLayerSize = 10;

net = patternnet(hiddenLayerSize);

[net,tr] = train(net,simpleclassInputs,simpleclassTargets);

outputs = net(simpleclassInputs);

% SVM

SVMModel = fitcsvm(X,Y,'KernelFunction','rbf');

[label,score] = predict(SVMModel,X);

% 随机森林

rng(1);

Mdl = TreeBagger(100,X,Y,'Method','classification');

[Yfit,scores] = predict(Mdl,X);

% RBF

net = newrb(simpleclassInputs,simpleclassTargets,0.01);

outputs = net(simpleclassInputs);

% LSTM

layers = [ ...

sequenceInputLayer(inputSize)

lstmLayer(numHiddenUnits,'OutputMode','sequence')

fullyConnectedLayer(numClasses)

softmaxLayer

classificationLayer];

options = trainingOptions('adam', ...

'MaxEpochs',100, ...

'MiniBatchSize',50, ...

'InitialLearnRate',0.01, ...

'GradientThreshold',1, ...

'Verbose',0, ...

'Plots','training-progress');

net = trainNetwork(sequences,YTrain,layers,options);

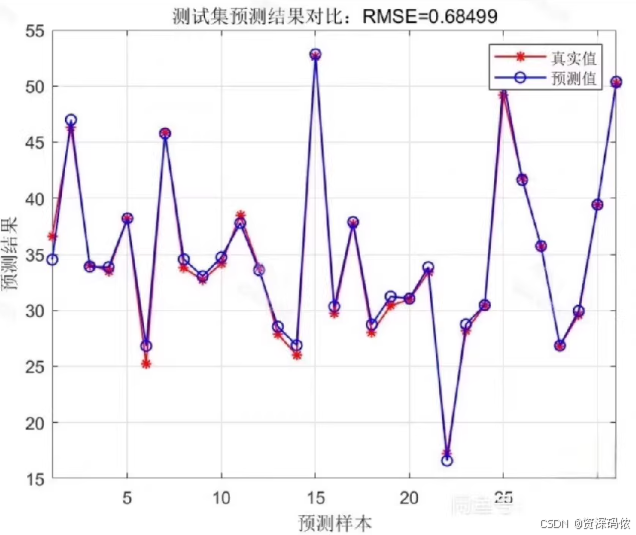

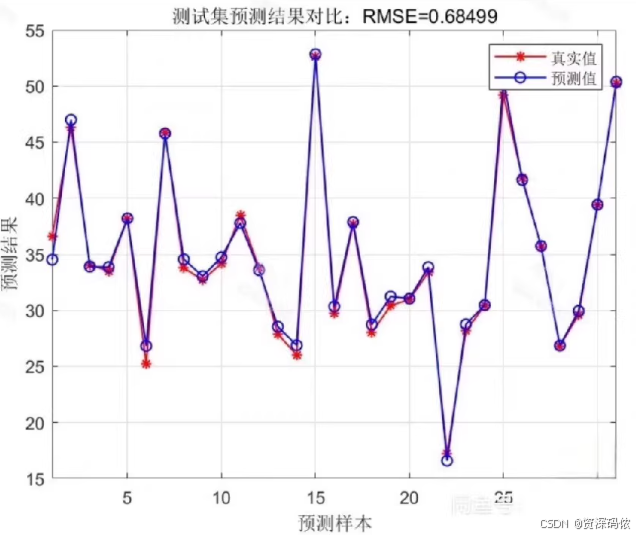

绘制预测结果对比图

假设你已经完成了模型的训练和预测,以下是绘制预测结果对比图的代码示例:

% 假设你已经有了真实值和预测值

true_values = ...; % 真实值

predicted_values = ...; % 预测值

% 计算RMSE

rmse = sqrt(mean((true_values - predicted_values).^2));

% 绘制预测结果对比图

figure;

plot(true_values, 'r*', 'DisplayName', '真实值');

hold on;

plot(predicted_values, 'b-o', 'DisplayName', '预测值');

title(['训练集预测结果对比: RMSE=' num2str(rmse)]);

xlabel('预测样本');

ylabel('预测结果');

legend('Location', 'best');

grid on;

hold off;

希望这些代码示例能够帮助你开始在MATLAB中使用这些机器学习方法。

)

为了帮助你更好地理解如何在MATLAB中实现神经网络、支持向量机(SVM)、随机森林、径向基函数(RBF)网络和长短期记忆(LSTM)网络,并附上相应的代码示例,我将逐一提供这些模型的基本实现代码。以下是一些基本的示例代码:

1. 神经网络

% 加载数据

load simpleclass_dataset % 假设这是一个简单的分类数据集

% 创建并训练一个两层前馈神经网络

hiddenLayerSize = 10;

net = patternnet(hiddenLayerSize);

[net,tr] = train(net,simpleclassInputs,simpleclassTargets);

% 使用网络进行预测

outputs = net(simpleclassInputs);

2. 支持向量机 (SVM)

% 加载数据

load fisheriris

X = meas;

Y = species;

% 训练SVM模型

SVMModel = fitcsvm(X,Y,'KernelFunction','rbf');

% 预测新数据点

[label,score] = predict(SVMModel,X);

3. 随机森林

% 加载数据

load fisheriris

X = meas;

Y = species;

% 创建随机森林

rng(1); % 设置随机种子以便结果可重复

Mdl = TreeBagger(100,X,Y,'Method','classification');

% 预测

[Yfit,scores] = predict(Mdl,X);

4. 径向基函数 (RBF) 网络

% 加载数据

load simpleclass_dataset % 假设这是一个简单的分类数据集

% 定义RBF网络结构

net = newrb(simpleclassInputs,simpleclassTargets,0.01);

% 使用网络进行预测

outputs = net(simpleclassInputs);

5. 长短期记忆网络 (LSTM)

% 准备序列数据

sequences = ...; % 序列数据

YTrain = ...; % 目标数据

% 定义LSTM网络架构

layers = [ ...

sequenceInputLayer(inputSize)

lstmLayer(numHiddenUnits,'OutputMode','sequence')

fullyConnectedLayer(numClasses)

softmaxLayer

classificationLayer];

% 指定训练选项

options = trainingOptions('adam', ...

'MaxEpochs',100, ...

'MiniBatchSize',50, ...

'InitialLearnRate',0.01, ...

'GradientThreshold',1, ...

'Verbose',0, ...

'Plots','training-progress');

% 训练LSTM网络

net = trainNetwork(sequences,YTrain,layers,options);

示例代码汇总

% 神经网络

hiddenLayerSize = 10;

net = patternnet(hiddenLayerSize);

[net,tr] = train(net,simpleclassInputs,simpleclassTargets);

outputs = net(simpleclassInputs);

% SVM

SVMModel = fitcsvm(X,Y,'KernelFunction','rbf');

[label,score] = predict(SVMModel,X);

% 随机森林

rng(1);

Mdl = TreeBagger(100,X,Y,'Method','classification');

[Yfit,scores] = predict(Mdl,X);

% RBF

net = newrb(simpleclassInputs,simpleclassTargets,0.01);

outputs = net(simpleclassInputs);

% LSTM

layers = [ ...

sequenceInputLayer(inputSize)

lstmLayer(numHiddenUnits,'OutputMode','sequence')

fullyConnectedLayer(numClasses)

softmaxLayer

classificationLayer];

options = trainingOptions('adam', ...

'MaxEpochs',100, ...

'MiniBatchSize',50, ...

'InitialLearnRate',0.01, ...

'GradientThreshold',1, ...

'Verbose',0, ...

'Plots','training-progress');

net = trainNetwork(sequences,YTrain,layers,options);

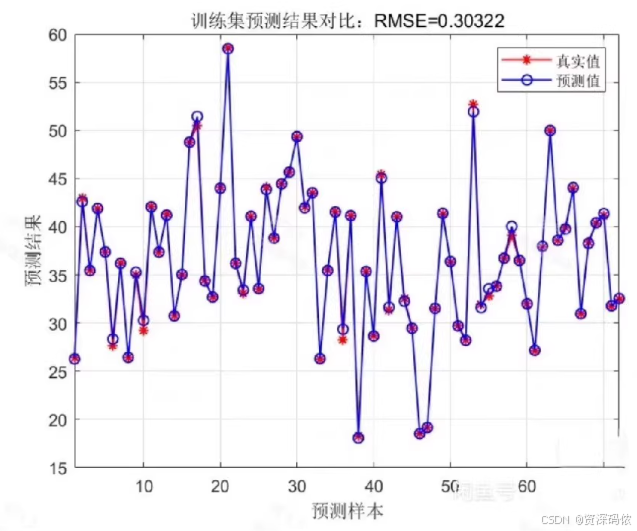

绘制预测结果对比图

假设你已经完成了模型的训练和预测,以下是绘制预测结果对比图的代码示例:

% 假设你已经有了真实值和预测值

true_values = ...; % 真实值

predicted_values = ...; % 预测值

% 计算RMSE

rmse = sqrt(mean((true_values - predicted_values).^2));

% 绘制预测结果对比图

figure;

plot(true_values, 'r*', 'DisplayName', '真实值');

hold on;

plot(predicted_values, 'b-o', 'DisplayName', '预测值');

title(['训练集预测结果对比: RMSE=' num2str(rmse)]);

xlabel('预测样本');

ylabel('预测结果');

legend('Location', 'best');

grid on;

hold off;

希望这些代码示例能够帮助你开始在MATLAB中使用这些机器学习方法。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?