问题预览/关键词

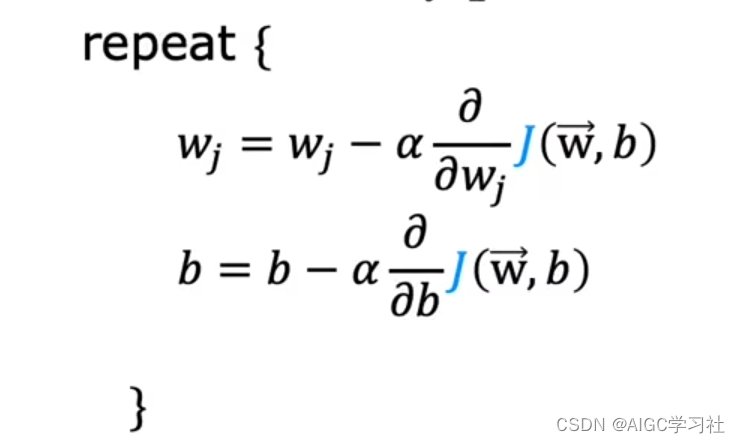

逻辑回归的梯度下降算法公式

和多元线性回归一样,有几个特征,就要同时计算几个wj。

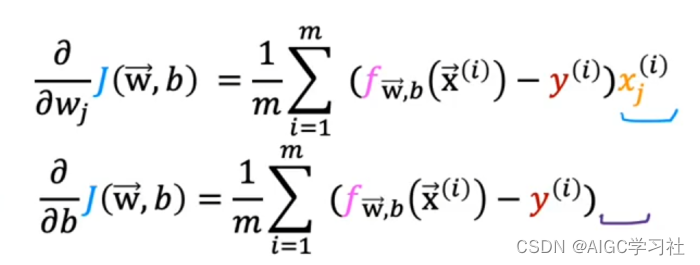

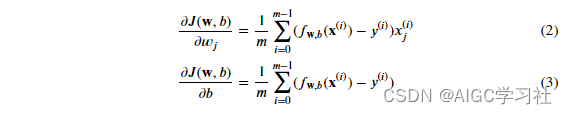

计算梯度下降的导数项

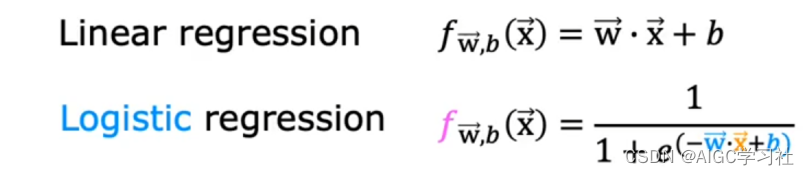

逻辑回归和线性回归的梯度下降算法区别

从梯度下降算法的形式上看,似乎没有区别。但是用于计算的f(x)函数不同,因此它们是不同的算法。

逻辑回归和线性回归在梯度下降算法的通用之处

检测梯度下降收敛

检测梯度下降收敛的方法一致,详见5.7(检测梯度下降是否收敛)。

向量化操作

都可以向量化操作,详见课后实验代码。

特征缩放

都可以使用特征缩放,加快逻辑回归的梯度下降。

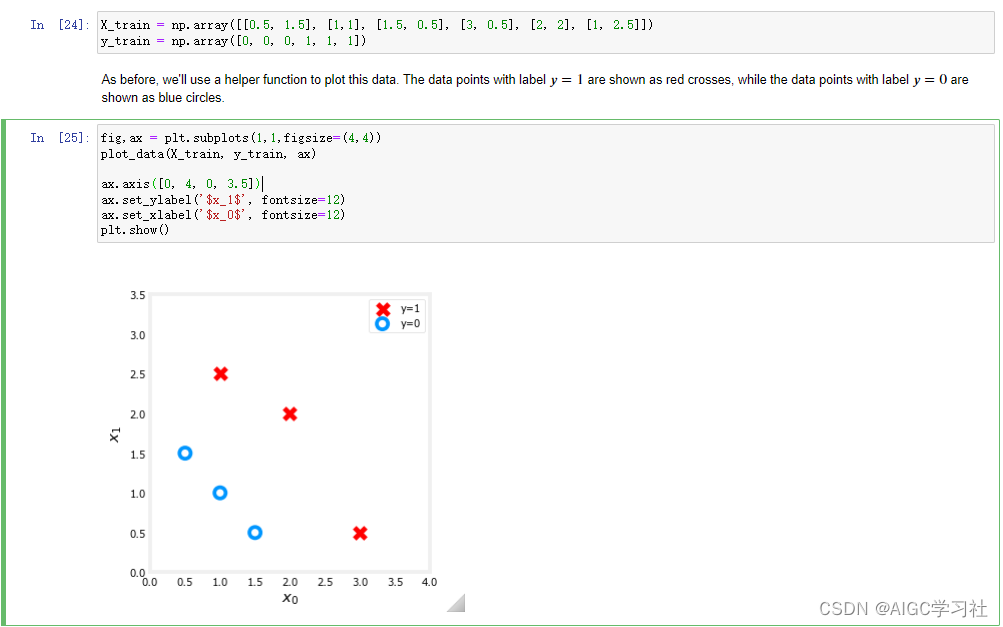

实验

创建训练集并绘制散点图

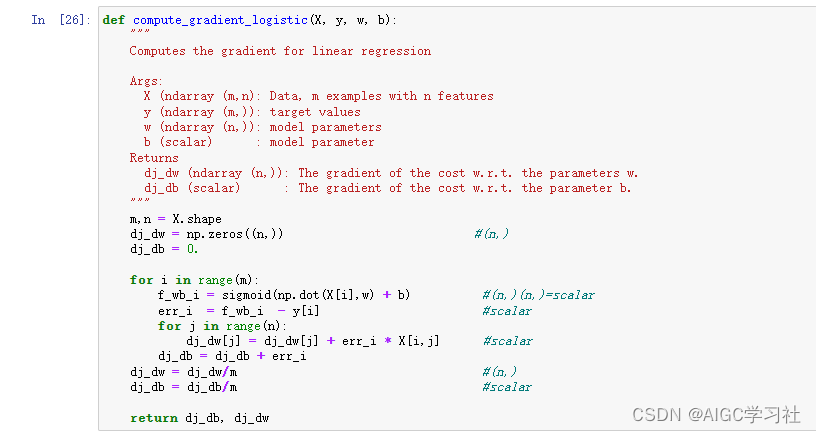

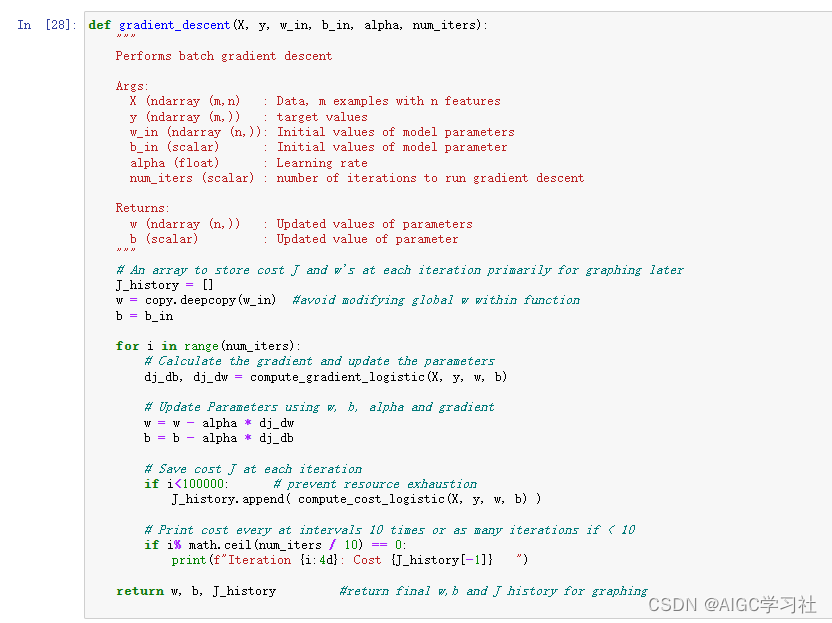

计算梯度下降的导数项

- 公式

- 计算过程解析详见第二周课后实验的Lab02。

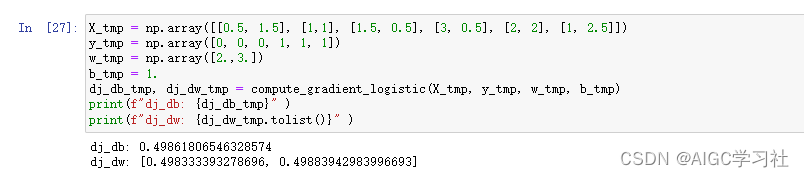

- 调用函数,执行一次梯度下降。

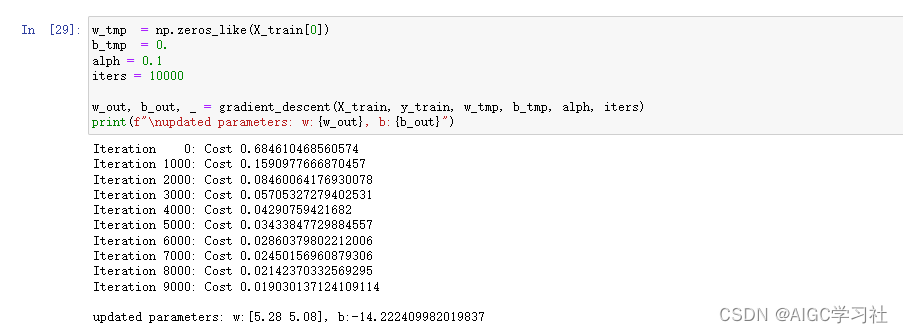

运行梯度下降

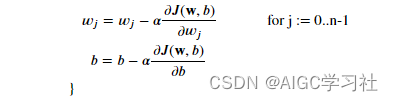

- 公式

- 根据公式编写函数

- 调用函数,计算出w,b。

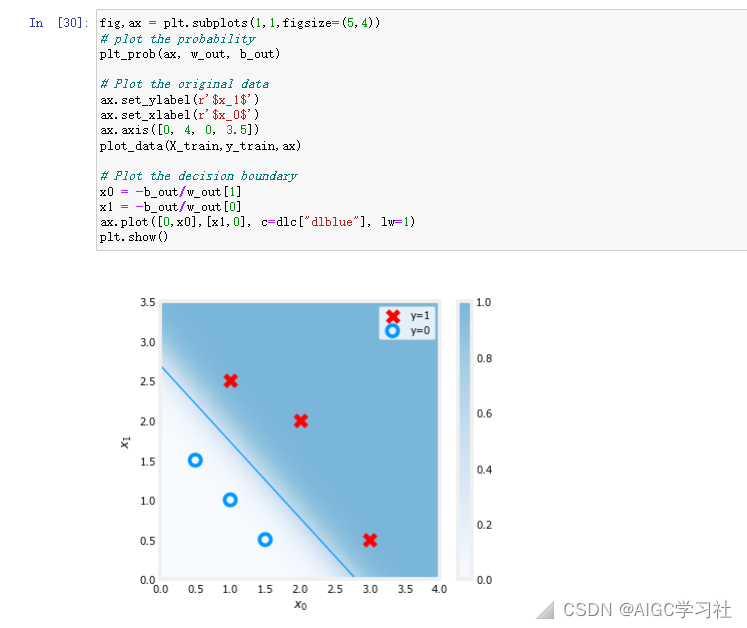

根据w,b构建决策边界

决策边界能够很好的将训练集的数据分类,证明计算出的w,b很合适。

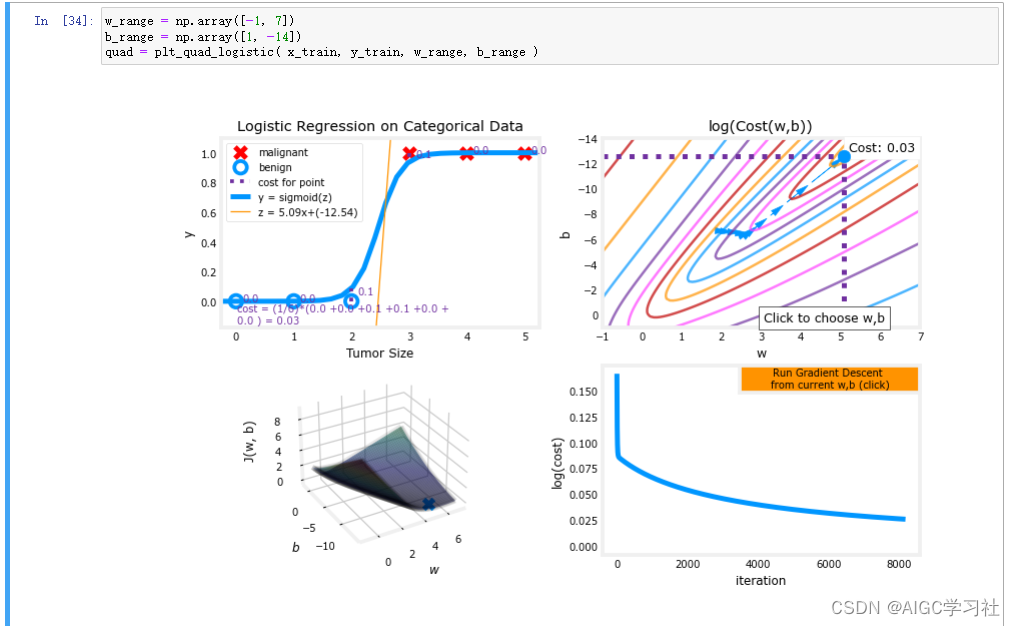

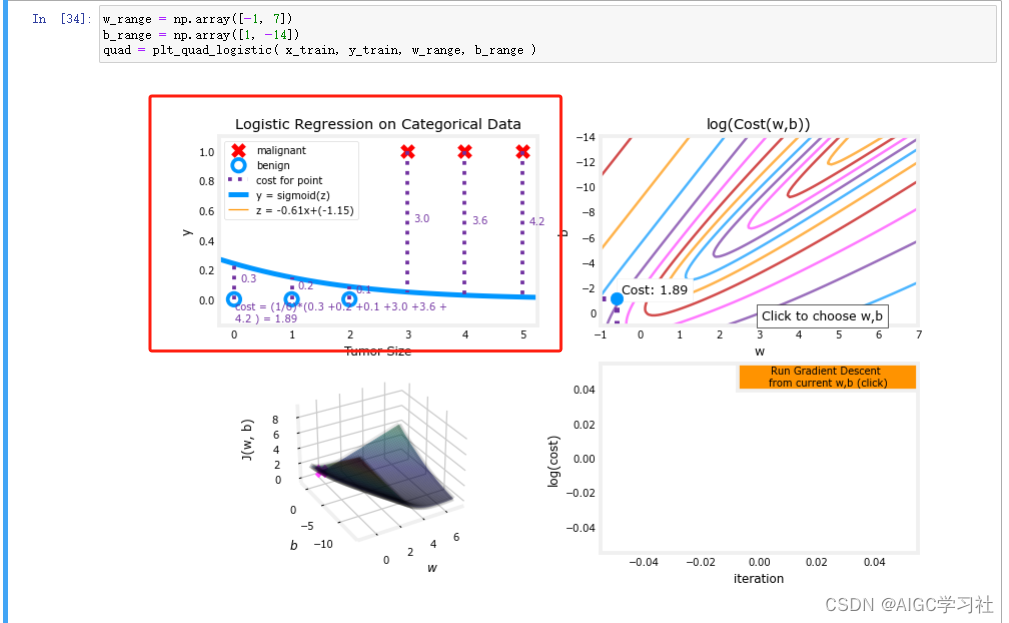

可视化理解成本函数和梯度下降迭代(单特征)

- 点击右上方等高线图,可以修改w,b,然后点击右下角的橘色按钮运行梯度下降,观察四张图的变化。

- w,b离等高线图越远,模型预测效果越差,因此左上方的逻辑回归模型对于每个训练集数据的损失越大。

总结

本节主要讲述了如何计算逻辑回归的梯度下降,并演示了如何用Python实现。逻辑回归和线性回归的梯度下降算法很相似,但因为它们的f(x)不同,因此也是不同的算法。

本文讲解逻辑回归梯度下降算法,Python实现,与线性回归的区别及收敛检测。

本文讲解逻辑回归梯度下降算法,Python实现,与线性回归的区别及收敛检测。

1364

1364

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?