文章链接:https://arxiv.org/pdf/2406.16815

项目地址:https://ggxxii.github.io/clothedreamer

高保真度的基于文本的三维服装合成对于数字化人物创建是可取的,但也具有挑战性。最近基于扩散的方法,通过评分蒸馏抽样(SDS)实现了新的可能性,但要么与人体紧密耦合,要么难以重复使用。

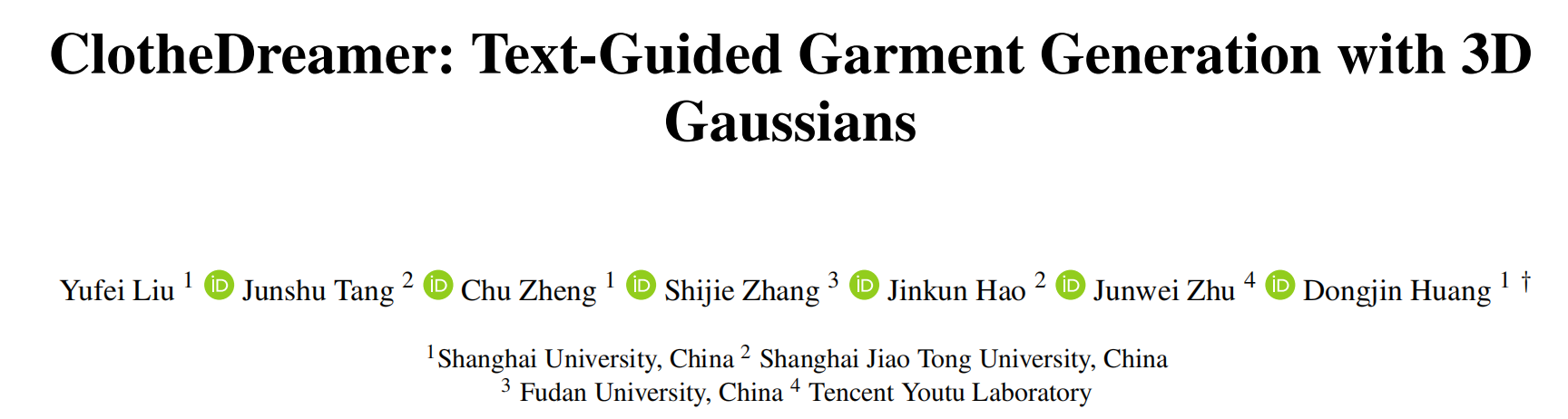

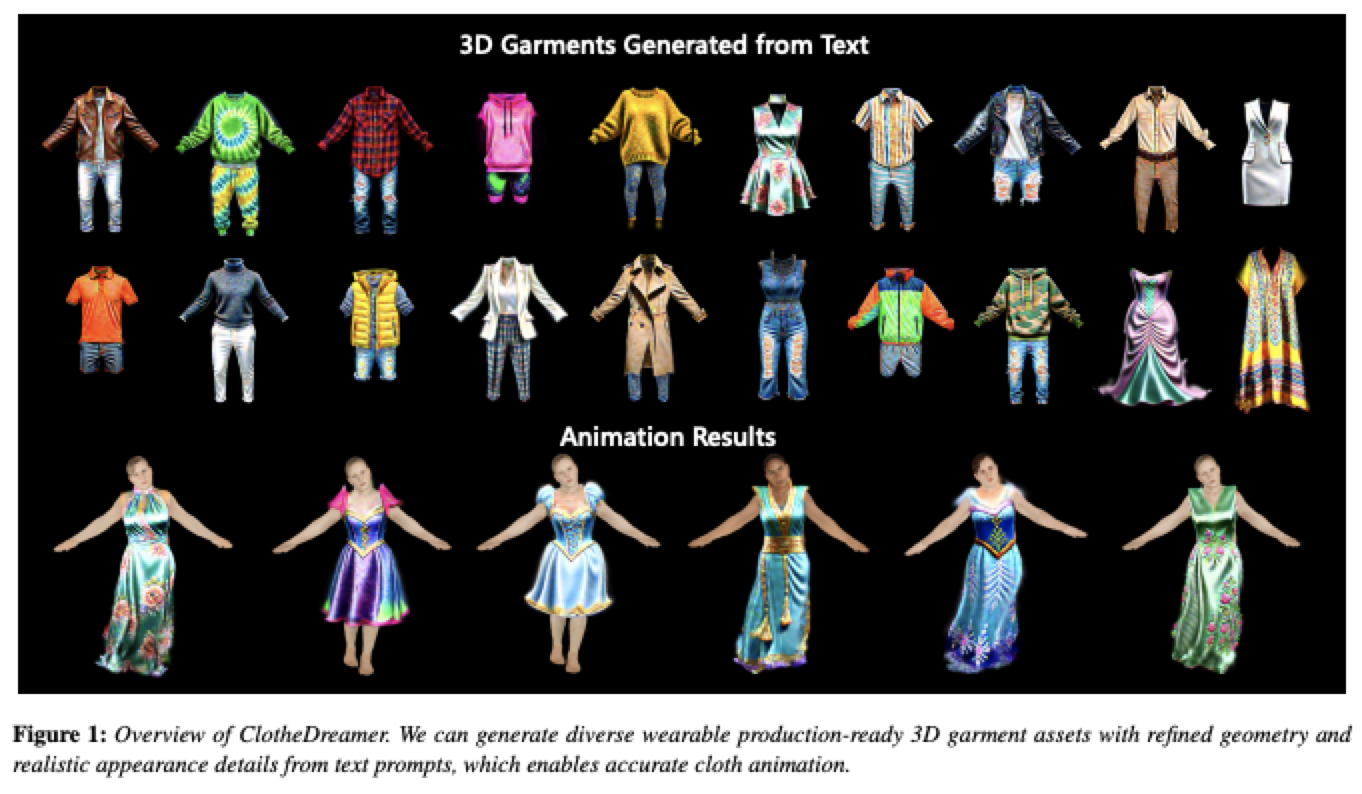

本文引入了ClotheDreamer,这是一种基于三维高斯的方法,用于从文本提示生成可穿戴的、适合生产的三维服装资产。本文提出了一种新颖的表示方法,称为解耦服装Gaussian Splatting(DCGS),以实现分离优化。DCGS将着装的人物头像表示为一个高斯模型,但冻结了身体高斯斑点。为了提高质量和完整性,本文结合了双向SDS来监督着装的人物头像和服装的RGBD渲染,分别带有姿势条件,并提出了一种新的宽松服装修剪策略。

本文的方法还可以支持自定义的服装模板作为输入。通过本文的设计,合成的三维服装可以轻松应用于虚拟试穿,并支持物理精确的动画。广泛的实验展示了本文方法优越且具有竞争力的性能。

亮点直击

本文引入了ClotheDreamer,这是一种结合了解耦服装Gaussian Splatting(DCGS)的新型3D服装合成方法。本文的技术通过基于ID的初始化,有效地将服装与人体分离,便于从文本提示生成多样化且可穿戴的服装资产。

本文提出了双向SDS指导,以高效地正则化服装高斯的基础几何,并提出了一种修剪策略,以增强宽松服装的完整性。

本文的方法通过模板网格指导支持定制化服装生成,并通过模拟网格先验实现准确的服装动画。广泛的实验表明,ClotheDreamer在文本一致性和整体质量方面优于现有方法。

方法

在本文中,本文介绍了一种基于3D高斯的高保真可重复使用3D服装生成方法,命名为ClotheDreamer。本文的框架概述如下图2所示。为了改善合成服装与人体的互动,本文提出了一种新颖的解耦服装Gaussian Splatting(DCGS),将穿着的身体部分分为SMPL身体部分和服装部分。在第一部分中,本文根据文本指令开始使用来自SMPL的相对语义ID初始化DCGS。然后提出通过操控优化梯度来学习身体部位和服装之间的解耦。在第二部分中,本文介绍了对单个渲染的双向SDS指导和一种新的宽松服装修剪策略。在第三部分中进一步展示了本文框架的有效性,可以实现模板引导生成,以简化定制化。最后展示了合成服装在多样化身体动作下的动画过程。

Zero-shot服装生成

基于ID的DCGS初始化。人类服装展示了多样且复杂的形状。以前的方法使用 SfM 点或 Shap-E 和 Point-E 生成的通用点云作为初始点,这在人体类别中表现不佳,难以提供强有力的先验。最近一种流行的初始化选择是使用一致的身体模型,如 SMPL 或 SMPL-X,因为它们结构良好且可参数化以进行优化。然而,这些方法通常在整个身体网格表面上采样点,使得难以单独操控服装。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?