Caffe学习:绘制loss和accuracy曲线(使用caffe的python接口)

上一篇博客讲到了使用caffe的工具包来绘制loss曲线和accuracy曲线,这篇文章主要将如何使用caffe的python接口绘制这两种曲线,以下的内容转自于:

http://www.cnblogs.com/denny402/p/5686067.html

使用python接口来运行caffe程序,主要的原因是python非常容易可视化。所以不推荐大家在命令行下面运行python程序。如果非要在命令行下面运行,还不如直接用 c++算了。

推荐使用jupyter notebook,spyder等工具来运行python代码,这样才和它的可视化完美结合起来。

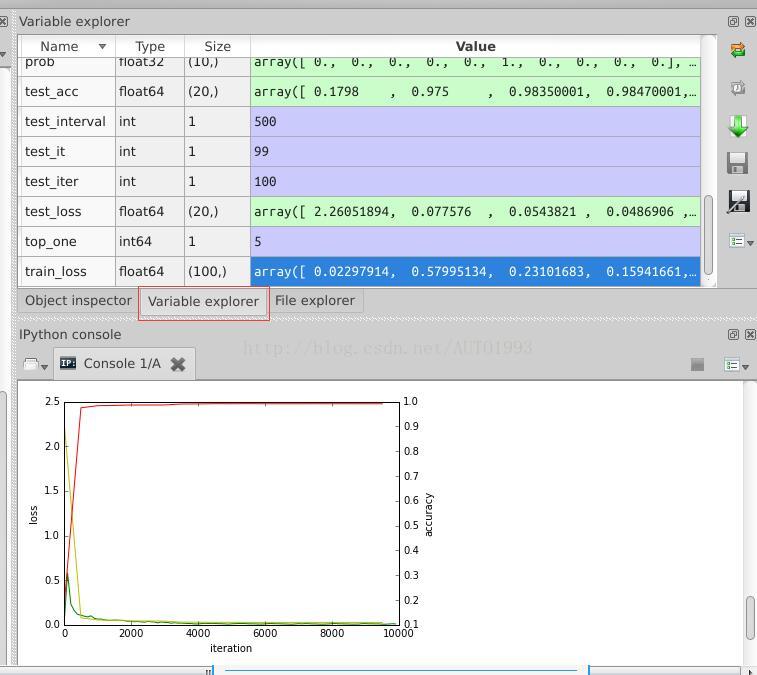

因为我是用anaconda来安装一系列python第三方库的,所以我使用的是spyder,与matlab界面类似的一款编辑器,在运行过程中,可以查看各变量的值,便于理解,如下图:

# -*- coding: utf-8 -*-

"""

Created on Sat May 6 11:39:29 2017

@author: root

"""

import sys

cafferoot='/root/caffe'

sys.path.insert(0,cafferoot+'/python')

import matplotlib.pyplot as plt

from numpy import zeros,arange

from math import ceil

import caffe

caffe.set_device(0)

caffe.set_mode_gpu()

# 使用Adamsolver,即随机梯度下降算法

solver=caffe.AdamSolver('/root/caffe/examples/mnist/lenet_solver_adam.prototxt')

#solver = caffe.SGDSolver('/root/caffe/examples/mnist/lenet_solver.prototxt')

# 等价于solver文件中的max_iter,即最大解算次数

niter = 10000

# 每隔100次收集一次数据

display= 100

# 每次测试进行100次解算,10000/100

test_iter = 100

# 每500次训练进行一次测试(100次解算),60000/64

test_interval =500

#初始化

train_loss = zeros(ceil(niter * 1.0 / display))

test_loss = zeros(ceil(niter * 1.0 / test_interval))

test_acc = zeros(ceil(niter * 1.0 / test_interval))

# iteration 0,不计入

solver.step(1)

# 辅助变量

_train_loss = 0; _test_loss = 0; _accuracy = 0

# 进行解算

for it in range(niter):

# 进行一次解算

solver.step(1)

# 每迭代一次,训练batch_size张图片

_train_loss += solver.net.blobs['loss'].data #注意,这里的loss表示你定义网络中loss层使用的名称,原博客中定义该网络使用的是SoftmaxWithLoss

if it % display == 0:

# 计算平均train loss

train_loss[it // display] = _train_loss / display

_train_loss = 0

if it % test_interval == 0:

for test_it in range(test_iter):

# 进行一次测试

solver.test_nets[0].forward()

# 计算test loss

_test_loss += solver.test_nets[0].blobs['loss'].data #loss名称和上面的一样

# 计算test accuracy

_accuracy += solver.test_nets[0].blobs['accuracy'].data # 这里和上面一样需要注意一下

# 计算平均test loss

test_loss[it / test_interval] = _test_loss / test_iter

# 计算平均test accuracy

test_acc[it / test_interval] = _accuracy / test_iter

_test_loss = 0

_accuracy = 0

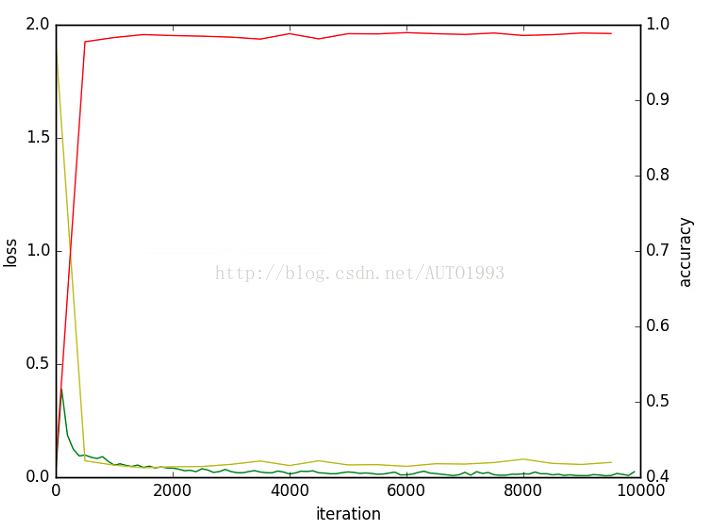

# 绘制train loss、test loss和accuracy曲线

print '\nplot the train loss and test accuracy\n'

_, ax1 = plt.subplots()

ax2 = ax1.twinx()

# train loss -> 绿色

ax1.plot(display * arange(len(train_loss)), train_loss, 'g')

# test loss -> 黄色

ax1.plot(test_interval * arange(len(test_loss)), test_loss, 'y')

# test accuracy -> 红色

ax2.plot(test_interval * arange(len(test_acc)), test_acc, 'r')

ax1.set_xlabel('iteration')

ax1.set_ylabel('loss')

ax2.set_ylabel('accuracy')

plt.show() 最后生成的曲线如下所示:

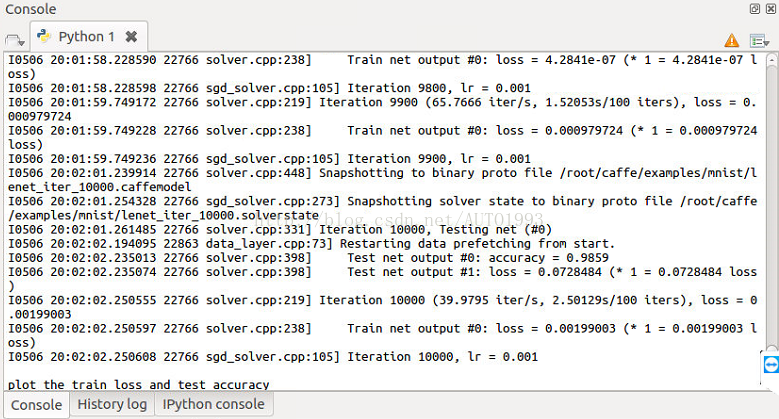

可以看出使用python接口来绘制曲线和将两种曲线绘制在一张图上。其实上面的程序相当于将网络重新训练一下,训练的时候将loss值和迭代次数,测试的accuracy值保存在相应的变量里,训练完之后再绘制。下面是使用spyder运行时的最后的结果。

1943

1943

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?