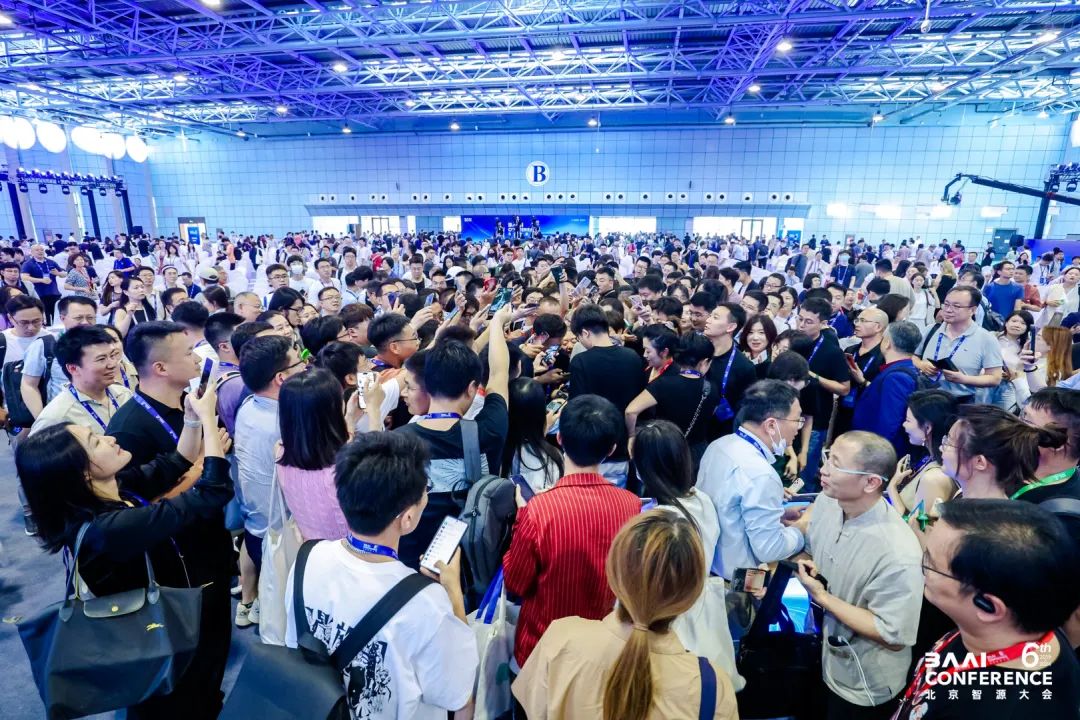

在会议现场,穿着黑色T恤的杨植麟被层层围住。

在会议现场,穿着黑色T恤的杨植麟被层层围住。

作者丨叶蓁 编辑丨王伟凯

出品丨深网·腾讯新闻小满工作室

AGI大模型,依然是2024年最炙手可热的风口。自2016年开启人工智能元年,AI产业已经历好几轮洗牌,借着ChatGPT的东风,通用人工智能大模型创业再次被置于聚光灯下。

在第六届“北京智源大会”上,百川智能CEO王小川、智谱AI CEO张鹏、月之暗面CEO杨植麟、面壁智能CEO李大海和智源研究院院长王仲远进行了对话。

怎么定义AGI,业界并没有达成共识。在这场对话中,王小川认为,大模型是通往AGI之路的基石。杨植麟指出:“不断规模化模型,不断做更好的压缩,能产生越来越多的智能。当然,这个过程会有很多挑战,最大的挑战是有一些数据并不一定有那么多,也可能根本不存在这样的数据。”

关于近期的热点事件,斯坦佛LlaMA团队抄袭了面壁智能的MiniCPM模型,面壁智能CEO李大海则回应,“我们完全没有想到我们的工作会以这种方式出圈,挺惶恐的。”

中国的大模型产业经过一年的迭代和发展,诞生了大模型“五虎”,创始人则成为明星创业者,会议结束后,月之暗面CEO杨植麟被参会者层层围住。熟悉杨植麟的人调侃,“一个 i 人,被一群 e 人围住了”。

以下是王仲远与王小川、杨植麟、李大海、张鹏的现场对话实录,经《深网》编辑整理(回放链接:https://event.baai.ac.cn/live/805)

大模型是通往AGI的基石

王仲远:各位是头部大模型公司的CEO,请教各位大模型是否是通往AGI之路的基石?有人说它依然是数据的压缩,对产业界非常有价值,但并不一定能够通往AGI。

王仲远,智源研究院院长

王仲远,智源研究院院长

杨植麟:我们认为大模型是第一性原理,需要不断提升模型的规模。它确实本质上是一个压缩,但这个压缩可以产生智能,不断规模化模型,不断做更好的压缩,它能产生越来越多的智能。当然,这个过程中会有很多挑战,最大的挑战是有一些数据并不一定有那么多。在数据没有那么多的领域,或者假设你在最后要做出来一个比人类更好的AI,可能根本不存在这样的数据,因为现在所有的数据都是人产生的。所以最大的问题是怎么解决这些比较稀缺甚至有一些不存在的数据,但是规模化定律或者大模型本身可能是没有太本质上的问题。

王小川:刚才一直在提大模型通往AGI是否是基石,我认为“基石”这个词是没有问题的。今天我们看到了提升,它只是在逼近AGI,大家看到了Scaling Law(尺度定律)是第一件事。今天还有一件被忽略的事是把语言放到大模型里,把语言变成数学,我们往前走,语言把这个符号主义跟连接主义之间产生一个突破,除了规模以外,符号和这中间的融合也是一件重要的事情。

再往后走还必须有泛式改变,比如大模型靠数据驱动学习能够做压缩。之前像AlphaGo那种自我思考的系统也会有这样的作用。所以我的结论是,我们到了AGI的时代,这个时代里我们能够有足够多的科学家进来、更多资源进来,能够走向AGI。但是以现在公开大家看到的Scaling Law这个事情是做不到AGI的。

张鹏:要说大模型是不是一个基石?同意小川说的,它肯定是基石,是不是“之一”?这是另外一个问题,这个问题涉及怎么定义AGI。站在我们现在看到的角度,我觉得做人工智能这波人挺实用主义的,所谓的实用主义就是咱们“不看广告,看疗效”,这个东西能不能解决问题,能不能真的向我们每个人心中定义的AGI路径上推进一步,大模型目前在很有效地推进这件事情,我们的Scaling Law还在有效、还在往前前进。至于它是不是能够帮助我们推到顶峰上去,我们现在找不到一个确切的答案,但是我们相信它在这个阶段是有效的,所以我认为它肯定是基石,至少是基石之一,这个没问题。

李大海:我个人是数学专业毕业的,所以我会比较严谨地去表达,我认为大模型一定是通往AGI这个方向上当前所有技术里能走得最远的,它能不能直接达到,现在还有很多未知因素,包括刚才提到的定义是什么。我提一个大家没有提到的点,现在的大模型作为知识压缩,主要是在处理人的大脑系统1的工作,这种慢思考的系统2的做各种各样推理,搜索空间去做搜索、组合,来完成一个任务,这样的能力是未来大模型通过Agent技术外部化或者把它内化为自己的能力,这是需要大家去探索的。

王仲远:关于AGI的定义,似乎没有广泛的共识。各位认为什么叫AGI?

杨植麟:首先,AGI的定义是重要的,但并不一定现在需要精确的、有量化的定义,它可能是一个定性的、感性的东西,它最重要的作用是能让这个社会或者所有人能够对接下来要发生什么事情有一个准备。因为也许这个技术节奏非常快,我们如果能够知道AGI是什么样的,如果能够定义,可以更好地准备这件事情,不管是每个人职业,还是接下来这个行业怎么发展,首先这个是重要的。第二,也一定程度上在短期内需要一些量化,因为如果没有完全量化,没有办法衡量AGI开发进度是什么样的,所以短期来说这个是很难的问题,也是很大的挑战。

杨植麟,月之暗面 CEO

杨植麟,月之暗面 CEO

王仲远:小川咱们上次在央视对话栏目提到去年是智能纪元的元年,这个智能纪元是对AGI的元年吗?

王小川:什么是AGI的定义,在全球里很难有完整的共识。大家都是学数学的,通过变换,把它从一个空间换成另一个空间来判断。在我看来,我用一个大家可以评测的指标来看,在我心中是接近等价的,是什么?是能不能造医生。为什么出这么奇怪的一个题目?医生在所有的职业里是智力密度最高的一个行业,既需要多模态,也需要少幻觉,也需要记忆,看70万字的病历,有推理能力、查文献能力等等。所以把医生跟AGI做比较时,做到医生是否就算做到AGI了?这可能有一种声音:医生只是一个Vertical,医生比这个低。人造医生太难了!这里面有太多幻觉问题,有太多推理能力不可靠。如果医生比AGI低,医生造不了,咱们就别谈AGI这件事情。在我的逻辑里,医生和AGI可以基本划等号。

李大海:我会尝试从经济学的角度来定义AGI。从经济学的角度讲,如果我们去执行任何一个任务,边际成本都为零,这就是我们理想中的AGI。回到我刚才说的,为什么我认为大模型能够走得最远,就是我相信大模型能够把边际成本一直往下降,可能会逼近于零。就像植麟刚才讲的,很多时候需要我们在各行各业的数据产生一个飞轮,逐步让模型持续训练、持续学习,让整体的成本降下去。

我们去年看到行业里面大家去做大模型落地的时候,很多的场景都还需要做微调,这个边际成本就很高。我们相信,随着模型能力的提升,慢慢从微调逐步地只需要做Promot generate(提示生成),慢慢地连Promot generate都不需要做,模型直接就问你到底有什么需求。如果你讲不清楚,我来问你。通过这种方式,我相信未来的门槛会越来越低,成本会越来越低。低到接近于零的时候,我觉得AGI基本就到来了。

我还想补充一个观点。现在大家都在讲怎么把模型做大。刚才小川提到一个关键词,叫“智能密度”。我们觉得大模型的智能密度也是一个非常重要的事情。当有一天达到AGI的时候,还要做的事情是大模型的小型化。如果用一个10万亿的参数模型做到AGI,能不能把10万亿的参数降到1万亿、降到1000亿,这也是一个要持续去突破的事情。

李大海,面壁智能CEO

李大海,面壁智能CEO

张鹏:在我们看AGI这件事,与其说它有一个很严格的定义,我更愿意相信它是我们的一种信念,是一个符号,它的内涵外延是在不断变化的。现在的问题就在于,没有人能够说清楚。反过来讲是一个好事,这个事情还有很多未知空间等待我们探索。AGI对于我们来说,可以把它定义成我们的目标。我们一直相信,当前我们的目标是以人为参照,让机器像人一样思考。这是我们的愿景。当然,机器的能力远不止人的水平,我们期待它可以出现超越人的能力,所以AGI里边我们会提到有super intelligence(超级智能)。下一步它是否能产生超过人的水平,我们会不断更新AGI的内涵和外延。

Scaling Law未来会持续演进

王仲远:今天早晨大家反复提到一个词Scaling Law,我不知道植麟对Scaling Law还是特别坚信吗?它会继续在未来这些年起作用吗?

杨植麟:对。怎么定义Scaling Law?Scaling Law是什么?如果说就沿着当前现在的方法做next token prediction,再去scale(规模)很多个数量级,用跟现在完全一样的数据去分布,我觉得它的上限是很明显的。但是,Scaling Law本身并不受这个东西的限制,只要有更多的算力,数据模型参数变大,持续产生更多的智能,但是并没有定义模型是什么样的。比如要多少个模态,中间数据是什么样的,数据是生成出来的还是用Web text,也没有规定你的Loss function是什么样的。所以,Scaling Law是会持续演进的,只是在这个过程中要scale的方法可能会发生很大的变化。像大家一直在讲的世界模型,本质上现在的大语言模型是世界模型的一个特例,只是先把里面一部分给做了,但是还能做更多持续的扩充训练方式,所以我觉得Scaling会持续。

王仲远:您对Scaling Law未来几年持续发挥作用怎么看?您觉得在未来几年是否会持续发挥作用?

王小川:我对Scaling Law到目前为止没有看到持续的发挥,美国号称要买30万片B200来做。在这种情况下,美国确实在这方面的认知程度,甚至投入程度是远远高于中国的。在我看起来,我们在Scaling Law之外,一定要去寻找范式上新的转化,比如数据算法算力。Scaling Law在里面很明确,在美国跟进的维度。不管从战略上讲还是从信仰上,我认为在Scaling Law之外都还有范式的变化,不只是去简单的变成压缩模式,会走出这样一个体系,才有机会走向AGI,才有机会跟前沿技术产生较量能力。

王仲远:张鹏,对Scaling Law呢?

张鹏:我刚才在讲AGI的时候已经表达了一些观点。Scaling Law本身这个定义,到目前为止人类认识所有的规律也好、物理定律也好、什么也好,都有可能有推翻的一天,只是看它的有效期是多长。前面加一个定语的话,到目前为止还没有看到Scaling Law会失效的预兆。未来的相当一段时间之内它仍然会有效。当然,所谓的会有效也是一个动态的概念,在于它本身所包含的事情会不断演进。就像小川说的,Scaling Law早期关注的就是参数量规模,现在慢慢扩展到参数量很重要,数据量也很重要,数据质量也很重要,变成了一种计算量。它的内涵也在慢慢变化。随着大家对规律的认知越来越深,规律的本质越来越揭示,所以掌握本质就能掌握通往未来的钥匙。基于现在大家对本质认识的深浅,至少在我们看来,仍然还会起效,会是未来我们主力想要推进的方向。

王仲远:我想追问一个问题。我们现在也看到,像GPT-5,之前传过几次说要发布,但是一直在推迟。张总,咱们自己也在训练大模型,如果我们从追逐GPT-4到要突破GPT-4,到要往GPT-5发展,Scaling Law有突破效应吗?我不知道您怎么看这个问题。

张鹏:因素有很多种,包括传说的4.5和5什么时候发布,这里面的因素非常多。就拿我们自己来说,我们自己也在选择一个道路,不断地去遵循Scaling Law往前前进。举个例子。我们开始做悟道的时候就讨论过一个方案,我们是否去做一个稠密的单体模型,还是去做MOE稀疏的多体模型,这就是当时我们认为,如何去满足Scaling Law或者追寻Scaling Law的不同路径。发展到今天这个地步的时候,你会发现里面维度已经非常多,可以在很多方面去做这个事情。同样,反过来看这个问题,你会发现复杂度又上升了,不是简单地追求参数量上去就行的,难度也变大了。所以我理解,想要实现GPT-5或者再下一代,我们自己想要实现下一代模型,里面的技术可能性、要探索的东西还是非常多的。也是一样的,正反两方面。

张鹏,智谱AI CEO

张鹏,智谱AI CEO

王仲远:大海,面壁主要是关注在端侧的大模型,我不知道在轻量级的大模型上,您认为Scaling Law也是有效的吗?

李大海:我认为Scaling Law是非常重要的。我也非常认同张鹏的意见。就是Scalinglaw是一个经验公式,是行业对大模型这样一个复杂系统观察以后的经验总结,随着训练过程中实验越来越多、认知越来越清晰,会有更细颗粒度的认知。

比如我们自己发现,除了前面说的维度之外,训练模型中的训练方法本身对于Scalinglaw、对于智能的影响是比较显著的。这个显著的影响在我们固定住参数规模以后变得非常重要,因为现在参数规模不断往上,它是低垂的扩势,只要扩就可以,先往上放大。但是固定让端侧芯片能够支撑这个规模的模型,能够做到足够好的智能,那数据质量、训练方法这些都变得非常重要。

王仲远:我们最近关注到一个热门新闻是关于开源社区的事情,斯坦佛LlaMA这个团队抄袭了咱们的MiniCPM,不知道您对这个事件怎么看?

李大海:最近这个事情在国内引起非常大反响,我们完全没有想到我们的工作会以这种方式出圈,挺惶恐的。这里澄清一下,我们自己认为这其实是海外个别学生组成的一个小团队做的个人行为,它不代表任何更大的像斯坦佛这样的学校。因为事件发生以后,斯坦佛系主任和西方同行都表达了价值观非常正的观点。

另外,因为这个事件,我们更加坚定相信开源的力量,这个事件的发现也是靠开源的热心参与者发现的,并不是我们自己发现的。我们是5月20日把这个模型开源出来,到了5月29日时这几个本科生小朋友就做了一些非常简单的工作,在我们的模型上做了一个高斯叠加,叠加一些高斯噪声,就号称是自己的模型。当然,这个模型一下子变得很受欢迎,主要原因是因为他们宣称:这个模型的多模态能力是跟GPT4-V和完全对标,但是参数只有后者的1%,并且只需要500美金就能够训练出来。前两项是真的,我们模型确实有这个能力,但是500美金训练不出来,需要花很多钱。

AGI当下的能力不足以颠覆人类

王仲远:随着大模型发展,AI安全问题被不断讨论。各位都是做企业的,我想了解一下AI安全在大模型产业怎么去看?是当下最急迫的问题吗?

杨植麟:AI安全是非常重要的,它可能不一定是当前最急迫,但是一个需要我们提前去准备的事情。因为随着模型的进展,Scaling Law的发展是每N个月算力乘10倍,这里你的智能会得到提升,是一个逐渐去适应的过程。它不一定是当前最大的矛盾或者最紧急的事情,但它肯定是长期储备。

这里面最重要的是两个方面,一个是模型本身会因为用户本身有些恶意意图,导致它去做一些本来不应该做的事情。比如现在有研究在prompt里注入一些不太恰当的意图,这些需要去关注。第二个是你的模型本身会不会有自己的motivation,这是跟训练方式相关的,包括能不能在模型的底层去注入比如AI的宪法,去框定它的行为,不管用户给什么指示,都不会违背这个宪法。

王小川:安全有不同的内涵和外延,所以我想提三个与安全相关的事情。

第一个,意识形态的安全。做to C有这样一个服务,作为中国的大模型,意识形态上跟国家发展保持一致是大家的基本功,每个模型有他们的价值观,我们有我们的价值观,这个安全是对民族、对社会负责任的一件事情,这个安全是底线,大家得把它做好了。

第二个,大家空谈得比较远的这种安全:这个模型是不是把人类毁灭了?以后人就没了,然后机器掌握世界了。我内心最不希望像核弹一样把人类文明搞没了,人类发展好几千年,好不容易有这样一种智慧及模型,不希望把地球搞没了。但是至于这个模型是不是比人更聪明,能够取代人做事情,我觉得这件事情是值得鼓励的一件事情。因为从人类文明,生孩子、发展技术去延续人类和延续文明才是重要的,人的肉身会死亡的,今天大家不回避这个问题。所以技术跟我们人类一块拓展文明是有意义的,不要限制。我去年写了一封公开信,AGI帮助我们延续和繁荣人类文明是一个目标,让人类更好地延续,而不是让机器当我们的奴隶、当我们的工具,这是在安全里面以文明为标准去看待它,这是第二层安全的理想色彩 。

第三个安全是比较现实的,刚才提到AGI是什么、怎么评测?当我跟很多人聊拿AGI做个医生,大家觉得很难,现在搞不定。如果连这个都做不到,那它能力如此之弱,我们就不要想它会颠覆人类这个复杂的事。所以,近期还不存在这个安全的问题。

王小川,百川智能CEO

王小川,百川智能CEO

王仲远:前一段时间智谱签了AI安全承诺,张鹏当时是什么考量?

张鹏:当时有15家AI相关的企业,来自全球各地各大洲,一起签署负责任的AI承诺书。安全只是其中一部分,我们叫“负责任的AI”,安全的AI包括刚才小川讲的三个方面的安全,但还有更低的问题,就是如何保证和如何努力让这个技术帮助人类、社会、地球,而不是去为恶。

当然,人有两面性,很难保证没有人拿这个事情去作恶,现实社会中已经发现有人在做这件事情,这件事情永远是防守比破坏要难,需要大家一起共同努力。我相信这个事情更重要的意义并不是我们现在能拿出多么安全的技术、方法或者管理规定去约束大家,而是增强大家对这件事情的了解,对这件事情统一的认识,大家能够坐下来正面面对这些问题,把这些问题摆在桌面上来,希望更多人一起参与讨论这件事情,总有解决问题的办法。

王仲远:大海对AI安全的看法呢?

李大海:我比较同意前面各位老板说到的观点。我认为现在这个阶段,安全主要还是聚焦在基础安全跟内容安全这两个方向上,现在的大模型本质上是只读的,模型训练也好,权重是固定的,推理不会影响权重,权重都是在线下持续阶段去训练的。有一天,当我们把模型部署到机器人,部署到我说的终端上,它能够去动态更新自己的权重以后,我觉得安全问题会变成一个非常重要的问题。

价格战对中国大模型的发展是有利的

王仲远:最近有好多记者朋友也都在问我:对于最近的大模型价格战怎么看?我当时给他们的回复:智源研究院坚定地拥抱开源,免费给整个产业界、整个社区使用。但我想请教一下诸位对于大模型价格战的看法,它是更有利于大模型的普及,还是不利于企业的发展。

杨植麟:这是很好的问题。如果我们把时间线拉足够长的话,最终还是会回归价值本身。我自己有三个判断。第一个,我们去看算力的投入,可能投入在推理上的算力,在某个时间点之后应该是可以显著超过训练的算力。我觉得这个标志价值开始得到释放,前面用来训练的成本是可以很大程度上被覆盖。第二个很重要的节点,如果从C端的角度来说,推理成本可能会显著低于获客成本,所以从商业本质上来讲,可能不会跟之前的各种商业模式有非常本质的区别。我觉得这两个是很重要的。第三个因素,AI在整个人的工作流程里面的占比还是很低的,可能是1%。也就是说,人做的事情要远远多于AI做的事情。AI本身做的事情,可能会在某个时间点超过人做的事情。这个时候,它就可能会产生新的商业模式,它可能不是像今天说的在B端用API做价格战,可能是一个普惠的AI,同时根据它产生的价值从这里面去分成产生的商业模式。这三个点,可能会是改变商业模式本身或者ROI这个问题很重要的方式。

王仲远:小川,你对近期的大模型价格战怎么看?

王小川:我先说结论,今天的价格战对中国发展大模型是非常特别的事。我是积极看待这个事情。首先,好不好,得看对单个公司还是对整个市场。因为价格战通常是市场行为,是竞争的导向,至少带来两个好的后果:第一个,更多公司、更多人用上大模型了,使得大模型在中国迅速普及,不管是个人还是企业都能入场了。第二个,很多企业但凡有点技术能力都要自己训练点大模型,甚至来找我们联合训练,明明它该是大模型的用户、消费者、使用方,但都想转型成为大模型的供给方,这种情况下,带来很多人才、资金和社会的浪费。价格战之后,很多企业清醒了,退回来成为大模型的用户。我们不需要一千、一万个大模型。

王仲远:张鹏你赞同小川的观点吗?

张鹏:基本上是赞同这个观点的。有人跑过来跟我们说:你们是这轮价格战的发起方。我说子虚乌有。在那个之前,我们一直秉持的概念就是你说的ROI,给用户带来最大的收益价值,用我们的技术、用我们的创新降低使用成本,就是为了让技术能够更多的普及,让更多人能够享受这个收益。在很长一段时间,我们的价格都是行业内极低的。因为我们的技术确实能做到那一步,能把中间的成本空间释放出来当作大家的收益。从宏观角度来讲,对中国大模型产业是有利的,让更多人来使用,让更多人真的把大模型当作我们一开始提到的那件事情,就是它会变成基础设施。基础设施什么意思?当真的有一天AI大模型能力变成水、电基础能力的时候,这个事对我们来讲、对企业来讲一个更好的发展空间、更好的发展态势,这也是我们一直在坚持做的事情。包括最近20号发的新模型,真的是把成本已经压到我们都不好意思跟大家报价的地方,就是几分钱,把单位变成100万Token多少钱,已经到了这样的地步了。这件事情对整体上大的是有好处的,但是也要注意,不要过多地关注和宣扬这件事情。商业上,你去牺牲企业短期的成本,亏本做买卖不是正常的商业逻辑,只能持续很短的时间,真正还是要回归最终的用户价值、生产力价值。

王仲远:在端侧的大模型会面临价格战的困扰吗?

李大海:我们做端侧,就是看到了端侧能更早更快落地的可能性。最近有机构做过一个调研,发现全国10亿用户的手机端侧的算力,相当于差不多100万片A100。这是一个非常夸张的数字。如果不同的手机上的算力能够被好好利用起来,很多应用就可以落地了。当然,现在这个阶段,包括到未来,都需要端侧跟云侧模型好好协同。端侧有端侧的优势,它的优势是隐私性好、更可靠,但是云上的模型肯定要比端侧好,我们跟其他所有模型公司要一起协作的事。

我也非常同意前面大家所说的观点。当前所谓的价格战,多多少少有一些营销的成分在,但是我相信未来一定会比现在还要便宜,并且大家都有利润,这才是健康的方式,并且才真的能让千行百业的应用往下落地。

- 点击“查看原文” ,观看完整大会视频回放 -

Llama2、王兴兴、王鹤、卢宗青、邵林、高阳等专家共论具身前沿

Llama2、百川、ChatGLM、MiniCPM、Llama作者等共论LLM关键问题

Llama2、3作者中国首讲!LLM前世今生,AGI是我们这代人的哥白尼革命

GPT-4o、SAM、DiT、DCN、SegGPT作者共话多模态模型前沿进展

4

4

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?