从线性回归讲起

先说回归问题。对于回归问题,最常用的是用线性函数来拟合待预测值,即:

上述情况中,待预测值是在线性尺度上变化,假若是在指数尺度上变化(

y

取值类似于1、2、4、8、16…),则可将待预测值的对数作为线性函数逼近的目标,即:

这实际上是试图让

ewTx+b

来逼近

y

。更一般地,考虑单调可微函数

则有:

这样得到的模型称为“广义线性模型”(generalized linear model),其中 g 称为“联系函数”(link function)。

Logistic Regression

若要将线性函数用于分类,则只需找到

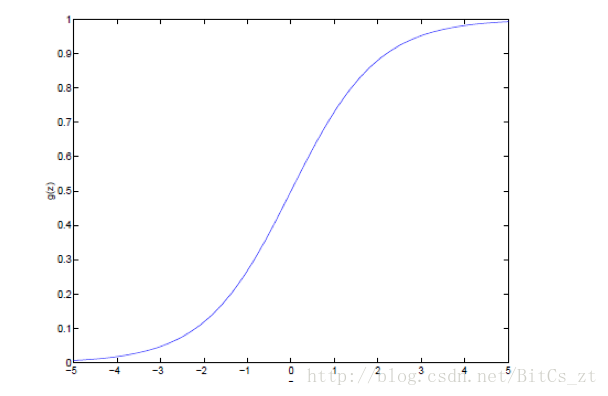

可以看到, g(z) :

-

z

趋近于正无穷时

g(z) 趋近于1 -

z

趋近于负无穷时

g(z) 趋近于0 - g(z)∈(0,1)

- g′(z)=g(z)(1−g(z))

将线性函数代入logistic function,有:

进行适当的反变换,有:

若将

y

视为样本

- 直接对分类可能性建模,无需事先假设数据分布

- 得到样本属于某一类别的近似概率

- logistic function任意阶可导,数学性质良好

LR的求解

若将上式中的

现在需要确定参数

w

使得所有训练样本属于对应标签的概率最大,即使用“极大似然法”进行参数估计。在当前模型下,每一个样本

似然函数为:

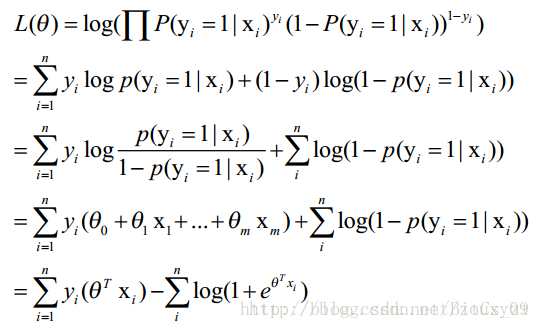

取对数(借用别人的图,其中的

θ

即为上述

w

):

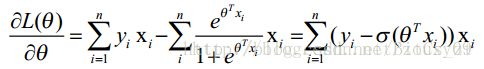

最大化似然函数,求导可得:

该式无法得到解析解,但

结合logistic function图像可以看到,在使似然函数最大化的过程,实质是让所有标签为1的样本

{x(i),y(i)=1}

所对应的

y

趋近1,即

参考如下:

周志华《机器学习》第三章

机器学习算法与Python实践之(七)逻辑回归(Logistic Regression)

SVM和logistic回归分别在什么情况下使用?

7019

7019

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?