在训练模型前,要把数据集进行分割,按照一定比例分成训练集、测试集、验证集,在有些时候也可以忽略测试集,笔者这里是分了测试集(训练集:测试集:验证集=8:1:1),废话不说,直接上代码

# h_split.py

import os

from shutil import copy

import random

def mkfile(file):

if not os.path.exists(file):

os.makedirs(file)

file = 'h_data/h_photos'

h_class = [cla for cla in os.listdir(file) if ".txt" not in cla]

# cla for cla in os.listdir(file) if ".txt" not in cla

# 查找file目录下所有的文件,也就说分类的类别即根据file目录下的文件夹个数确定分类的类别

# 创建训练集

mkfile('h_data/train')

for cla in helmet_class:

mkfile('h_data/train/'+cla)

# 创建测试集

mkfile('h_data/test')

# 创建验证集

mkfile('h_data/val')

for cla in helmet_class:

mkfile('h_data/val/'+cla)

split_rate = 0.1

for cla in h_class:

cla_path = file + '/' + cla + '/'

images = os.listdir(cla_path) # images存储了所有图片的名称

num = len(images)

eval_index = random.sample(images, k=int(num*split_rate))

# print(eval_index)

# 从images列表中抽取k个,num为图片总数,split_rate为自定义的比例

# 随机抽取出的数据为验证集, eval_index为图片名称

rest_images = list(set(images).difference(set(eval_index)))

#取images和eval_index的差集,得到未在eval_index中的图片

test_index = random.sample(rest_images, k=int(num*split_rate))

# 得到测试集数据

for index, image in enumerate(images):

# enumerate()函数按照索引序列遍历对象

if image in eval_index:

image_path = cla_path + image

new_path = 'h_data/val/' + cla

copy(image_path, new_path)

elif image in test_index:

image_path = cla_path + image

new_path = 'h_data/test/'

copy(image_path, new_path)

else:

image_path = cla_path + image

new_path = 'h_data/train/' + cla

copy(image_path, new_path)

print("\r[{}] processing [{}/{}]".format(cla, index+1, num), end="") # processing bar

print()

print("processing done!")

特别说明

1.file:要换成自己数据所在的目录

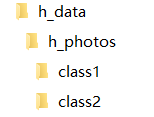

2.笔者的目录结构如下:

3.数据分割的文件(h_split.py)同h_data放在同一目录下

4723

4723

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?