业务描述:

项目中使用的数据不是那么重要,而数据又是生产者实时发送的,所以希望消费者重启之后,跳过历史数据,只接收并处理生产者新发送的数据。

找了很多博客,没有什么特别好的方法,都挺麻烦。

于是研究了一番,最简单的办法是使用动态不重复的group ID,这样每次启动Kafka client在zookeeper找不到偏移量就会应用auto-offset-reset策略,如果是latest(默认)就会从最新的偏移量开始消费。

也就是说@KafkaListener参数里的groupId,在每次启动时,如果都是动态不重复的随机数,那么就会跳过历史数据,只接收新数据。

至于springboot集成kafka收发数据,博客搜一下,很多,这里就不作赘述了。

所以将groupId设置为random.id即可。

并且不用在yml里对random.id做配置

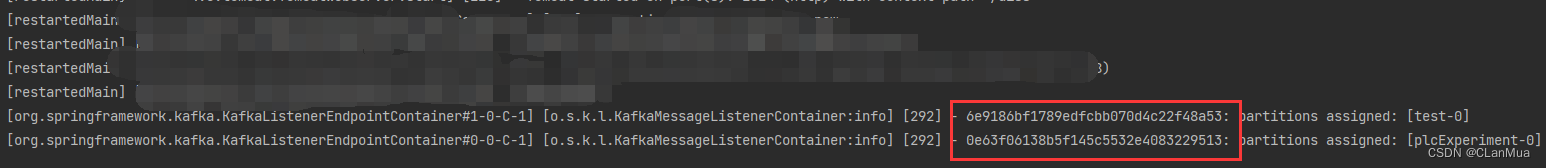

@KafkaListener(topics = "plcExperiment",groupId = "${random.id}")看图

此时每次启动的groupId都为32为数字与字符组合的随机数,也就达到了动态不重复。

所以就跳过历史数据,只接收并处理生产者新发送的数据。

375

375

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?