概念

<b>逻辑回归假设数据服从伯努利分布,通过极大化似然函数的方法,运用梯度下降来求解参数,来达到将数据二分类的目的。

分类问题不用线性回归的原因对于分类问题分类,y 取值为0 或者1。如果使用线性回归,那么线性回归模型的输出值可能远大于1,或者远小于0。导致代价函数很大。

逻辑回归算法的思想是:它的输出值永远在0 到1 之间。

推导

对于给定的输入变量x,根据选择的参数θ,计算输出变量y=1 的可能性(estimated probability)。如果对于给定的x,通过已经确定的参数计算得出hθ(x)=0.7,则表示有70%的几率y 为正向类。

逻辑函数(sigmoid函数)求导:

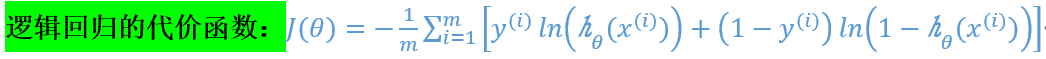

代价函数(cost function 函数)求导:

逻辑回归正则化:

正则化逻辑回归 — 代价函数

逻辑回归算法注意事项:

逻辑回归梯度下降算法表面上看上去与线性回归的梯度下降算法一样,但是这里的hθ(x)=g(Xθ)与线性回归中不同,所以实际上是不一样的。

在运行梯度下降算法之前,进行特征缩放依旧是非常必要的。

除了梯度下降算法以外,还有一些常被用来令代价函数最小的算法,这些算法更加复杂和优越,而且通常不需要人工选择学习率,通常比梯度下降算法要更加快速。

这些算法有: 共轭梯度(Conjugate Gradient);

局部优化法(Broyden fletcher goldfarb shann,BFGS);

有限内存局部优化法(LBFGS)

522

522

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?