数据、代码等相关资料来源于b站日月光华老师视频,此博客作为学习记录。

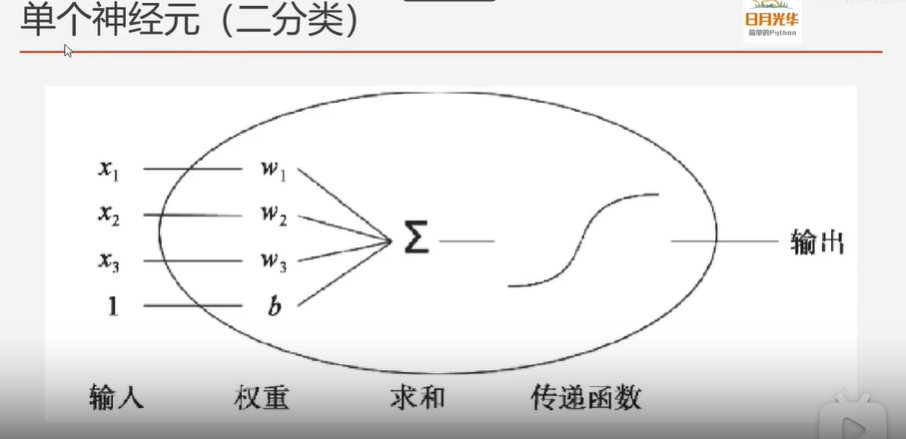

上节学习的逻辑回归模型是单个神经元:计算输入特征的加权和,再使用激活函数(传递函数)计算输出。

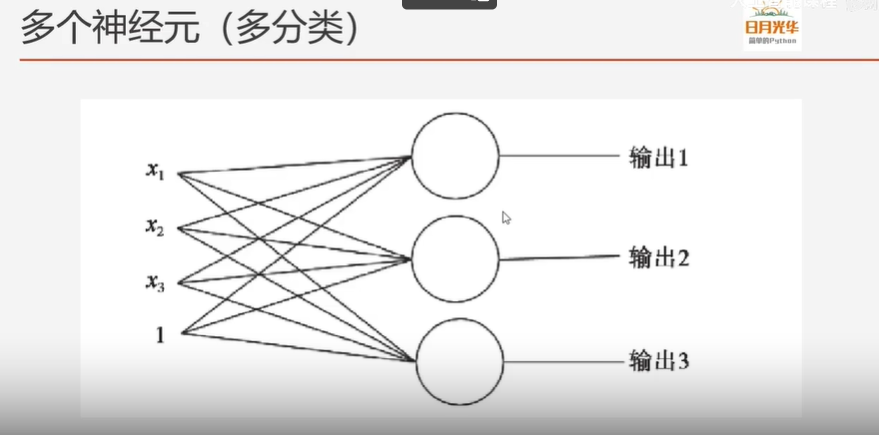

多层感知机:生物的神经元一层一层连接起来,当神经信号达到某一个条件,这个神经元就会激活,然后继续传递信息下去。为了继续使用神经网络解决这种不具备线性可分性的问题,采取在神经网络的输入端和输出端之间插入更多的神经元。

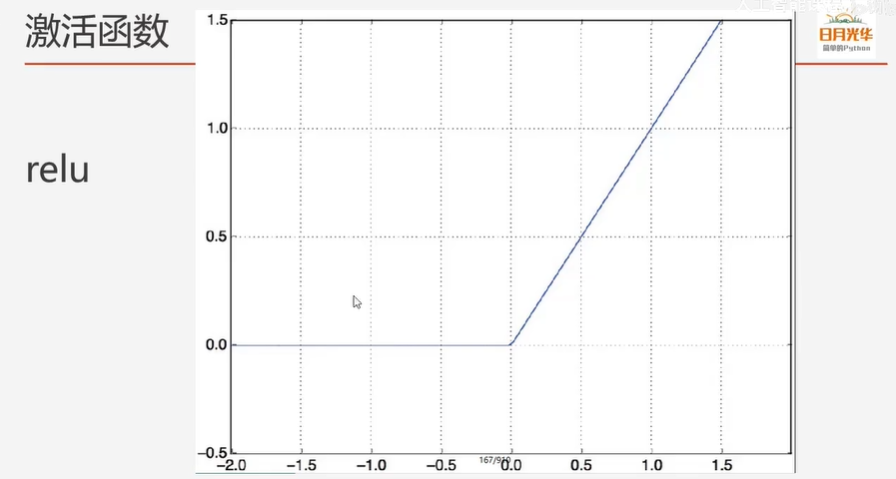

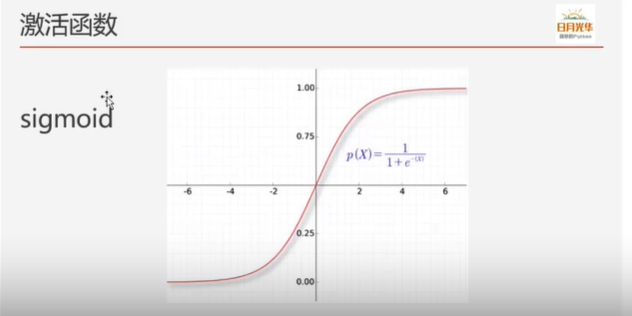

激活函数为网络带来了非线性的拟合能力。

常见激活函数:

f(x) = max(x, 0)

# 可通过torch.relu()调用

# 范围是0~1之间,把值映射成0到1之间的概率。

# 可用 torch.sigmoid()调用

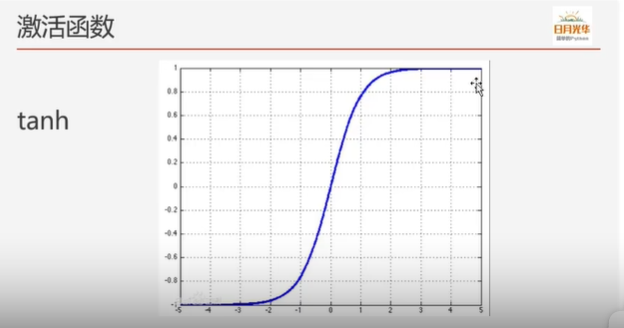

# 范围在-1到1之间

# 用torch.tanh()调用

# 带泄漏的relu函数,给负值给较小的斜率不至于全部丢失

# 通过以下方法使用:

from torch import nn

nn.LeakReLU()

297

297

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?