图像卷积

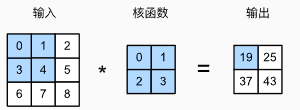

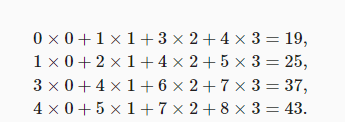

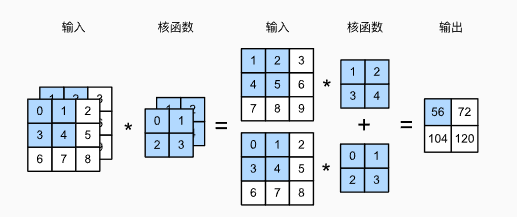

卷积原理:

就是将之前的大的图片,定义一个核函数,然后经过移动并运算将图片变小了.也就是将图像压缩提取整合特征值.

这里利用的时乘法.

填充和步幅

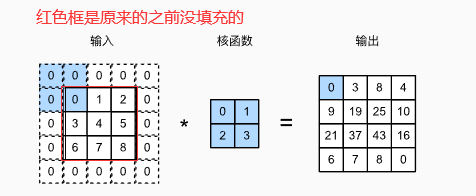

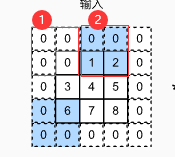

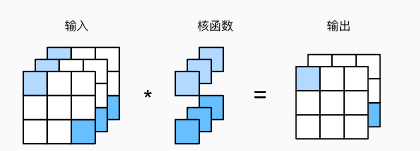

填充

在应用多层卷积时,我们常常丢失边缘像素。 由于我们通常使用小卷积核,因此对于任何单个卷积,我们可能只会丢失几个像素。 但随着我们应用许多连续卷积层,累积丢失的像素数就多了。 解决这个问题的简单方法即为填充(padding):在输入图像的边界填充元素(通常填充元素是

)。

import torch

from torch import nn

# 为了方便起见,我们定义了一个计算卷积层的函数。

# 此函数初始化卷积层权重,并对输入和输出提高和缩减相应的维数

def comp_conv2d(conv2d, X):

# 这里的(1,1)表示批量大小和通道数都是1

X = X.reshape((1, 1) + X.shape)

print(X.shape)

Y = conv2d(X)

# 省略前两个维度:批量大小和通道

return Y.reshape(Y.shape[2:])

# 请注意,这里每边都填充了1行或1列,因此总共添加了2行或2列

conv2d = nn.Conv2d(1, 1, kernel_size=3, padding=1) #

X = torch.rand(size=(8, 8))

comp_conv2d(conv2d, X).shape

步幅

在计算互相关时,卷积窗口从输入张量的左上角开始,向下、向右滑动。

通俗的来说就是一次运动多少步。

比如我下面移动两步。

# 填充边为1层,一次走两步

conv2d = nn.Conv2d(1, 1, kernel_size=3, padding=1, stride=2)

comp_conv2d(conv2d, X).shape

也可以设置上下和左右走的步长分别是什么,设置stride=(3, 4)时,意味着卷积核在输入数据的宽度(横向)上每次移动3个像素,在高度(纵向)上每次移动4个像素。

conv2d = nn.Conv2d(1, 1, kernel_size=(3, 5), padding=(0, 1), stride=(3, 4))

comp_conv2d(conv2d, X).shape

多输入多输出通道

彩色图像具有标准的RGB通道来代表红、绿和蓝。就有三个通道,比如下面的输入就是两个通道

1x1卷积层

卷积失去了卷积层的特有能力——在高度和宽度维度上,识别相邻元素间相互作用的能力。 其实1x1卷积的唯一计算发生在通道上。

使用1x1卷积核与3个输入通道和2个输出通道的互相关计算.如图:

1712

1712

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?