7.1 优化与深度学习

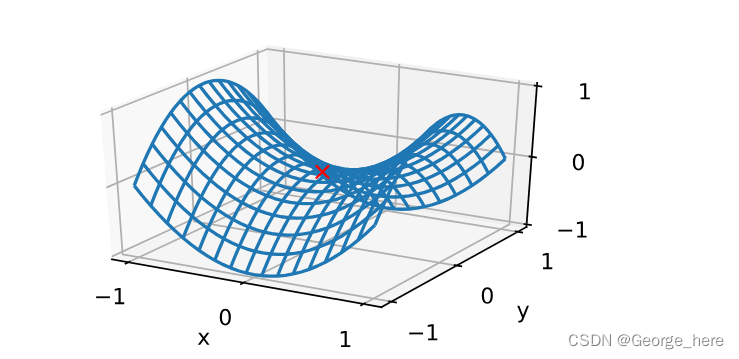

梯度接近或变成零可能是由于当前解在局部最优解附近造成的。事实上,另一种可能性是当前解在鞍点(saddle point)附近。

假设一个函数的输入为k维向量,输出为标量,那么它的海森矩阵(Hessian matrix)有�k个特征值。该函数在梯度为0的位置上可能是局部最小值、局部最大值或者鞍点。

- 当函数的海森矩阵在梯度为零的位置上的特征值全为正时,该函数得到局部最小值。

- 当函数的海森矩阵在梯度为零的位置上的特征值全为负时,该函数得到局部最大值。

- 当函数的海森矩阵在梯度为零的位置上的特征值有正有负时,该函数得到鞍点。

随机矩阵理论告诉我们,对于一个大的高斯随机矩阵来说,任一特征值是正或者是负的概率都是0.5 。那么,以上第一种情况的概率为 0.5**k。由于深度学习模型参数通常都是高维的(k很大),目标函数的鞍点通常比局部最小值更常见。

在图的鞍点位置,目标函数在x轴方向上是局部最小值,但在y轴方向上是局部最大值。

640

640

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?