Code Llama 是一系列专注于代码相关任务的大型语言模型,它构建在 Llama 2 的基础上,在开放模型中提供了最先进的性能,它在填充能力、支持大输入上下文以及零指导编程任务的能力方面表现出色。GpuMall智算云 | 省钱、好用、弹性。租GPU就上GpuMall,面向AI开发者的GPU云平台

支持的模型种类如下:GpuMall智算云 | 省钱、好用、弹性。租GPU就上GpuMall,面向AI开发者的GPU云平台![]() https://gpumall.com/image-details?shareImageId=SIMGQ1es7kq042py&comment提示#autodl#恒源云#矩池云#算力云#恒源云 实例迁移#autodl 官网#autodi#GpuMall#GPU云#AutoDL#AotuDL 算力云#GpuMall智算云#AI#大数据#算力租赁#大模型#深度学习#人工智能#算力变现

https://gpumall.com/image-details?shareImageId=SIMGQ1es7kq042py&comment提示#autodl#恒源云#矩池云#算力云#恒源云 实例迁移#autodl 官网#autodi#GpuMall#GPU云#AutoDL#AotuDL 算力云#GpuMall智算云#AI#大数据#算力租赁#大模型#深度学习#人工智能#算力变现

Code Llama 提供多个版本以涵盖各种应用领域,它包括如下模型:

- 基础模型

(Code Llama) - Python 专业化模型

(Code Llama - Python) - 遵循指导的模型

(Code Llama - Instruct)

这些模型具有不同的参数,包括 7B、13B 和 34B,以应对不同的使用情境

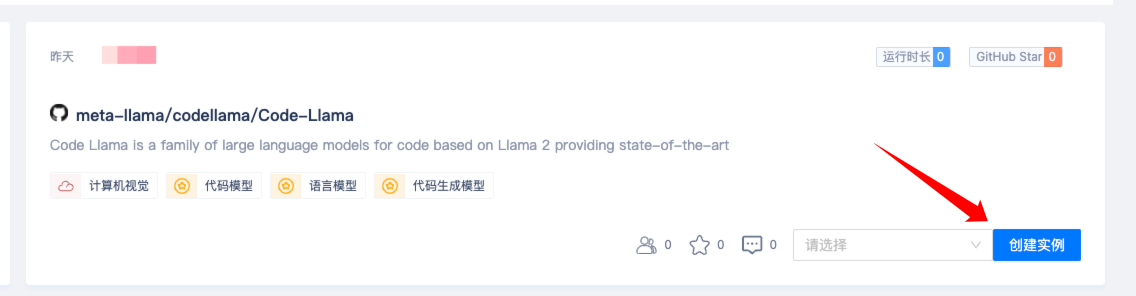

下面介绍如何在 GpuMall 平台使用已集成的 CodeLlama 模型

1. 选择 CodeLlama 镜像创建实例

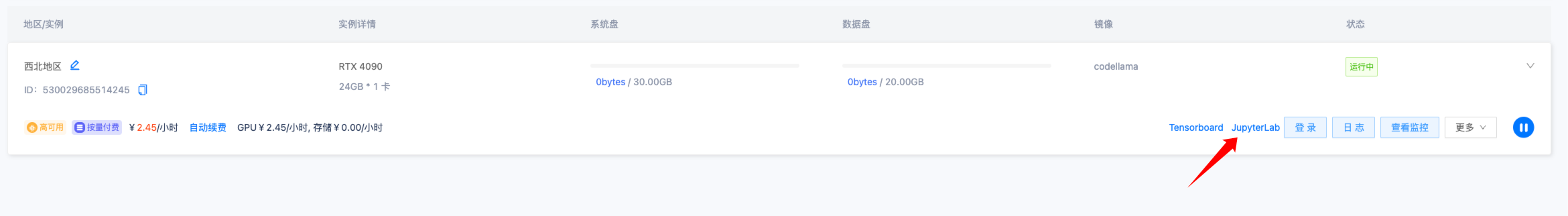

选择完成后创建实例,然后点击 JupyterLab,进入终端。

2. 查看CodeLlama模型大小

du -sh /gm-models/CodeLlama/*

25G /gm-models/CodeLlama/CodeLlama-13b

25G /gm-models/CodeLlama/CodeLlama-13b-Instruct

25G /gm-models/CodeLlama/CodeLlama-13b-Python

48G /gm-models/CodeLlama/CodeLlama-34b

63G /gm-models/CodeLlama/CodeLlama-34b-Instruct

63G /gm-models/CodeLlama/CodeLlama-34b-Python

13G /gm-models/CodeLlama/CodeLlama-7b

13G /gm-models/CodeLlama/CodeLlama-7b-Instruct

13G /gm-models/CodeLlama/CodeLlama-7b-Python

通过 du -sh 命令来统计 CodeLlama 模型目录下的所有分支模型占用空间大小,实例数据盘默认为 20GB,如果需要使用的模型大小超过 20GB,需先到控制台进行数据盘扩容后再进行下述操作。

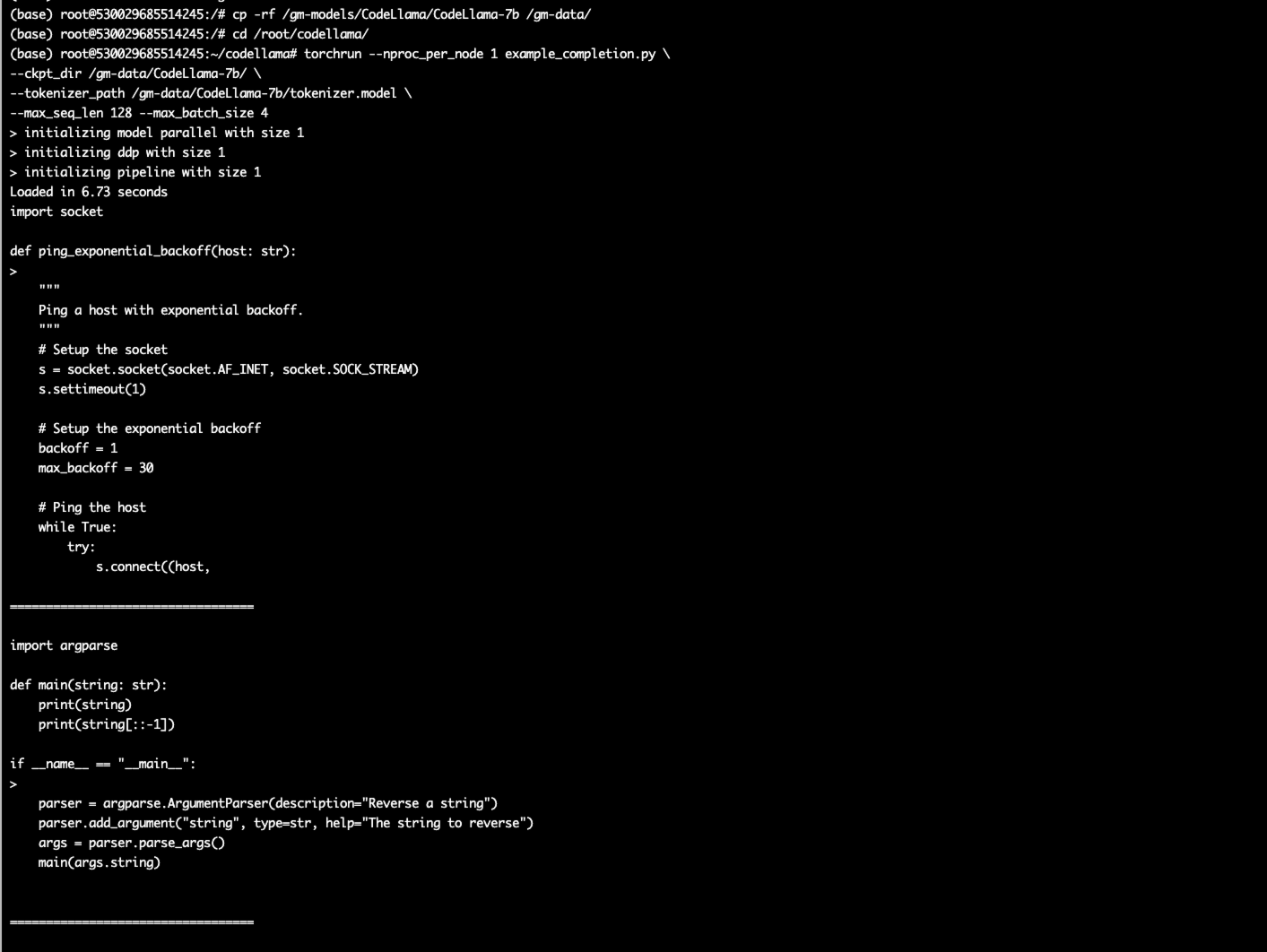

3. 复制模型到实例数据盘

#如下复制所需要使用的模型到/gm-data/目录下

cp -rf /gm-models/CodeLlama/CodeLlama-7b /gm-data/

然后等待模型复制完成,不建议将模型放到非

/gm-data/目录不建议移动,因为模型可能较大,系统盘空间不足以存储模型。

3. 测试 codellama 代码填充

#进入 codellama 目录

cd /root/codellama/

#使用如下指令开始执行

torchrun --nproc_per_node 1 example_completion.py \

--ckpt_dir /gm-data/CodeLlama-7b/ \

--tokenizer_path /gm-data/CodeLlama-7b/tokenizer.model \

--max_seq_len 128 --max_batch_size 4

输出如上图结果就说明 CodeLlama 已经可以正常使用了。

更多使用方法请参考:CodeLlama官方项目

如需通过公网访问请参考:自定义服务

352

352

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?