禁止商业或二改转载,仅供自学使用,侵权必究,如需截取部分内容请后台联系作者!

文章目录

介绍

特征选择(Feature Selection)是机器学习中的一个重要步骤,它涉及到从原始特征集中选择最相关、最有信息量的特征子集,以用于模型训练和预测。这个过程的目的是提高模型的性能、减少计算成本、增强模型的可解释性,并可能提高模型的泛化能力。以下是特征选择的几个关键点:

- 定义:特征选择是从原始特征集中选择一个子集的过程,这个子集被认为是对模型预测最有用的。

- 必要性:

- 数据简化:减少特征数量可以简化模型,使其更容易理解和解释。

- 性能提升:去除不相关或冗余的特征可以减少模型的过拟合风险,提高模型的泛化能力。

- 计算效率:减少特征数量可以减少模型训练和预测的时间和计算资源消耗。

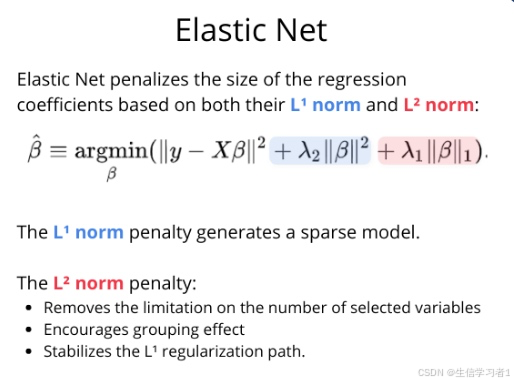

- 方法

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?