K-means算法阐述

k近邻法(k-nearest neighbor, k-NN)是1967年由Cover T和Hart P提出的一种基本分类与回归方法。它的工作原理是:存在一个样本数据集合,也称作为训练样本集,并且样本集中每个数据都存在标签,即我们知道样本集中每一个数据与所属分类的对应关系。输入没有标签的新数据后,将新的数据的每个特征与样本集中数据对应的特征进行比较,然后算法提取样本最相似数据(最近邻)的分类标签。一般来说,我们只选择样本数据集中前k个最相似的数据,这就是k-近邻算法中k的出处,通常k是不大于20的整数。最后,选择k个最相似数据中出现次数最多的分类,作为新数据的分类。

K-means实战

这是一个判断电影类型的表

通过上表,可以判断出来(101,20)应该属于武打片,可如果让电脑来识别,应该怎么算呢?

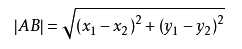

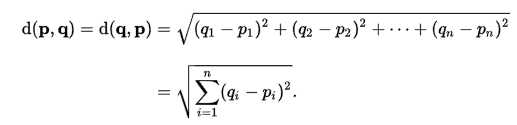

上图公式便是电脑用来识别电影到底是动作片还是爱情片。

代码

import numpy as np

import operator

"""

函数说明:创建数据集

Returns:

group -数据集

labels -分类标签

"""

def dataCreat():

#四组二维空间

group = np.array([[1,101],[5,89],[108,5],[115,8]])

#四组特征的标签

labels = ['爱情片','爱情片','动作片','动作片']

return group,labels

if __name__ == '__main__':

#创建数据集

group,labels = dataCreat()

#打印数据集

print(group)

print(labels)

"""

函数说明:knn算法,分类器

Parameters:

inX - 用于分类的数据(测试集)

dataSet - 用于训练的数据(训练集)

labes - 分类标签

k - kNN算法参数,选择距离最小的k个点

Returns:

sortedClassCount[0][0] - 分类结果

"""

def classif(inX,dataSet,labels,k):

#numpy库中的shape返回dataSet的行数

dataSetSize = dataSet.shape[0]

# dataSetSize == 4

#在列向量方向上重复inX共1次(横向),行向量方向上重复inX共dataSetSize次(纵向)

diffMat = np.tile(inX, (dataSetSize, 1)) - dataSet#np.tile()这个函数是复制函数,y复制dataSetSize次,x不变

#相当于[101,20]-[1,101]=[100,-81],其他一样

#二维特征相减后平方

sqdiffMat = diffMat ** 2

#[10000, 6561],

#[ 9216, 4761],

#[ 49, 225],

#[ 196, 144]]

#sum()所有元素相加,sum(0)列相加,sum(1)行相加

sqDistances = sqdiffMat.sum(axis=1)

#[16561, 13977, 274, 340]

# 开方,计算出距离

distances = sqDistances ** 0.5

#[128.68954892, 118.22436297, 16.55294536, 18.43908891]

# 返回distances中元素从小到大排序后的索引值

sortedDistIndices = distances.argsort()

#[16.55294536,18.43908891,118.22436297,128.68954892]

# 定一个记录类别次数的字典

classCount = {}

for i in range(k):

# 取出前k个元素的类别

voteIlabel = labels[sortedDistIndices[i]]

# dict.get(key,default=None),字典的get()方法,返回指定键的值,如果值不在字典中返回默认值。

# 计算类别次数

classCount[voteIlabel] = classCount.get(voteIlabel, 0) + 1

# python3中用items()替换python2中的iteritems()

# key=operator.itemgetter(1)根据字典的值进行排序

# key=operator.itemgetter(0)根据字典的键进行排序

# reverse降序排序字典

sortedClassCount = sorted(classCount.items(), key=operator.itemgetter(1), reverse=True)

#返回次数最多的类别,即所要分类的类别

return sortedClassCount[0][0]

if __name__ == '__main__':

# 创建数据集

group, labels = dataCreat()

# 测试集

test = [101, 20]

# kNN分类

test_class = classif(test, group, labels, 3)

# 打印分类结果

print(test_class)

其中有一步十分难理解,我给大家用手写了出来计算过程

diffMat = np.tile(inX, (dataSetSize, 1)) - dataSet

大概过程就是这样,原谅我字丑,hhhh。

补充

numpy库里面有一个函数是tile(),这个函数的作用是复制数组

1.

group = np.array([[1,101],[5,89],[108,5],[115,8]])

new = np.tile(group,2)

new

这样是按行复制

2.

group = np.array([[1,101],[5,89],[108,5],[115,8]])

new = np.tile(group,(3,2))

new

这样是行复制2,列复制3

总结

这次的例子是二维的,接下来的例子会到多维的来判断

后续请等待接下来的更新。

379

379

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?