参考:【機器學習2021】預測本頻道觀看人數 (下) - 深度學習基本概念簡介、Introduction of ML/DL

结论:

e

p

o

c

h

≥

b

a

t

c

h

=

u

p

d

a

t

e

epoch\geq batch=update

epoch≥batch=update

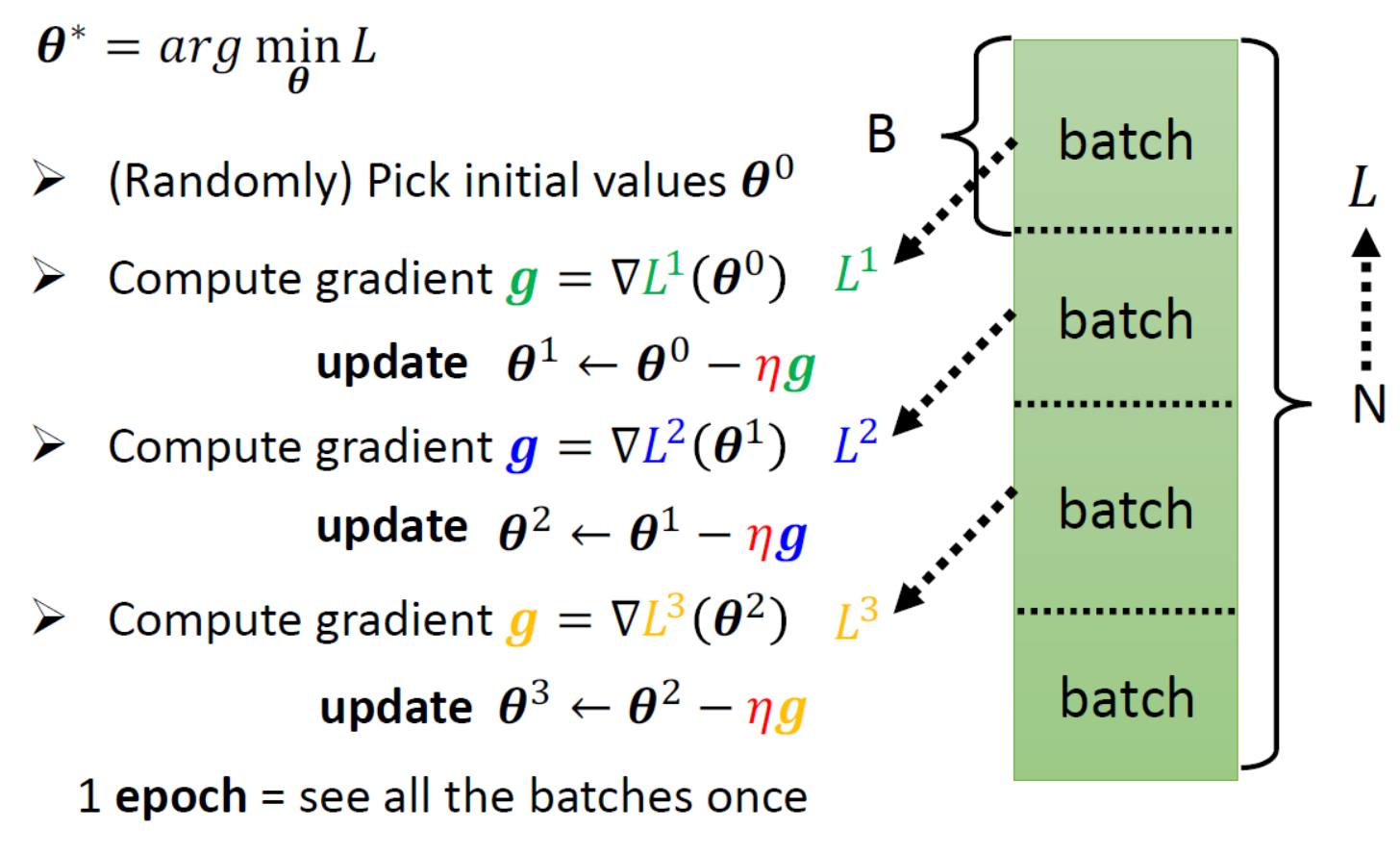

详解,如右图

1)将

N

N

N个训练样本随机分成若干个等长的

b

a

t

c

h

batch

batch,每个

b

a

t

c

h

batch

batch中的样本个数为

B

B

B(最后一个可能小于

B

B

B);

2)随机初始化参数

θ

0

\theta^0

θ0;

3)用第一个

b

a

t

c

h

batch

batch内的

B

B

B个样本针对loss函数

L

L

L(因为只用了第一个

b

a

t

c

h

batch

batch内的样本,所以记为

L

1

\textcolor{green}{L^1}

L1)计算得到梯度

g

\textcolor{green}{g}

g;再在

θ

0

\theta^0

θ0的基础上更新参数得到

θ

1

\theta^1

θ1;

4)用第二个

b

a

t

c

h

batch

batch内的

B

B

B个样本针对loss函数

L

L

L(因为只用了第一个

b

a

t

c

h

batch

batch内的样本,所以记为

L

2

\textcolor{blue}{L^2}

L2)计算得到梯度

g

\textcolor{blue}{g}

g;再在

θ

1

\theta^1

θ1的基础上更新参数得到

θ

2

\theta^2

θ2;

5)用第三个

b

a

t

c

h

batch

batch内的

B

B

B个样本针对loss函数

L

L

L(因为只用了第一个

b

a

t

c

h

batch

batch内的样本,所以记为

L

3

\textcolor{orange}{L^3}

L3)计算得到梯度

g

\textcolor{orange}{g}

g;再在

θ

2

\theta^2

θ2的基础上更新参数得到

θ

3

\theta^3

θ3;

6)…

每用一个

b

a

t

c

h

batch

batch内的

B

B

B个样本训练一次,就叫一次

u

p

d

a

t

e

update

update;

当完成所有的

b

a

t

c

h

batch

batch(即

N

N

N个样本都训练过一次)表示一次

e

p

o

c

h

epoch

epoch;

模型一般会进行多次

e

p

o

c

h

epoch

epoch的训练,每次

e

p

o

c

h

epoch

epoch会重新打乱样本的顺序。

4089

4089

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?