MindSpore算子笔记–nn.ReLU

背景

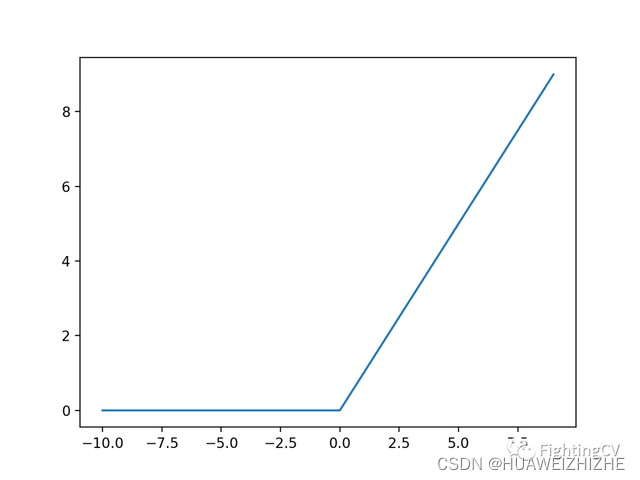

ReLU是神经网络中最基础的一种激活函数,主要应用于卷积神经网络中提高网络非线性度,从而可拟合复杂函数,模拟神经元突触控制部分神经激活的场景。计算公式是f(x)=max(0,x),因此输入在小于0时,结果为0,输入在大于0时为线性增大,参考下图

参数介绍

input_data (Tensor) - 输入Tensor,要求输入数据必须为fp32或fp16格式

调用方式

import numpy as np

import mindspore.nn as nn

from mindspore import context, Tensor

#pynative模式

context.set_context(mode=context.PYNATIVE_MODE, device_target="CPU")

input_data = Tensor(np.ones([2, 3, 3]).astype(np.float32))

relu = nn.ReLU()

output = relu(input_data)

print(output.asnumpy())

#graph模式

context.set_context(mode=context.GRAPH_MODE, device_target="CPU")

class Net(nn.Cell):

def __init__(self):

super(Net, self).__init__()

self.relu = nn.ReLU()

def construct(self, x):

out = self.relu(X)

return out

input_data = Tensor(np.ones([2, 3, 3]).astype(np.float32))

net = Net()

output = net(input_data)

print(output.asnumpy())

2384

2384

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?