梯度下降法(Gradient Descent)(重点)

梯度下降法可以做什么?

在你测试集上,通过最小化代价函数(成本函数) J(w,b) 来训练的参数w和b ,

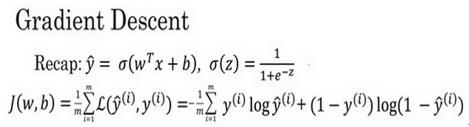

如图,在第二行给出和之前一样的逻辑回归算法的代价函数(成本函数)(上一篇文章已讲过)

梯度下降法的形象化说明

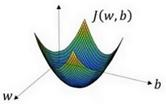

在这个图中,横轴表示你的空间参数w 和 b ,在实践中,w可以是更高的维度,但是为了更好地绘图,我们定义 w 和b,都是单一实数,代价函数(成本函数)J(w,b)是在水平轴w和b上的曲面,因此曲面的高度就是 J(w,b)在某一点的函数值。我们所做的就是找到使得代价函数(成本函数)J(w,b)函数值是最小值,对应的参数w 和b 。

如图,代价函数(成本函数) J(w,b) 是一个凸函数(convex function),像一个大碗一样。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1468

1468

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?