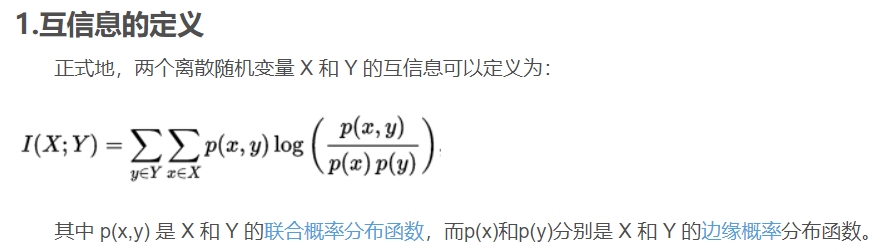

互信息(Mutual Information)

互信息(Mutual Information)是度量两个事件集合之间的相关性 (mutual dependence)

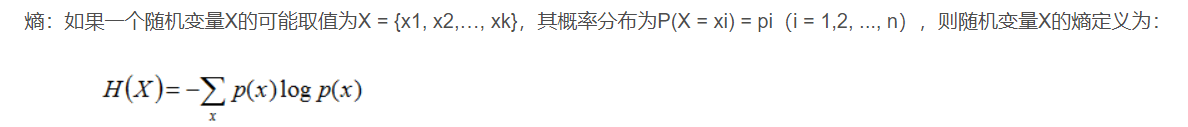

熵的定义(基于概率):

联合熵(基于联合概率分布):

联合熵:两个随机变量X,Y的联合分布,可以形成联合熵Joint Entropy,用H(X,Y)表示。

联合熵。

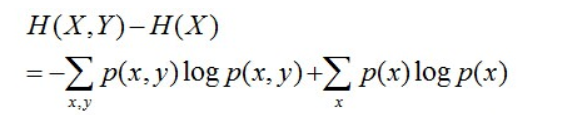

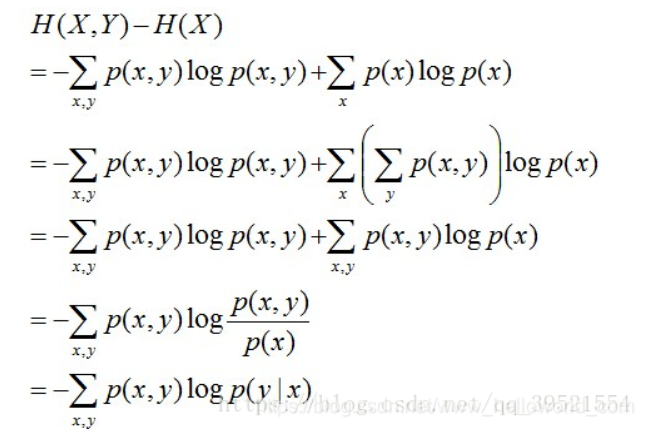

条件熵(基于条件概率分布):

条件熵:在随机变量X发生的前提下,随机变量Y发生所新带来的熵定义为Y的条件熵,用H(Y|X)表示,用来衡量在已知随机变量X的条件下随机变量Y的不确定性。

且有此式子成立:H(Y|X) = H(X,Y) – H(X),整个式子表示(X,Y)发生所包含的熵减去X单独发生包含的熵。至于怎么得来的请看推导:

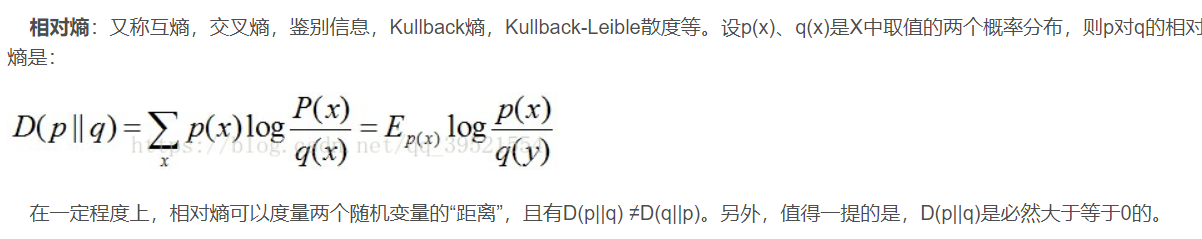

相对熵:又称互熵,交叉熵(两个概率分布)

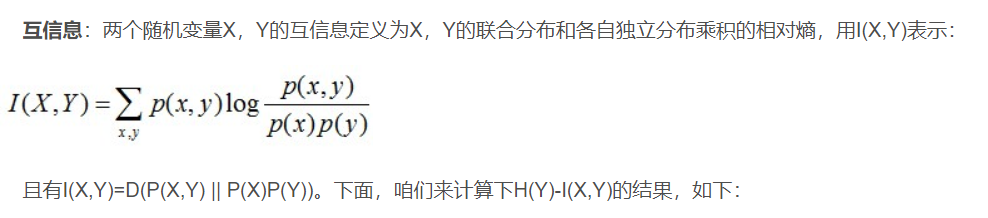

互信息(基于交叉熵定义的):

两个随机变量X,Y的互信息定义为X,Y的联合分布和各自独立分布乘积的相对熵,用I(X,Y)表示。

互信息就是变量X和变量Y的联合概率分布p(x,y) 和各自的独立概率分布乘积的 交叉熵。

本文探讨了互信息的概念,包括其与熵(如联合熵和条件熵)、相对熵(交叉熵)的关系,以及如何通过交叉熵定义来衡量两个随机变量之间的依赖程度。这些概念在信息技术中尤其在数据处理、机器学习等领域具有重要应用。

本文探讨了互信息的概念,包括其与熵(如联合熵和条件熵)、相对熵(交叉熵)的关系,以及如何通过交叉熵定义来衡量两个随机变量之间的依赖程度。这些概念在信息技术中尤其在数据处理、机器学习等领域具有重要应用。

6032

6032

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?