自己在使用时从无到有的过程

一、使用以下代码进行相应的检查

1、查看tensorflow的版本:

import tensorflow as tf

print(tf.__version__) # 查看TensorFlow的版本2、判断cuda是否可用

print(tf.test.is_built_with_cuda()) # 判断CUDA是否可用3、查看cuda、tensorflow-gpu和cudnn(选择下载,cuda对深度学习的补充)版本是否对应

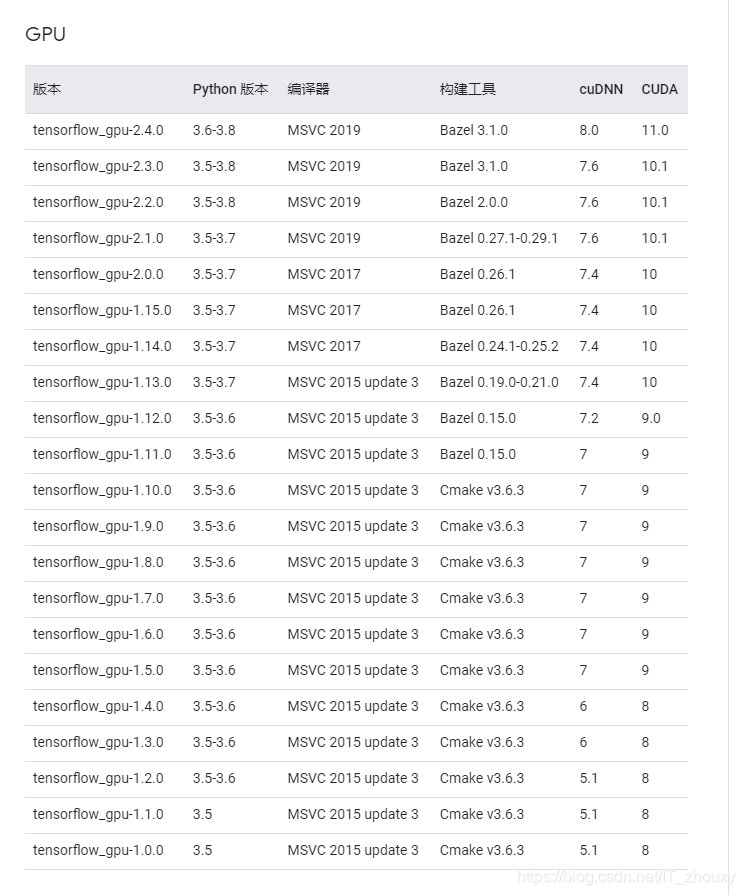

print(tf.test.is_gpu_available()) # 查看cuda、TensorFlow_GPU和cudnn(选择下载,cuda对深度学习的补充)版本是否对应- 若版本不对应会返回False,可以点击这里查看您当前使用TensorFlow版本对应的CUDA和cuDNN的版本。

- 若安装的TensorFlow不是GPU版本也会返回False。

tips:查看CUDA版本:

打开终端输入nvcc -V

若没有安装CUDA,可以再官网进行下载

二、使用GPU运行代码

1、查看可用GPU

gpus = tf.config.experimental.list_physical_devices(device_type='GPU')

print(gpus)2、选择使用某一块或多块GPU

import os

os.environ["CUDA_VISIBLE_DEVICES"] = "0,1" # =右边"0,1",代表使用标号为0,和1的GPU可以使用下边的代码查看可用GPU的详细信息

from tensorflow.python.client import device_lib

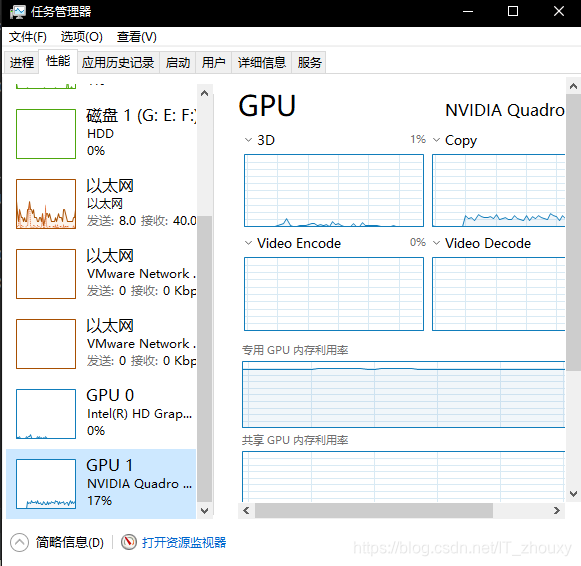

print(device_lib.list_local_devices())这时候在运行相应的代码,就可以看到在GPU上运行了。可以通过任务管理器-性能处查看GPU使用率。

目前我的GPU利用率最高能达到20%左右,通过在这篇博客里看到:

两种限定GPU占用量的方法:

方法一、设置定量的GPU显存使用量:

config = tf.ConfigProto()

config.gpu_options.per_process_gpu_memory_fraction = 0.4 # 占用GPU40%的显存

session = tf.Session(config=config)

方法二、设置最小的GPU显存使用量,动态申请显存:(建议)

config = tf.ConfigProto()

config.gpu_options.allow_growth = True

session = tf.Session(config=config)

————————————————

版权声明:本文为CSDN博主「万道一」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。

原文链接:https://blog.csdn.net/qq_38299170/article/details/103836393

但此方法对我的机器并不适用,因为我的显卡不是太好,一些壕们可以使用此方法进行提高GPU利用率。

本文介绍了如何检查TensorFlow与CUDA的版本匹配,以及如何在Python中利用TensorFlow进行GPU资源的检测和使用。通过设置环境变量选择使用特定GPU,并提供了调整GPU显存使用的方法,以提高GPU利用率。

本文介绍了如何检查TensorFlow与CUDA的版本匹配,以及如何在Python中利用TensorFlow进行GPU资源的检测和使用。通过设置环境变量选择使用特定GPU,并提供了调整GPU显存使用的方法,以提高GPU利用率。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?