Scrapy项目的创建

-

安装scrapy包

pip install scrapy -

在Pycharm中使用命令行创建项目

注意: 这里不要在创建好的python项目中新建,不然会遇到一些莫名其妙的bug

scrapy startproject [项目的名称]

-

windows 下可以使用tree /F 命令查看目录

-

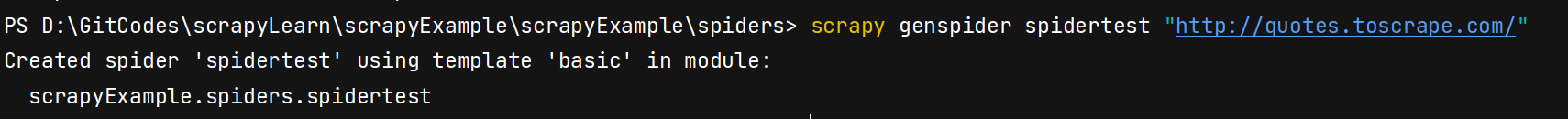

在spiders目录下创建一个爬虫

scrapy genspider[你的爬虫文件名] [限定爬虫的范围]

-

测试运行

import scrapy class SpidertestSpider(scrapy.Spider): # 爬虫名称 name = 'spidertest' allowed_domains = ['quotes.toscrape.com'] start_urls = ['http://quotes.toscrape.com/'] def parse(self, response): print(response.body) # pass测试检查爬虫,命令行输入:scrapy check spidertest

运行爬虫:scrapy crawl spidertest

201

201

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?