import torchvision

import torch

from torch import nn

from torch.nn import Conv2d

from torch.utils.data import DataLoader

from torch.utils.tensorboard import SummaryWriter

dataset=torchvision.datasets.CIFAR10('../Data',train=False,transform=torchvision.transforms.ToTensor(),download=True)

#dataloader

dataloader=DataLoader(dataset,batch_size=64)

#神经网络

#torch.nn.Conv2d(in_channels, out_channels, kernel_size(卷积核), stride=1, padding=0(扩充),dilation=1, groups=1(常为一),

# bias=True(偏置), padding_mode='zeros', device=None, dtype=None)

class Sjnet(nn.Module):

def __init__(self):

super(Sjnet, self).__init__()#继承父类

self.conv1=Conv2d(in_channels=3,out_channels=6,kernel_size=3,stride=1,padding=0,)#卷积层

def forward(self,x):

x=self.conv1(x)

return x

sjnet=Sjnet()

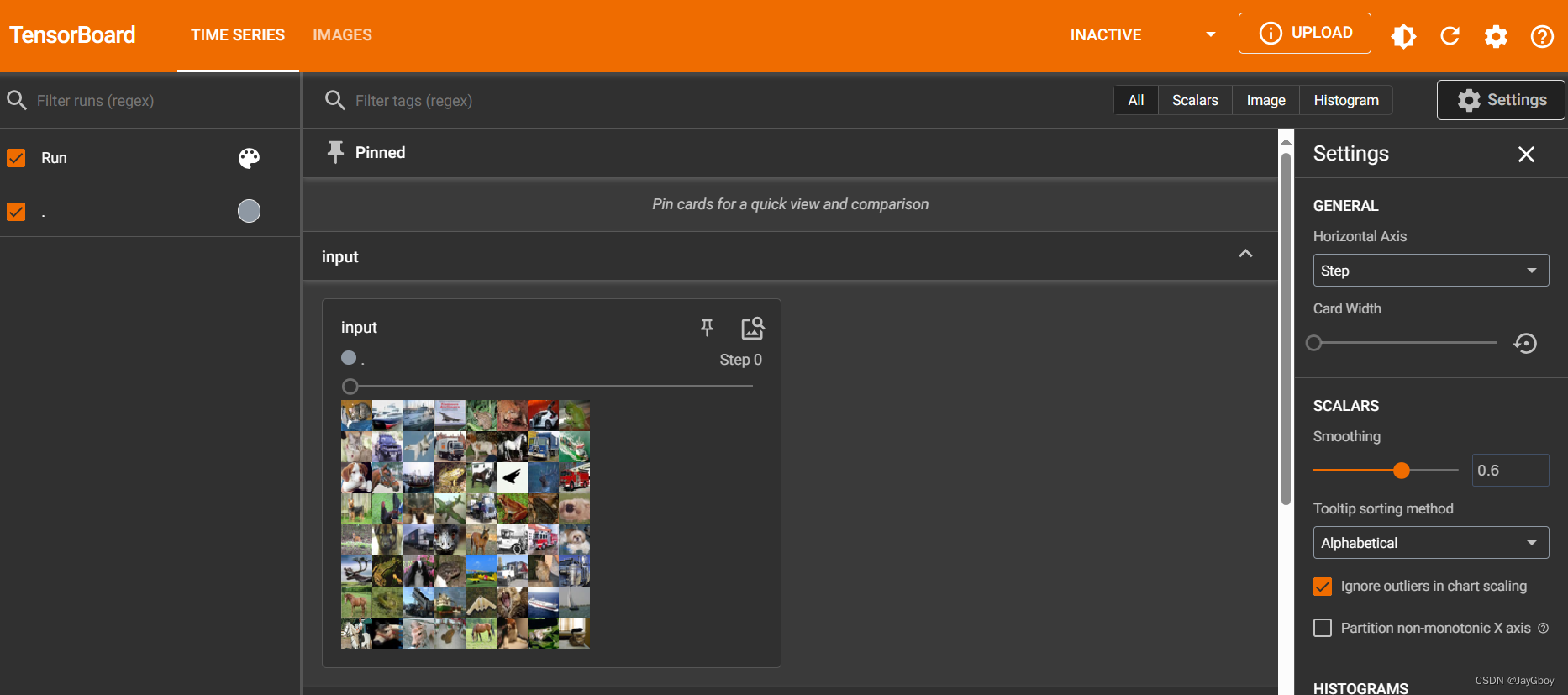

#tensorboard展示图象

writer=SummaryWriter('logs')

i=0

for data in dataloader:

imgs,targets=data

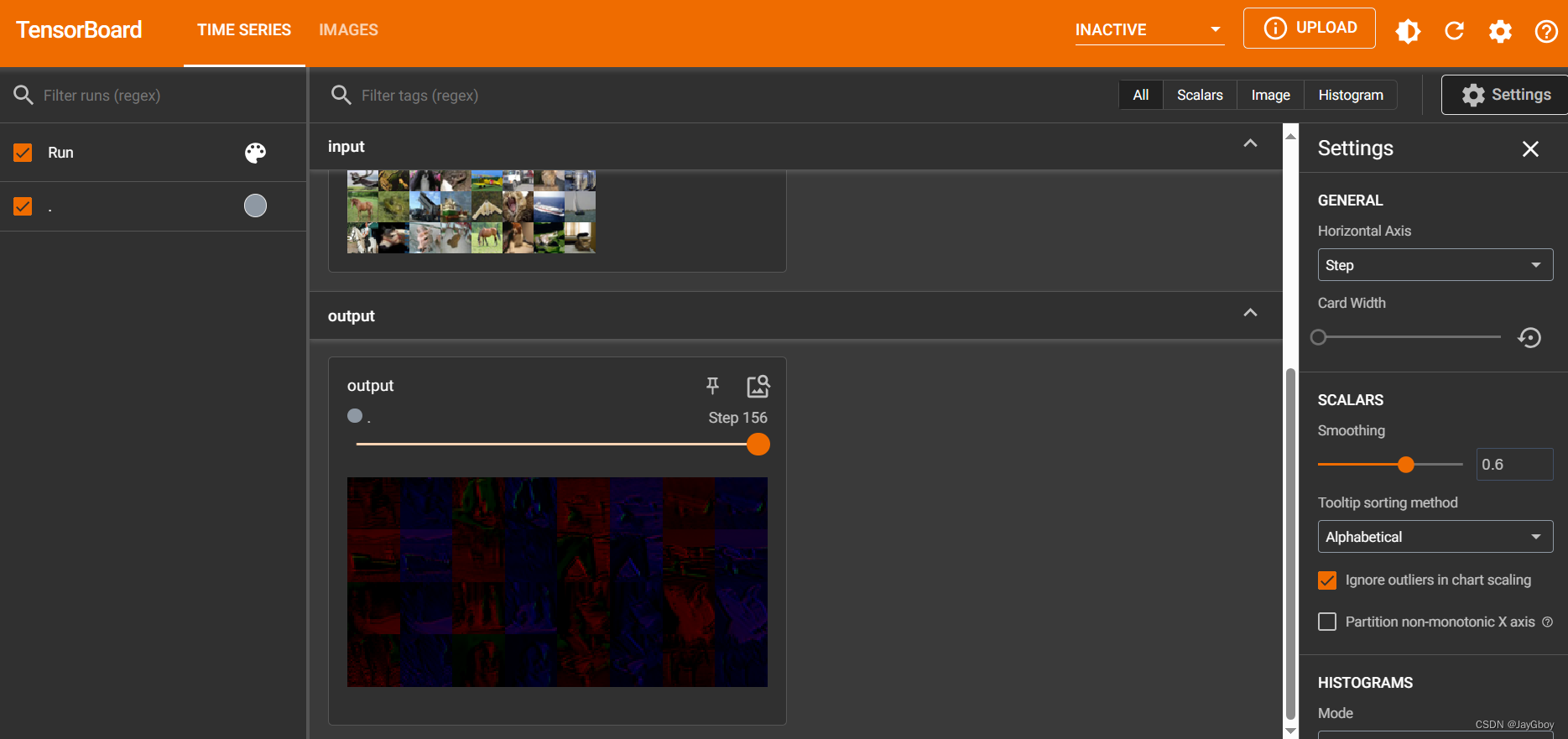

output=sjnet(imgs)

print(output.shape)#输出卷积后的图片信息

writer.add_images('input', imgs, i)#展示没有卷积之前的图像

output=torch.reshape(output,(-1,3,30,30))#修改卷积后的图像

writer.add_images('output',output,i)#展示卷积后的图像

i=i+1

writer.close()input:

output:

值得注意的是,卷积层的输入数据张量的维度应该符合卷积层的要求。一般来说,输入数据的维度为(batch_size, in_channels, height, width),其中batch_size表示批次大小,in_channels表示输入的通道数,height和width表示输入数据的高度和宽度。

卷积层的输出数据张量的维度为(batch_size, out_channels, output_height, output_width),其中out_channels表示输出的通道数,output_height和output_width表示输出数据的高度和宽度,这些维度的计算取决于输入数据的维度、卷积核的大小、步长和填充等参数。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?