书生浦语项目首页:https://github.com/InternLM/InternLM

训练营课程首页:https://github.com/internLM/tutorial?tab=readme-ov-file

b站视频首页:OpenMMLab的个人空间-OpenMMLab个人主页-哔哩哔哩视频

课程简介(个人认知):介绍书生浦语开源平台体系,教会使用平台

本节课手册:https://github.com/InternLM/tutorial/blob/main/helloworld/hello_world.md

-------------------------------------------------------------------------------------

目录

目录

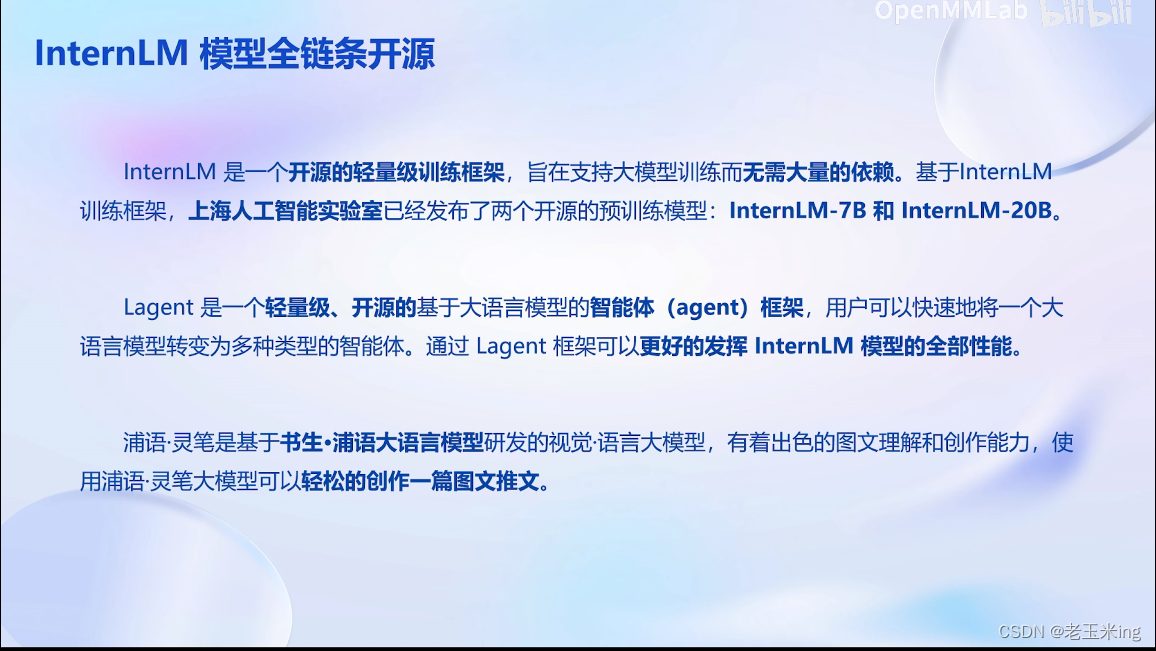

书生浦语大模型趣味Demo

1. 大模型及InternLM模型介绍

2. InternLM-Chat-7B 智能对话Demo

3 Lagent 智能体工具调用Demo

4. 浦语灵笔 视觉-预言大模型

5. 实践 环境准备

挂本地代理、conda建虚环境、提前改好pip和conda源

黑色是我做的,ppt是官方的,请学官方操作。

注意要3.12环境,因为3.11会有环境冲突

huggingface-cli的local-dir参数支持相对路径和绝对路径

还可以使用OpenXLab和modelScope下载模型,提前下载依赖就行

6. 实践 本地(教程是云上)

6.1 下载代码

注:模型在上面已经下载完了,视频里是使用云开发机(推荐) git clone https://gitee.com/internlm/InternLM.git

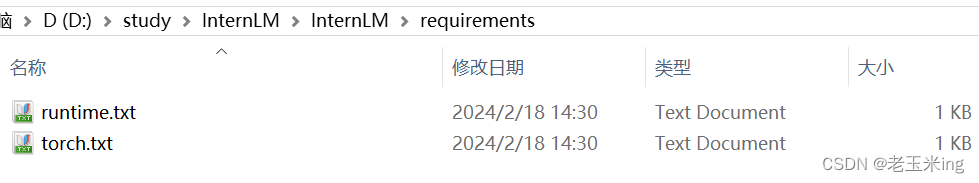

吐槽1:没有常见的requirements.txt,而是文件夹形式,拆分了俩txt

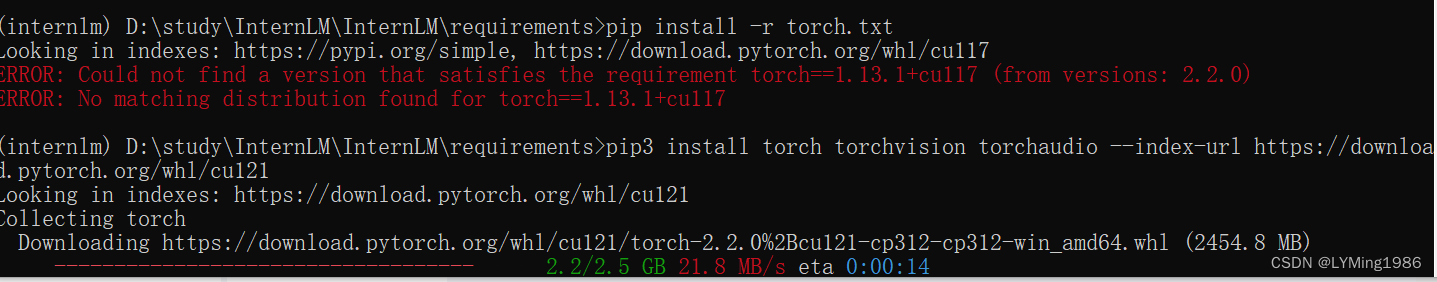

吐槽2:git代码里的torch1.13+cu117环境过时了,我换用最新的torch2.2+cu12.1了

吐槽3:sentencepiece库,在win10和ubuntu22.04下默认都pip不成功。解决方法见:

6.2 chat6b模型cli运行

速度不太快,不知道是不是2070算力一般般的问题

6b模型,默认半精度推理占15G显存,刚刚好利用上手边的显卡

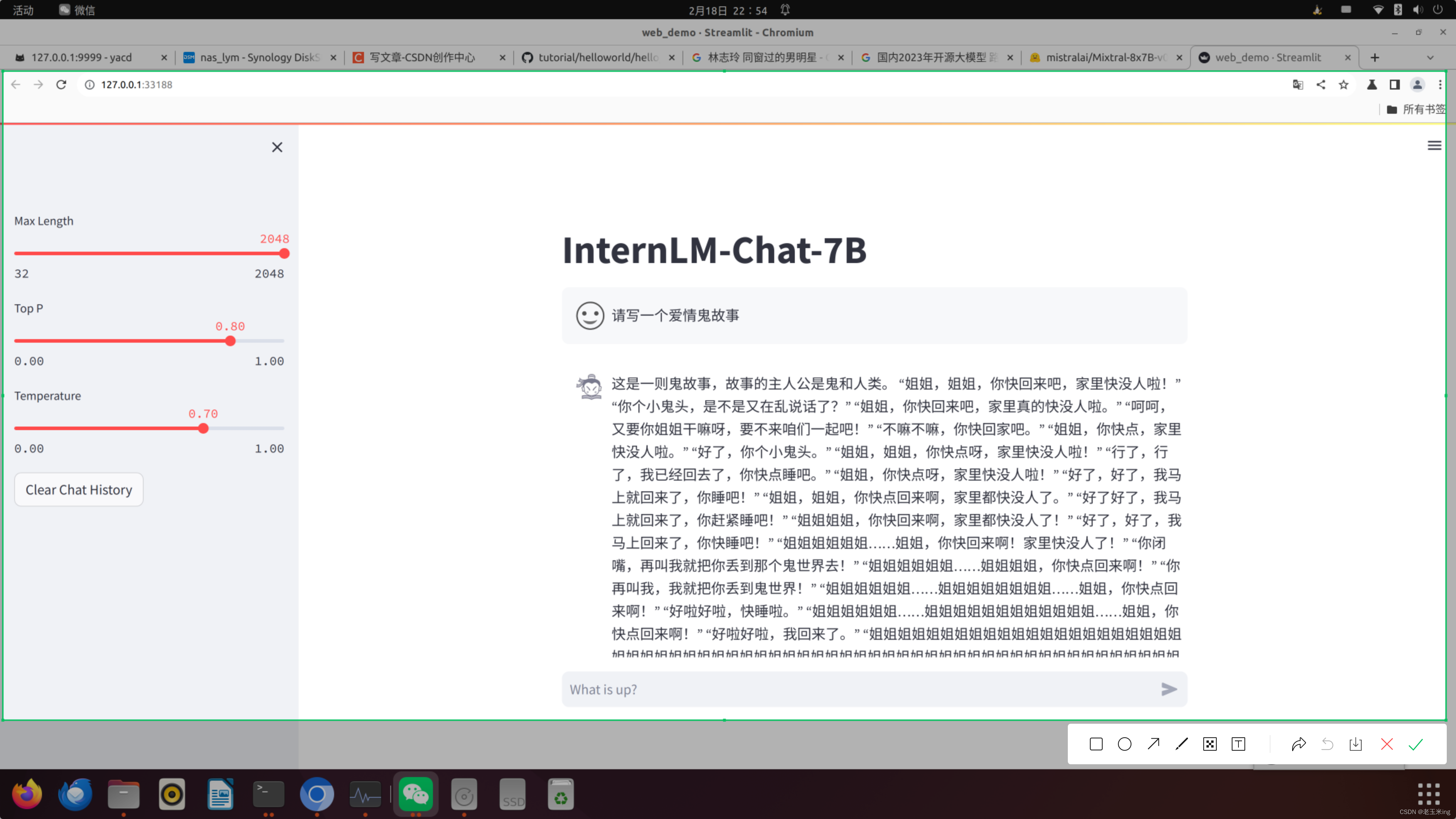

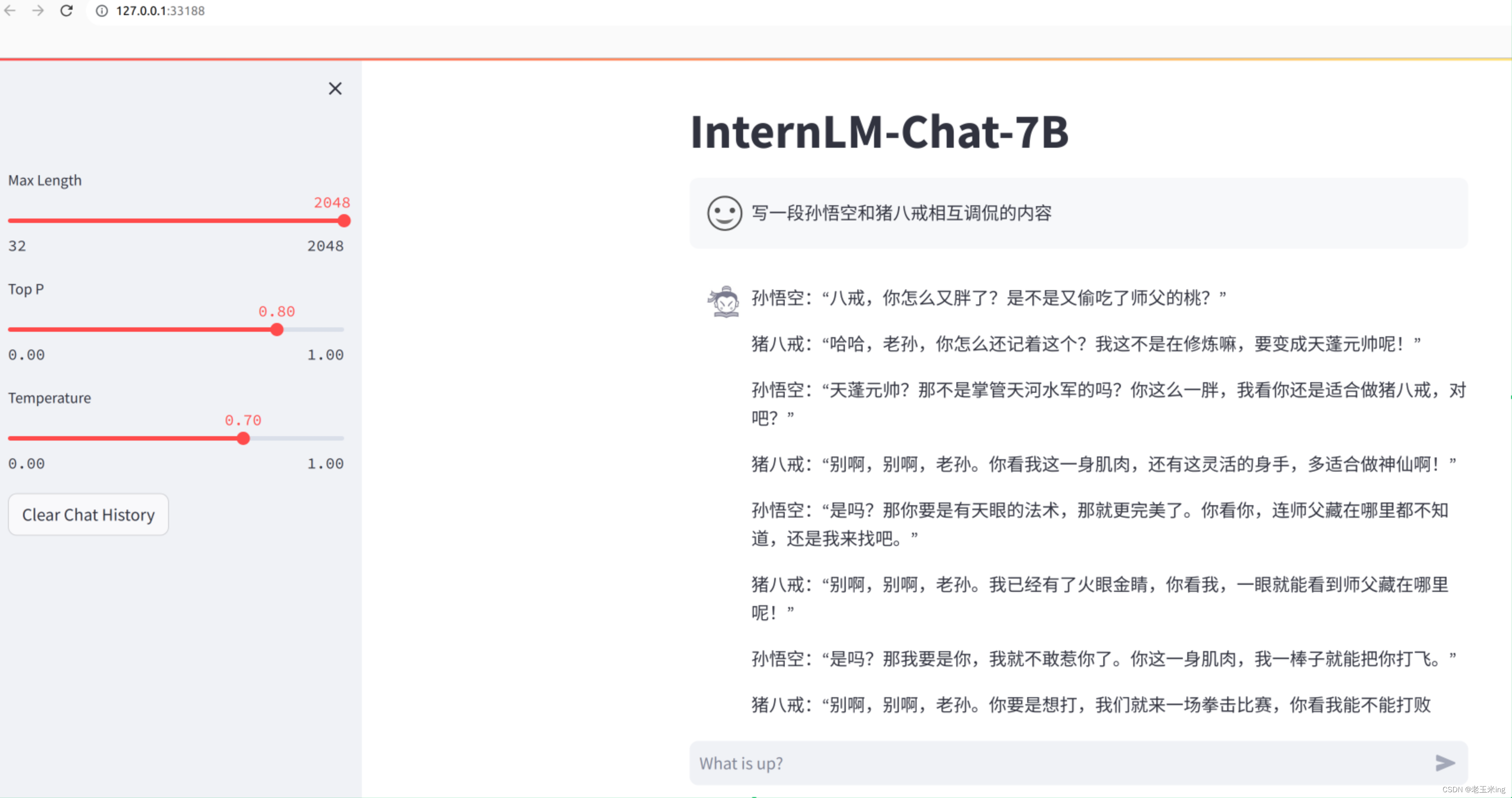

6.3 chat6b模型web_demo运行

6.3 chat6b模型web_demo运行

7. Latent智能体工具调用Demo

直接使用上面下载完成的chat7b模型,本节课tutorial提供了react_web_demo.py

给出了两个答案,一个正确一个错误。

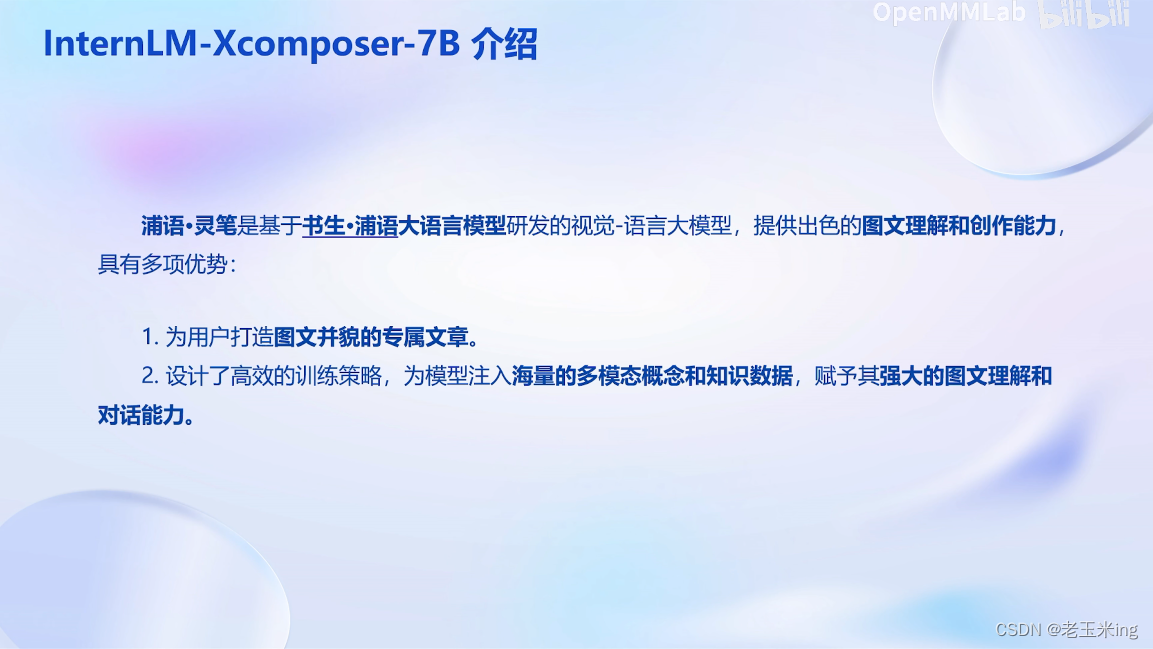

8. 浦语灵笔图文理解创作Demo

这里要用internlm-xcomposer-7b模型,需要修改模型地址。我设了个变量model_path

https://huggingface.co/internlm/internlm-xcomposer2-vl-7b

每次远程连云主机,运行xcompose,都会在一两分钟内error断线。。。。

而且xcompose对显存需求很大,两行文字就占到30G显存,恐怖!

9. 课后回顾

如果用云开发机,使用教程中的端口映射功能,可以不用自搭ddns服务实现本地web输出

ssh -CNg -L 6006:127.0.0.1:6006 root@ssh.intern-ai.org.cn -p 33090

193

193

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?