决策树CART算法原理理解

首先应该清楚回归树与分类树的本质区别在于模型的输出值不同,如果输出值为连续值则为回归树,如果为离散值则为分类树。

一、CART回归决策树算法原理

(一)、回归树的生成

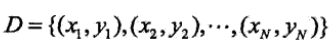

假设现在已有训练数据集

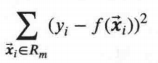

并且假设已经将输入空间划分为M个单元R1,R2,……RM,此时如果给定输入空间的一个划分,那么回归树在这个划分上的预测误差即为(用平方误差表示如下):

那么(此处假设为基于平方误差最小的准则)此回归树模型在每个划分单元上的最优输出值即为

上面公式的含义就是Rm单元内包括的样本对应的数据集中y值的平均值

最优特征及最优切分点的选择

那么现在的问题就在于依据什么原则去找到最佳的划分,现在假设样本共有k个特征(k维),假设现在选择第j维和它此时的取值为s,作为划分数据集的特征以及特征值(切分点),将数据集划分为两部分R1,R2:

我们选

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

8万+

8万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?