环境:

window10 pycharm

tensorflow 1.13.1

python 3.7.1

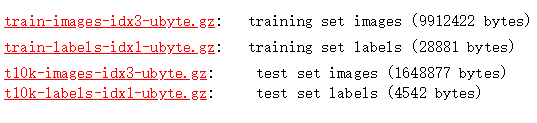

数据集:MNIST,0~9的28×28像素的灰度手写数字图片(训练集和测试集,图片和标签共4个压缩文件)

tensorflow官方提供了input_data.py文件自动下载导入数据集,所以可以不用下载,如果下载出现问题,可以自己下载,并放到MNIST_data目录下,不用解压。下载网址:http://yann.lecun.com/exdb/mnist/

导入input_data时报错:

No module named 'tensorflow.models'

解决方法:https://blog.csdn.net/RineZ/article/details/81671382

代码:

import tensorflow as tf

import tensorflow.examples.tutorials.mnist.input_data as input_data

# 下载MNIST数据集到'MNIST_data'文件夹并解压

mnist = input_data.read_data_sets('MNIST_data', one_hot=True)

# 定义权重

W = tf.Variable(tf.zeros([784, 10]))

# 定义偏置

b = tf.Variable(tf.zeros([10]))

# 构建模型

x = tf.placeholder("float", [None, 784]) # 输入

y = tf.nn.softmax(tf.matmul(x, W) + b) # 预测输出

y_ = tf.placeholder("float", [None, 10]) # 目标输出

# 定义损失函数:交叉熵

cross_entropy = -tf.reduce_sum(y_ * tf.log(y))

# 定义训练时的优化函数

train_step = tf.train.GradientDescentOptimizer(0.01).minimize(cross_entropy)

# 定义一个会话

sess = tf.Session()

# 初始化变量

sess.run(tf.global_variables_initializer())

# 开始迭代

for i in range(1000):

# 每次获取一小块数据

batch_xs, batch_ys = mnist.train.next_batch(100)

sess.run(train_step, feed_dict={x: batch_xs, y_: batch_ys})

# 每训练100次后评估模型

if i % 100 == 0:

# 计算准确率

correct_prediction = tf.equal(tf.argmax(y, 1), tf.argmax(y_, 1))

accuracy = tf.reduce_mean(tf.cast(correct_prediction, "float"))

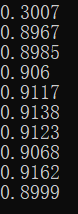

print(sess.run(accuracy, feed_dict={x: mnist.test.images, y_: mnist.test.labels}))运行结果:准确度在90%左右

参考文章:

http://www.tensorfly.cn/tfdoc/tutorials/mnist_beginners.html

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?