Epoll 是 Linux IO 多路复用的管理机制。作为现在 Linux 平台高性能网络 IO 必要的组件。内核的实现可以参照:fs/eventpoll.c 。

为什么需要自己实现 epoll 呢?现在自己打算做一个用户态的协议栈。采用单线程的模式。https://github.com/wangbojing/NtyTcp,至于为什么要实现用户态协议栈?可以自行百度 C10M 的问题。

由于协议栈做到了用户态故需要自己实现高性能网络 IO 的管理。所以 epoll 就自己实现一 下。代码:https://github.com/wangbojing/NtyTcp/blob/master/src/nty_epoll_rb.c

在实现 epoll 之前,先得好好理解内核 epoll 的运行原理。内核的 epoll 可以从四方面来理解。

1. Epoll 的数据结构,rbtree 对的存储,ready 队列存储就绪 io。

2. Epoll 的线程安全,SMP 的运行,以及防止死锁。

3. Epoll 内核回调。

4. Epoll 的 LT(水平触发)与 ET(边沿触发)。

下面从这四个方面来实现 epoll:

一、 Epoll 数据结构

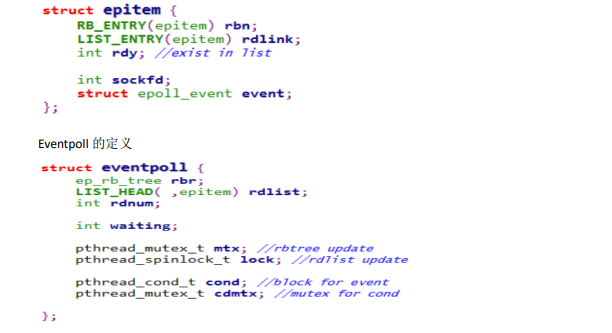

Epoll 主要由两个结构体:eventpoll 与 epitem。Epitem 是每一个 IO 所对应的的事件。比如 epoll_ctl EPOLL_CTL_ADD 操作的时候,就需要创建一个 epitem。Eventpoll 是每一个 epoll 所 对应的的。比如 epoll_create 就是创建一个 eventpoll。

Epitem 的定义:

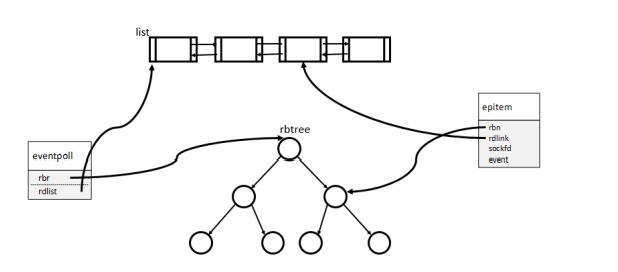

数据结构如下图所示:

List 用来存储准备就绪的 IO。对于数据结构主要讨论两方面:insert 与 remove。同样如此, 对于 list 我们也讨论 insert 与 remove。何时将数据插入到 list 中呢?

当内核 IO 准备就绪的时 候,则会执行 epoll_event_callback

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1775

1775

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?