- 🍨 本文为🔗365天深度学习训练营 中的学习记录博客

- 🍖 原作者:K同学啊 | 接辅导、项目定制

文章目录

前言

本文使用的是最简单的CNN模型- -LeNet-5,采用Tenserflow框架完成彩色图片分类。简单讲述实现代码与执行结果,并浅谈涉及知识点,涉及知识点包括。

关键字:CIFAR-10数据集介绍,CNN网络模型结构,神经网络程序调用顺序,loss、val_loss与accuracy、val_accuracy含义

一、我的环境

- 电脑系统:Windows 11

- 语言环境:python 3.8.6

- 编译器:pycharm

- 深度学习环境:TensorFlow 2.10.1

二、代码实现与执行结果

1.引入库

import tensorflow as tf

from tensorflow.keras import datasets, layers, models

import matplotlib.pyplot as plt

import numpy as np

import warnings

warnings.filterwarnings('ignore') # 忽略一些warning内容,无需打印

2.设置GPU(如果使用的是CPU可以忽略这步)

'''前期工作-设置GPU(如果使用的是CPU可以忽略这步)'''

gpus = tf.config.list_physical_devices("GPU")

if gpus:

gpu0 = gpus[0] # 如果有多个GPU,仅使用第0个GPU

tf.config.experimental.set_memory_growth(gpu0, True) # 设置GPU显存用量按需使用

tf.config.set_visible_devices([gpu0], "GPU")

本人电脑无独显,故该步骤被注释,未执行。

3.导入数据

'''前期工作-导入数据'''

(train_images, train_labels), (test_images, test_labels) = datasets.cifar10.load_data()

4.数据归一化

'''前期工作-数据归一化'''

# 将像素的值标准化至0到1的区间内。

train_images, test_images = train_images / 255.0, test_images / 255.0

print(train_images.shape, test_images.shape, train_labels.shape, test_labels.shape)

'''输出:(50000, 32, 32, 3) (10000, 32, 32, 3) (50000, 1) (10000, 1)'''

5.可视化图片

'''前期工作-可视化图片'''

class_names = ['airplane', 'automobile', 'bird', 'cat', 'deer', 'dog', 'frog', 'horse', 'ship', 'truck']

plt.figure(figsize=(20, 10))

for i in range(20):

plt.subplot(5, 4, i + 1)

plt.xticks([])

plt.yticks([])

plt.grid(False)

plt.imshow(train_images[i], cmap=plt.cm.binary)

plt.xlabel(class_names[train_labels[i][0]])

plt.show()

显示训练集数据前20个,显示结果如下:

7.构建CNN网络模型

'''构建CNN网络模型'''

model = models.Sequential([

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(32, 32, 3)), # 卷积层1,卷积核3*3

layers.MaxPooling2D((2, 2)), # 池化层1,2*2采样

layers.Conv2D(64, (3, 3), activation='relu'), # 卷积层2,卷积核3*3

layers.MaxPooling2D((2, 2)), # 池化层2,2*2采样

layers.Conv2D(64, (3, 3), activation='relu'), # 卷积层3,卷积核3*3

layers.Flatten(), # Flatten层,连接卷积层与全连接层

layers.Dense(64, activation='relu'), # 全连接层,特征进一步提取

layers.Dense(10) # 输出层,输出预期结果

])

model.summary() # 打印网络结构

网络结构结果如下:

8.编译模型

'''编译模型'''

model.compile(optimizer='adam',

loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True),

metrics=['accuracy'])

9.训练模型

'''训练模型'''

history = model.fit(train_images, train_labels, epochs=10,

validation_data=(test_images, test_labels))

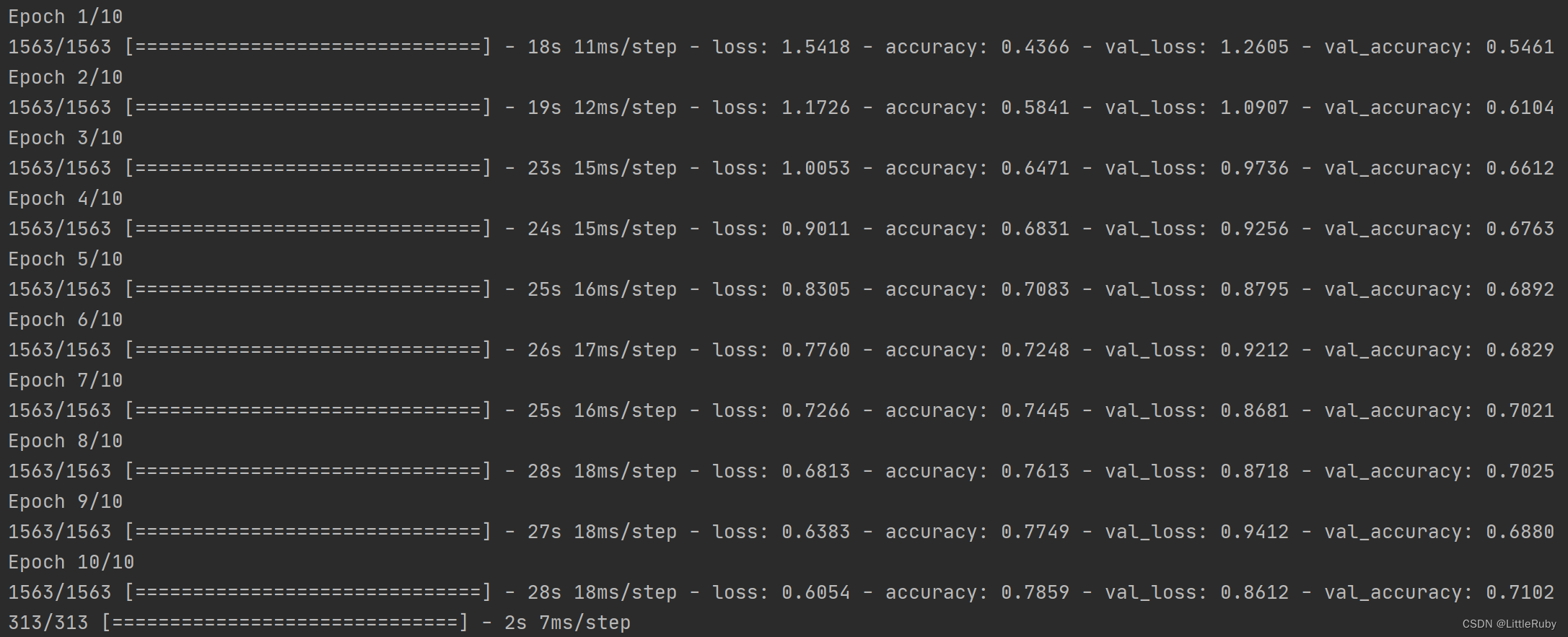

训练记录如下:

10.预测

'''预测'''

plt.imshow(test_images[1])

# 需要加上这句话,否则不显示图片

plt.show()

# 通过模型进行预测得到的是每一个类别的概率,数字越大该图片为该类别的可能性越大

pre = model.predict(test_images)

print(class_names[np.argmax(pre[1])])

以下为测试图第2张图

预测结果为ship

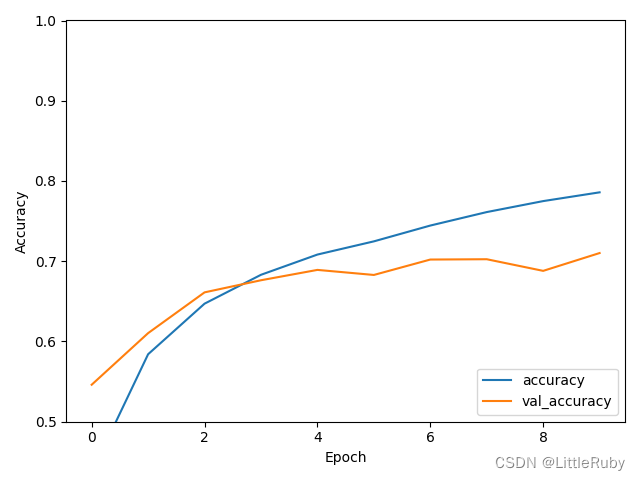

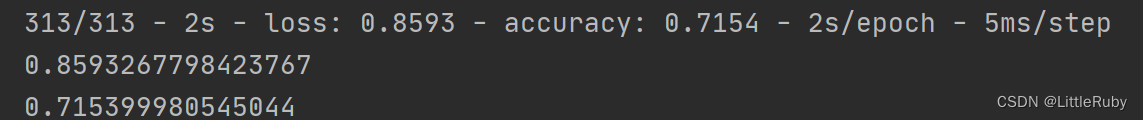

11.模型评估

'''模型评估'''

plt.plot(history.history['accuracy'], label='accuracy')

plt.plot(history.history['val_accuracy'], label='val_accuracy')

plt.xlabel('Epoch')

plt.ylabel('Accuracy')

plt.ylim([0.5, 1])

plt.legend(loc='lower right')

plt.show()

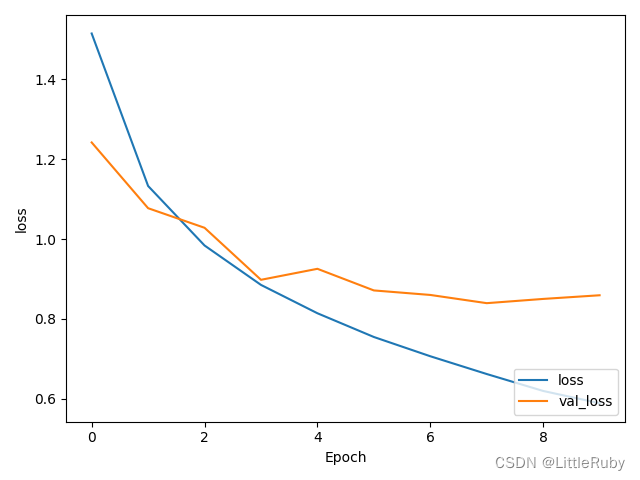

plt.plot(history.history['loss'], label='loss')

plt.plot(history.history['val_loss'], label='val_loss')

plt.xlabel('Epoch')

plt.ylabel('loss')

# plt.ylim([0.5, 1])

plt.legend(loc='lower right')

plt.show()

test_loss, test_acc = model.evaluate(test_images, test_labels, verbose=2)

print(test_loss)

print(test_acc)

以下为画出accuracy和loss的图:

三、知识点详解

1.CIFAR-10数据集介绍

cifar10.load_data()下载到本地的路径为:/home/your_userName/.keras/datasets

首次运行调用下载数据稍微花一点时间,已经下载后,则会直接加载。

数据网址:https://www.cs.toronto.edu/~kriz/cifar.html

6万张32*32的彩色图片,共10个类,每类6000张图片,其中训练集和测试集的划分如下:

training images: 50000

test images: 10000

训练集被划分为5个batch,每个batch有10000张图片,测试集只有1个batch,也有10000张图片

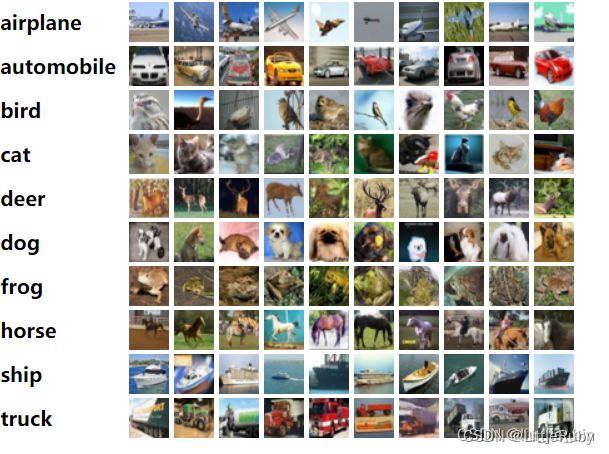

以下是数据集中的类,以及每个类的10张随机图片:

这些类是完全互斥的。汽车和卡车之间没有重叠。“汽车”包括轿车、越野车之类的东西。“卡车”只包括大卡车。这两项都不包括皮卡。

2.神经网络程序调用顺序

- 选择模型

- 构建网络模型

- 编译

- 训练

- 预测

- 模型评估

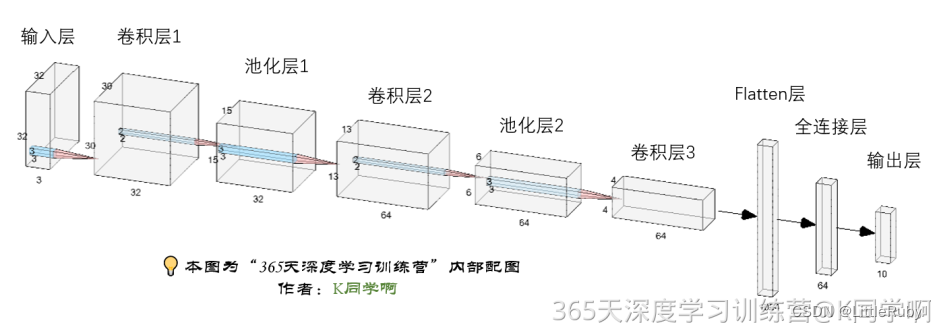

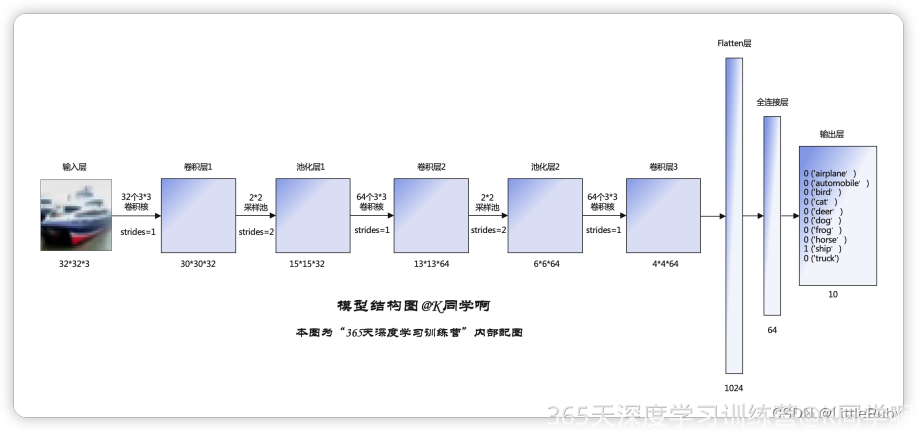

3.CNN网络模型结构

本文网络模型按一下方式构建:

4.loss、val_loss与accuracy、val_accuracy含义

1、概念

loss:训练集损失值

val_loss:测试集损失值

accuracy:训练集准确率

val_accruacy:测试集准确率

2、之间的关系:以下5种情况可供参考:

train loss 不断下降,test loss不断下降,说明网络仍在学习;(最好的)

train loss 不断下降,test loss趋于不变,说明网络过拟合;(max pool或者正则化)

train loss 趋于不变,test loss不断下降,说明数据集100%有问题;(检查dataset)

train loss 趋于不变,test loss趋于不变,说明学习遇到瓶颈,需要减小学习率或批量数目;(减少学习率)

train loss 不断上升,test loss不断上升,说明网络结构设计不当,训练超参数设置不当,数据集经过清洗等问题。(最不好的情况)这种情况,loss在下降,val_loss趋于不变,说明网络过拟合状态。

一般而言,当loss不再下降,趋于稳定时,就差不多收敛了,就意味着训练可以结束了

总结

通过本次的学习,能通过tenserflow框架创建cnn网络模型实现彩色图片分类,并更深入的了解了模型评估的分析方法。

参考链接

loss、val_loss与accuracy、val_accuracy含义:https://blog.csdn.net/looknm/article/details/126143124

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?