| 论文标题 | YOLOv9: Learning What You Want to Learn Using Programmable Gradient Information |

|---|---|

| 论文作者 | Chien-Yao Wang, I-Hau Yeh, Hong-Yuan Mark Liao |

| 发表日期 | 2024年02月01日 |

| GB引用 | > Wang Chien-Yao, Yeh Jau, Liao Hong-Yuan Mark. YOLOv9: Learning What You Want to Learn Using Programmable Gradient Information[J]. Lecture Notes in Computer Science, 2025, 15089. |

| DOI | 10.1007/978-3-031-72751-1_1 |

论文地址:https://arxiv.org/pdf/2402.13616

摘要

本文提出了一种新的辅助监督框架——可编程梯度信息(PGI),用于解决深度神经网络中的信息瓶颈问题及深度监督机制在轻量级模型中的适用性。为实现这一目标,设计了广义高效层聚合网络(GELAN),该网络结合了CSPNet和ELAN的优点,在保持轻量化的同时提高了推理速度与准确性。实验表明,PGI不仅提升了轻量级模型的性能,还增强了深层模型训练过程中的梯度可靠性,使模型能更准确地建立数据与目标之间的关联。YOLOv9通过融合PGI和GELAN实现了全面改进,在MS COCO数据集上的表现超越现有实时目标检测器,参数减少49%,计算量降低43%,同时AP值提升0.6%。

全文摘要

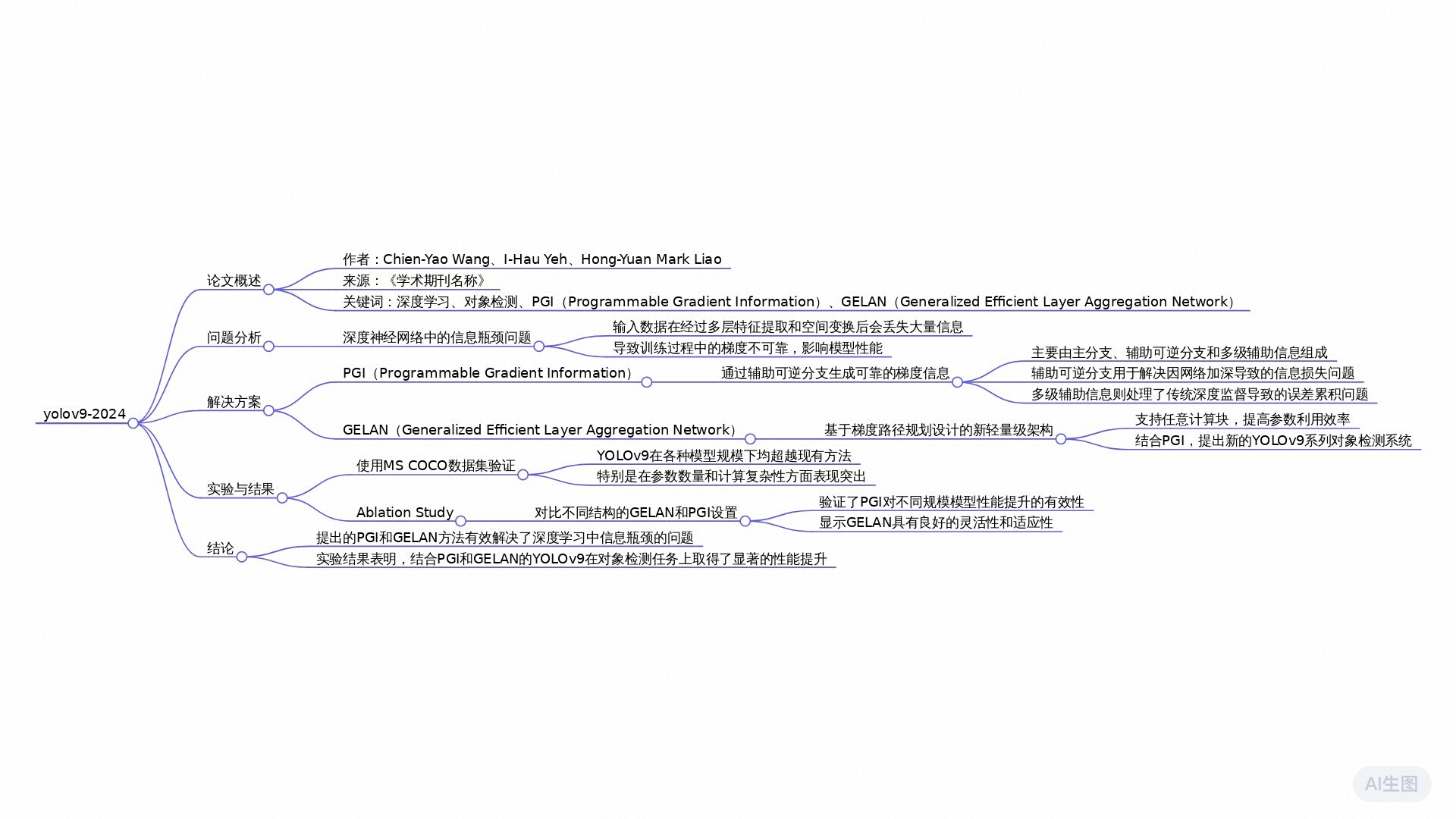

论文标题为《YOLOv9: Learning What You Want to Learn》,由来自台湾的研究团队进行研究。该论文探讨了深度学习模型在进行目标检测时的信息损失问题,特别是在数据通过深度网络的传递过程中,如何有效保留有用的信息以减少梯度更新的不准确性。

主题概述: 该论文提出了一种新的概念——可编程梯度信息(PGI),来解决在深度网络中常见的信息瓶颈问题。通过设计一个辅助可逆分支,PGI确保在通过网络时能够生成可靠的梯度信息,从而有效地更新模型参数,提高学习效果。并且,论文还展示了一个新的轻量级网络架构——广义高效层聚合网络(GELAN),支持多种计算模块的组合,从而提升了模型性能。

主要结论:

- 信息损失解决方案:PGI能够提供完整的输入信息,确保梯度计算的可靠性,从而提高模型的学习能力和预测准确性。

- 轻量级模型表现突出:GELAN仅使用常规卷积操作,在参数利用率上超越了基于深度卷积的先进方法,使得轻量级模型在实际应用中更具实用性。

- 出色的目标检测性能:经验证,基于MS COCO数据集的YOLOv9在多个方面超越了现有的实时目标检测器,展示了其强大的竞争力。

独特之处: 该论文的创新之处在于结合了PGI和GELAN,提高了深度学习模型在小规模数据集上的训练效果,尤其是在"从头开始"训练的情况下。研究者的工作强调了深度学习模型中信息保留的重要性,为未来的模型设计提供了新的思路。

研究问题

- 如何在深度网络中减少信息瓶颈导致的信息丢失,同时保持可靠的梯度信息以更新模型权重?

- 是否可以通过设计可编程梯度信息(PGI)来克服传统深度监督机制的局限性,并适用于轻量级神经网络?

- GELAN架构如何通过结合不同计算块实现高效且轻量化的特征提取,同时保持准确率?

- 在不同大小的模型中,PGI是否能够有效解决信息瓶颈和信息断裂问题,并提高各种模型的准确性?

- PGI与传统深度监督相比,在浅层模型和深层模型中的表现有何差异,以及其对梯度可靠性的影响是什么?

研究方法

实验研究: 提出了一种新的辅助监督框架称为可编程梯度信息(PGI),并通过设计主分支、辅助可逆分支以及多级辅助信息来解决深度学习方法中的关键问题。在MS COCO数据集上验证了所提出的YOLOv9,在参数量和计算量方面均优于现有实时目标检测器。

比较研究: 通过对比不同网络架构(如PlainNet、ResNet、CSPNet和GELAN)的可视化结果,发现GELAN在保持特征完整性方面表现最优,特别是在深层网络中仍能保留清晰的边界信息。

混合方法研究: 结合了两种已有网络架构CSPNet和ELAN的优点,设计了通用高效的层聚合网络(GELAN),并在不同的计算块和深度设置下展示了其稳定性能。

元分析: 通过对多种计算块(如Res块、Dark块、CSP块)的消融实验表明,使用CSP块的GELAN-S在性能上提升明显,参数量和计算量减少的同时,AP提升了0.7%。

研究思路

该论文“YOLOv9: Learning What You Want to Learn”提出了一个新颖的对象检测方法,主要通过编程梯度信息(Programmable Gradient Information, PGI)和一种新的轻量级网络架构(Generalized Efficient Layer Aggregation Network, GELAN)来缓解深度学习模型中的信息损失问题。

论文的研究思路主要围绕如何利用PGI和GELAN来解决深度神经网络中的信息瓶颈问题。在深度学习过程中,输入数据经过逐层的特征提取和空间变换时,常常会造成大量信息损失,这直接影响到模型的预测准确性。因此,研究者旨在提出一种方法,能够更好地保留输入数据在向深层传递时的重要信息,从而提升模型的学习效果和泛化能力。

理论框架或模型

- 理论基础:论文借鉴了可逆函数(Reversible Functions)和信息瓶颈原则(Information Bottleneck Principle)的理论基础。信息瓶颈原则表明,在数据经过变换过程中,信息会逐渐丧失,而可逆函数能够保证数据的转换过程不会丢失信息。这一理论被用来指导PGI的设计,使得模型能够在保留关键信息的同时,生成可靠的梯度用于网络权重更新。

- PGI模型:PGI模型是论文的核心,设计了辅助可逆分支来生成可靠的梯度信息,从而保证主分支获得充分的输入信息进行目标任务的训练。通过对不同语义层次的梯度信息进行编程,PGI能够克服传统深度监督的限制,使得轻量级和深度模型在训练过程中都能得到有效的信息支持。

- GELAN架构:GELAN是一种通用的高效层聚合网络,旨在提高参数利用率,减小计算复杂度,同时保证准确性和推理速度。GELAN的设计不仅考虑了网络的深度与宽度,还允许用户根据不同的推理设备灵活选择计算模块,从而适应多种应用场景。

研究方法

- 数据集与实验设计:该研究在MS COCO数据集上进行了广泛的实验,验证了提出的PGI和GELAN的有效性。实验采用了从零开始的训练策略,探索了超参数调优和数据增强的方法,以不同的模型规模和配置严格评估新方法的性能。

- 模型训练:研究者使用SGD优化器进行训练,定义了一系列的超参数,包括学习率、动量、权重衰减和数据增强策略。论文详细描述了模型架构的设置,包括使用CSP-ELAN作为计算块进行组合,从而保持高性能的同时控制参数量。

- 比较与评估:通过与多种先进对象检测模型(如YOLO系列、RT DETR等)进行对比,展示了YOLOv9在准确性、参数利用率和计算复杂度方面的优势,尤其是在小型和中型模型中的表现。

问题陈述

通常,人们认为深度神经网络收敛困难的原因是梯度消失或梯度爆炸等问题,这些问题在传统的深度神经网络中确实存在。然而,现代深度神经网络通过设计各种归一化和激活函数已经从根本上解决了上述问题。尽管如此,深度神经网络仍然存在收敛缓慢或结果较差的问题。

在本文中,我们进一步探讨了上述问题的本质。通过深入分析信息瓶颈,我们推断出这个问题的根本原因是来自一个非常深的网络的初始梯度在传输后很快丢失了很多实现目标所需的信息。为了验证这一推理,我们在具有不同架构的深度前馈网络中输入初始权重,并在图 2 中可视化和说明它们。显然,PlainNet 在很深的层中丢失了许多用于对象检测的重要信息。ResNet、CSPNet 和 GELAN 能够保留的重要信息的比例确实与训练后的精度呈正相关。我们进一步设计了基于可逆网络的方法来解决上述问题的原因。在本节中,我们将详细阐述我们的信息瓶颈原则和可逆函数分析。

信息瓶颈原则

根据信息瓶颈原则,我们知道数据X在经过变换时可能会导致信息损失,如公式(1)所示:

I ( X , X ) ≥ I ( X , f θ ( X ) ) ≥ I ( X , g ϕ ( f θ ( X ) ) ) , ( 1 ) I(X,X)\geq I(X,f_\theta(X))\geq I(X,g_\phi(f_\theta(X))),\quad(1) I(X,X)≥I(X,fθ(X))≥I(X,gϕ(fθ(X))),(1)

其中,I 表示互信息,f 和 g 是变换函数, θ θ <

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?