SROBB: Targeted Perceptual Loss for Single Image Super-Resolution

没有GitHub

论文翻译:https://blog.csdn.net/breezero/article/details/100624738

问题:

如果将CNN应用在整体图像上,而不考虑语义信息,会限制其能力。仍使用小内核较少细粒度的空间细节。需要学习具有全局语义意义和抽象对象信息的特征。

做法:

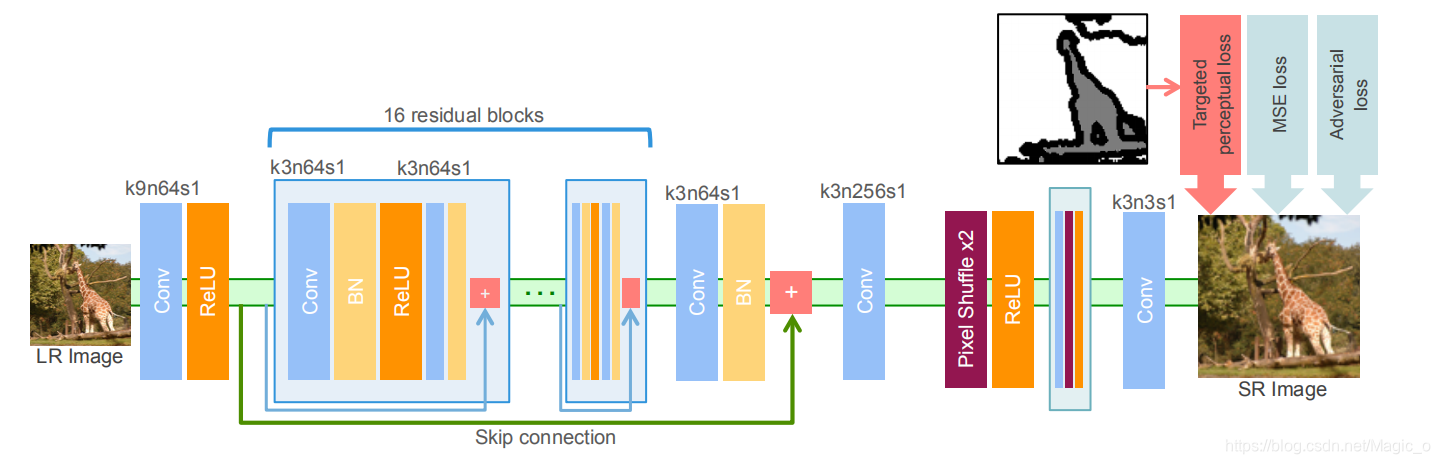

- 提出的目标函数用相应的损失项对图像的不同区域进行惩罚,即在训练过程中使用边缘损失对边缘进行惩罚,使用纹理损失对纹理进行惩罚。

- 我们引入了我们的OBB标签,以提供更好的空间控制的语义信息的图像。这使得我们有针对性的感知损失集中在图像的语义区域。

好处:

- 更真实的纹理和更锐利的边缘。

- 基于像素的分割注释来构建我们所提议的OBB标签,以便能够找到可用于最小化不同图像区域适当损失的定向感知特征。

具体方法:

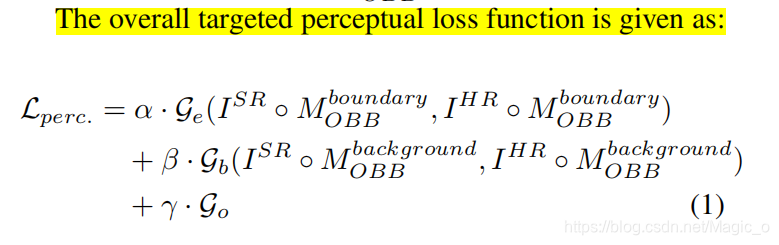

我们引入了一个包含三个项的损失函数:

- 像素损失(MSE),

- 对抗性损失,

- 我们新的定向知觉损失。

下面介绍了新的定向知觉损失

使用低级特征重构边缘更有效,而使用中级特征分解的纹理更接近于原始图像。

为此,我们首先在图像中定义三种类型的区域:1-背景,2-边界和3-对象,然后使用不同的函数计算每个区域的目标感知损失。

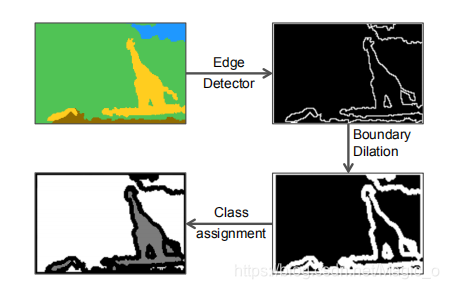

为了创建这样的标签(OBB标签),

- 我们首先计算分割标签在颜色空间中的导数来估计分割标签中目标类之间的边缘以及目标与图像背景之间的边缘。为了在分离不同类的所有边缘上都有一个较厚的条带,我们计算大小为d1的圆盘的膨胀。我们将结果区域标记为“boundary”类,它覆盖了图像中不同类之间的边界。

- 我们特别认为“天空”、“植物”、“地面”和“水”类从分割标签中作为“背景”。

- 所有剩余的对象类都被认为是“object”类

实验

为了创建OBB标签,我们使用COCO-Stuff数据集的50K图像随机集合,其中包含91个类的语义标签用于分割任务。在本文中,我们考虑了一个或多个“天空”、“植物”、“地面”和“水”类的景观。我们将这些类分组到一个“Background”类中。我们使用3.2节中提出的技术将像素级的分割注释转换为OBB标签。为了获得LR图像,我们使用MATLAB的imresize函数与双三次核和抗混叠滤波器。所有的实验都是在dow上进行的

首先,以像素平均平方误差作为损失函数,对SR解码器进行25个epoch的预训练。

然后,将提出的目标知觉损失函数和对抗性知觉损失函数相加,再进行55个多epoch的训练。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?