有了实验评估方法和性能度量,看似就可以比较不同方法的效果了,但是这是不严谨的。

首先我们希望比较的是泛化性能,可能与测试集上的结果不同,这就需要用到统计假设检验,基于假设检验结果我们可推断出,若在测试集上观察到学习器A比B好,则A的泛化性能是否在统计意义上优于B,以及这个结论的把握有多大。

以下介绍两种最基本的假设检验,为便于讨论,本节默认使用错误率为性能度量。

1.假设检验

很多时候要经过多次留出法或者交叉验证法进行多次训练/测试,这样就会有多个测试错误率。

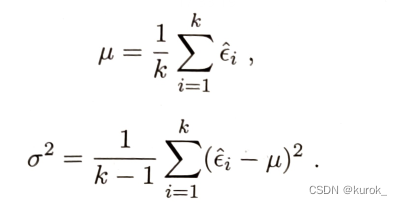

假设得到了k个测试错误率,1~k,平均错误率和方差可求出

可以使用T-检验方法进行均值检验,检验泛化错误率是否为0。

2.机器学习实际中为什么不常用假设检验?

(8 封私信 / 28 条消息) 为什么做机器学习的很少使用假设检验? - 知乎 (zhihu.com)

挺麻烦的好像,大概因为参数空间比传统的都要大。

566

566

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?