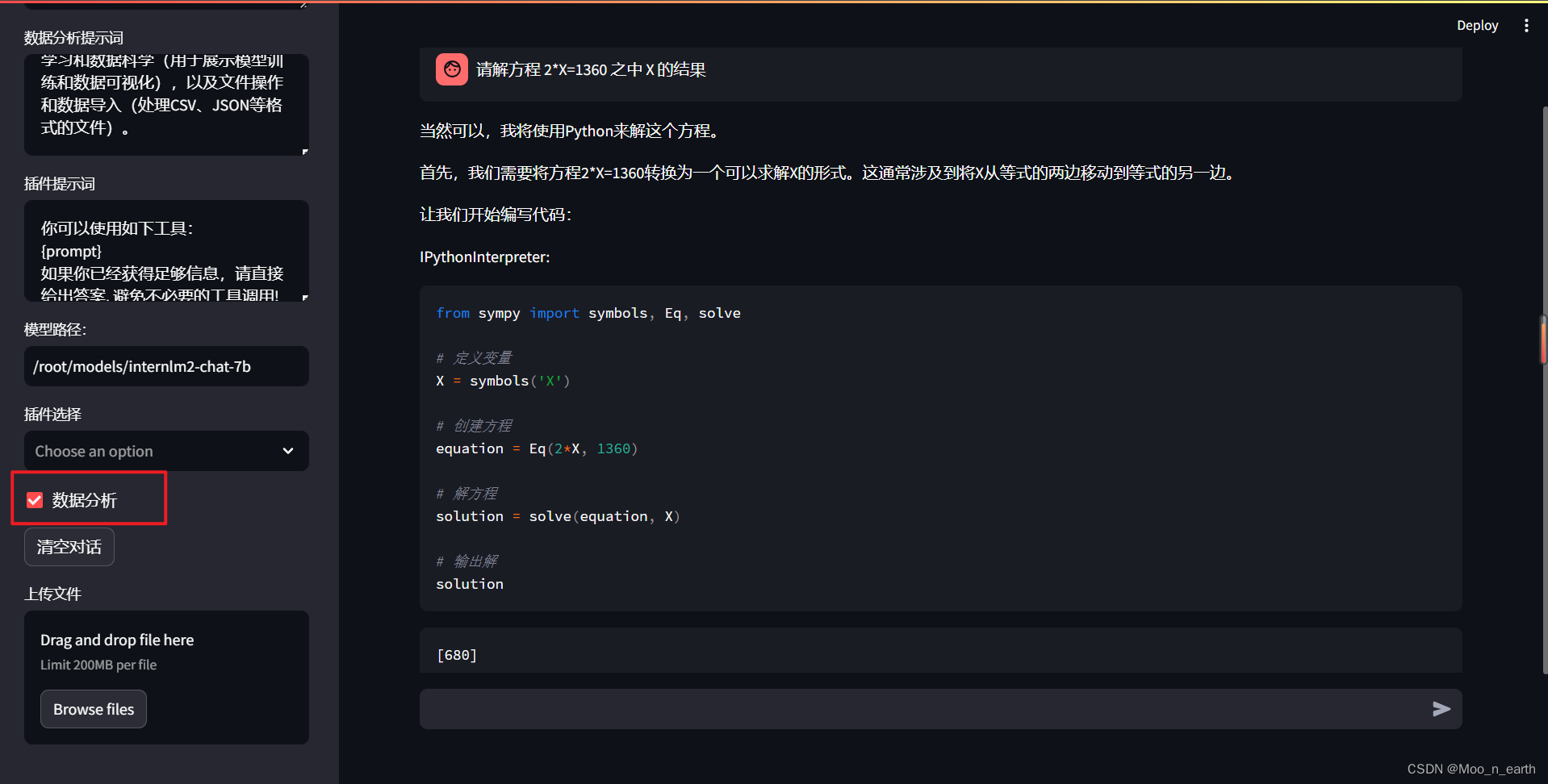

使用 Lagent 运行 InternLM2-Chat-7B 模型,调用数据分析:

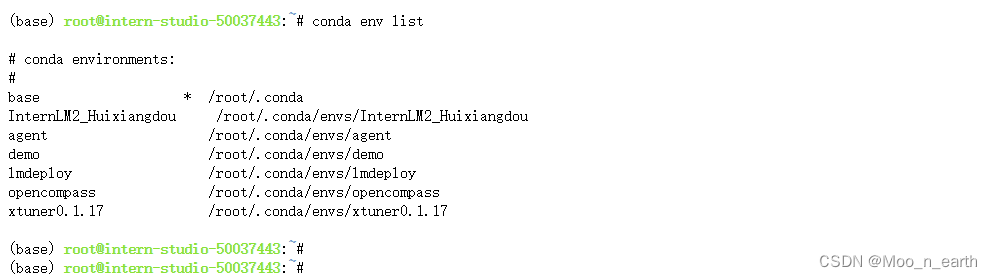

做好前期环境准备:

conda activate demo

cd /root/demo

git clone https://gitee.com/internlm/lagent.git

# git clone https://github.com/internlm/lagent.git

cd /root/demo/lagent

git checkout 581d9fb8987a5d9b72bb9ebd37a95efd47d479ac

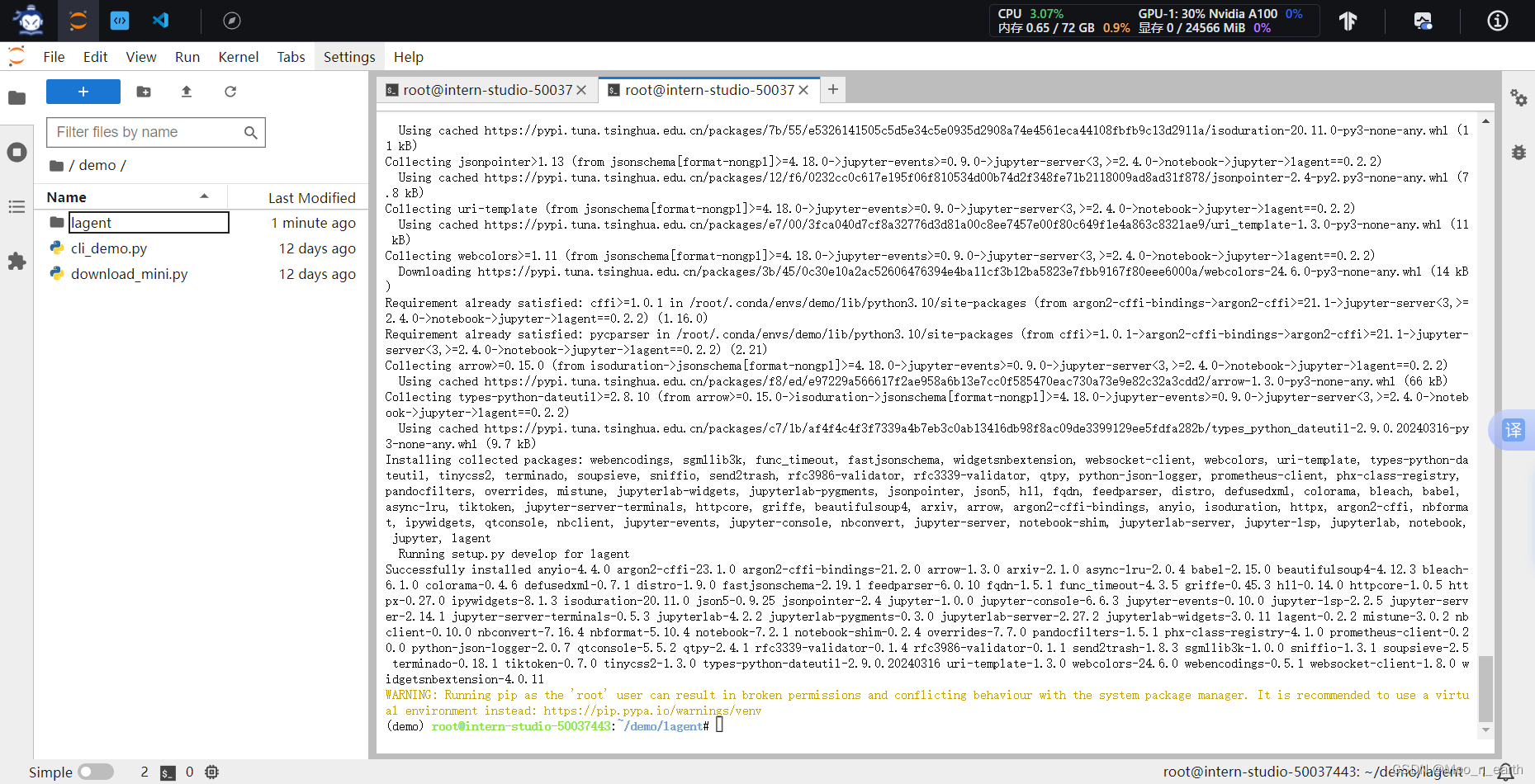

pip install -e . # 源码安装

使用 Lagent 运行 InternLM2-Chat-7B 模型为内核的智能体

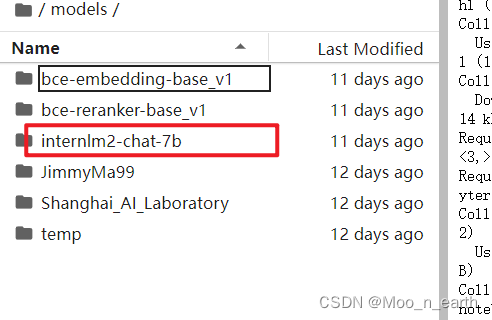

构建模型地址软链接:

cd /root/demo/lagent

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-7b /root/models/internlm2-chat-7b

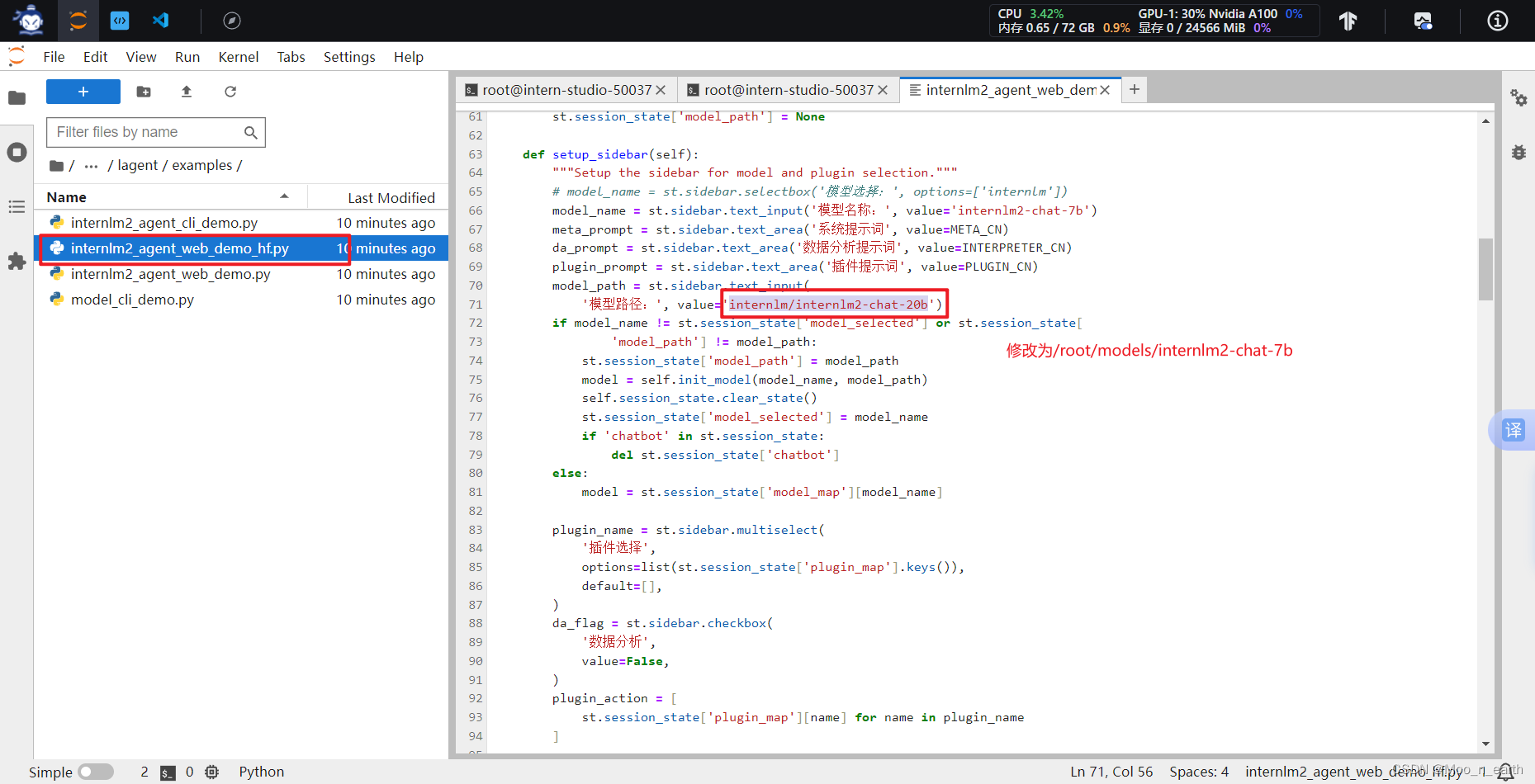

打开 lagent 路径下 examples/internlm2_agent_web_demo_hf.py 文件,修改需要使用的模型

运行命令:

streamlit run /root/demo/lagent/examples/internlm2_agent_web_demo_hf.py --server.address 127.0.0.1 --server.port 6006进行本地端口映射,已经做过很多次这里不再赘述,细节见玩转书生·浦语趣味 Demo学习笔记(一)

结果如下,勾选数据分析,然后测试:

实践部署 浦语·灵笔2 模型:

介绍浦语·灵笔2:

浦语·灵笔2 是基于 书生·浦语2 大语言模型研发的突破性的图文多模态大模型,具有非凡的图文写作和图像理解能力,在多种应用场景表现出色,总结起来其具有:

- 自由指令输入的图文写作能力:

浦语·灵笔2可以理解自由形式的图文指令输入,包括大纲、文章细节要求、参考图片等,为用户打造图文并貌的专属文章。生成的文章文采斐然,图文相得益彰,提供沉浸式的阅读体验。 - 准确的图文问题解答能力:

浦语·灵笔2具有海量图文知识,可以准确的回复各种图文问答难题,在识别、感知、细节描述、视觉推理等能力上表现惊人。 - 杰出的综合能力:

浦语·灵笔2-7B基于书生·浦语2-7B模型,在13项多模态评测中大幅领先同量级多模态模型,在其中6项评测中超过GPT-4V和Gemini Pro。

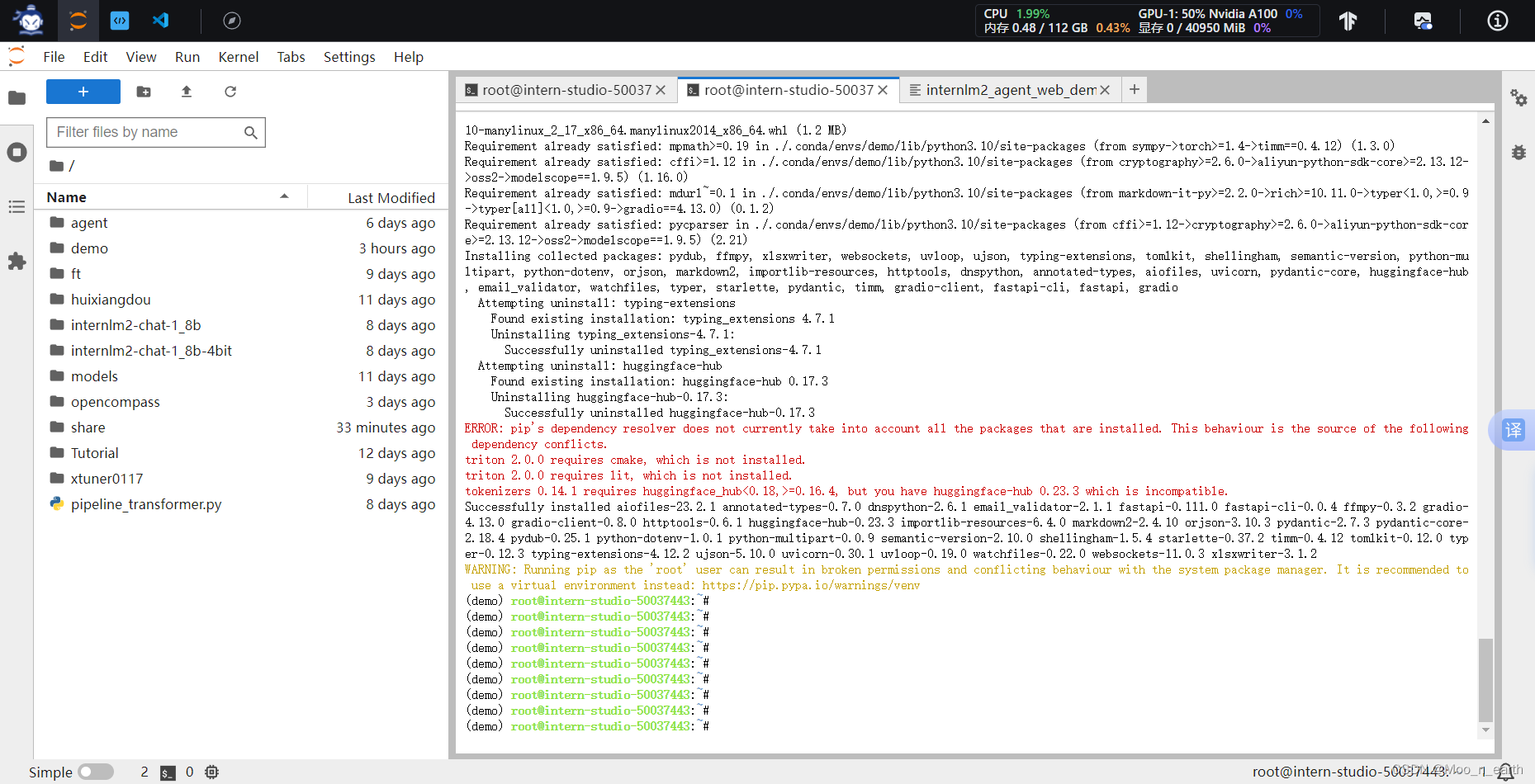

配置相关环境:

conda activate demo

# 补充环境包

pip install timm==0.4.12 sentencepiece==0.1.99 markdown2==2.4.10 xlsxwriter==3.1.2 gradio==4.13.0 modelscope==1.9.5

cd /root/demo

git clone https://gitee.com/internlm/InternLM-XComposer.git

# git clone https://github.com/internlm/InternLM-XComposer.git

cd /root/demo/InternLM-XComposer

git checkout f31220eddca2cf6246ee2ddf8e375a40457ff626

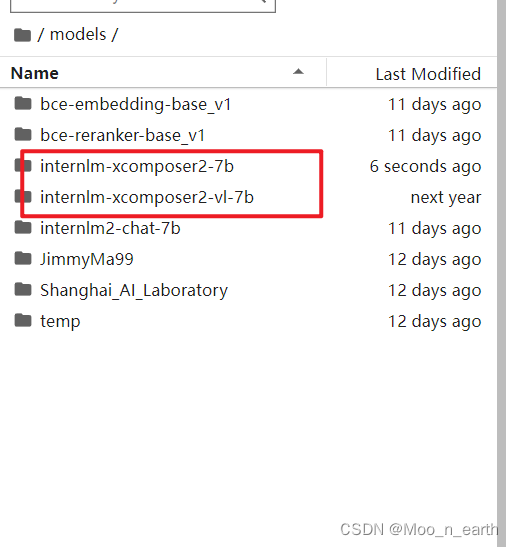

建立模型软链接:

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm-xcomposer2-7b /root/models/internlm-xcomposer2-7b

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm-xcomposer2-vl-7b /root/models/internlm-xcomposer2-vl-7b

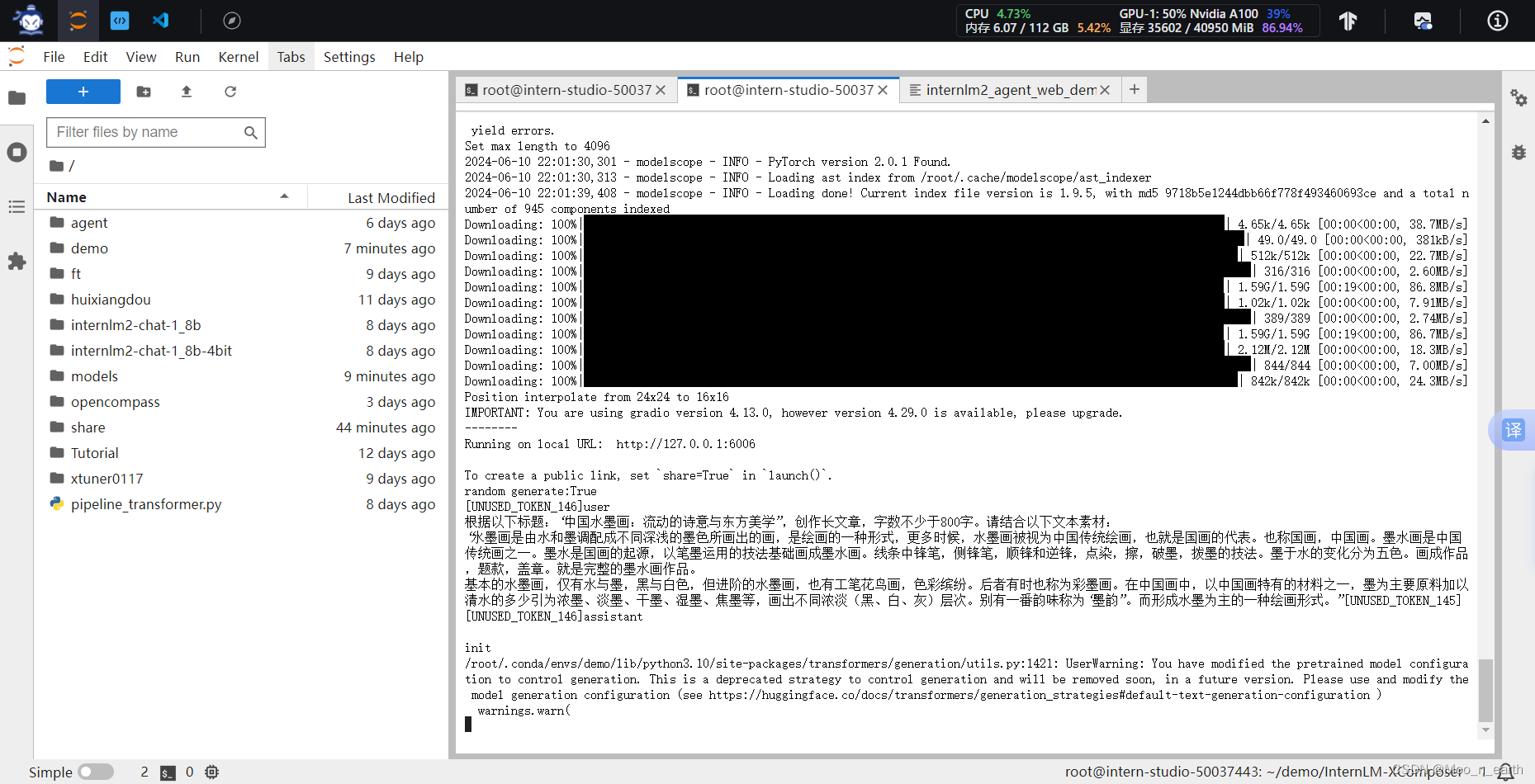

图文写作实战:

运行命令:

cd /root/demo/InternLM-XComposer

python /root/demo/InternLM-XComposer/examples/gradio_demo_composition.py \

--code_path /root/models/internlm-xcomposer2-7b \

--private \

--num_gpus 1 \

--port 6006建立好本地端口映射,细节见玩转书生·浦语趣味 Demo学习笔记(一)

结果如下:

牛,以后直接实现写文章自由。至此Demo跑通

图片理解实战:

shut down刚才运行的terminal(避免显存耗尽)并重新启动一个新的 terminal,继续输入指令,启动 InternLM-XComposer2-vl:

conda activate demo

cd /root/demo/InternLM-XComposer

python /root/demo/InternLM-XComposer/examples/gradio_demo_chat.py \

--code_path /root/models/internlm-xcomposer2-vl-7b \

--private \

--num_gpus 1 \

--port 6006确保本地端口映射依然正常,打开 http://127.0.0.1:6006

结果如下:

Demo跑通

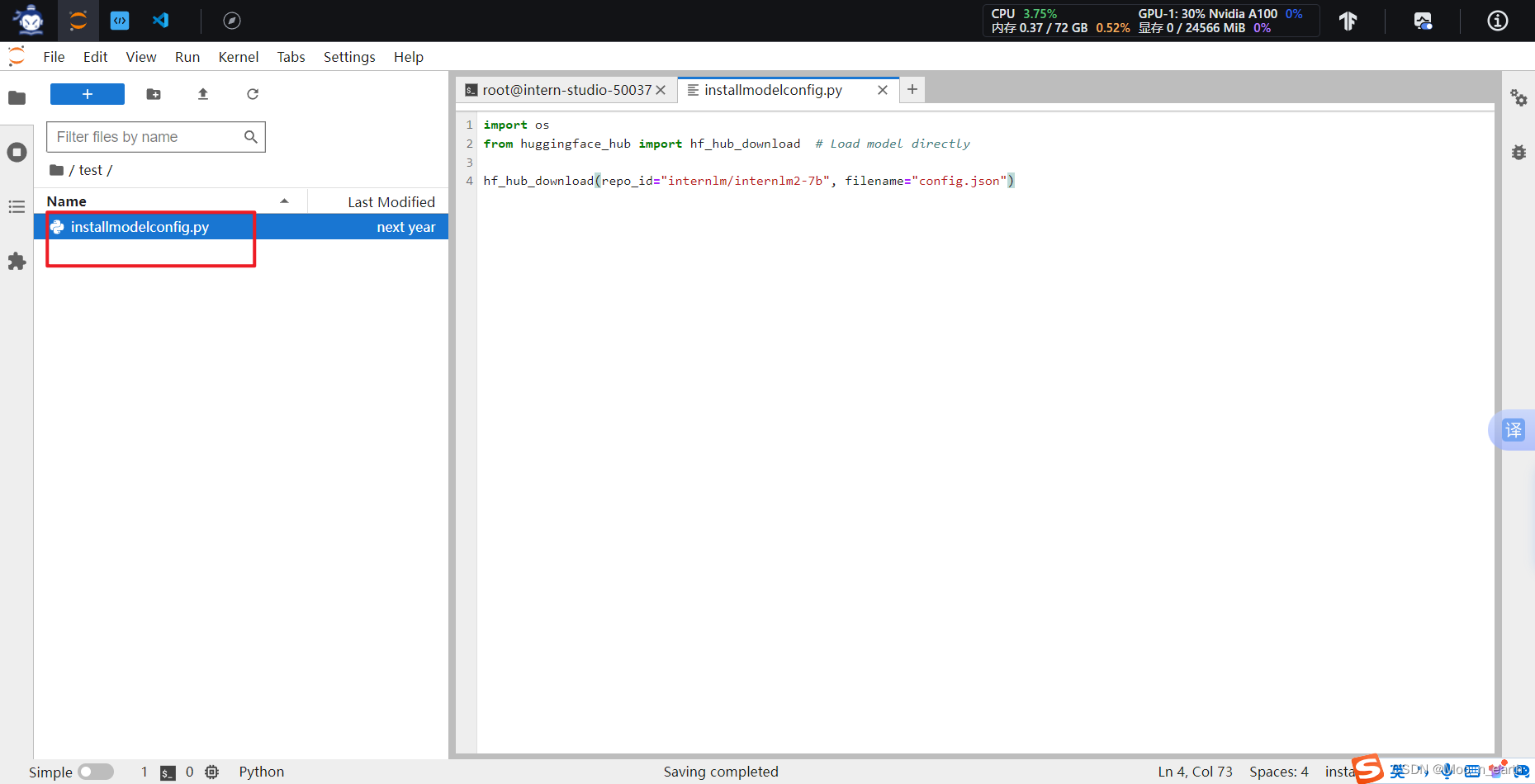

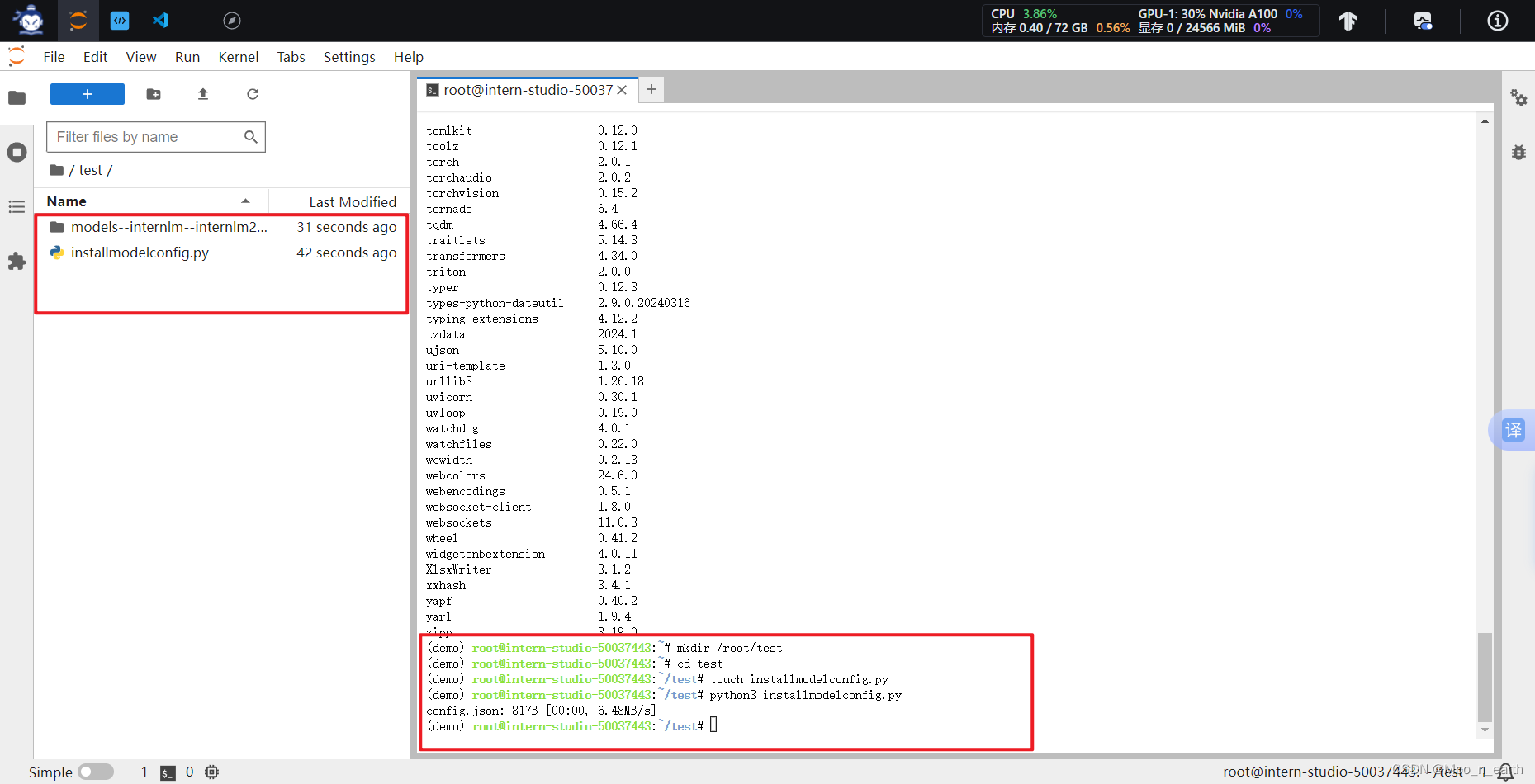

Hugging Face模型下载:

(以下载模型配置文件为例)

使用 Hugging Face 官方提供的 huggingface-cli 命令行工具。安装依赖:

pip install -U huggingface_hub以下内容将展示使用 huggingface_hub 下载模型中的部分文件:

import os

from huggingface_hub import hf_hub_download # Load model directly

hf_hub_download(repo_id="internlm/internlm2-7b", filename="config.json")结果如下:

hf_hub_download 函数传递 cache_dir 参数可以指定下载路径。

1722

1722

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?