基于对抗自编码器(AAE)的图像生成模型

matlab代码

ID:5199649604569612

誩宝

近年来,随着人工智能的发展,图像生成技术逐渐成为研究的热点领域之一。其中,基于对抗自编码器(AAE)的图像生成模型在图像生成领域取得了显著的成果。本文将介绍AAE的原理、优势以及如何使用MATLAB实现图像生成。

首先,我们来了解一下对抗自编码器(AAE)的原理。AAE是一种生成对抗网络(GAN)的变种,它由一个编码器、一个解码器和一个鉴别器组成。编码器将输入的图像转换为潜在空间中的向量表示,解码器则根据这个向量生成图像。而鉴别器则试图区分真实图像和生成图像,从而训练生成器生成更逼真的图像。通过对编码器和解码器的交互训练,AAE能够学习到图像的分布特征,并可以生成与真实图像相似的图像。

AAE相比传统的自编码器具有许多优势。首先,AAE通过引入鉴别器的概念,使得生成的图像更加逼真。鉴别器的存在使得生成器不仅仅是学习到输入图像的一种编码表示,而是学习到了图像的整体分布特征。其次,AAE能够在潜在空间中进行插值操作,从而实现图像的随机生成。通过在潜在空间中进行向量操作,我们可以生成具有不同属性的图像,从而实现图像的多样性。

接下来,我们将介绍如何使用MATLAB实现基于对抗自编码器的图像生成模型。首先,我们需要加载并预处理图像数据。可以使用MATLAB自带的图像处理工具箱对图像进行预处理,例如调整图像大小、归一化等。

然后,我们需要构建AAE的网络结构。可以使用MATLAB的深度学习工具箱来构建编码器、解码器和鉴别器的网络结构。在构建网络结构时,我们需要注意参数的选择和网络层的设计,以达到更好的生成效果。

接下来,我们需要定义AAE的损失函数和优化器。在AAE中,生成器和鉴别器分别有自己的损失函数。生成器的损失函数可以采用均方差损失或者交叉熵损失,而鉴别器的损失函数可以采用二分类的交叉熵损失。当定义好损失函数后,我们可以使用MATLAB的优化器进行参数的更新和优化。

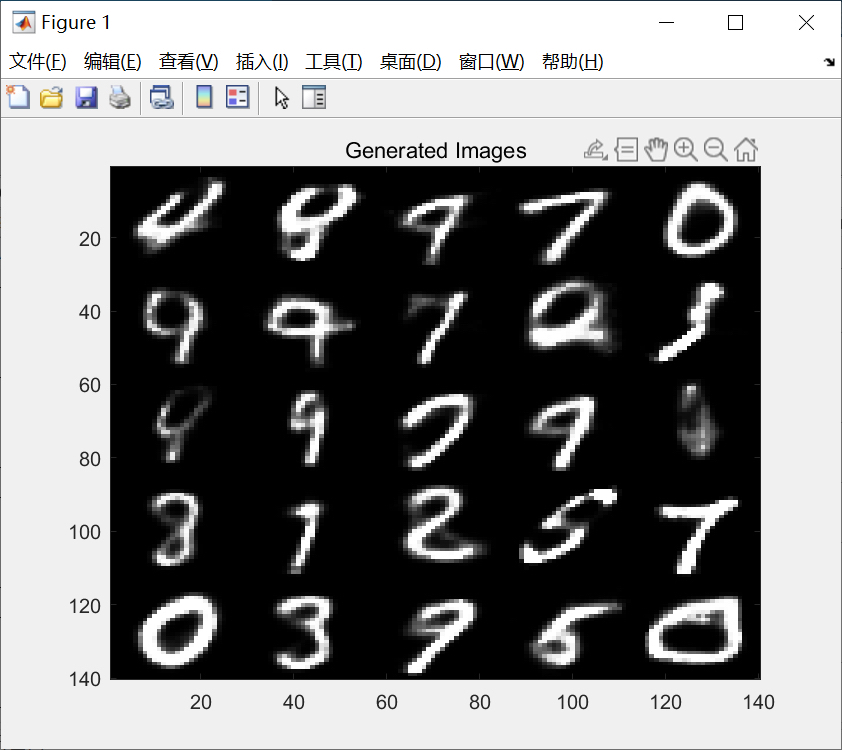

最后,我们可以开始训练AAE模型并生成图像。在训练过程中,我们需要将真实图像和生成图像输入到鉴别器中进行对抗训练。通过多次迭代训练,AAE模型会逐渐学习到图像的分布特征,并能够生成逼真的图像。通过调整训练参数和网络结构,我们可以获得更好的生成效果。

综上所述,基于对抗自编码器(AAE)的图像生成模型是一种强大的图像生成技术。通过对编码器、解码器和鉴别器的交互训练,AAE能够学习到图像的分布特征,并可以生成与真实图像相似的图像。使用MATLAB实现AAE模型需要加载和预处理图像数据、构建网络结构、定义损失函数和优化器,并进行训练和生成图像。通过调整参数和网络结构,我们可以获得更好的生成效果。希望本文对于图像生成领域的研究和实践有所帮助。

相关的代码,程序地址如下:http://coupd.cn/649604569612.html

2118

2118

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?