【李宏毅机器学习2021】本系列是针对datawhale《李宏毅机器学习-2022》的学习笔记。本次是对机器学习介绍的学习总结。本节通过学习视频了解到李老师对机器学习课程的整体安排,介绍了每个章节的侧重点,从回归开始,由有监督到半监督,无监督。以及后续的mata learning。整体介绍目前深度学习的学习大纲。讲解中也穿插了有多有趣的例子,容易接受同时也充满乐趣。希望在参加本次学习课程可以拓宽自己的知识面,打扎实基础理论,点满技能树,在丰富作业体系下提升自己的DLcoing能力。

课程链接:

19版:1-机器学习介绍_哔哩哔哩_bilibili

21版:(强推)李宏毅2021/2022春机器学习课程_哔哩哔哩_bilibili

目录

Task01 机器学习介绍

本节对15节课做整体介绍,也是对机器学习做整体介绍。

01-什么是机器学习

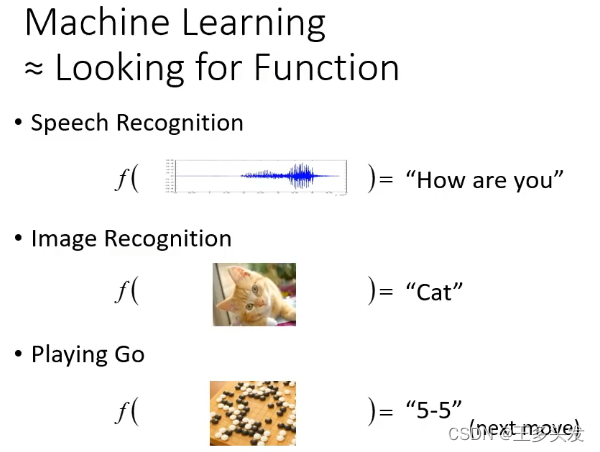

机器学习就是计算机自身构建方程,对送入的数据通过方程得到目标结果的过程。虽然李老师的课叫机器学习,但主要讲的是深度学习的内容啦~

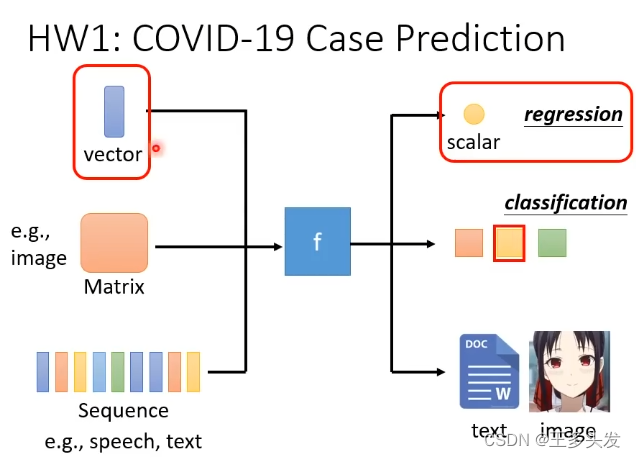

针对深度学习的输入与输出也做了介绍,输入包括但不限于向量、矩阵、序列,输出包括但不限于点、分类、文章图像等等。

02-教机器的几种方法

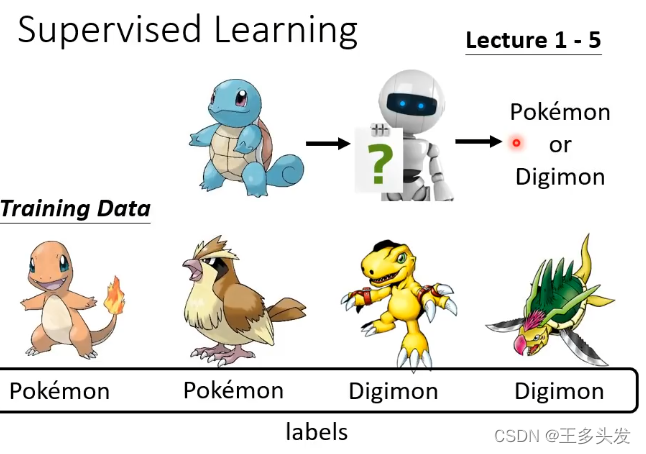

有监督 :通过对数据集进行标记训练

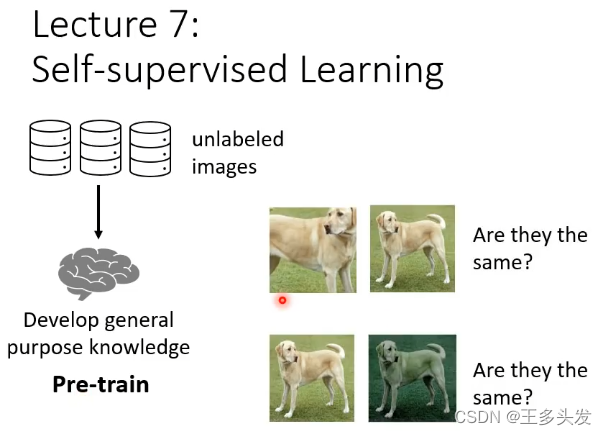

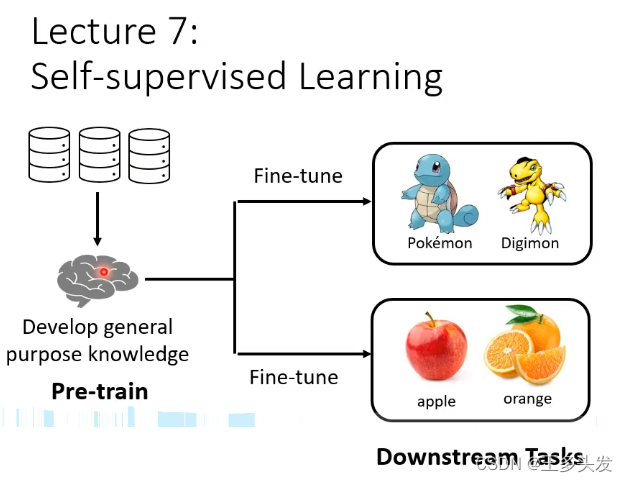

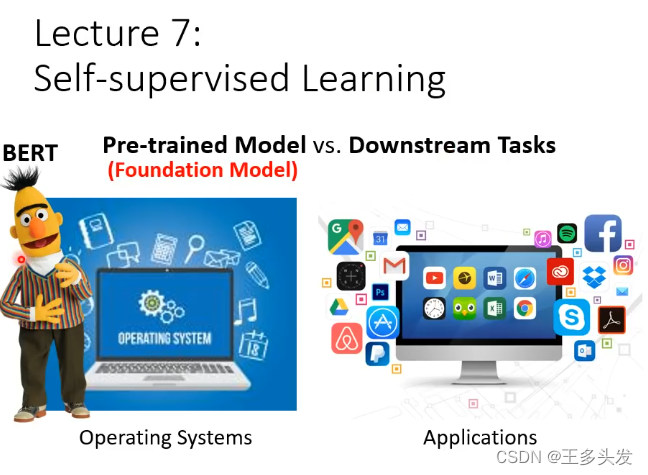

自监督:通过预训练进行预测,感觉是迁移学习吧= = 不太懂,虽然以前做过Fine-tune

这个就好比有一个大模型,比如cfr1000训好,就可以拿过来到别的训练项目上,比如专门分狗的训练器上,坐下游任务。可以减少很多训练工作量。

无监督:

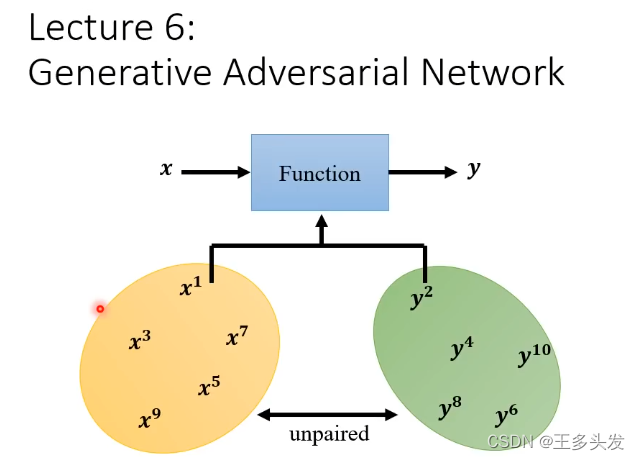

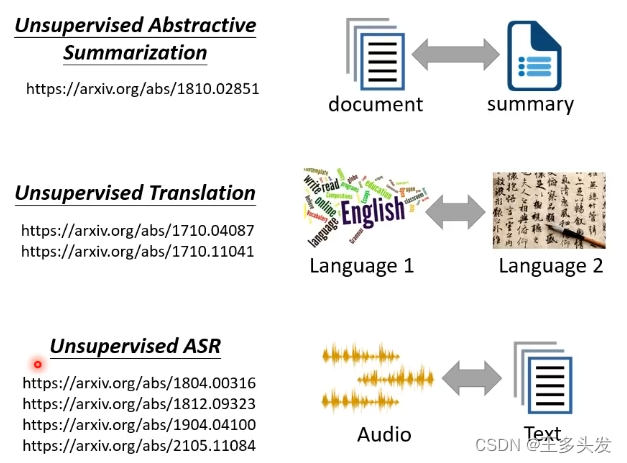

给出数据和标签自行匹配,代表算法就是GAN

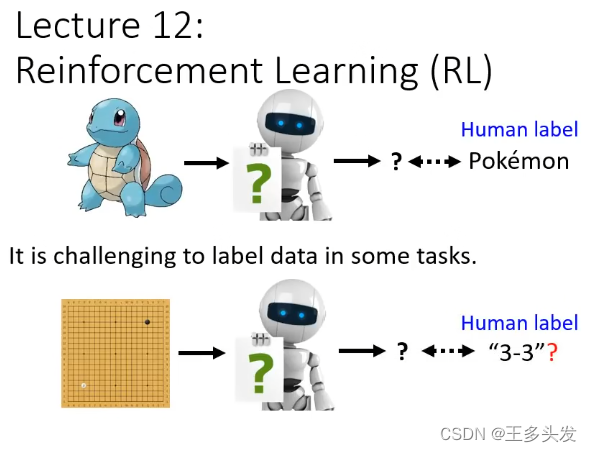

RL:强化学习

和监督学习不同。主要解决不知道怎么标注资料的时候使用,比如教机器下围棋。一般用作电脑自己玩游戏 = =,就是自己训练自己玩电子游戏的AI

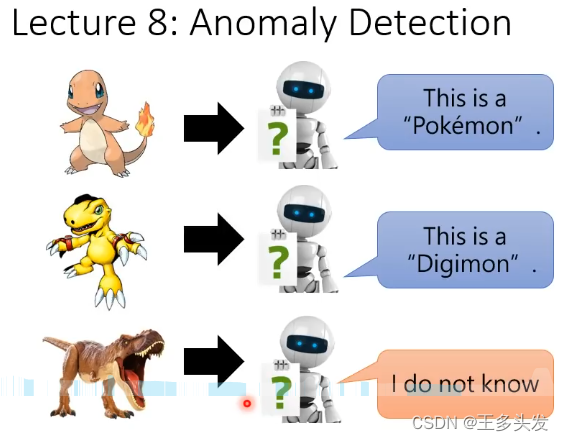

异常检测:

对异常数据,非标注数据的检测

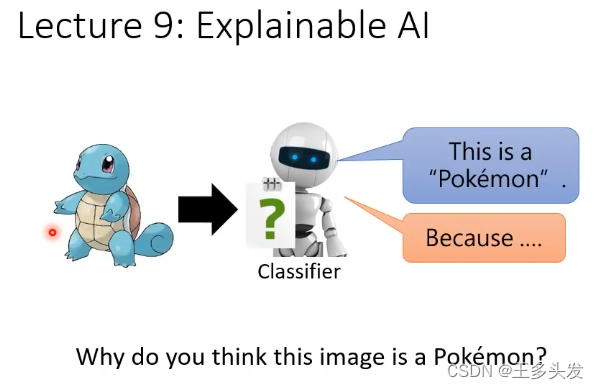

可解释性:

为了更好的评价深度学习模型,更直观更容易理解。

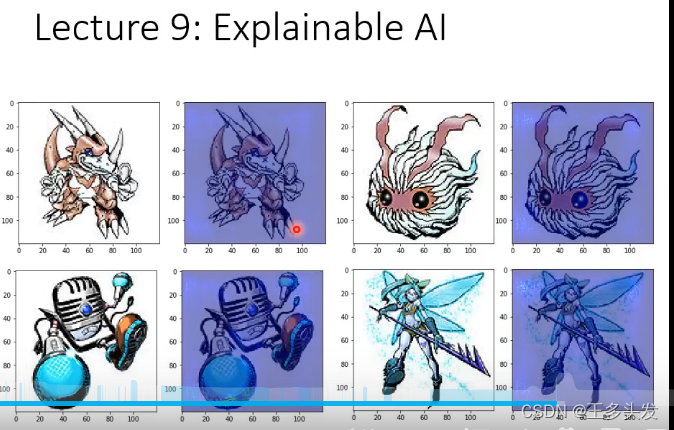

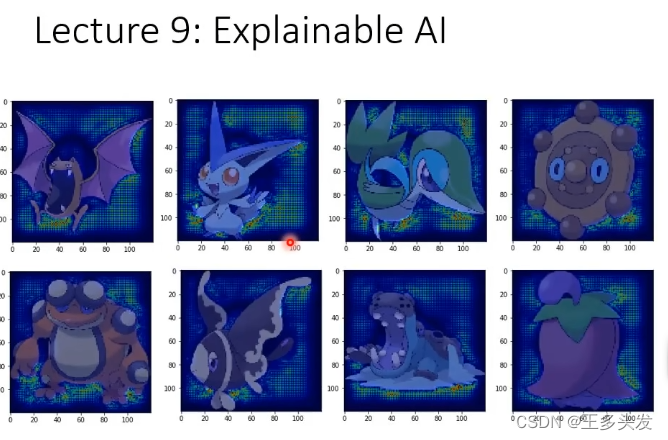

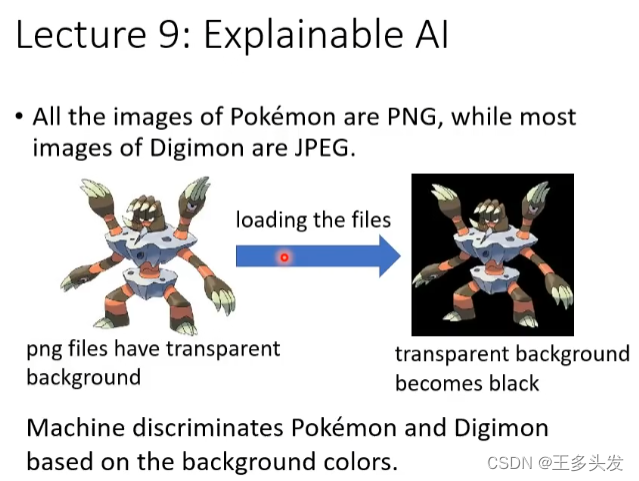

这里举的这个例子在讲可解释性的重要性,我觉得很有意义 = =。大概说一下就是李老师做了一个分类宝可梦和数码宝贝的分类器,但是精度到98%。想看看可解释性的表现情况,结果发现模型的敏感区域都是在图像四周!结果发现训练图中,宝可梦是黑色背景,数码宝贝白色!!!!绝了,这个问题对训练影响很大,但是不认真确实不好发现……希望大家做模型时不要本末倒置,先确保数据集的质量。对于学习还是研究都比较有警醒意义。

再补一下:最近Bilibili大佬子豪兄在做可解释机器学习的授课,大家可以去看看。还有一个两天搞定人工智能毕业设计的专栏。安利给大家。

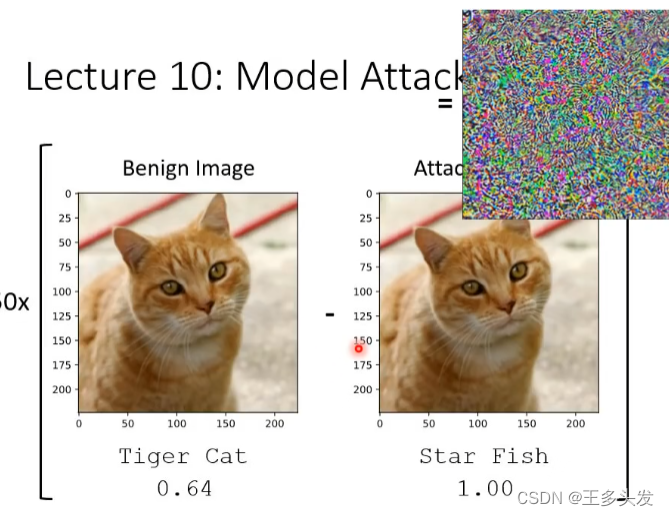

模型攻击:

这里介绍深度学习被模型攻击后的一个例子,第十章会将这块。

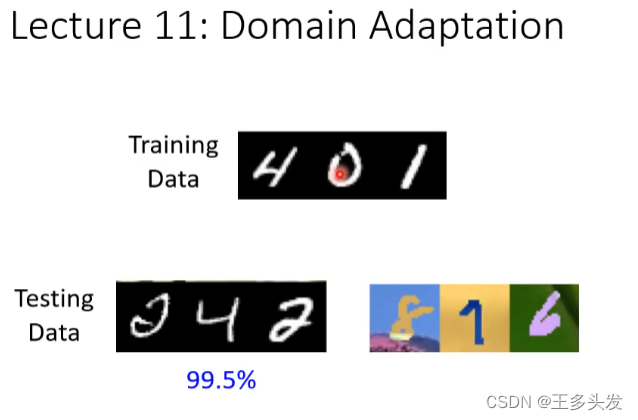

domain adaptation:

领域自适应,主要讲出现预训练图像差异较大的数据出现时,模型怎么更好的适应这些看上去合理但其实不太好预测的数据。例如下面的彩色数字。

Network Compression:

网络压缩,对大模型更好适应移动设备的解决方案。之前了解到的有剪枝和蒸馏,应该都在这里。

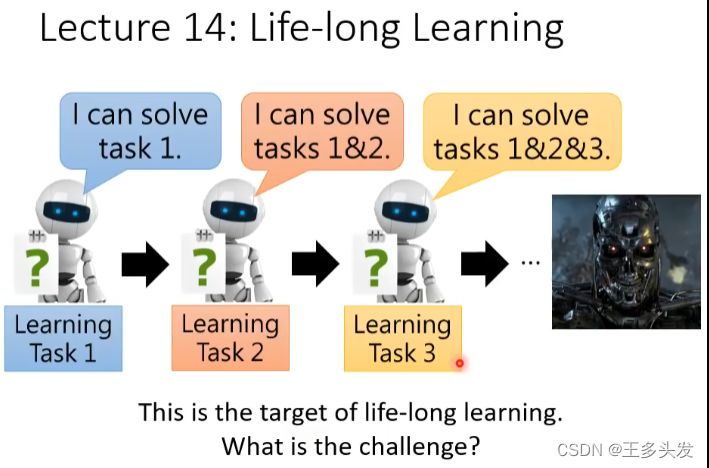

Life-long Learning:

建立一个永久学习的模型……感觉是哲学课

Meta learning:

机器自己学怎么学习,越来越离谱……

本次学习就是以上的知识,总的来说李老师讲课还是很有趣的。期待后续课程~加油!!

970

970

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?