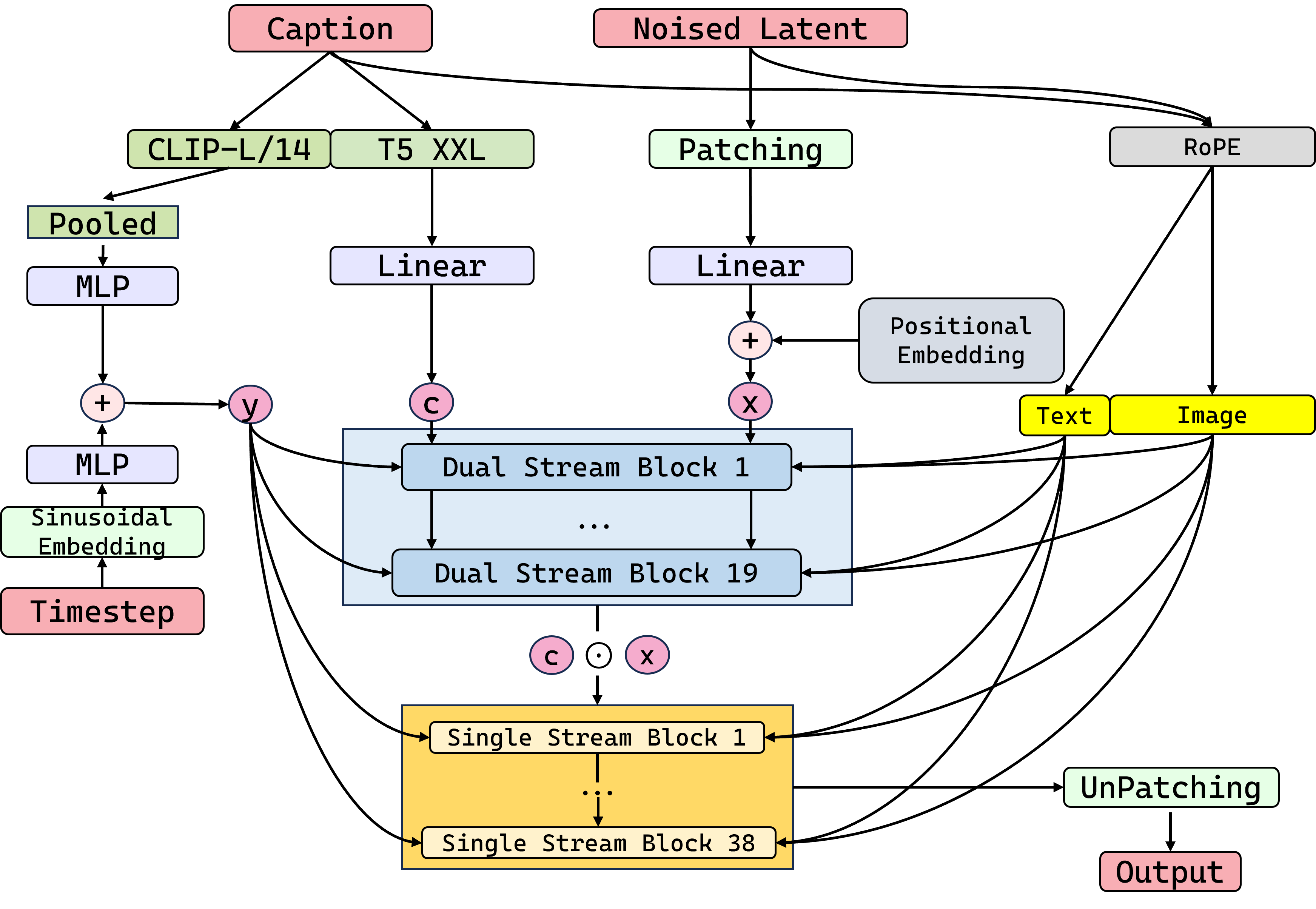

从大规模文本到图像(T2I)扩散模型中移除不需要的概念,同时保持其整体生成质量,仍然是一个尚未解决的挑战。这个问题在一些新兴范式中尤为突出,例如 Stable Diffusion(SD)v3 和 Flux,它们采用了流匹配(flow matching)和基于 Transformer 的架构。这些新技术限制了原先为旧版 T2I 范式(如 SD v1.4)设计的概念擦除技术的适用性。

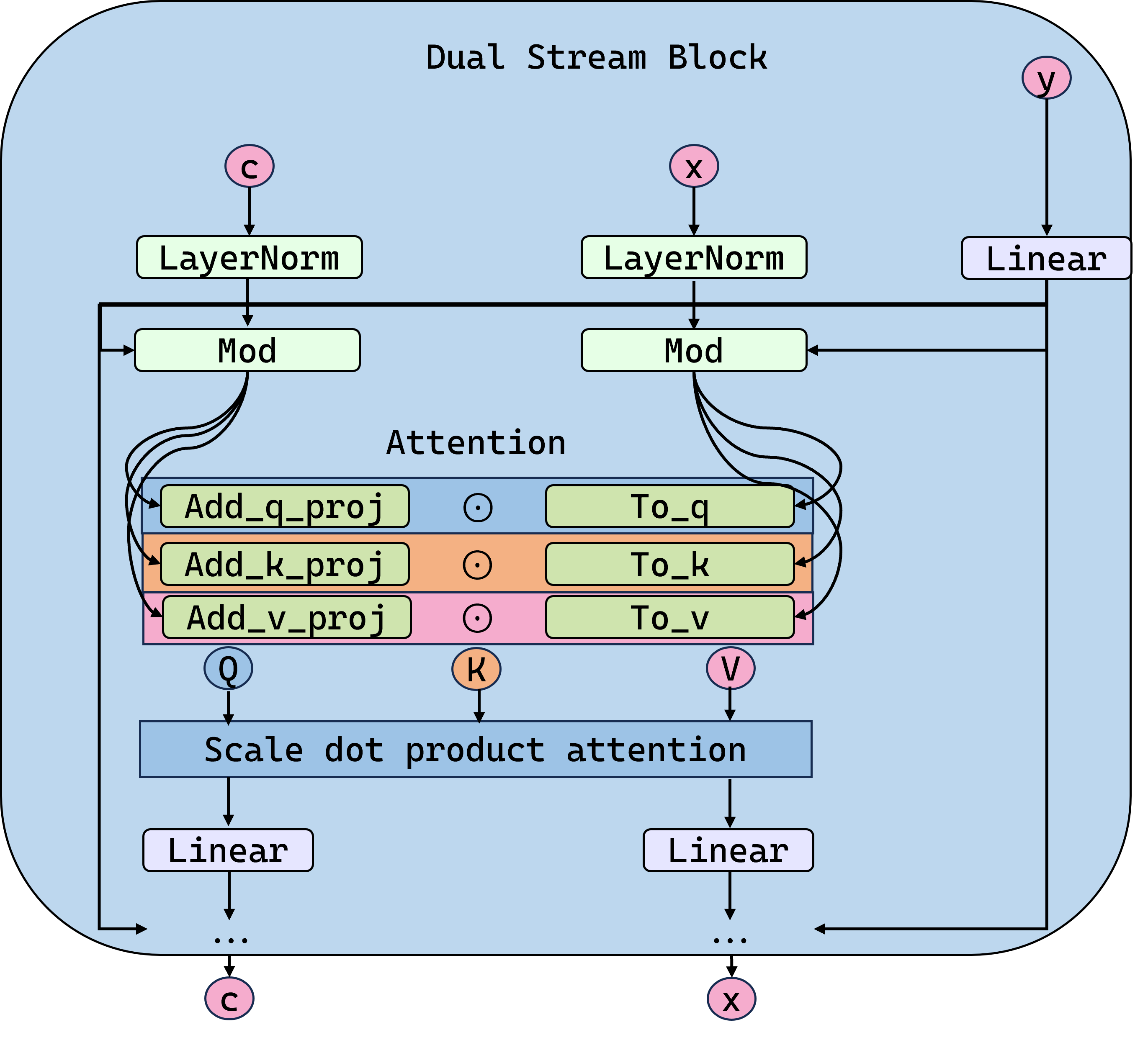

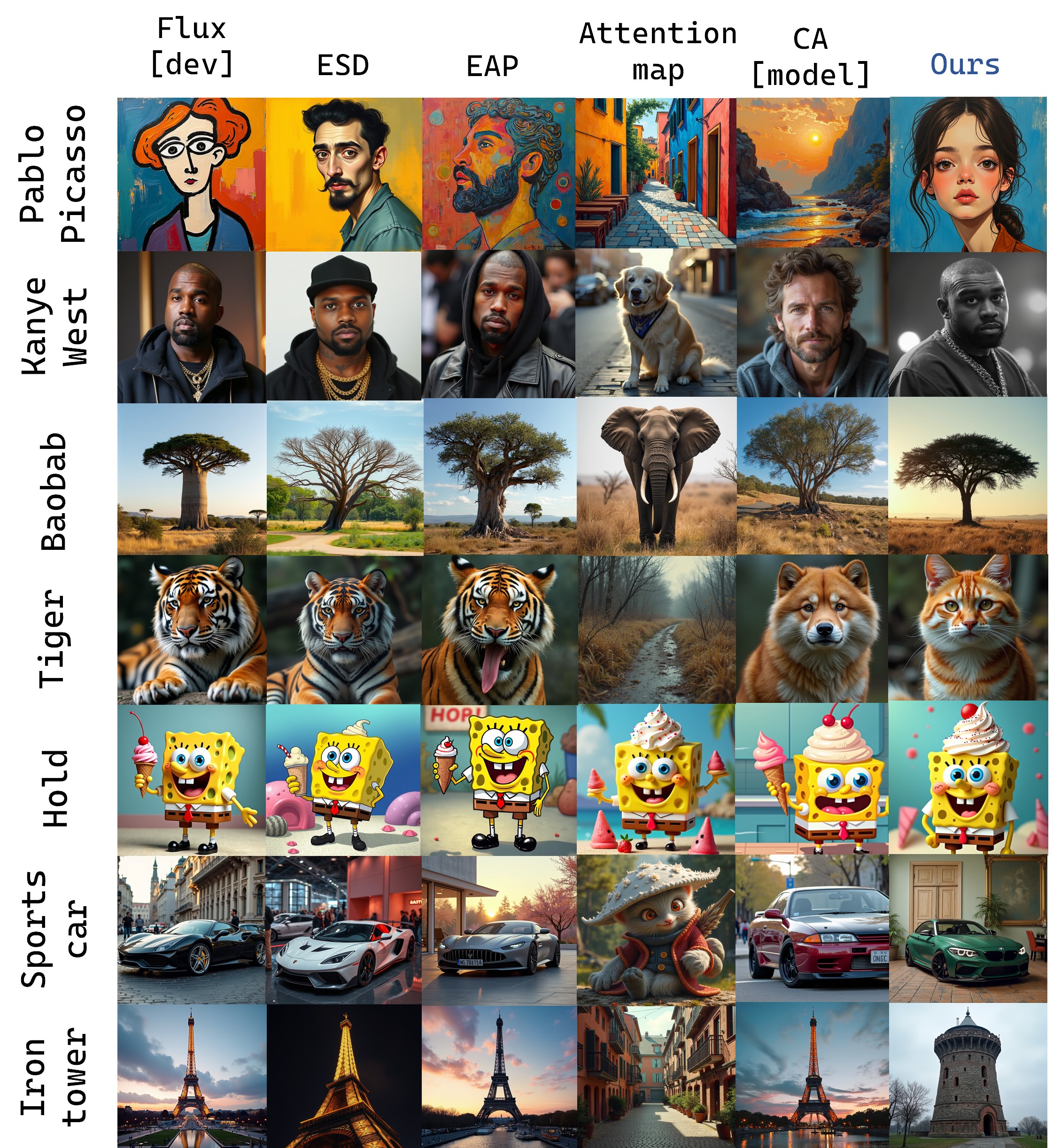

EraseAnything 是首个专为最新基于流的 T2I 框架设计的概念擦除方法。它将概念擦除建模为一个双层优化问题,利用基于 LoRA 的参数微调,并引入注意力图正则项以有选择地抑制不需要的激活。目前已被 ICLR 2025 接收。

论文名称:EraseAnything: Enabling Concept Erasure in Rectified Flow Transformers

论文链接:https://arxiv.org/abs/2412.20413

论文代码:https://github.com/tomguluson92/eraseanything

此外,EraseAnything还提出了一种自对比学习策略,以确保在移除不良概念的同时,不会意外损害模型对无关概念的表现。

实验结果表明,EraseAnything 成功弥补了此前方法在新 T2I 范式中的空白,在多个概念擦除任务中实现了当前最优性能(state-of-the-art)。

5月26日晚8点,青稞Talk 第51期,青稞社区联合创始人高岱恒, 将分享ICLR 2025最新成果《EraseAnything:在 Flux 等先进文生图架构的概念擦除方法》

主题提纲:

EraseAnything:在 Flux 等先进文生图架构的概念擦除方法

1、什么是 AIGC 的概念擦除

2、概念擦除的难点和特点

3、生成模型从 SD 迭代到 Flux 后,概念擦除失效

4、EraseAnything 的做法和效果展现

直播时间

5月26日20:00 - 21:00

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?