时间序列bp自回归神经网络预测matlab程序代码 ,含最佳 自回归阶数和最佳隐层节点数的确定。

ID:31200644372379560

卡酷星幸福的鱿鱼

时间序列预测一直是数据分析与机器学习领域的热门研究方向之一。其中,自回归神经网络(Autoregressive Neural Network, ARNN)作为一种基于神经网络的时间序列预测方法,具有较好的性能和广泛的应用。本文将介绍如何用MATLAB编写自回归神经网络的时间序列预测程序,并探究如何确定最佳的自回归阶数和隐层节点数。

首先,为了实现时间序列预测,我们需要先了解时间序列的基本概念和特性。时间序列是指按时间顺序排列的一系列数据点的集合,通常用于描述某个变量随时间的变化情况。在时间序列预测中,我们希望根据已有的历史数据,预测未来的数据趋势。自回归神经网络作为一种非线性的时间序列预测模型,能够捕捉时间序列的非线性关系和动态演化规律,因此被广泛应用于时间序列预测任务中。

在MATLAB中,我们可以使用神经网络工具箱(Neural Network Toolbox)来实现自回归神经网络。首先,我们需要准备用于训练和测试的时间序列数据。通常,我们将时间序列数据按照一定的时间窗口大小进行分割,将每个时间窗口作为一个样本输入到神经网络中。然后,我们可以使用MATLAB提供的样本划分函数将数据集划分为训练集和测试集。

接下来,我们需要确定自回归神经网络的最佳自回归阶数和隐层节点数。自回归阶数是指模型在预测当前样本时所考虑的历史数据的时间步长。一般来说,自回归阶数越大,模型能够捕捉的时间序列的长期依赖关系就越多。然而,自回归阶数过大可能会导致模型过于复杂,容易过拟合。隐层节点数是指模型隐层神经元的数量,它决定了模型的复杂度和表示能力。一般来说,隐层节点数应根据具体问题进行调整,可以通过试验和验证来确定最佳值。

为了确定最佳自回归阶数和隐层节点数,我们可以采用交叉验证的方法。具体而言,我们将训练集进一步划分为训练子集和验证子集,在不同的自回归阶数和隐层节点数下,分别训练模型并计算在验证子集上的预测误差。根据预测误差的大小,我们可以选取最佳的自回归阶数和隐层节点数作为模型的参数。

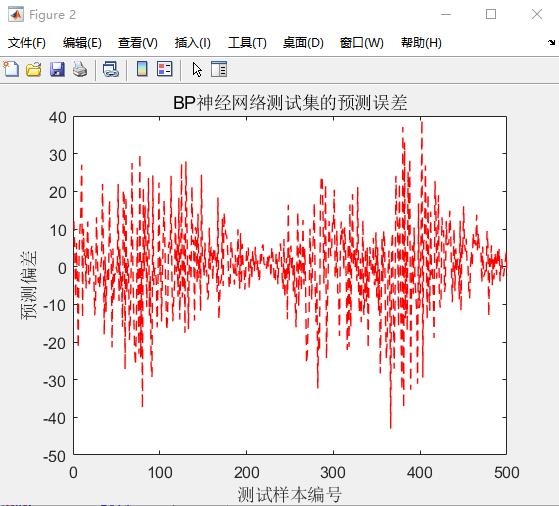

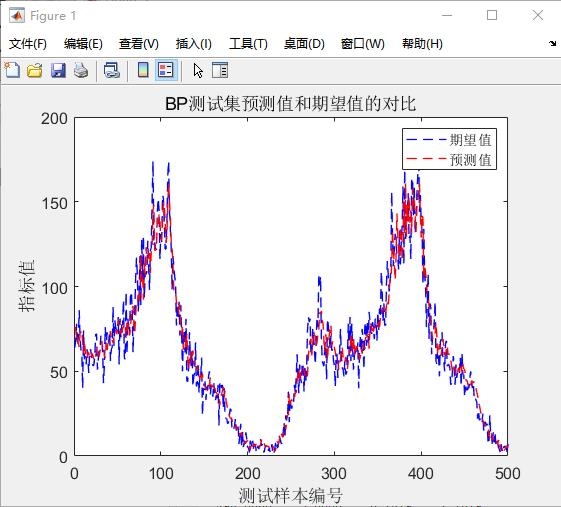

最后,我们可以使用确定好的自回归阶数和隐层节点数,对测试集进行预测并评估预测性能。通常,我们可以使用均方根误差(Root Mean Squared Error, RMSE)和平均绝对百分比误差(Mean Absolute Percentage Error, MAPE)等指标来评估预测模型的准确性和稳定性。

总之,本文主要介绍了如何用MATLAB编写自回归神经网络的时间序列预测程序,并探究了最佳的自回归阶数和隐层节点数的确定方法。通过对时间序列数据的分析和建模,结合神经网络的学习和预测能力,我们可以实现对时间序列的准确预测。这为实际应用中的数据分析和决策提供了有力的支持和指导。

相关的代码,程序地址如下:http://imgcs.cn/644372379560.html

142

142

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?