1. 准备工作

1.1 Linux基础指令

cd //进入目录

vi //文本编辑模式

进入文本编辑模式后按i,编辑文本

esc //退出文本编辑模式

:wq //保存退出

:q! //强制退出

dd //删除一行

G //跳到段尾

ls //查看文件夹内容

# //注解

注:在xshell中不能用CTRL+C/V复制粘贴,只能够选择文本鼠标右击选择复制/粘贴

1.2 软件及文件

- VMware Workstation15.5

- CentOS7

- JDK1.8.0(Linux)

- Hadoop

- Xshell

- Xftp

2. 安装及配置CentOS 7

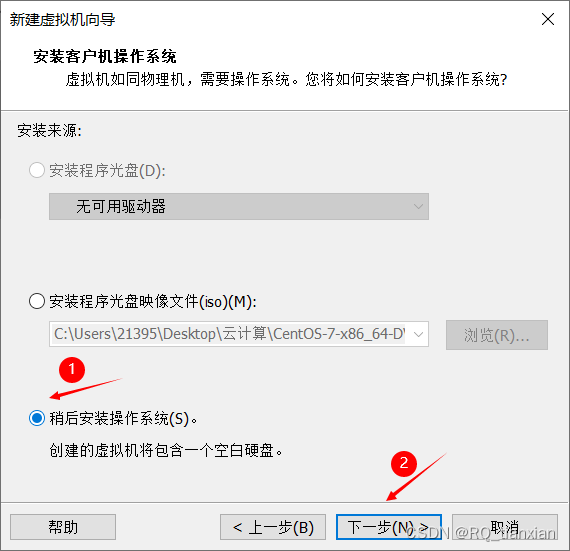

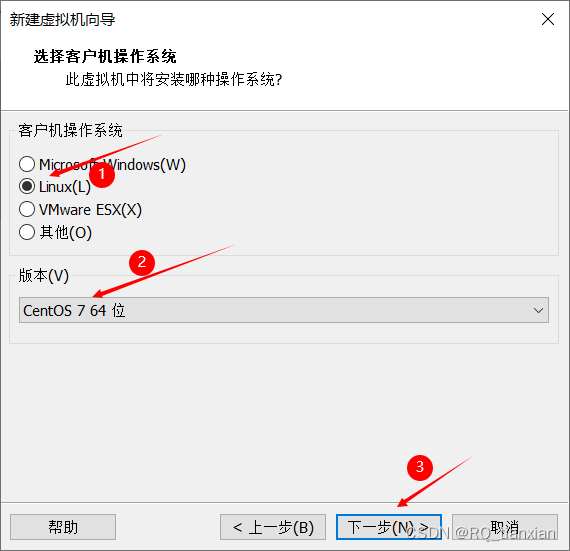

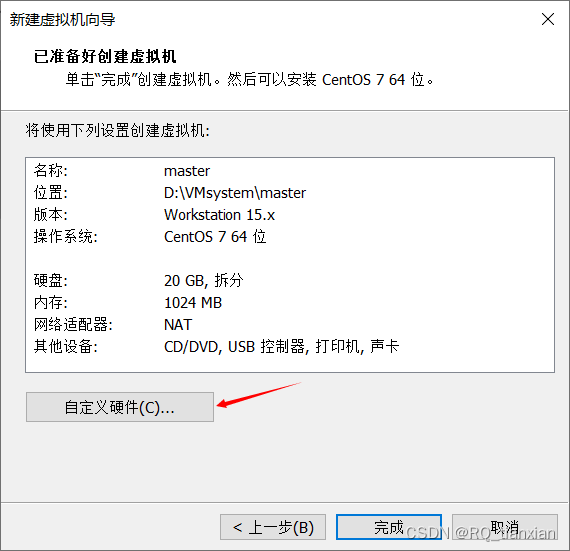

2.1 创建虚拟机

- 没有标注来的步骤默认点击下一步

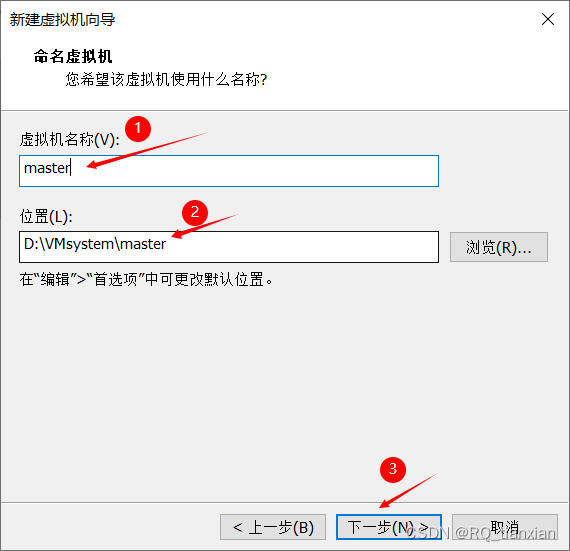

2.1.1 将虚拟机命名为master,存放到一个自定义文件夹内

2.1.2 选择网络类型

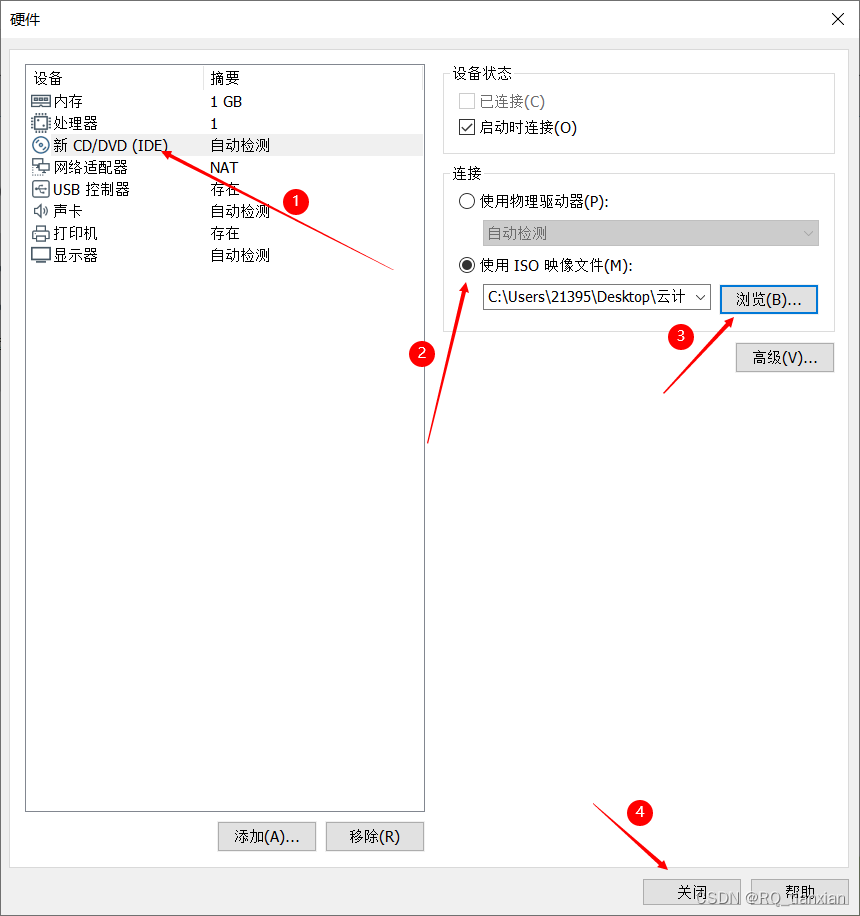

2.1.3 导入CentOS 7镜像文件

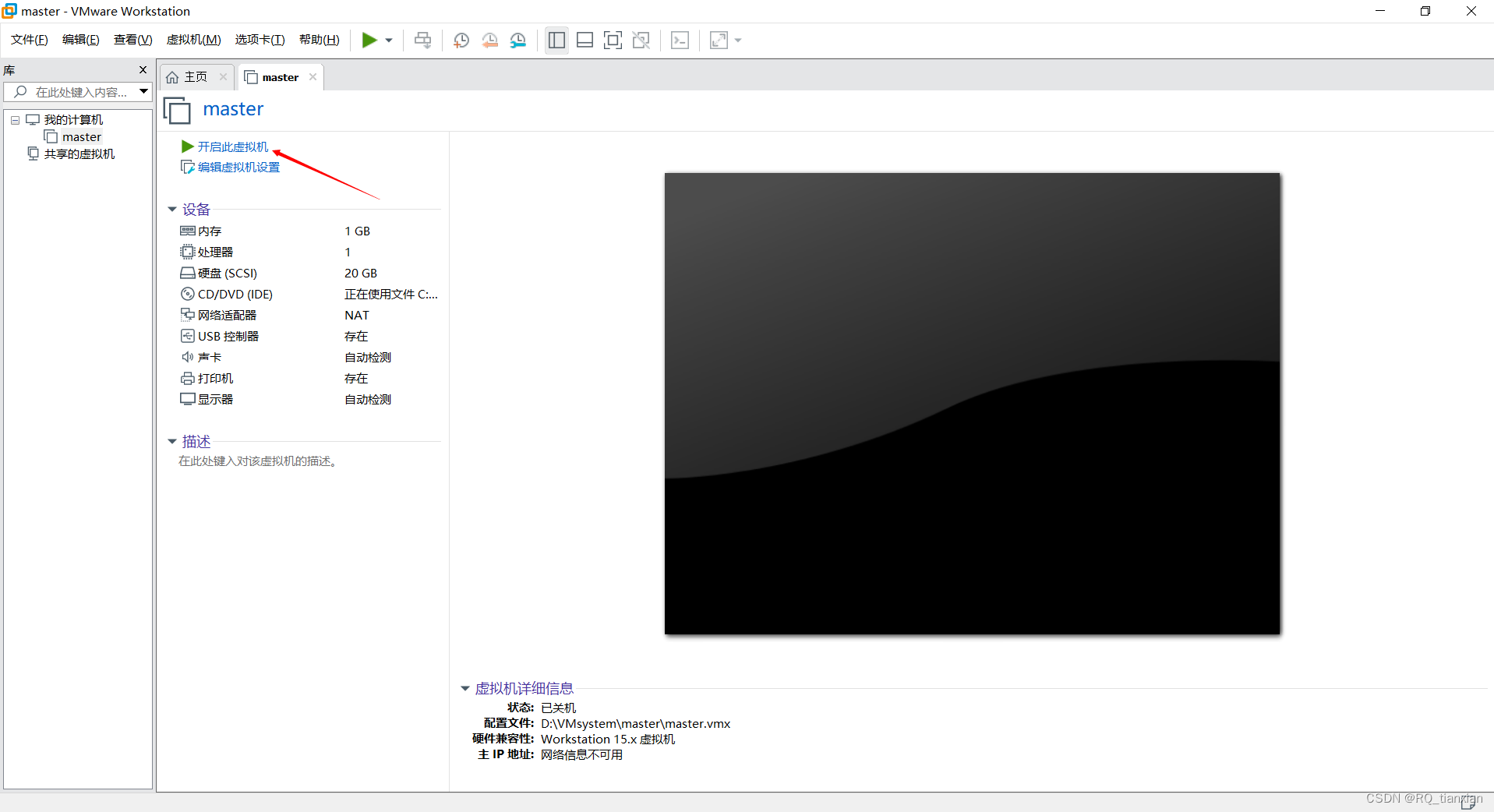

2.1.4 打开虚拟机

2.2 CentOS 7的安装

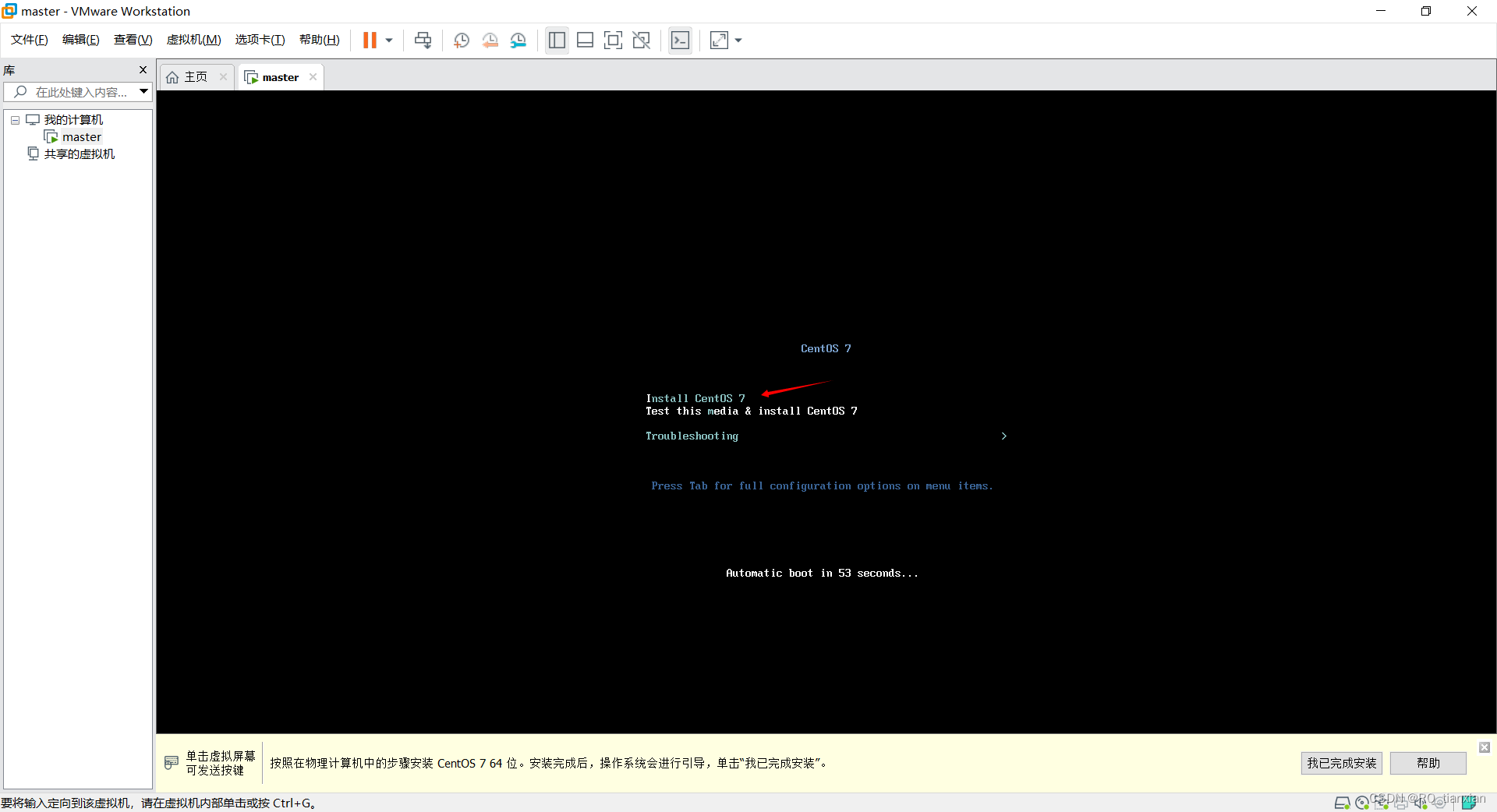

2.2.1 选择install CentOS 7

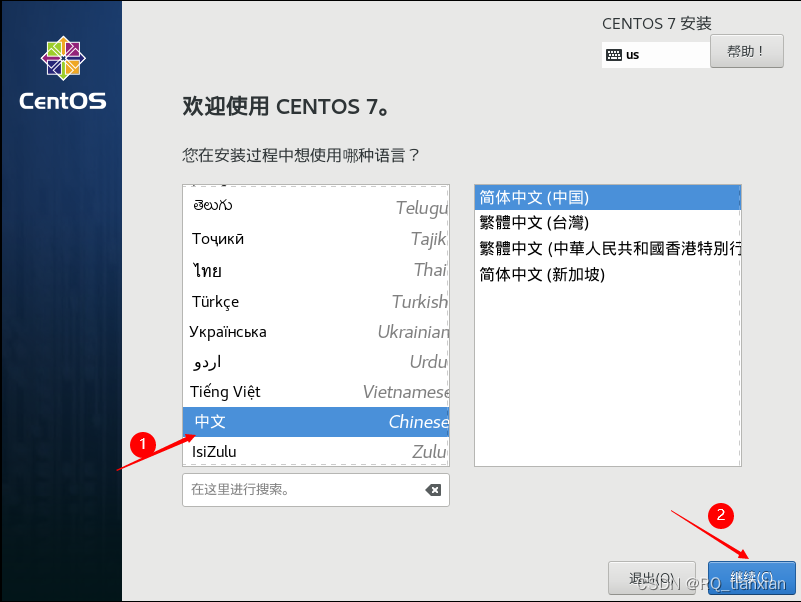

2.2.2 选择中文

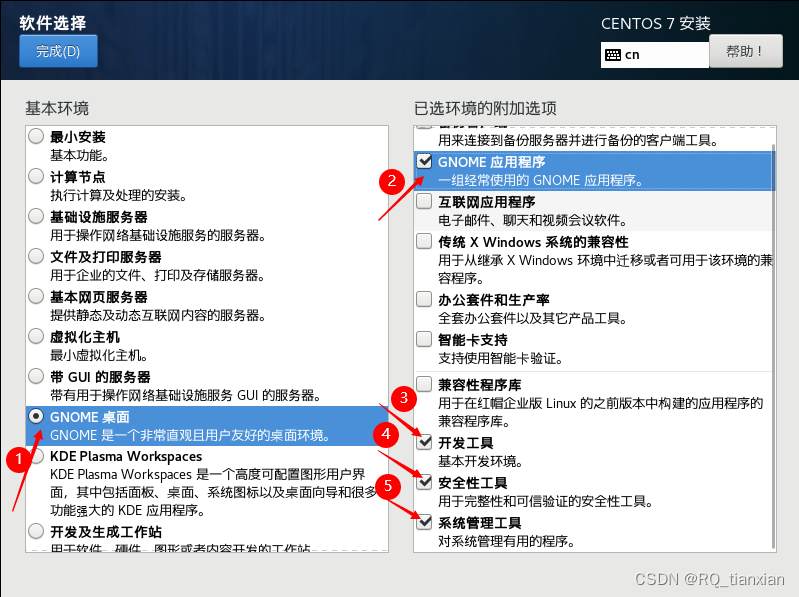

2.2.3 软件选择

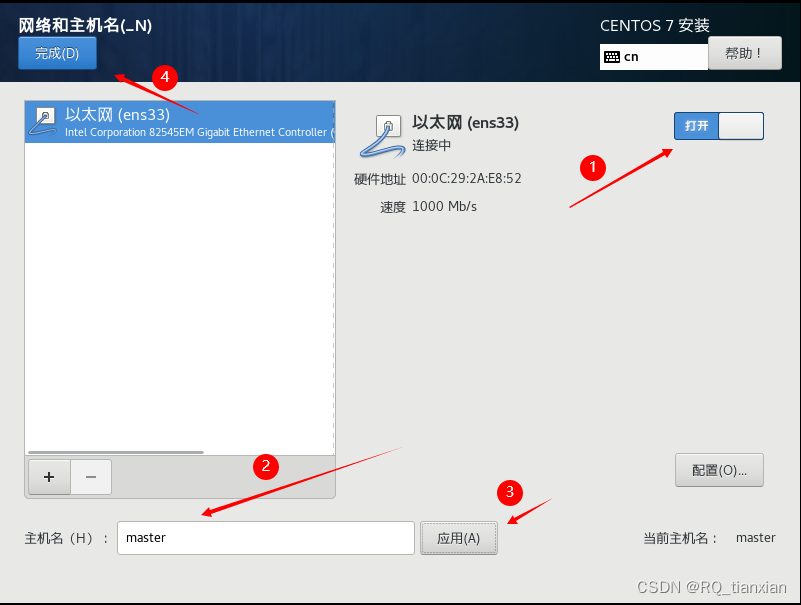

2.2.4 设置网络与主机名

- 点击安装位置,点击完成

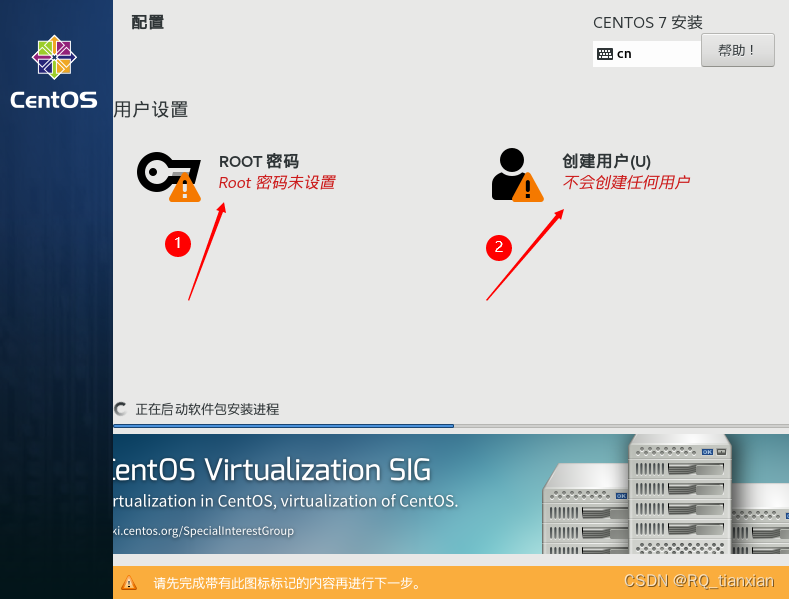

2.2.5 开始安装

2.2.6 创建用户

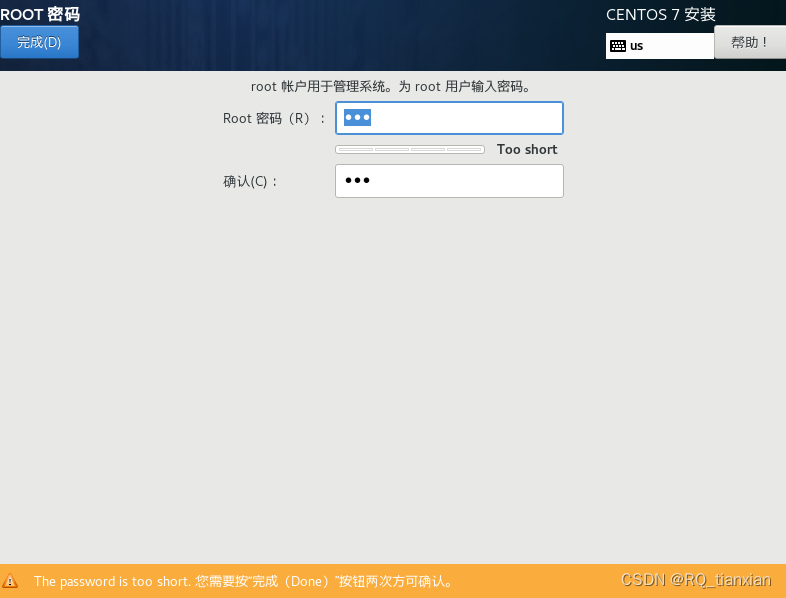

- 设置root密码,由于是教学,只设置简单的123,实际开发要一定要设置超级复杂的密码

- 创建普通用户

- 安装需要一段较长的时间

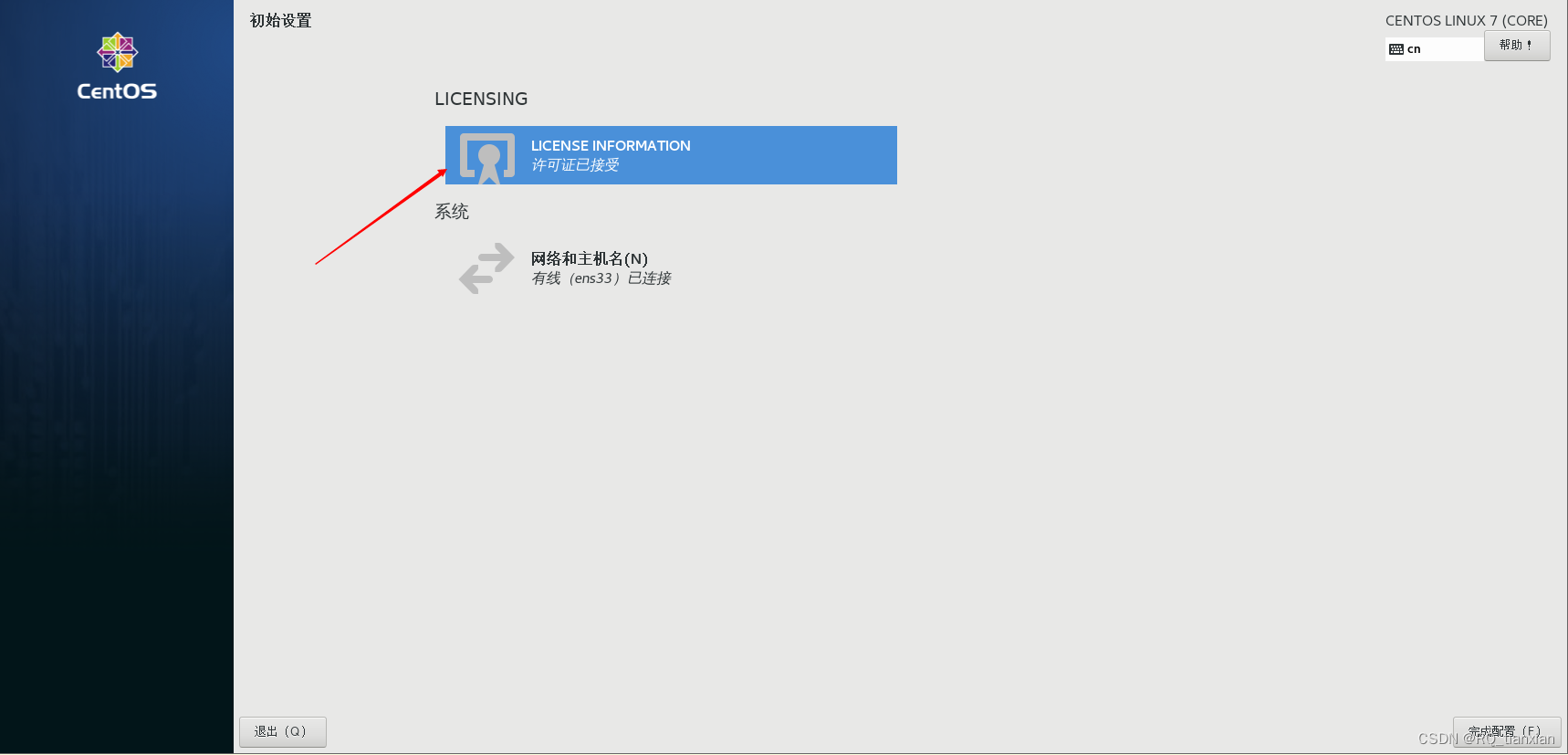

- 安装完成重启,会弹出许可证,点击同意

2.2.7 登录root用户

- 点击未列出

- 用户名为:root

2.3 CentOS 7的配置

2.3.1 先拍一张快照

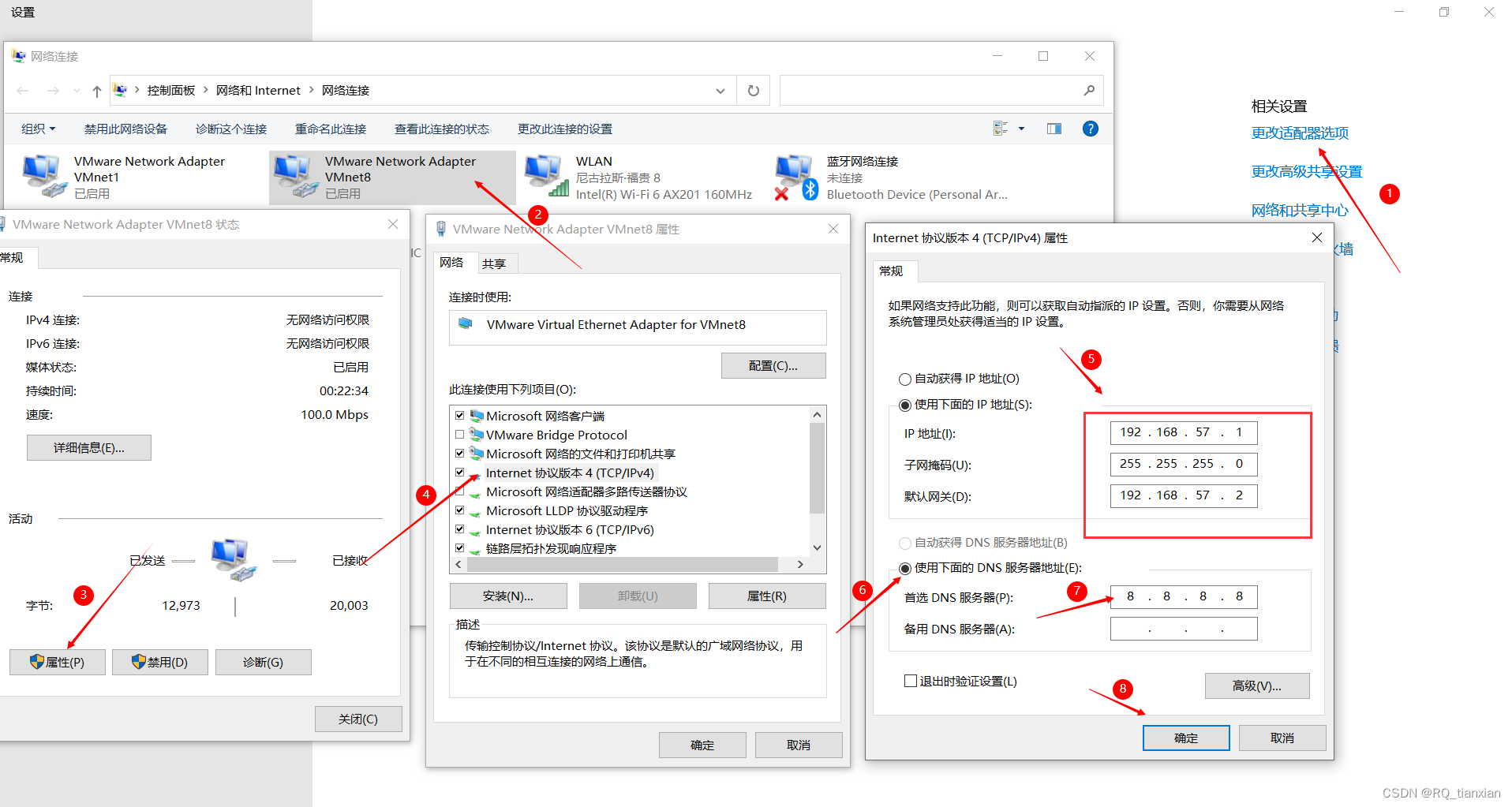

2.3.2 查看电脑的网络配置

- 按住 Win+i 快捷进入设置,在搜索栏搜索 以太网设置

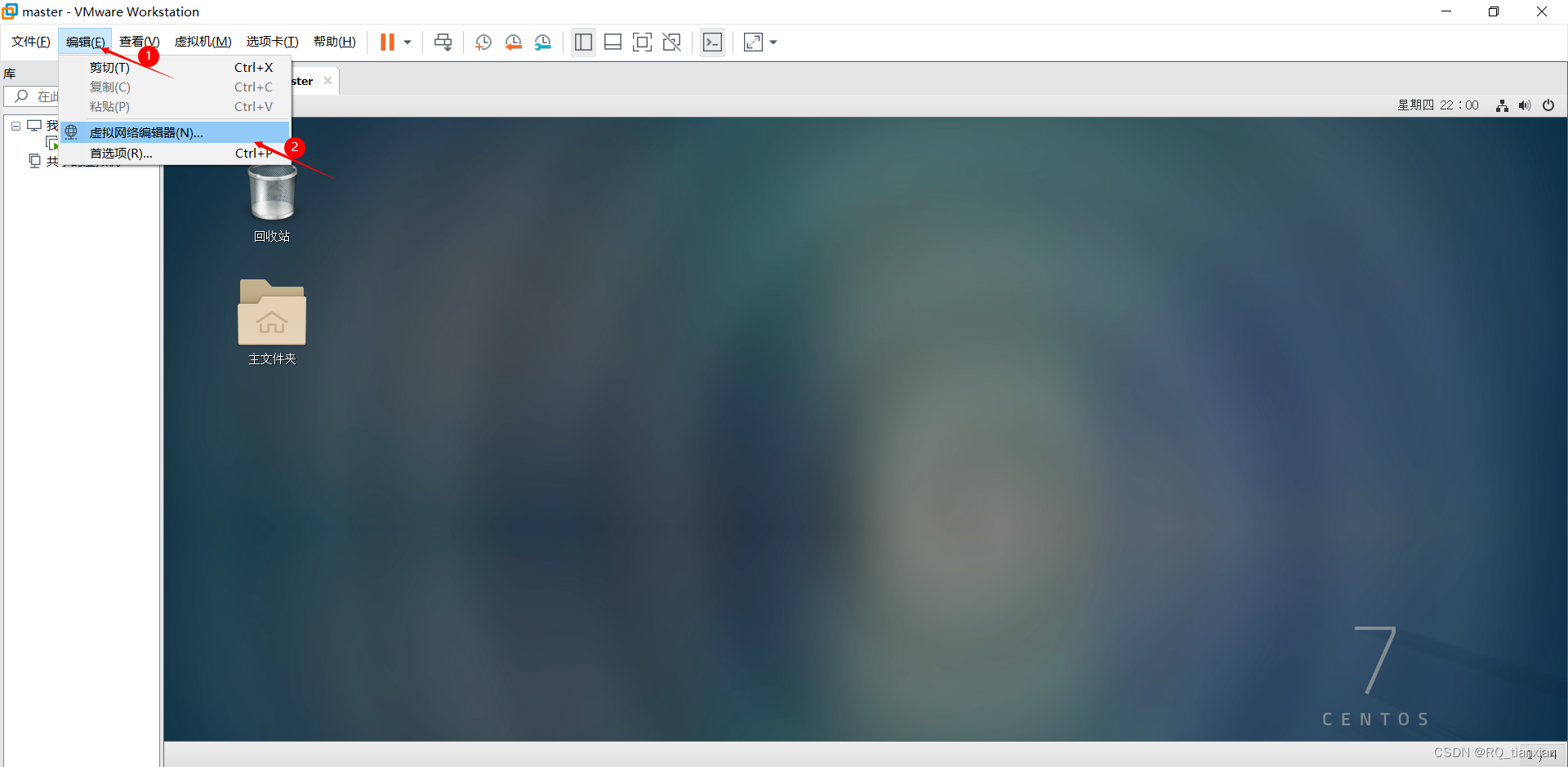

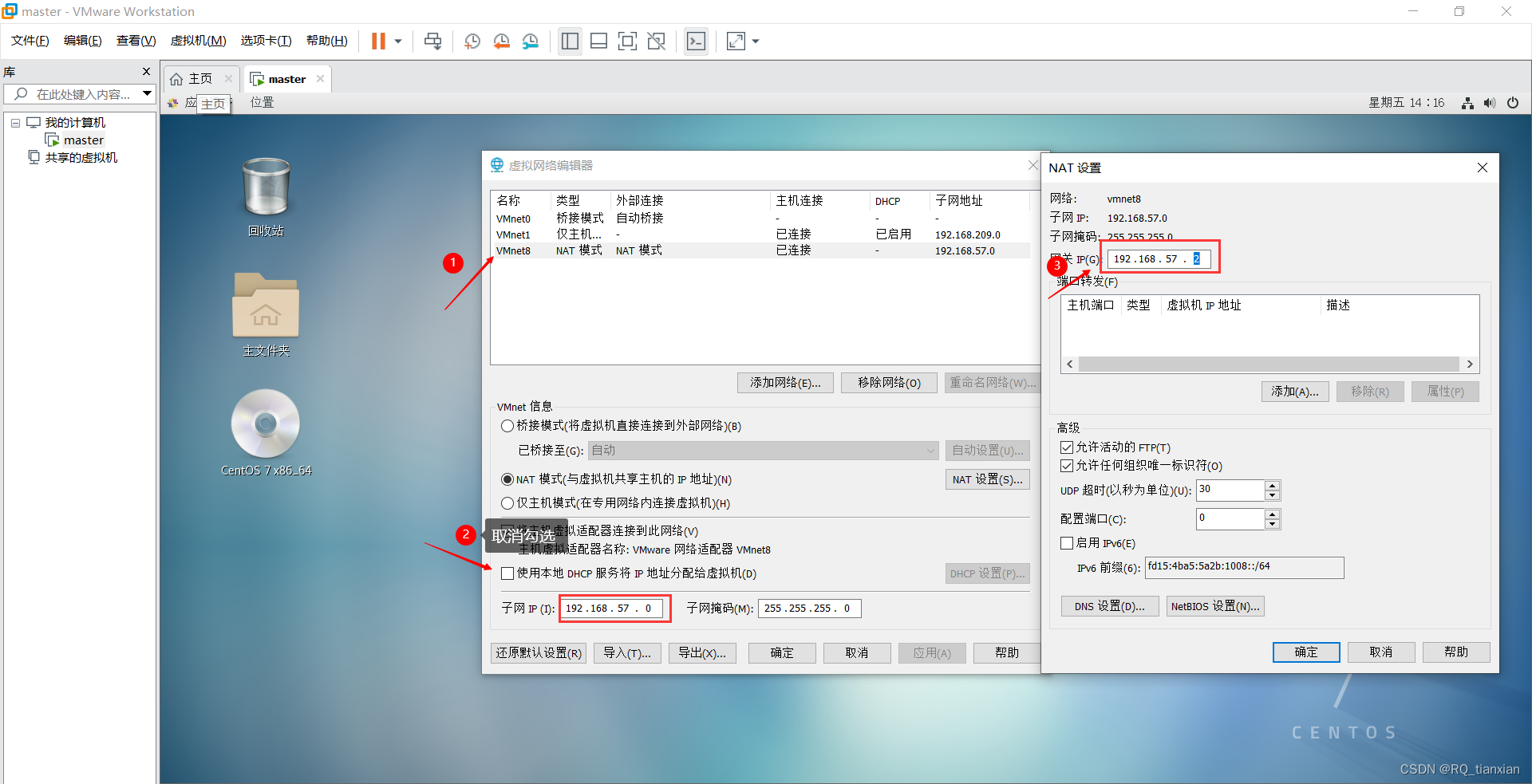

2.3.3 更改虚拟机网络配置

- 确保与电脑的IP地址相同

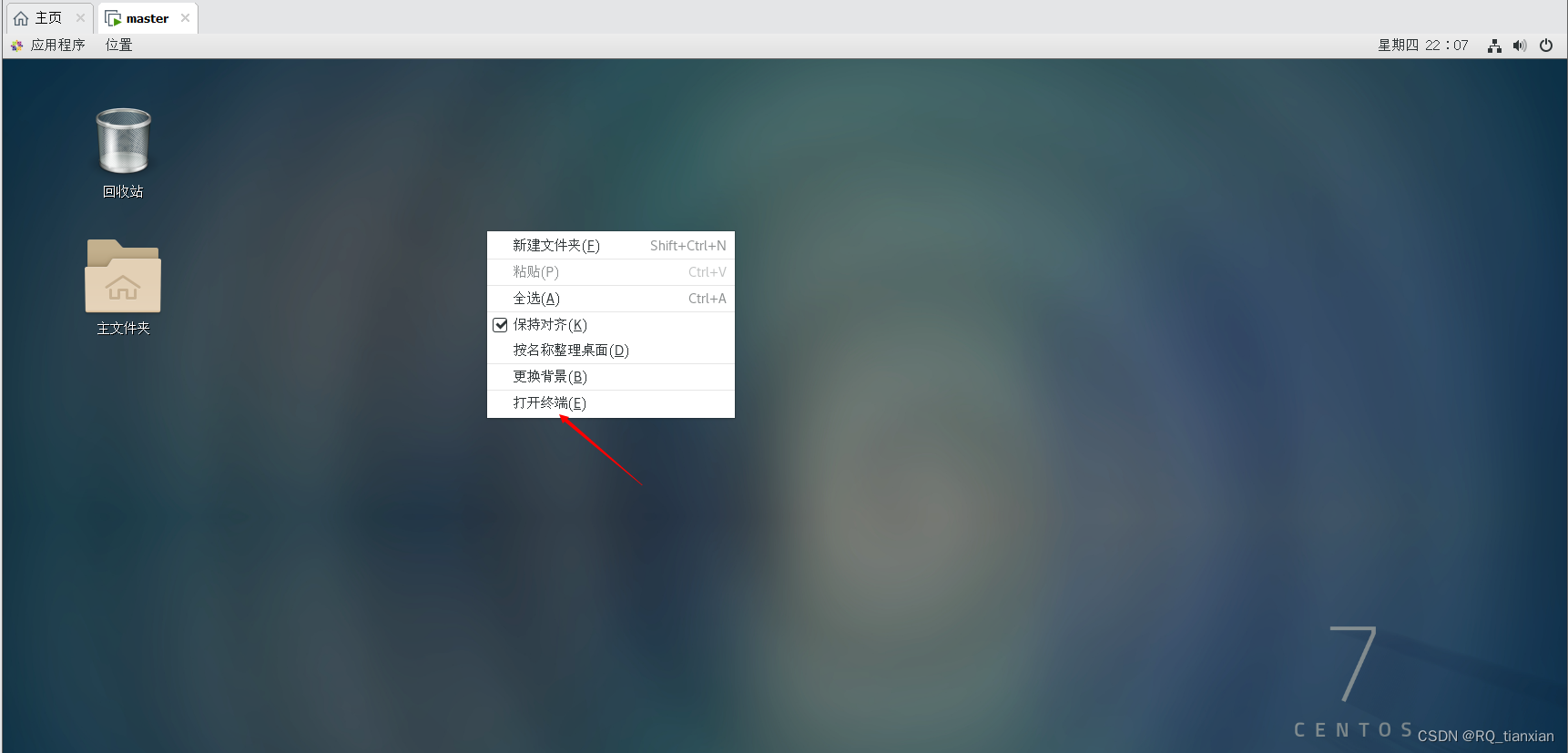

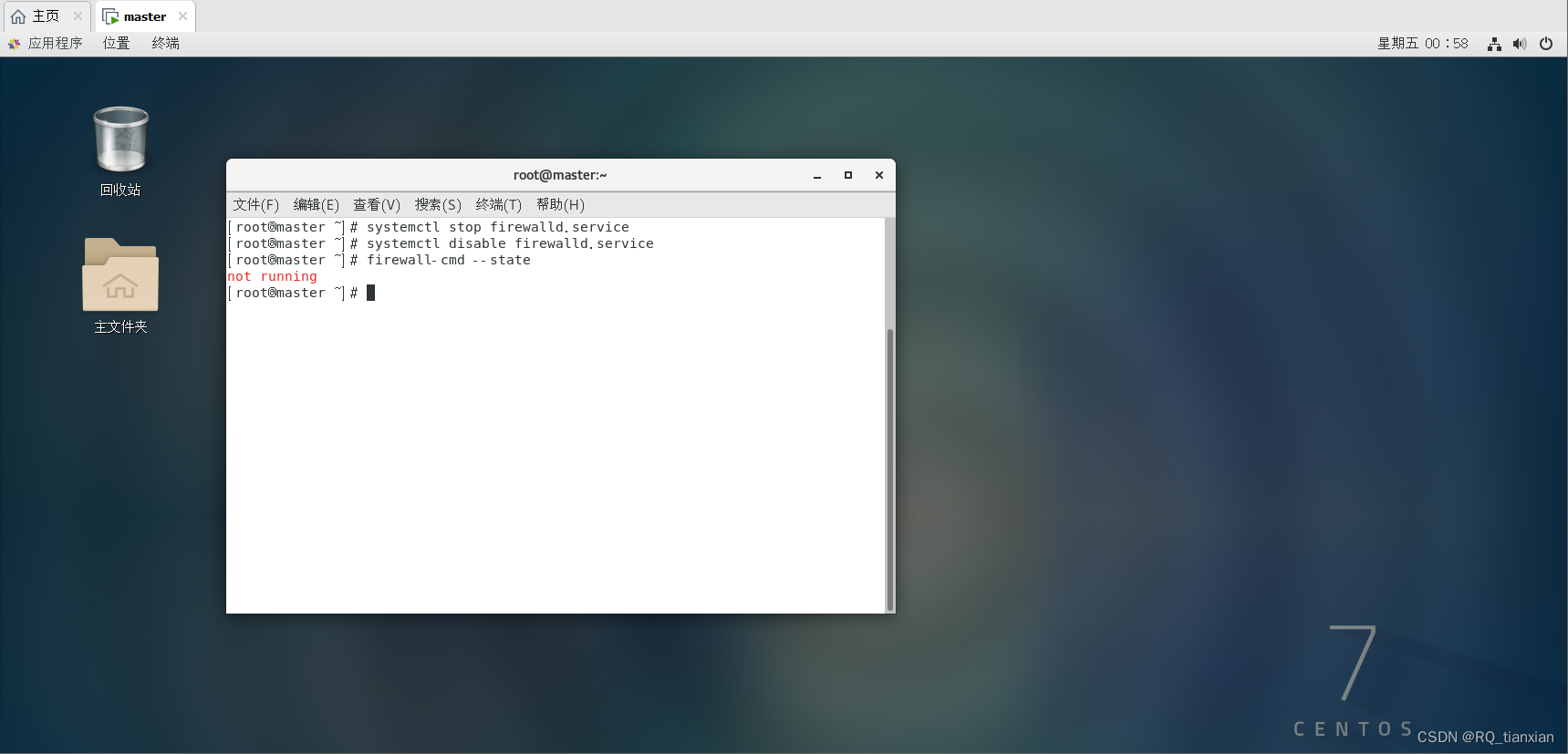

2.3.4 关闭防火墙

- 打开终端

- 依次输入指令

systemctl stop firewalld.service //当前禁用防火墙

systemctl disable firewalld.service //永久禁用防火墙

firewall-cmd --state //查看防火墙状态

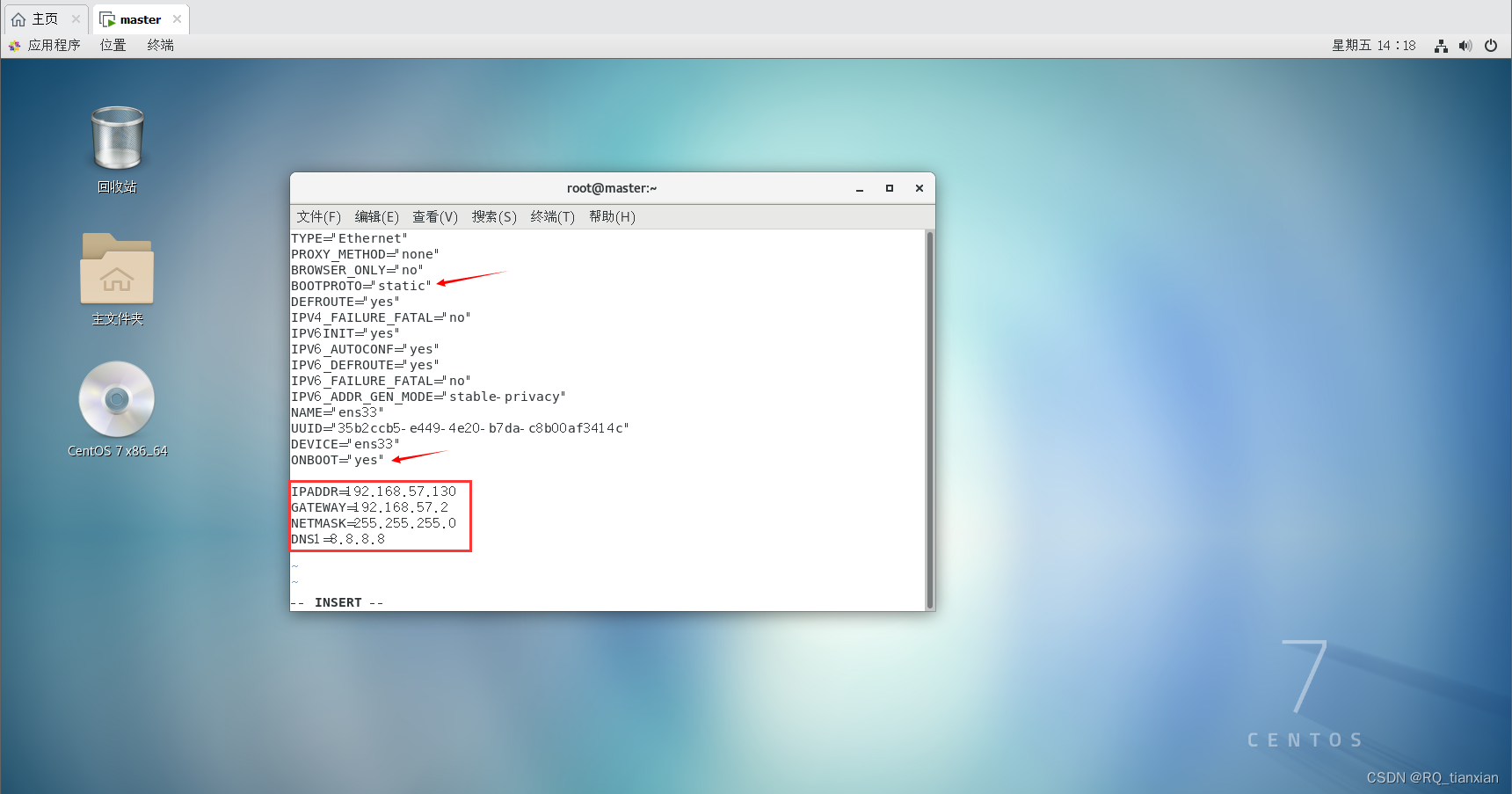

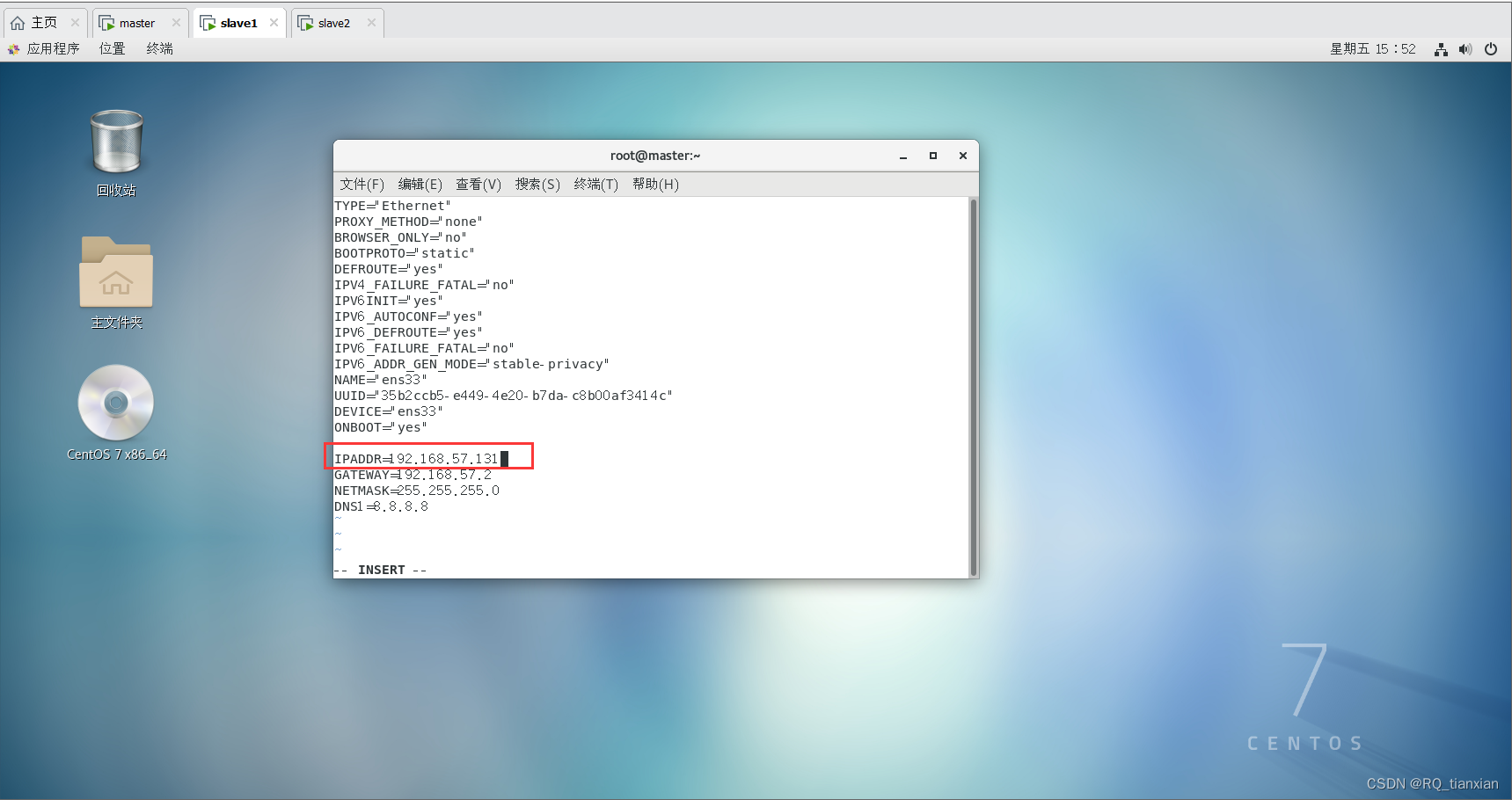

2.3.5 设置固定IP

- 修改配置文件

vi /etc/sysconfig/network-scripts/ifcfg-ens33

- 根据自己IP地址修改,一般是第三组(57)数字需要修改

- NETMASK和DNS1不需要修改

IPADDR=192.168.57.130

GATEWAY=192.168.57.2

NETMASK=255.255.255.0

DNS1=8.8.8.8

- 修改后图示

- 重启网卡服务

service network restart

- 查看ip

ip addr

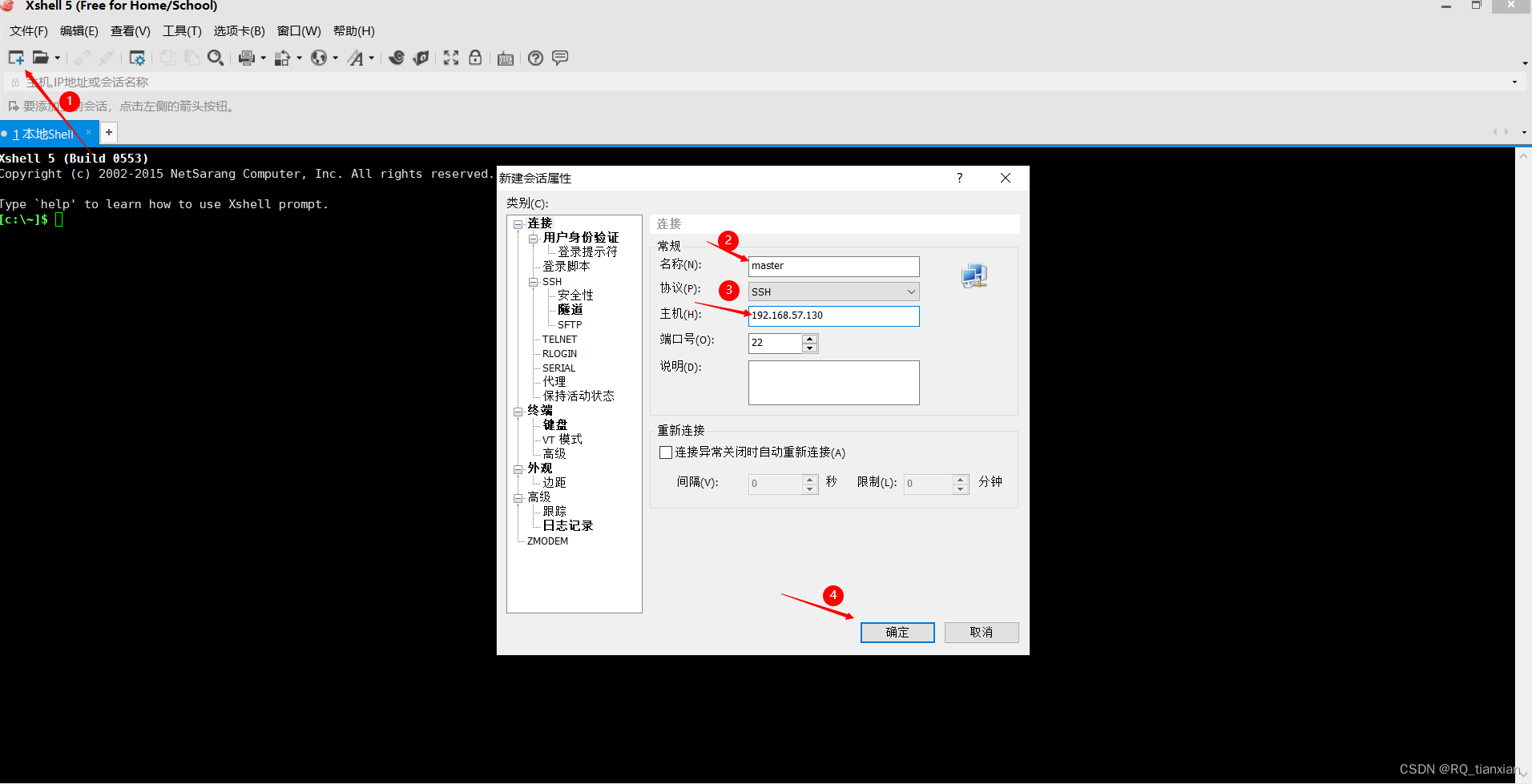

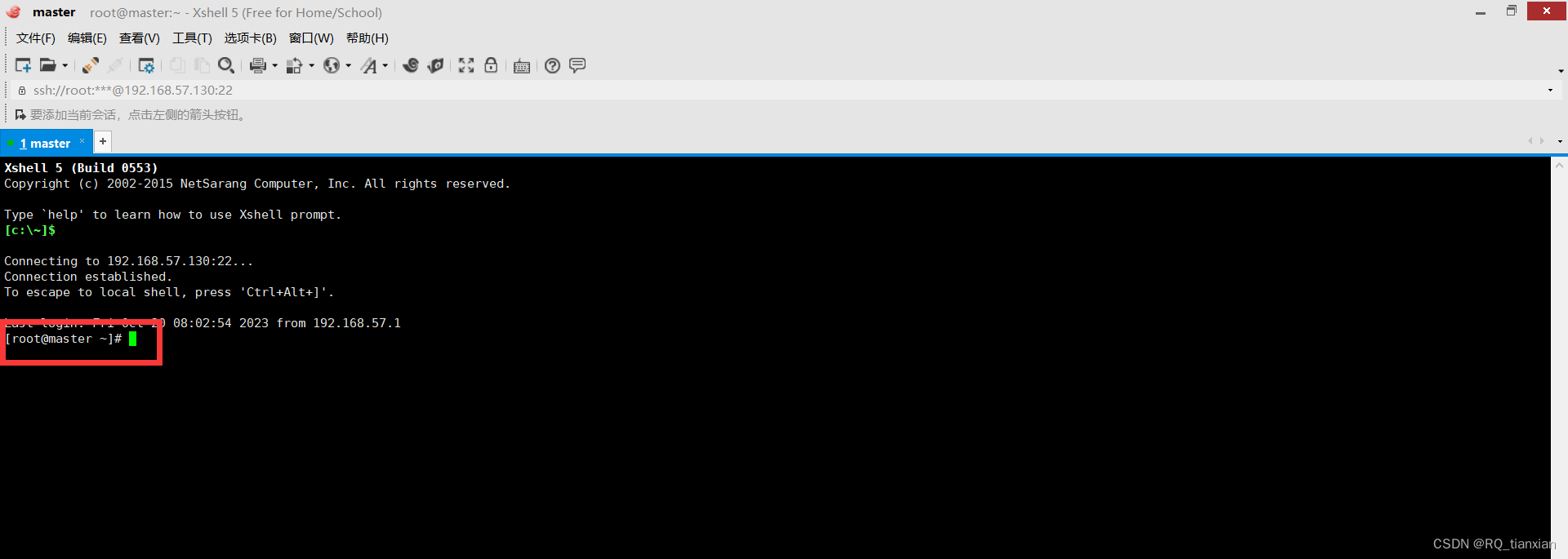

2.4 Xshell配置

2.4.1 Xshell连接虚拟机

2.4.2 安装常用软件

yum install -y vim zip openssh-server openssh-clients

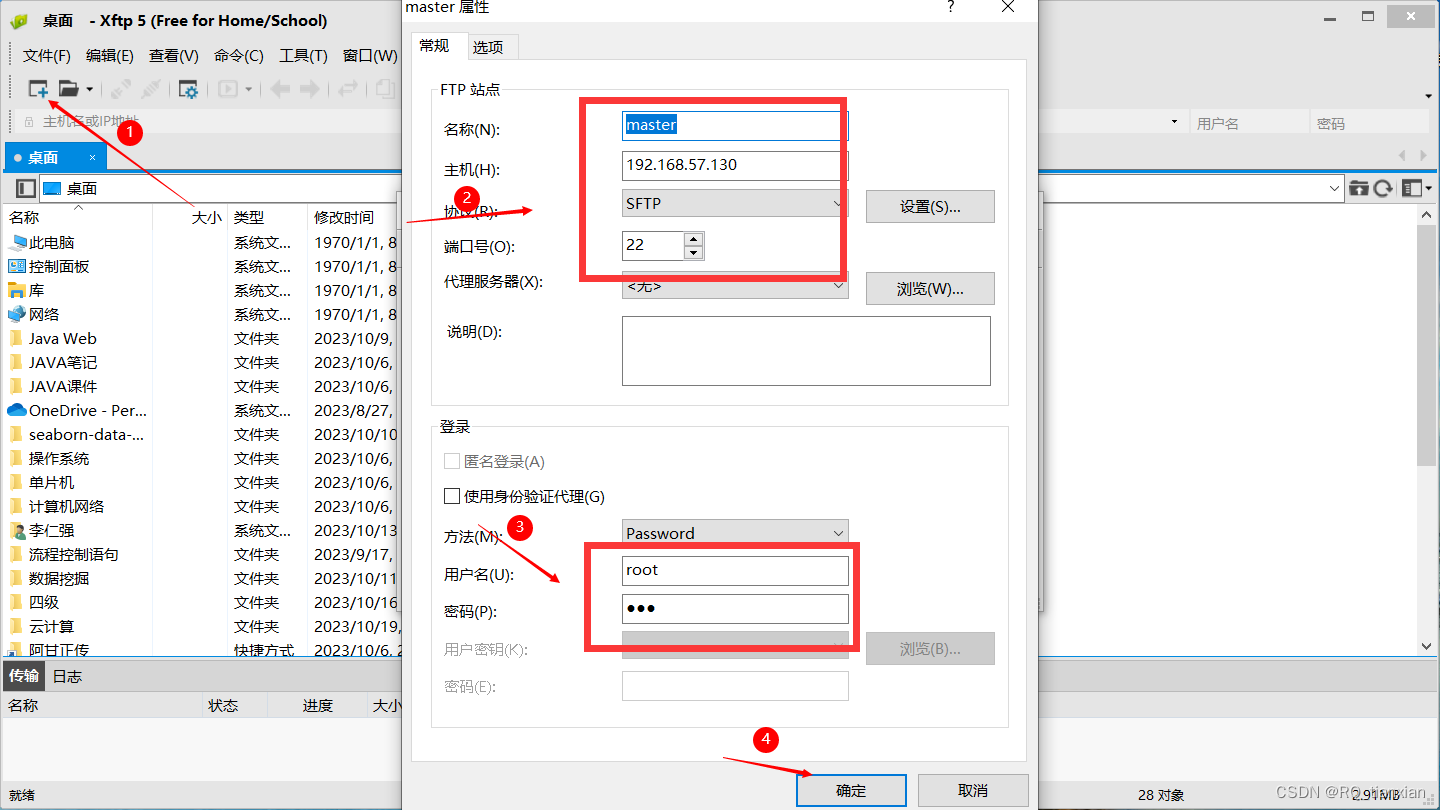

2.5 用Xfpt传送jdk和Hadoop文件

2.5.1 建立连接

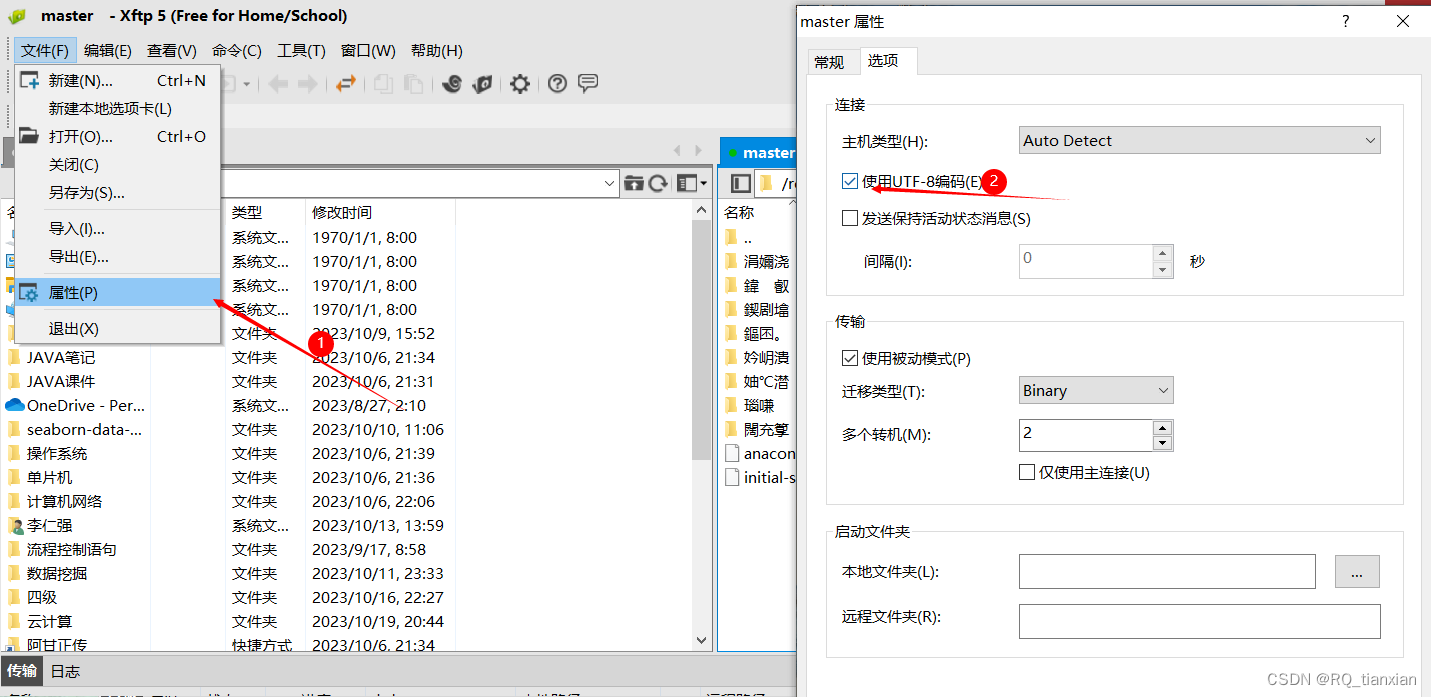

2.5.2 解决乱码问题

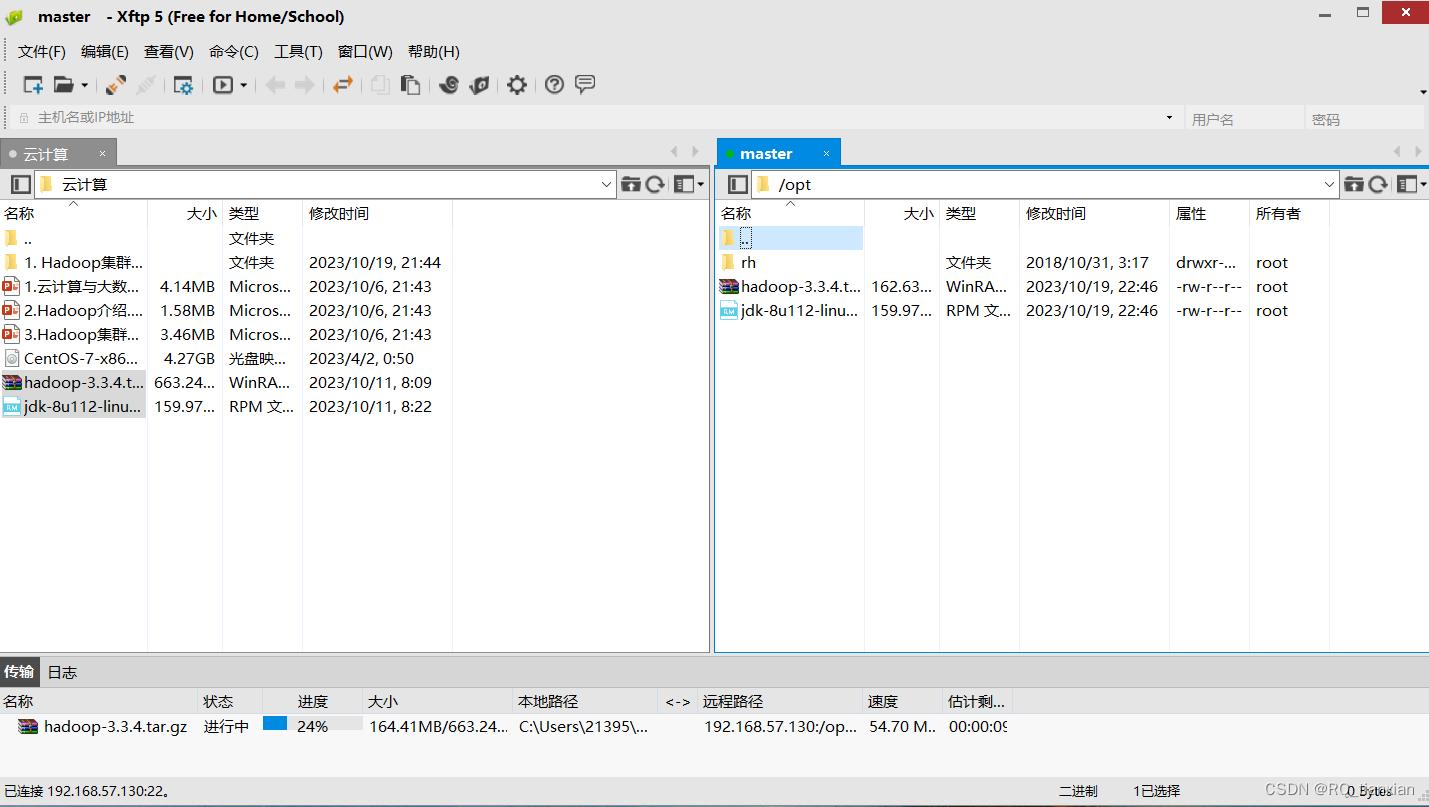

2.5.3 将文件传入虚拟机内

- 位置:/opt

2.6 安装Java

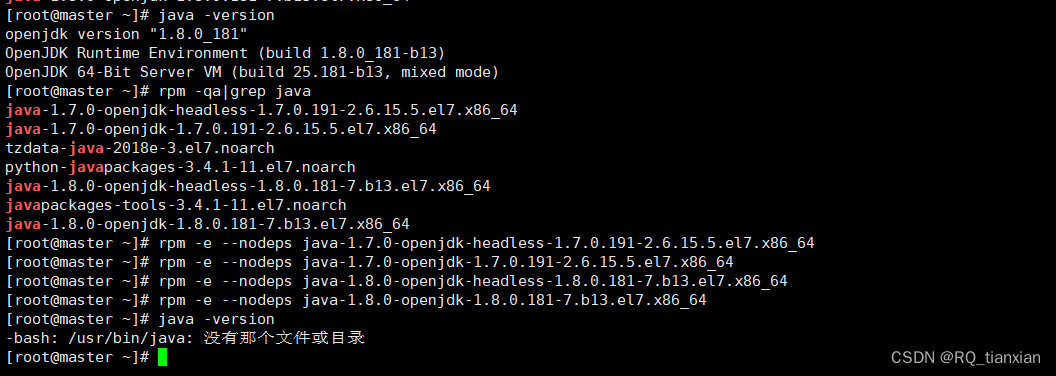

2.6.1 删除CentOS 7自带的openjdk

- 查看java安装软件

rpm -qa|grep java

- 卸载openjdk,一定要删干净(CAO)

rpm -e --nodeps

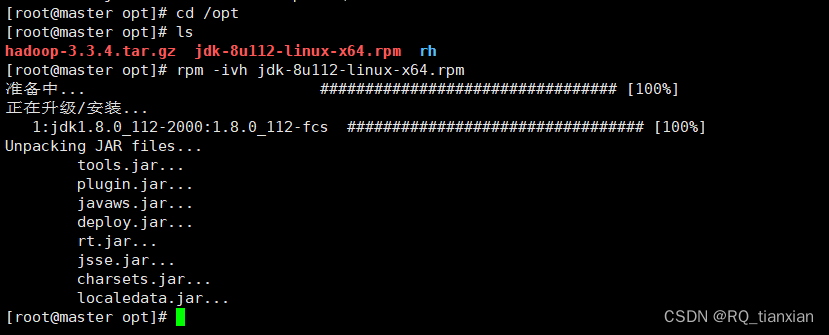

2.6.2 安装jdk1.8.0

- 进入 /opt 目录

cd /opt

- 输入指令安装

rpm -ivh jdk-8u112-linux-x64.rpm

- 改名(方便一点)

cd /usr/java

mv jdk1.8.0_112 jdk1.8.0

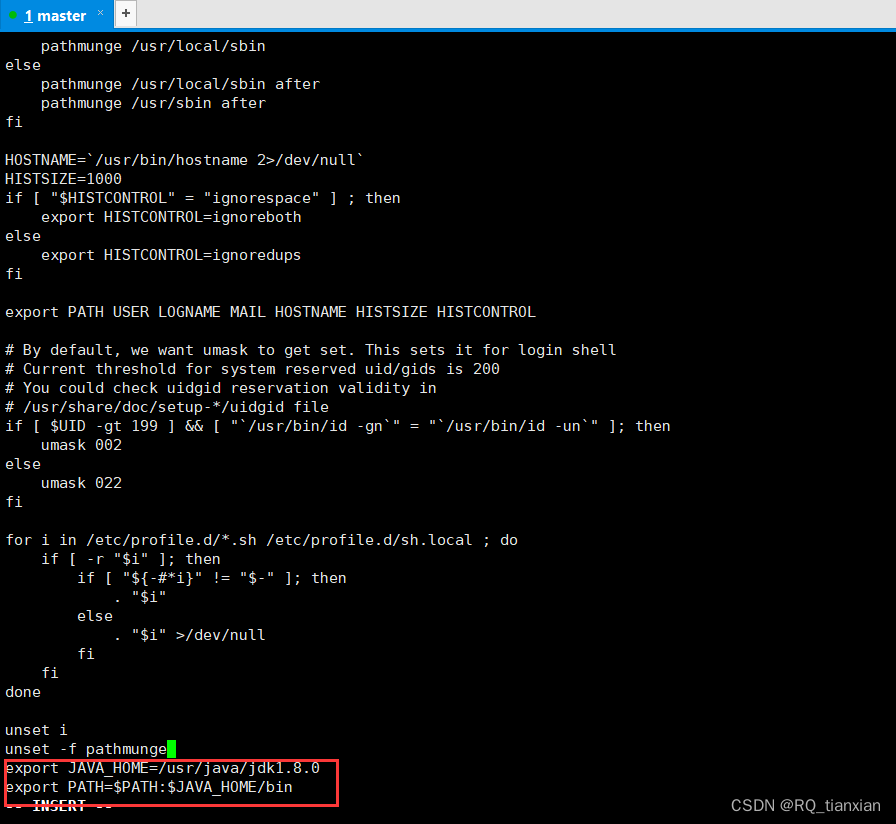

2.6.3 配置环境变量

- 进入编辑文件

vi /etc/profile

- 在尾行加入代码

export JAVA_HOME=/usr/java/jdk1.8.0

export PATH=$PATH:$JAVA_HOME/bin

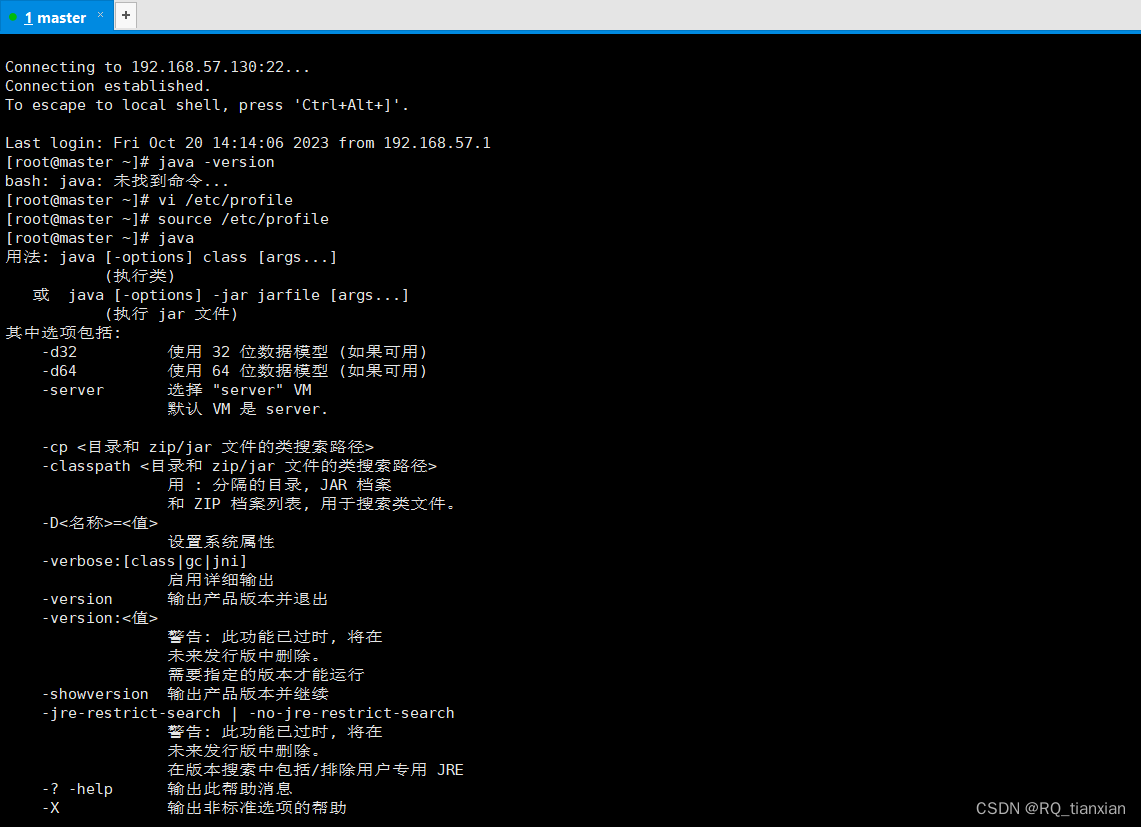

- 更新配置文件

source /etc/profile

3. Hadoop集群搭建

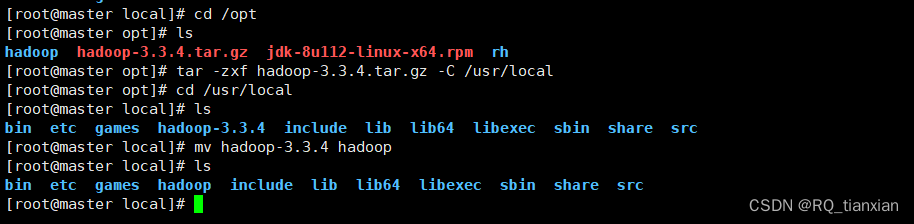

3.1 解压Hadoop

- 进入目标文件

cd /opt

- 解压到 /usr/local

tar -zxf hadoop-3.3.4.tar.gz -C /usr/local

- 改名(老师说她比较习惯改成这个,然后习惯继承)

cd /usr/local

mv hadoop-3.3.4 hadoop

- 解压的时候没有显示,稍等一会儿就行

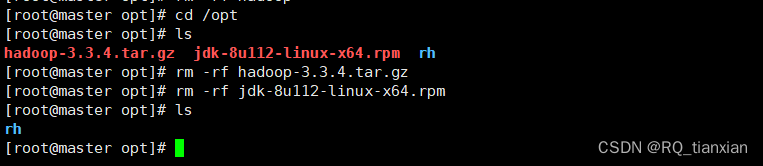

- 删除java和hadoop安装包

cd /opt

rm -rf hadoop-3.3.4.tar.gz

rm -rf jdk-8u112-linux-x64.rpm

3.2 修改配置文件

- 文件目录(要把目录写清楚,是第二个hadoop)

cd /usr/local/hadoop/etc/hadoop

- 修改文件(7个)

core-site.xml、hadoop-env.sh、yarn-env.sh、mapred-site.xml、yarn-site.xml、workers、hdfs-site.xml

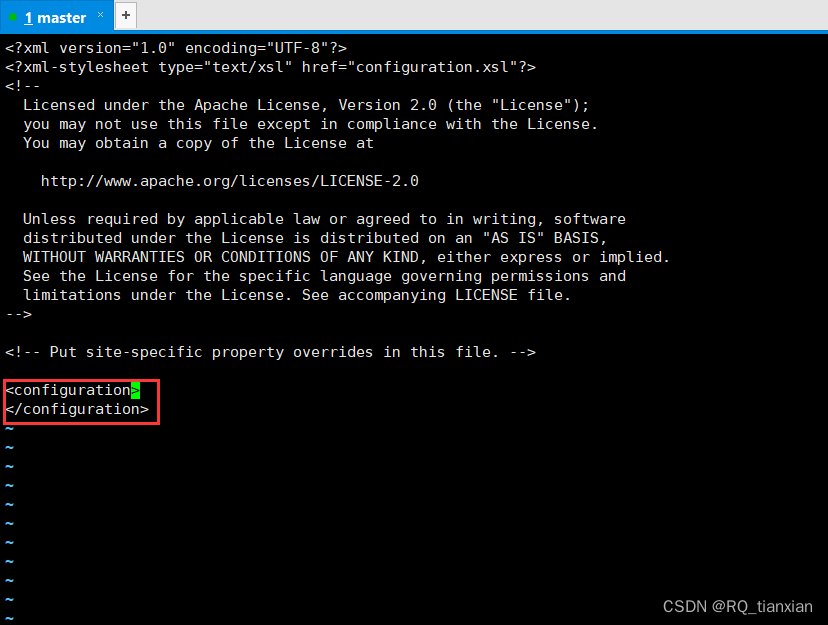

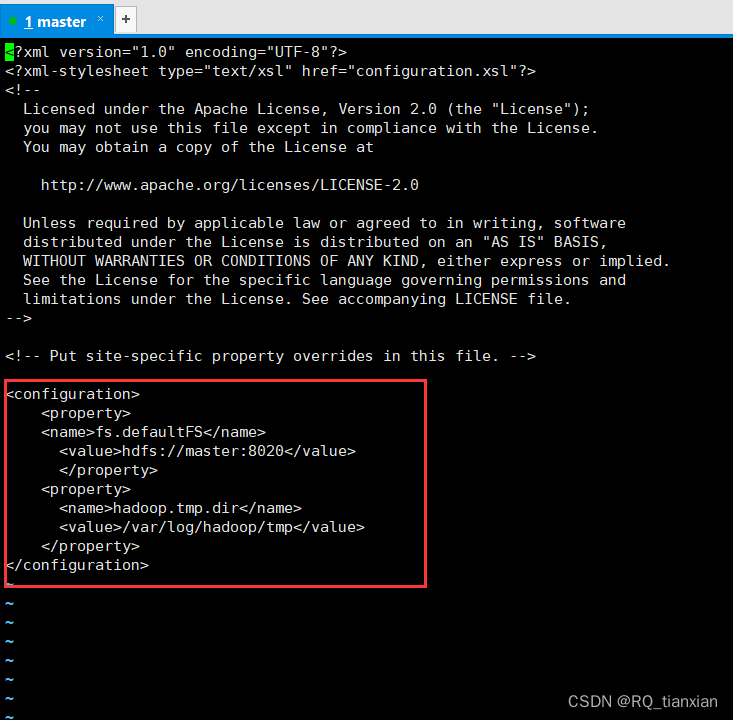

3.2.1 修改core-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:8020</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/var/log/hadoop/tmp</value>

</property>

</configuration>

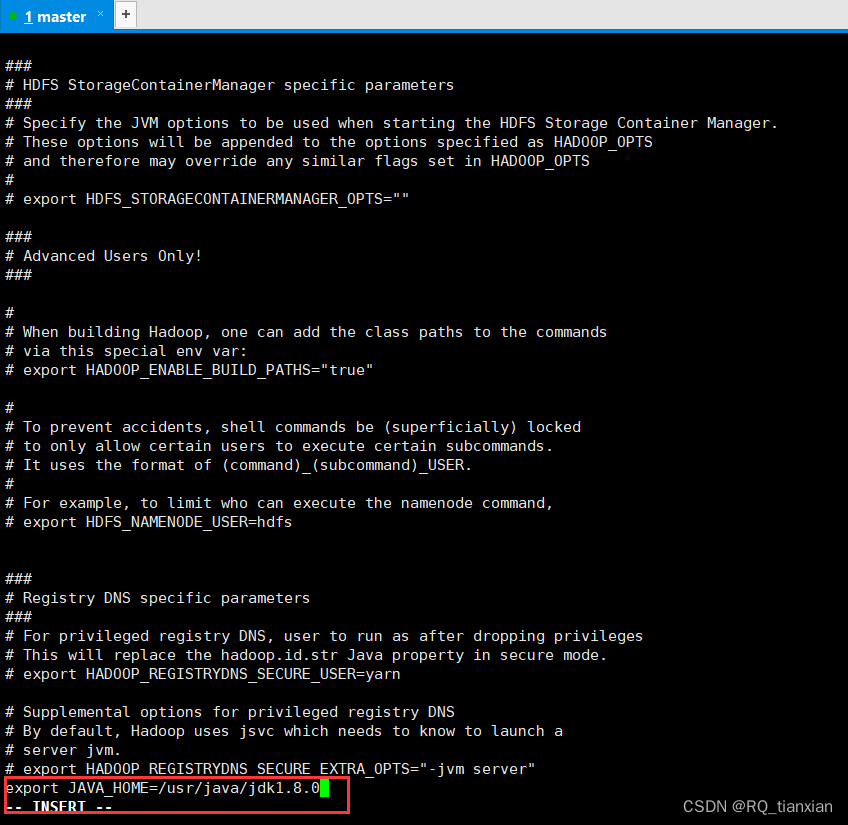

3.2.2 修改hadoop-env.sh

export JAVA_HOME=/usr/java/jdk1.8.0

3.2.3 修改yarn-env.sh

export JAVA_HOME=/usr/java/jdk1.8.0

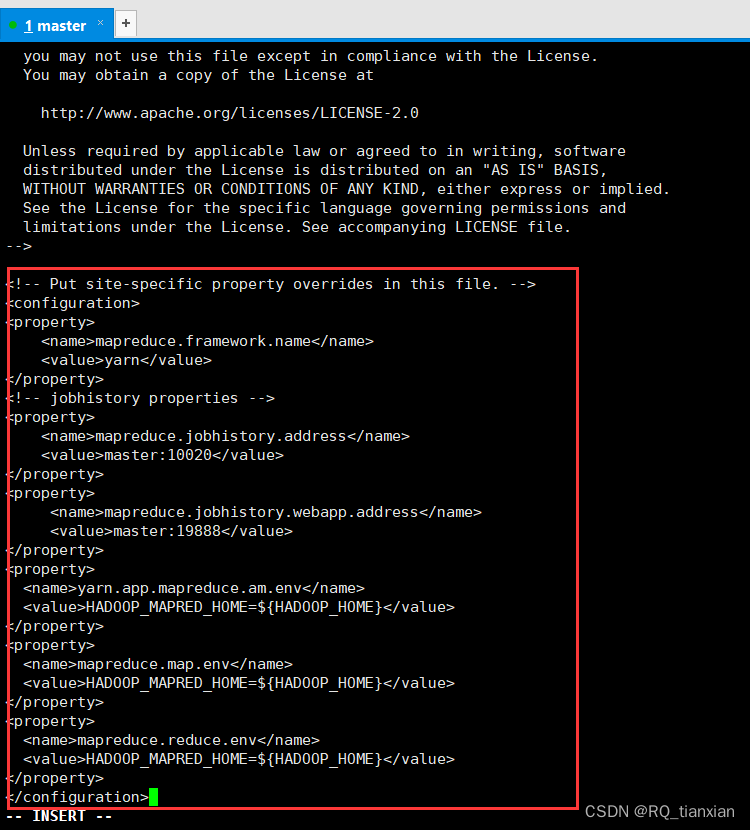

3.2.4 修改mapred-site.xml

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<!-- jobhistory properties -->

<property>

<name>mapreduce.jobhistory.address</name>

<value>master:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>master:19888</value>

</property>

<property>

<name>yarn.app.mapreduce.am.env</name>

<value>HADOOP_MAPRED_HOME=${HADOOP_HOME}</value>

</property>

<property>

<name>mapreduce.map.env</name>

<value>HADOOP_MAPRED_HOME=${HADOOP_HOME}</value>

</property>

<property>

<name>mapreduce.reduce.env</name>

<value>HADOOP_MAPRED_HOME=${HADOOP_HOME}</value>

</property>

</configuration>

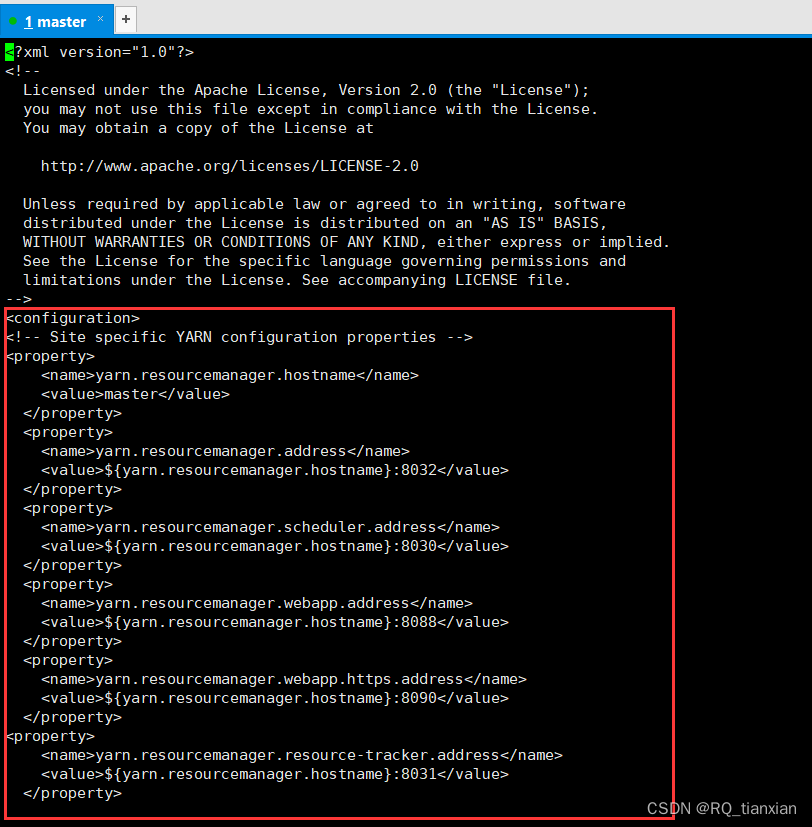

3.2.5 修改yarn-site.xml

<configuration>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>master</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>${yarn.resourcemanager.hostname}:8032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>${yarn.resourcemanager.hostname}:8030</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>${yarn.resourcemanager.hostname}:8088</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.https.address</name>

<value>${yarn.resourcemanager.hostname}:8090</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>${yarn.resourcemanager.hostname}:8031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>${yarn.resourcemanager.hostname}:8033</value>

</property>

<property>

<name>yarn.nodemanager.local-dirs</name>

<value>/data/hadoop/yarn/local</value>

</property>

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<property>

<name>yarn.nodemanager.remote-app-log-dir</name>

<value>/data/tmp/logs</value>

</property>

<property>

<name>yarn.log.server.url</name>

<value>http://master:19888/jobhistory/logs/</value>

<description>URL for job history server</description>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.scheduler.minimum-allocation-mb</name>

<value>512</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>4096</value>

</property>

<property>

<name>mapreduce.map.memory.mb</name>

<value>2048</value>

</property>

<property>

<name>mapreduce.reduce.memory.mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.nodemanager.resource.cpu-vcores</name>

<value>1</value>

</property>

</configuration>

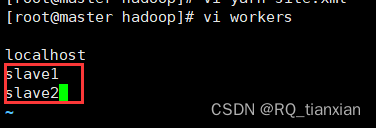

3.2.6 修改workers(课程只要求搭建两个)

slave1

slave2

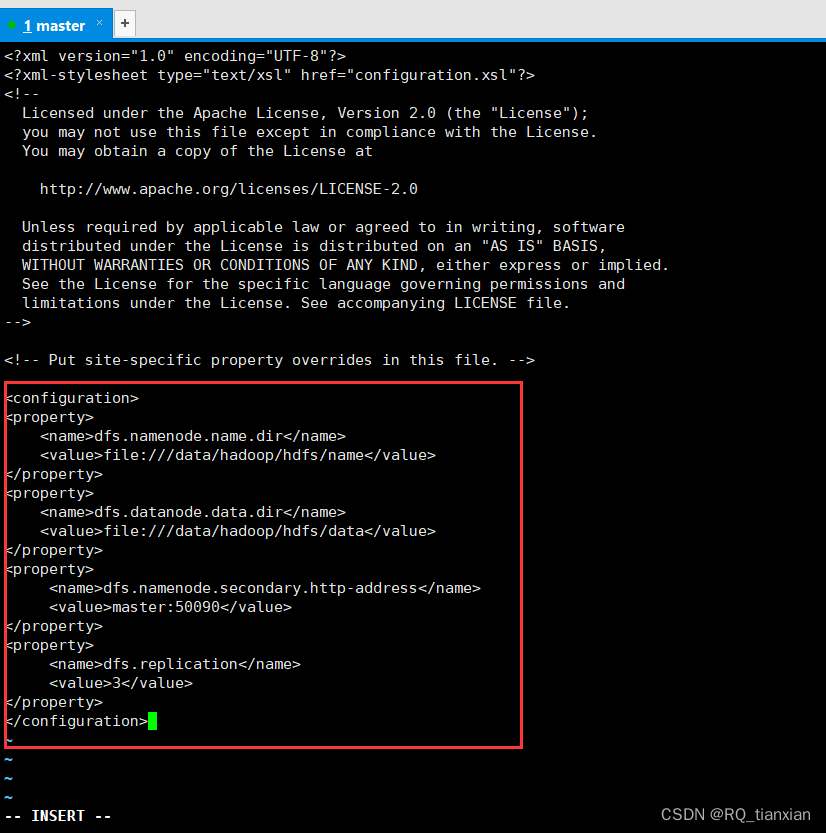

3.2.7 修改hdfs-site.xml

<configuration>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:///data/hadoop/hdfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:///data/hadoop/hdfs/data</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>master:50090</value>

</property>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

</configuration>

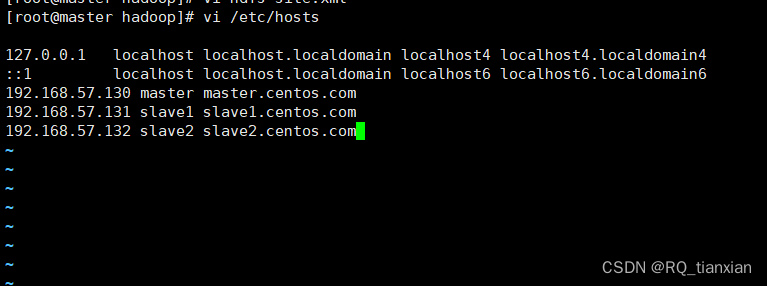

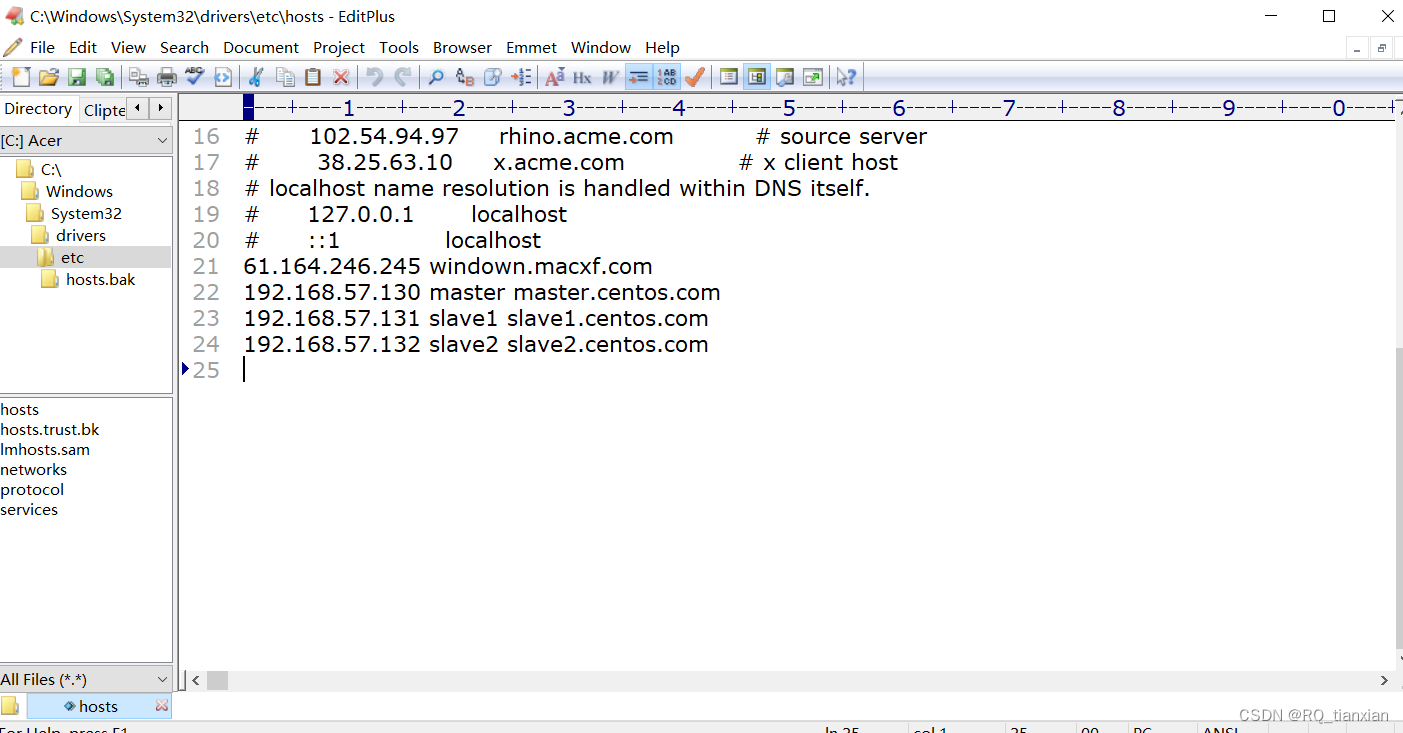

3.2.8 修改 /etc/hosts文件

- 不同电脑ip不相同

192.168.57.130 master master.centos.com

192.168.57.131 slave1 slave1.centos.com

192.168.57.132 slave2 slave2.centos.com

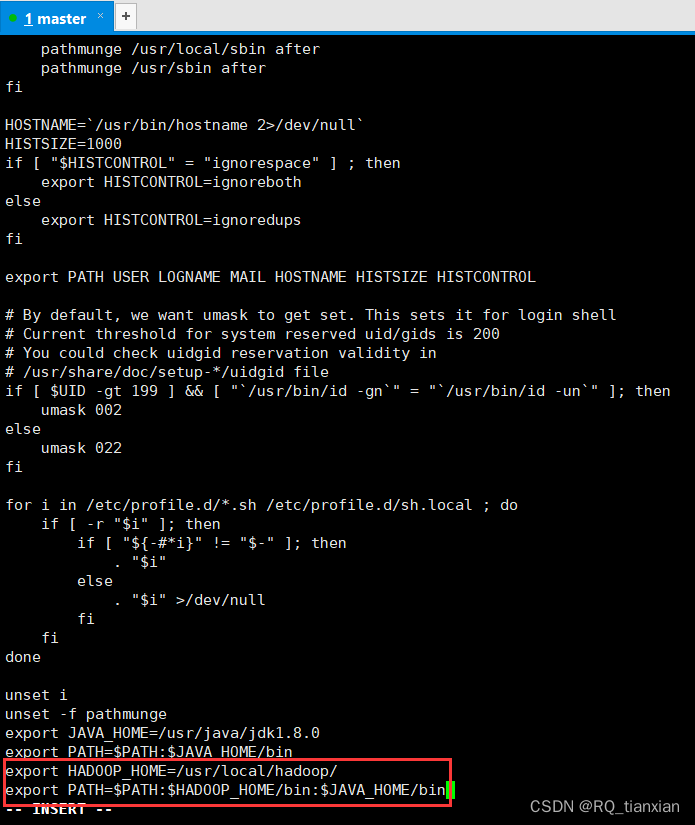

3.2.9 配置环境变量

vi /etc/profile

export HADOOP_HOME=/usr/local/hadoop/

export PATH=$PATH:$HADOOP_HOME/bin:$JAVA_HOME/bin

- 更新文件

source /etc/profile

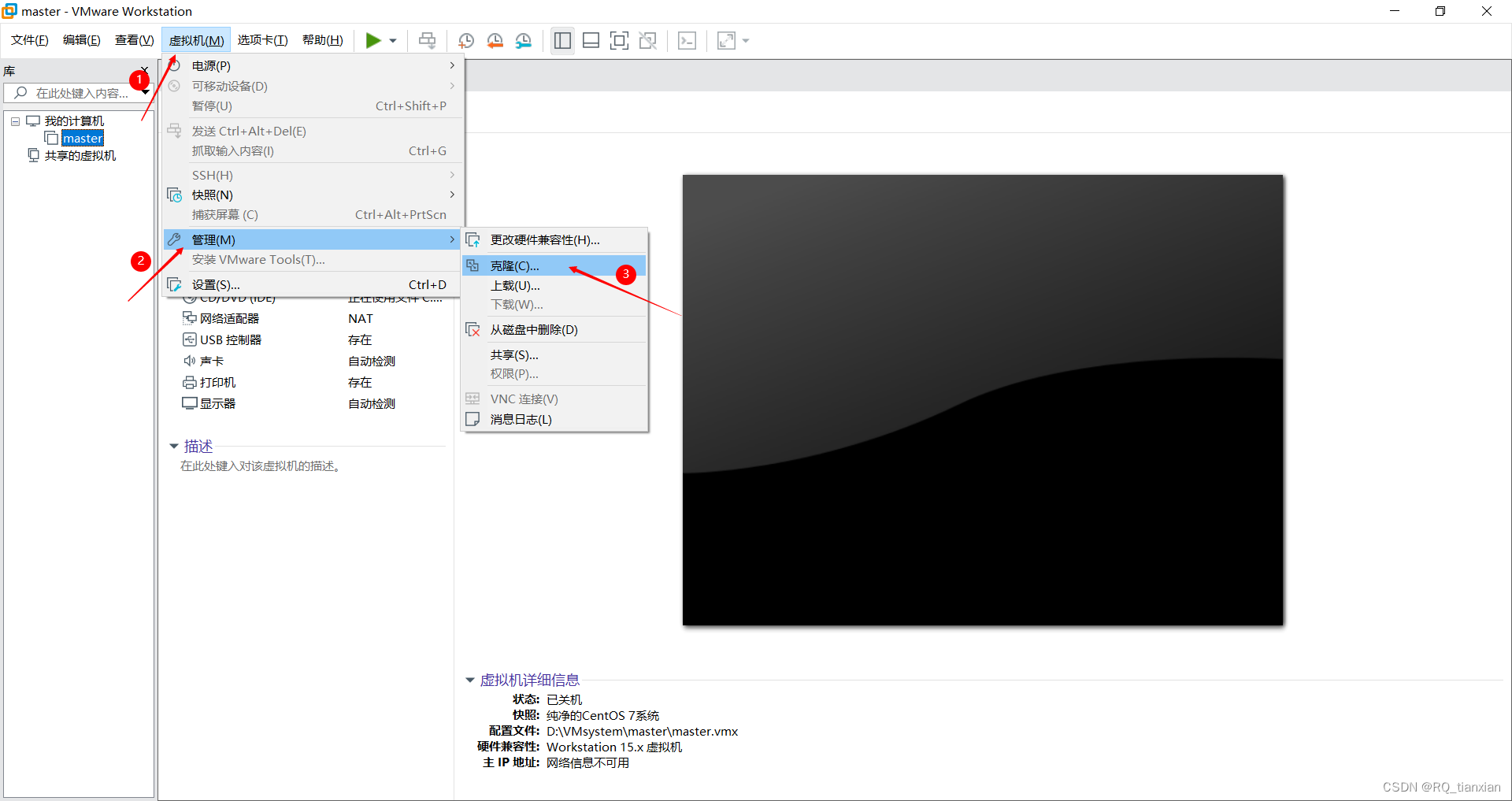

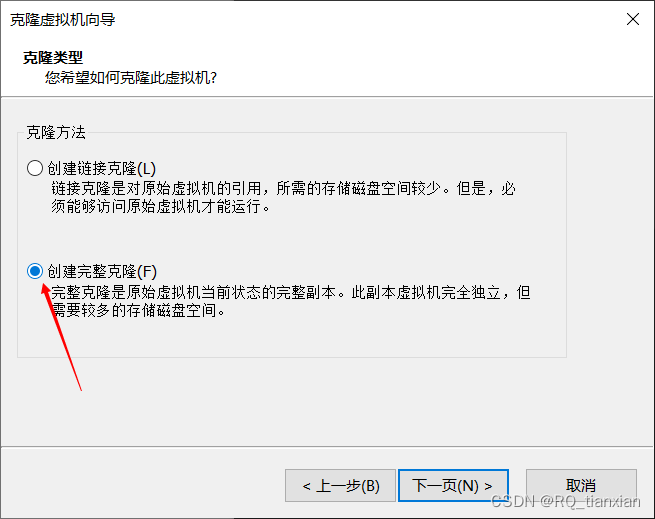

3.3 克隆虚拟机

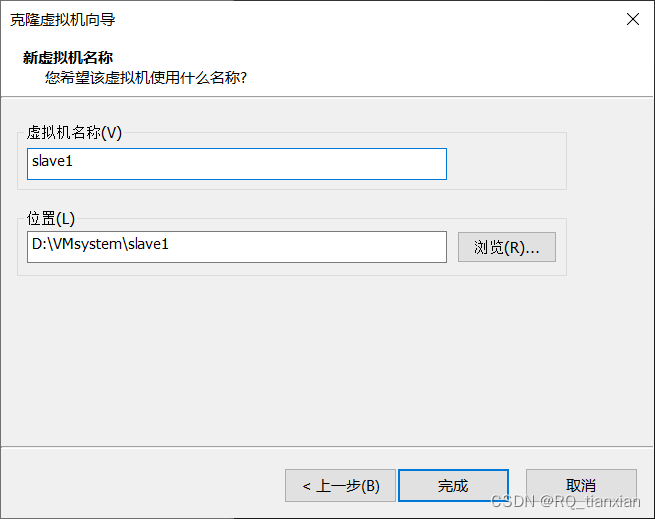

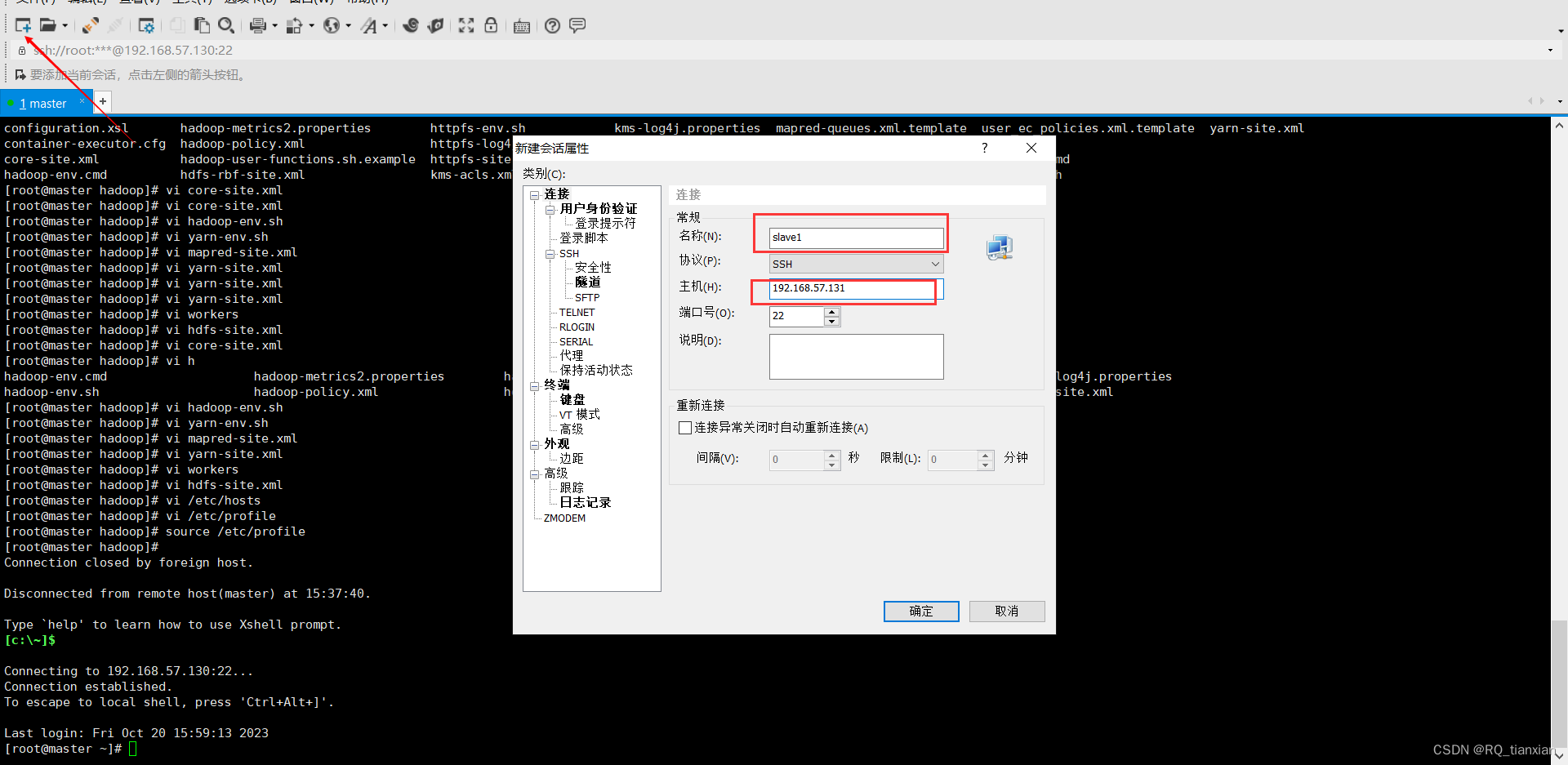

3.3.1 克隆slave1

- 修改网络配置

将IPADDR值修改为192.168.57.131 (每台电脑ip都不同)

vi /etc/sysconfig/network-scripts/ifcfg-ens33

- 重启网络

service network restart

- 查看IP

ip addr

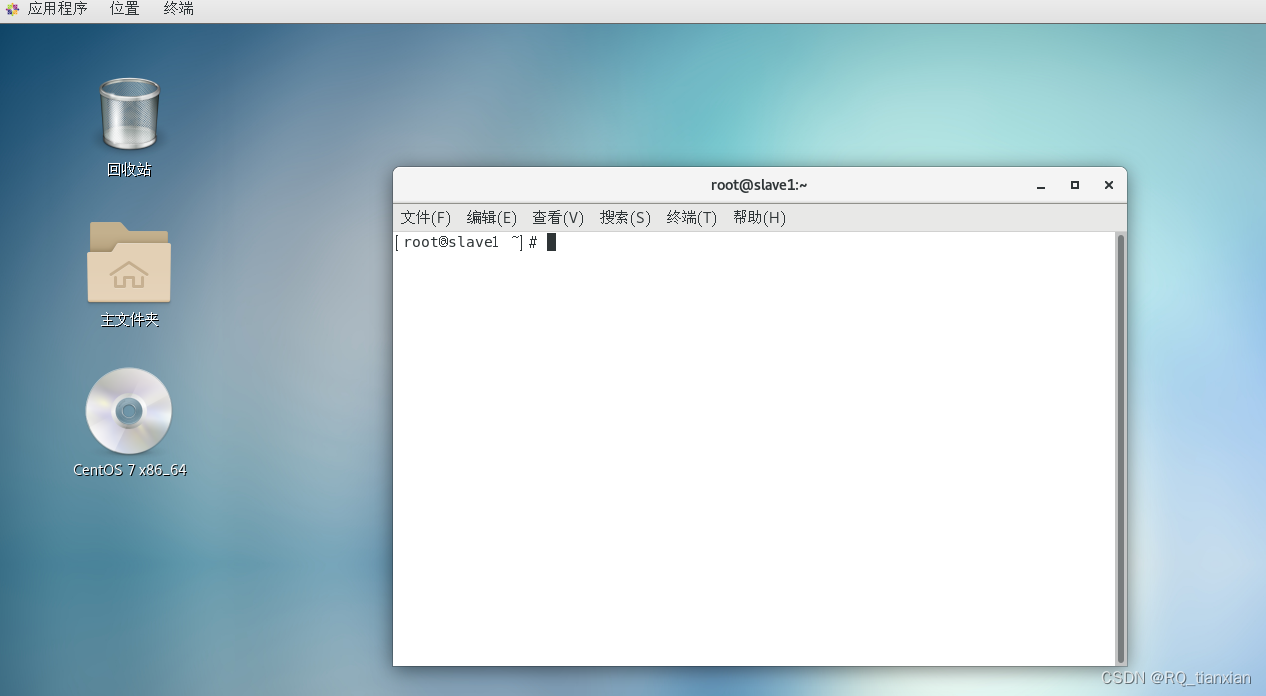

- 修改主机名,重启

hostnamectl set-hostname slave1

reboot

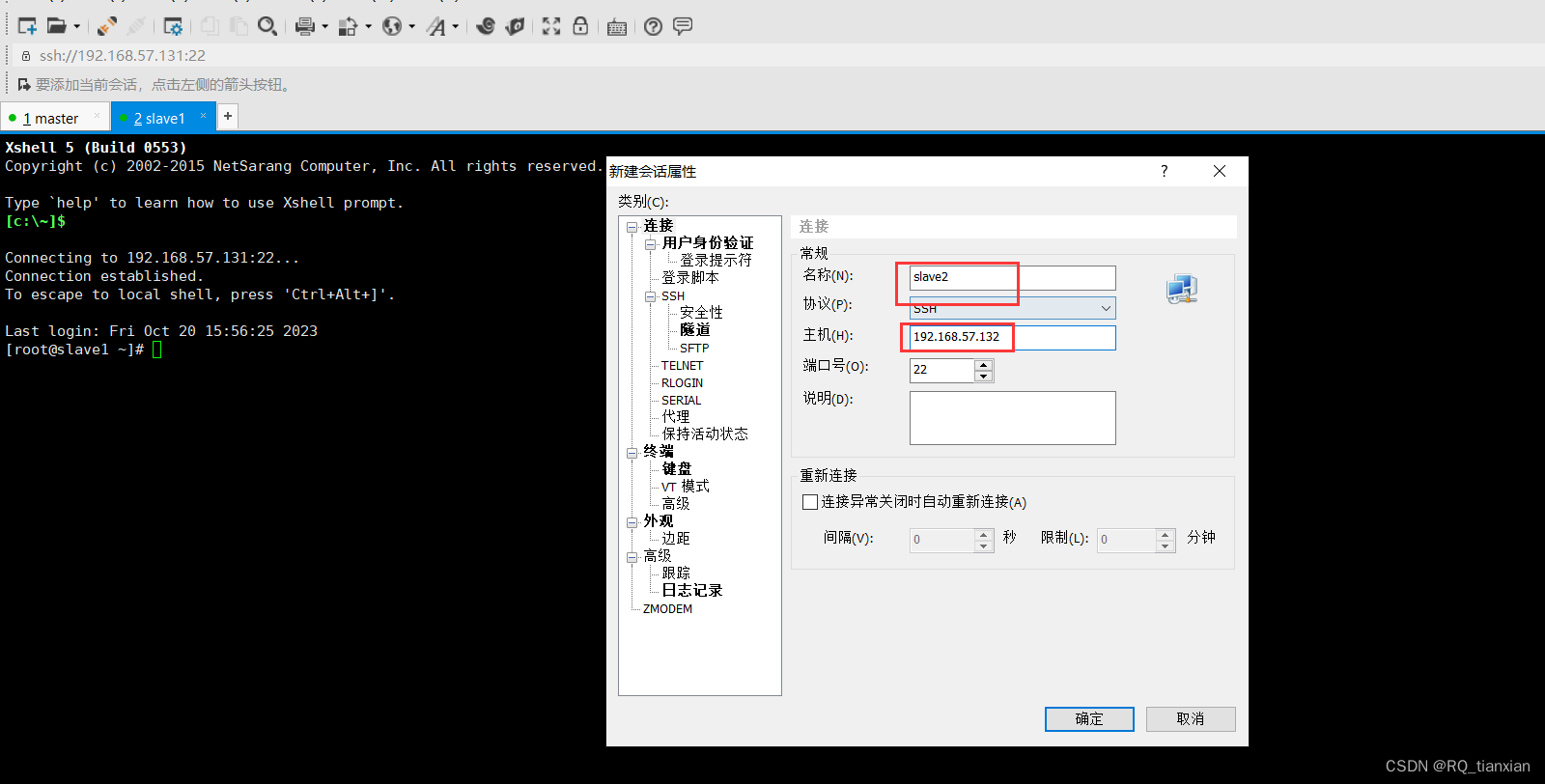

3.3.2 克隆slave2

- 将IPADDR值修改为192.168.57.132

- 将主机名修改为slave2

3.4 远程连接

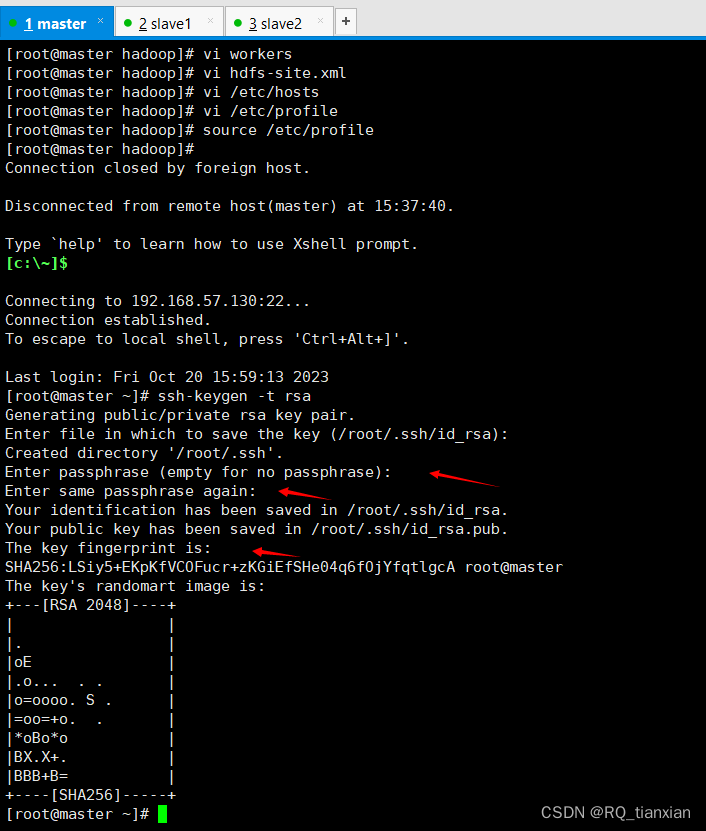

3.5 SSH免密登录

3.5.1 使用ssh-keygen产生公钥和钥对

- 输入指令,连按三次

ssh-keygen -t rsa

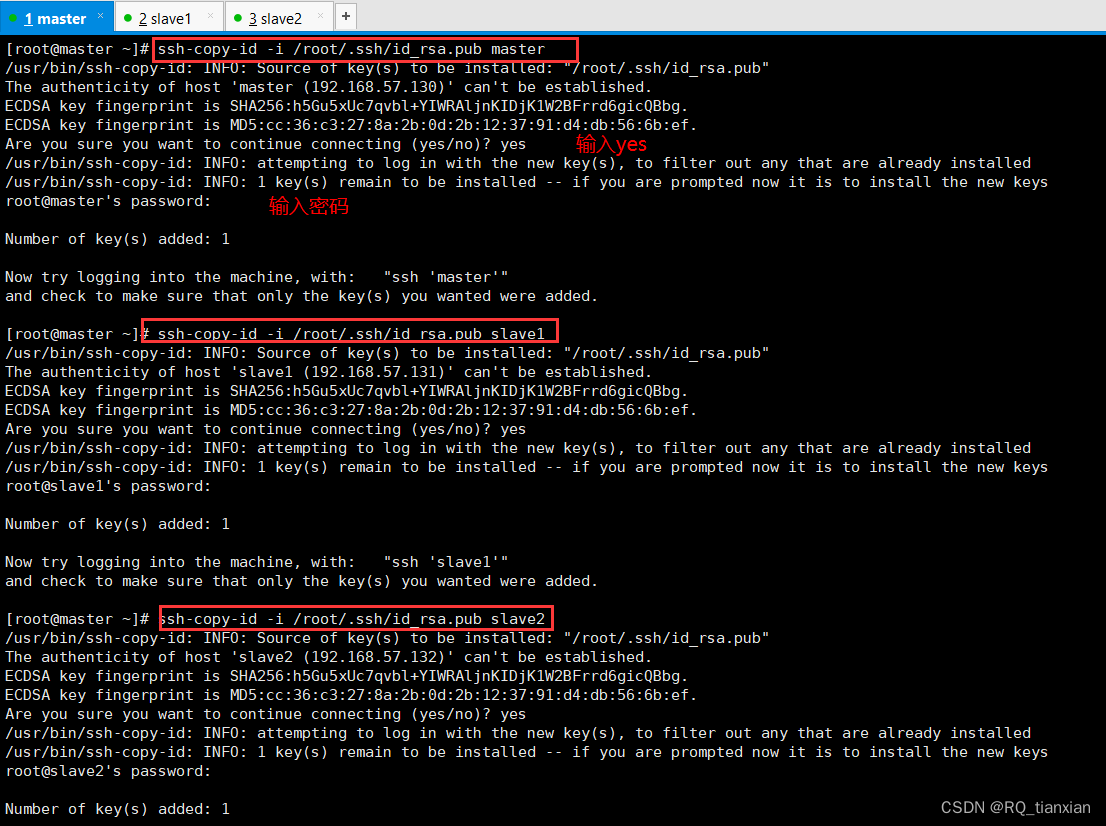

3.5.2 将公钥复制至远程机器中

ssh-copy-id -i /root/.ssh/id_rsa.pub master

ssh-copy-id -i /root/.ssh/id_rsa.pub slave1

ssh-copy-id -i /root/.ssh/id_rsa.pub slave2

3.5.3 验证无密钥登录

ssh slave1

ssh slave2

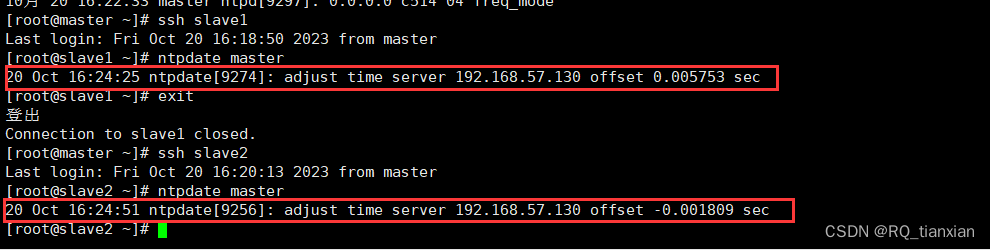

3.6 配置时间同步服务

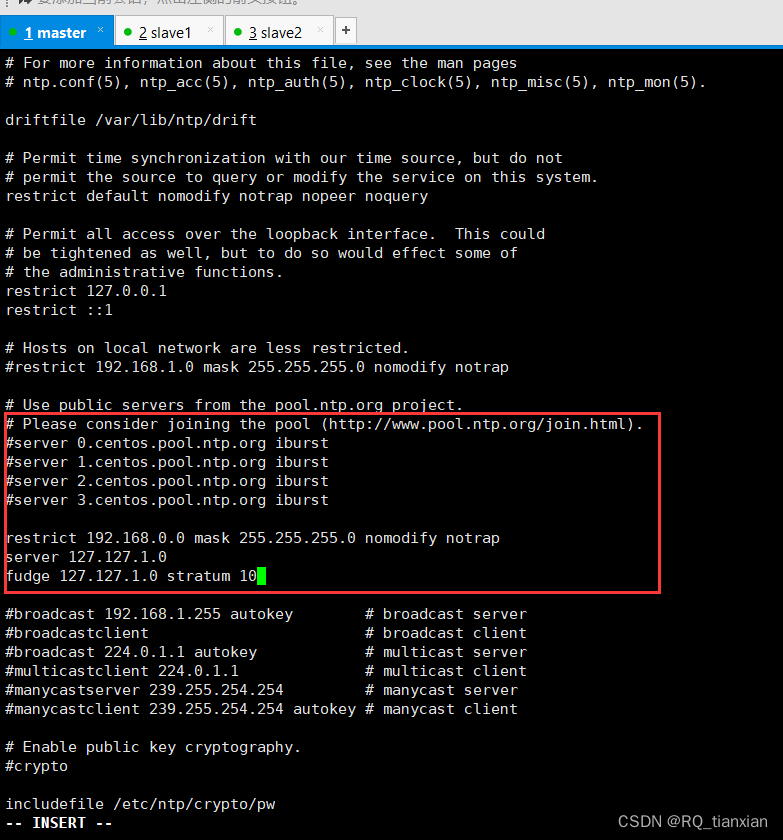

3.6.1 设置master节点为NTP服务主节点

- 注释 /etc/ntp.conf 文件中以server开头的行

- 添加配置内容(copy就行)

restrict 192.168.0.0 mask 255.255.255.0 nomodify notrap

server 127.127.1.0

fudge 127.127.1.0 stratum 10

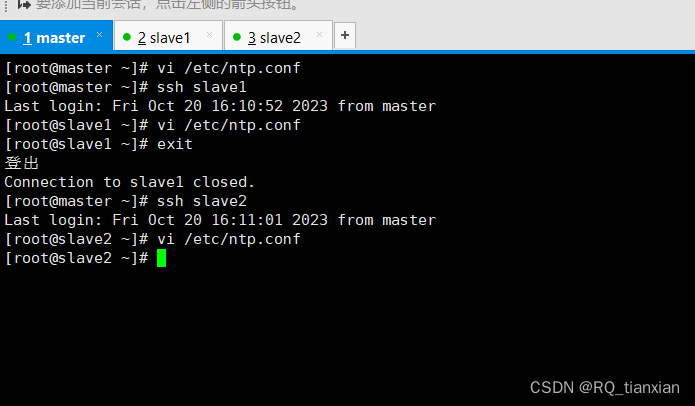

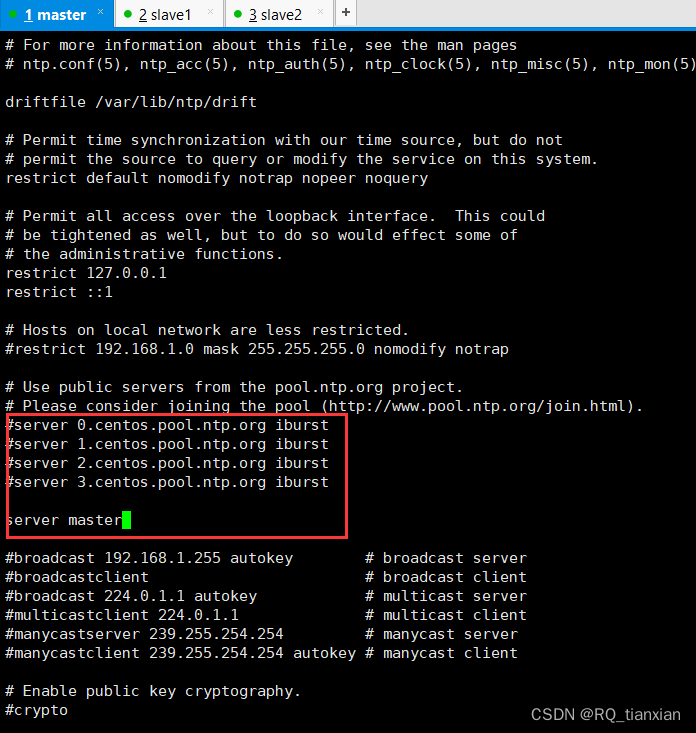

3.6.2设置slave1、slave2中配置NTP服务

- 注释 /etc/ntp.conf 文件中以server开头的行

- 添加配置内容

server master

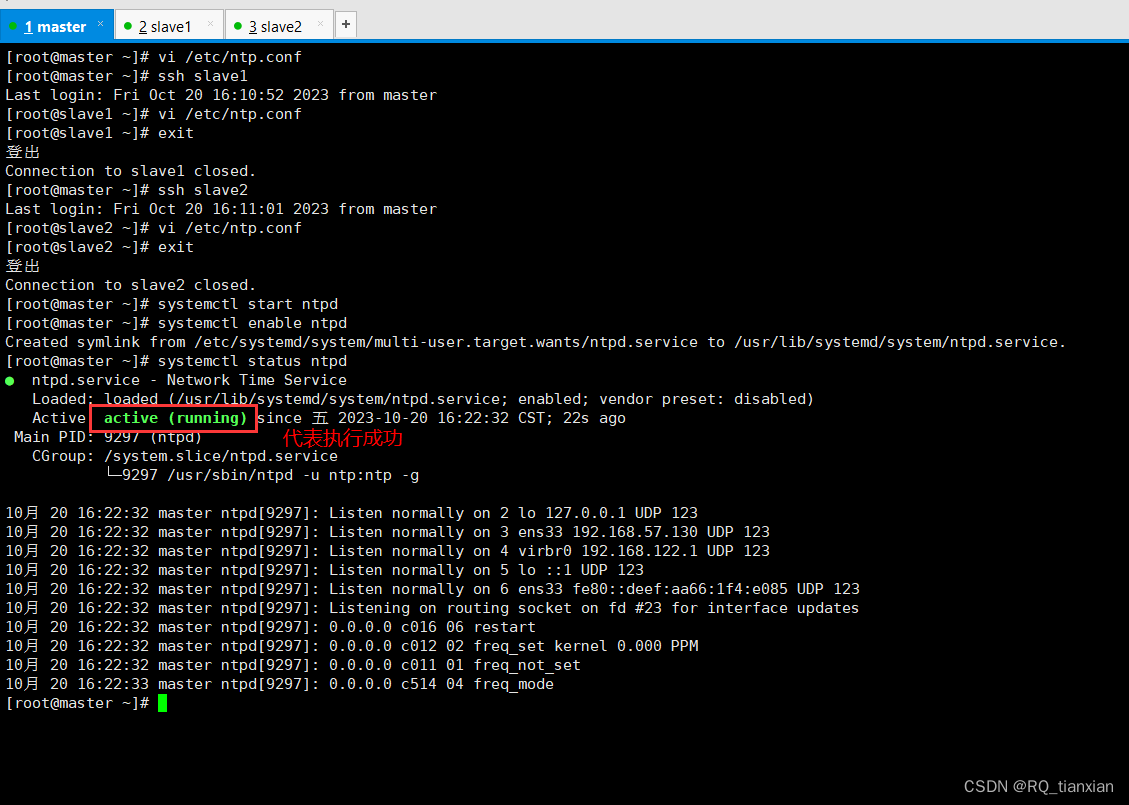

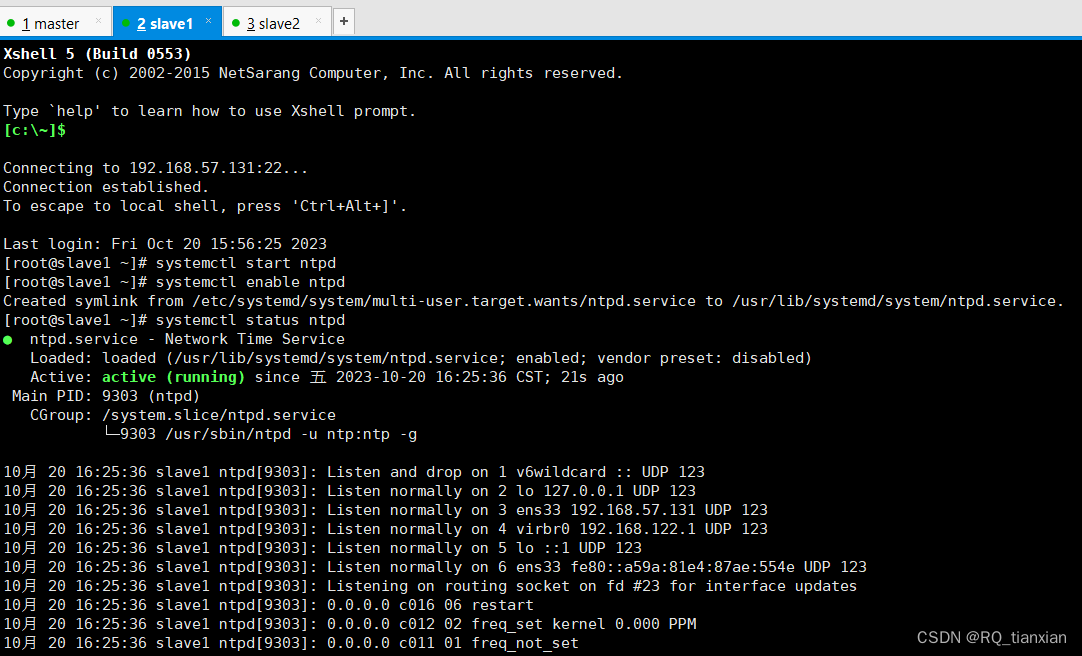

3.6.3 启动NTP服务

- 在master节点执行指令

systemctl start ntpd

systemctl enable ntpd

systemctl status ntpd

- 分别在slave1、slave2执行命令

ntpdate master

- 分别在slave1、slave2执行systemctl start ntpd systemctl enable ntpd命令,永久启动NTP服务

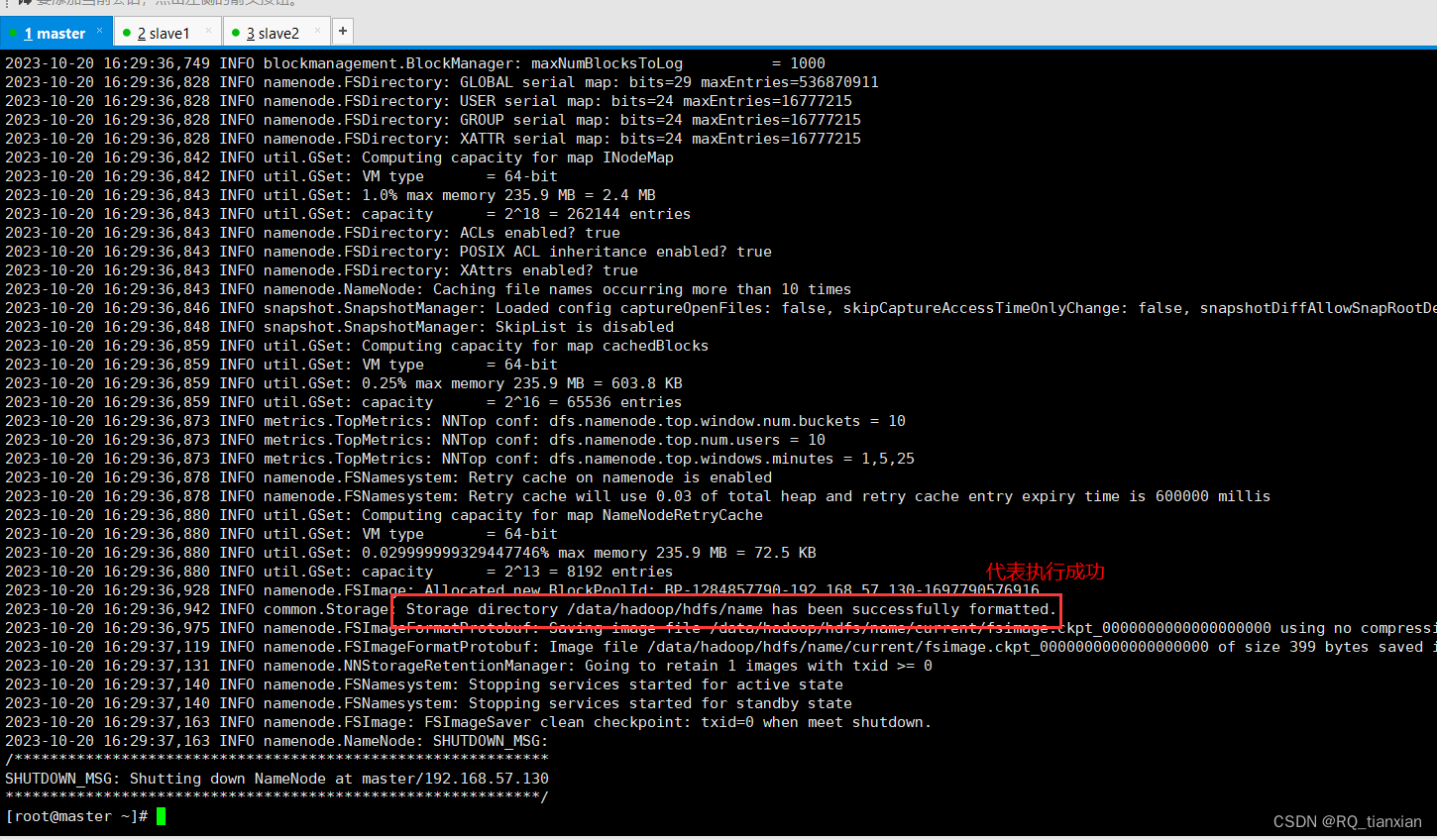

3.7启动集群

3.7.1 格式化NameNode(只需执行一次)

hdfs namenode -format

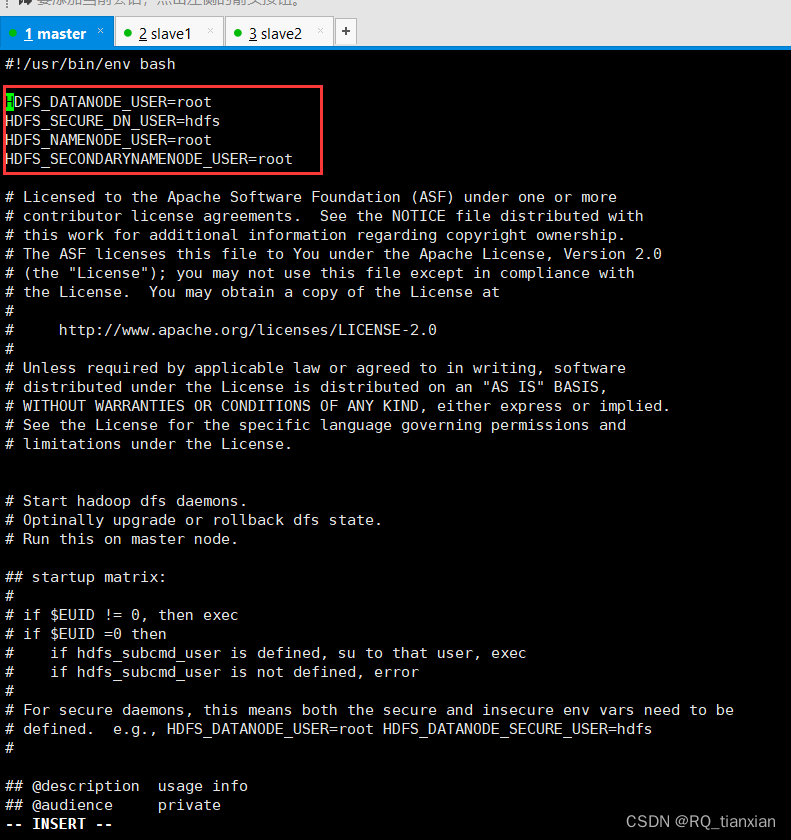

3.7.2 修改Hadoop集群启动和关闭服务文件

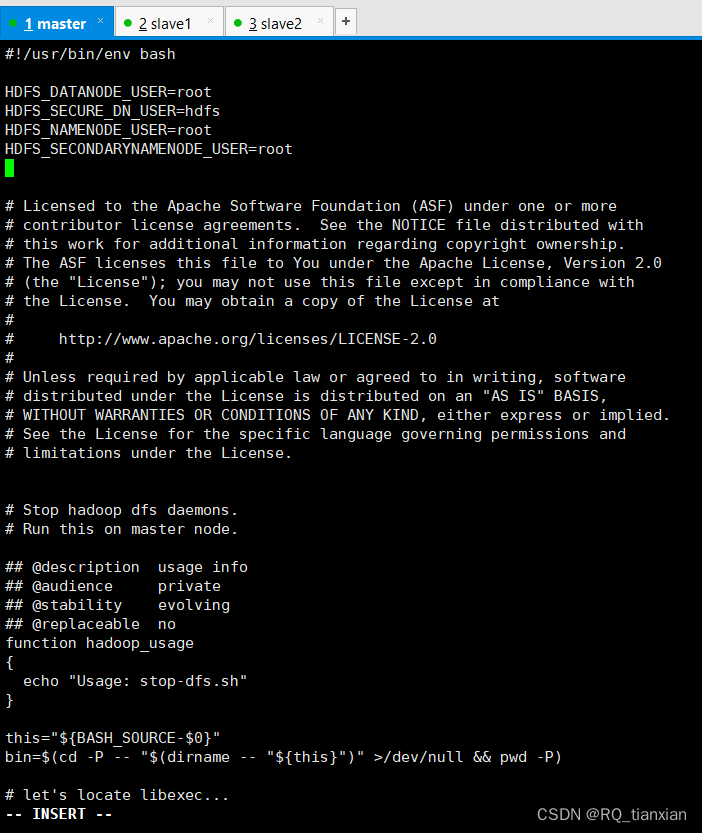

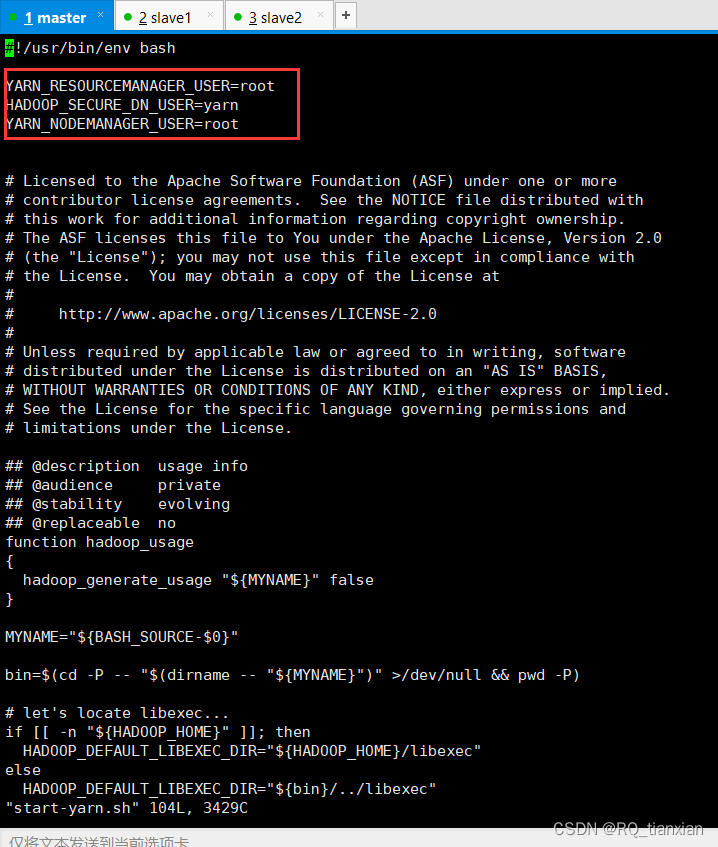

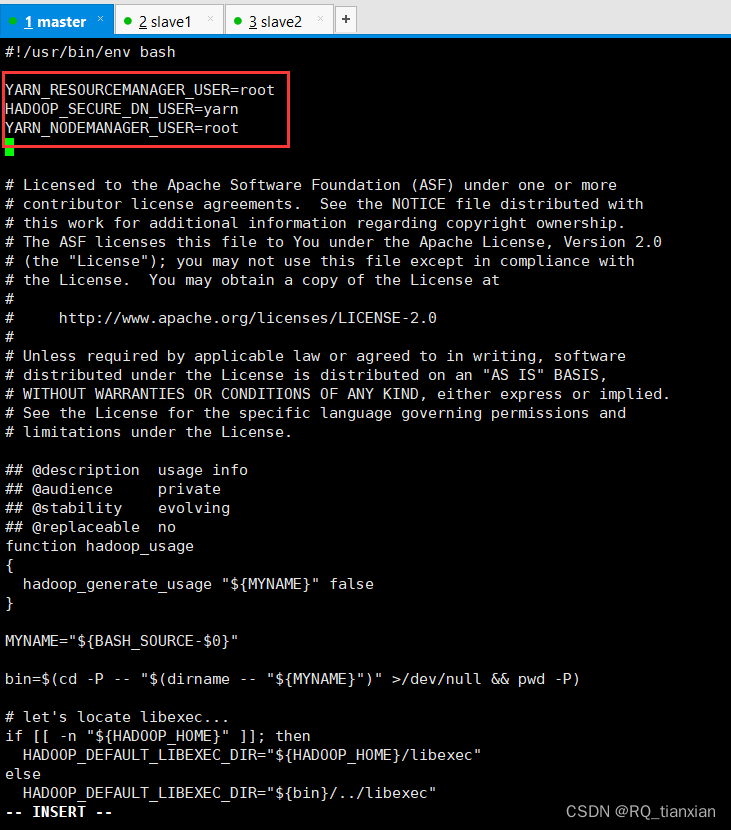

- master、slave1、slave2上都要修改

- 修改start-dfs.sh和stop-dfs.sh文件,在文件开头添加如下代码

- 修改start-yarn.sh和stop-yarn.sh,在文件开头添加如下代码

3.7.3 拍摄快照

- 三台虚拟机都要拍

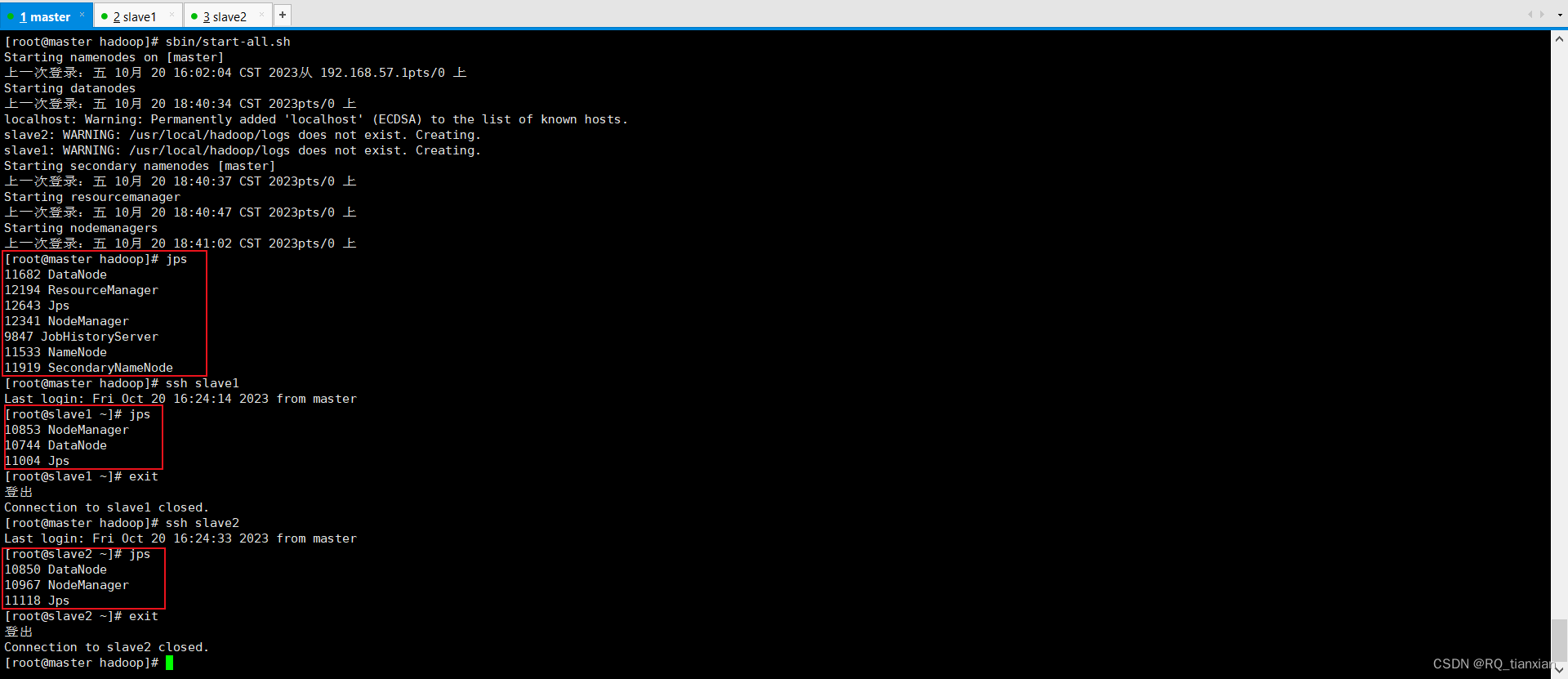

3.7.4 在安装目录启动集群

cd /usr/local

sbin/start-all.sh

mapred --daemon start historyserver

3.7.5 修改个人计算机的host文件

- 路径:C:\Windows\System32\drivers\etc\

- 末行加入ip(不同电脑ip不同)

192.168.57.130 master master.centos.com

192.168.57.131 slave1 slave1.centos.com

192.168.57.132 slave2 slave2.centos.com

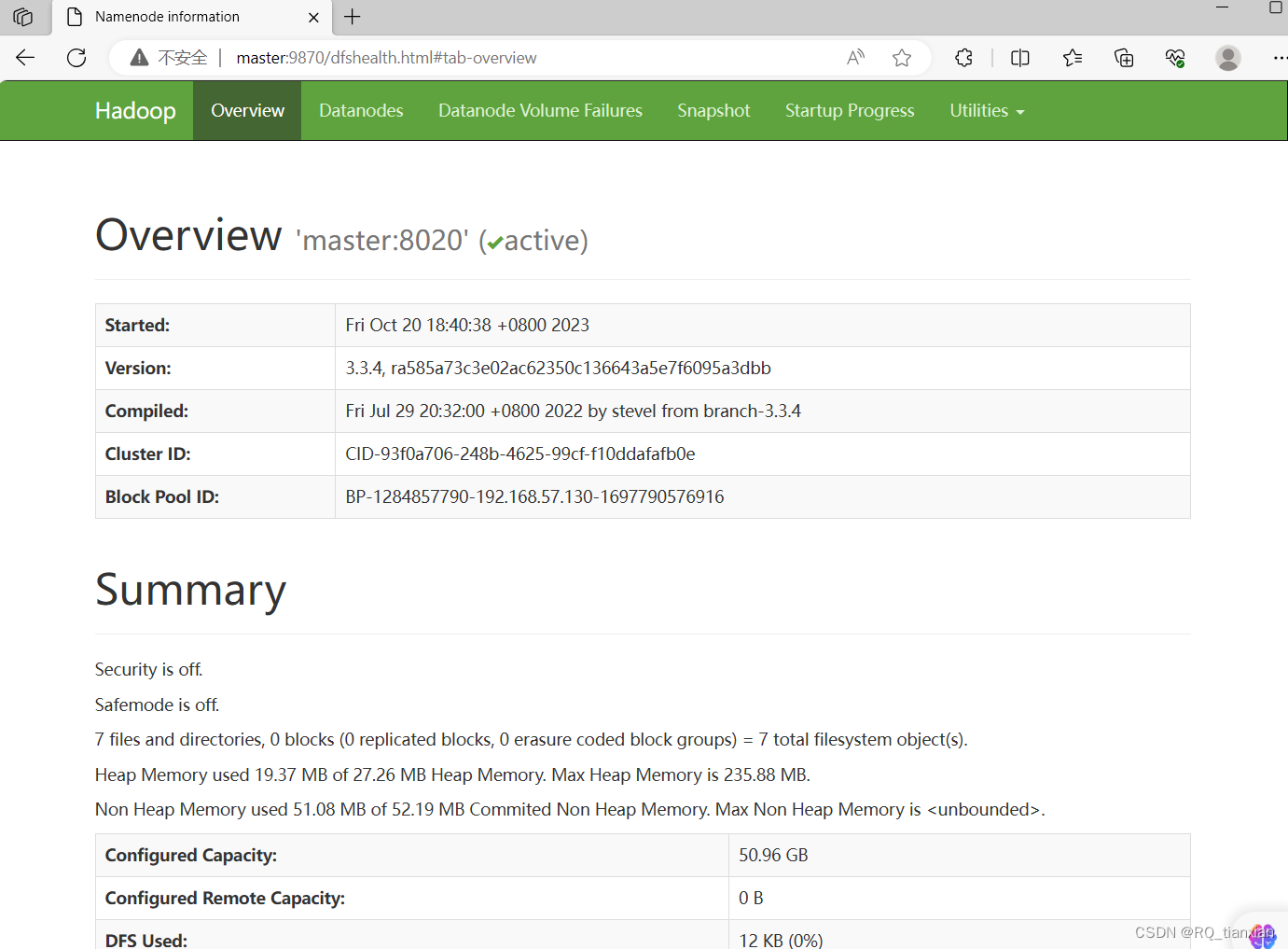

4. 监控集群

4.1 HDFS监控

- 浏览器输入网站 http://master:9870

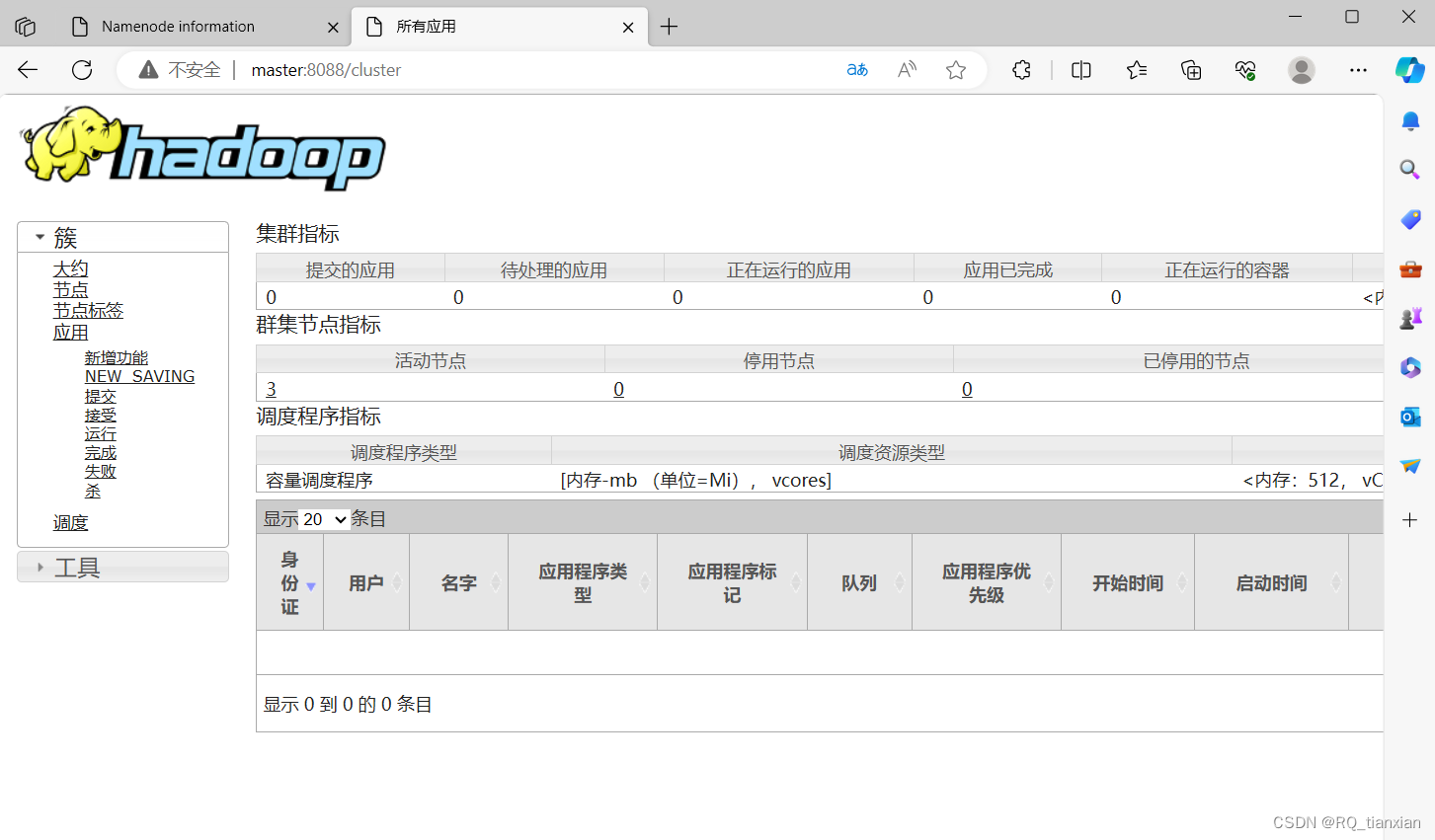

4.2 YARN监控

- 浏览器输入 http://master:8088

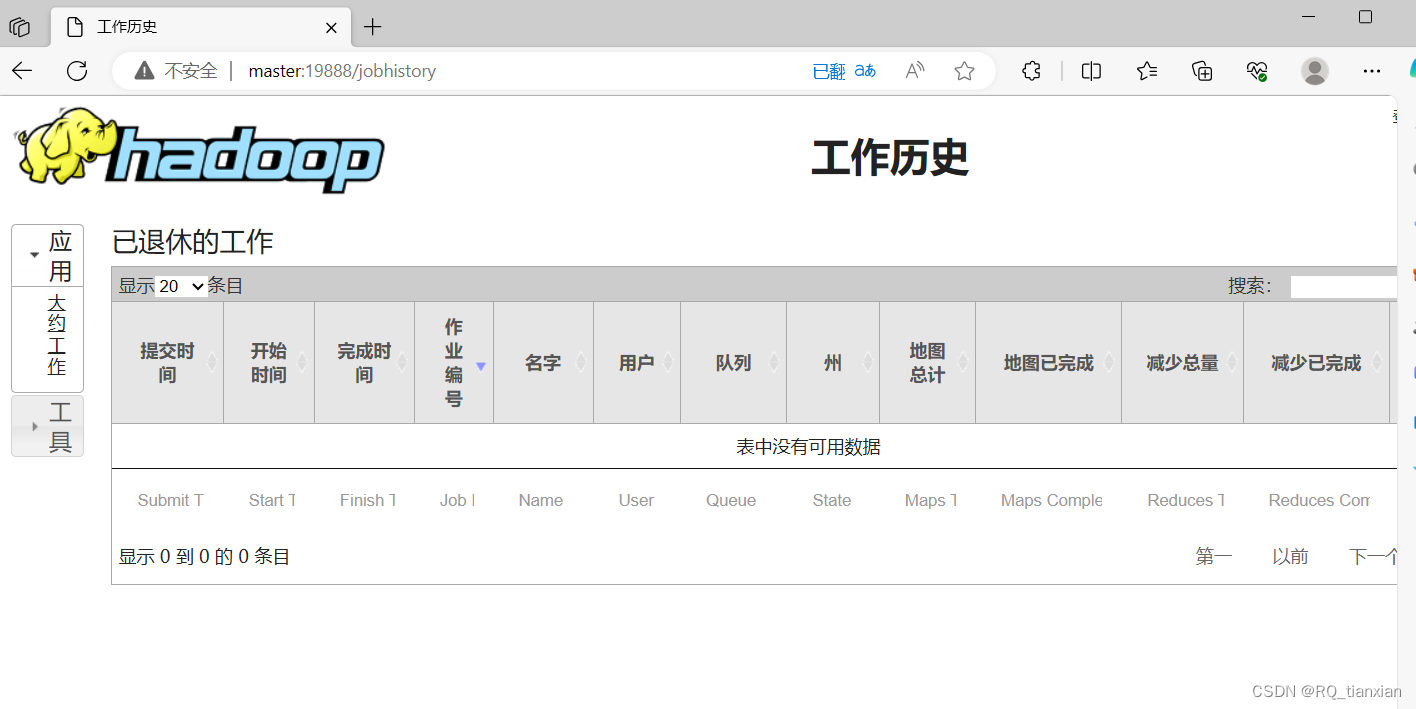

4.3 日志监控

浏览器输入 http://master:19888

5. 写在最后

5.1 出现并解决的问题

-

主机忘记改名,后面改名不成功

-

与外网ping不成功

-

与Xftp连不上

-

找不到openjdk路径

-

hadoop配置文件路径出错

-

java环境变量配置失败

-

时间同步无法实现

-

多次格式化NameNode导致无法启动监控集群

5.2 总结

- 修改能正常运行的已知bug最好在克隆的虚拟机上操作

- 多拍快照

- 很多奇奇怪怪的问题网上都找不到解决方法,要主动提高自己的自主排错能力

云计算选修课Hadoop集群的搭建

1494

1494

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?