13.MapReduce框架原理

13.2MapReduce工作流程

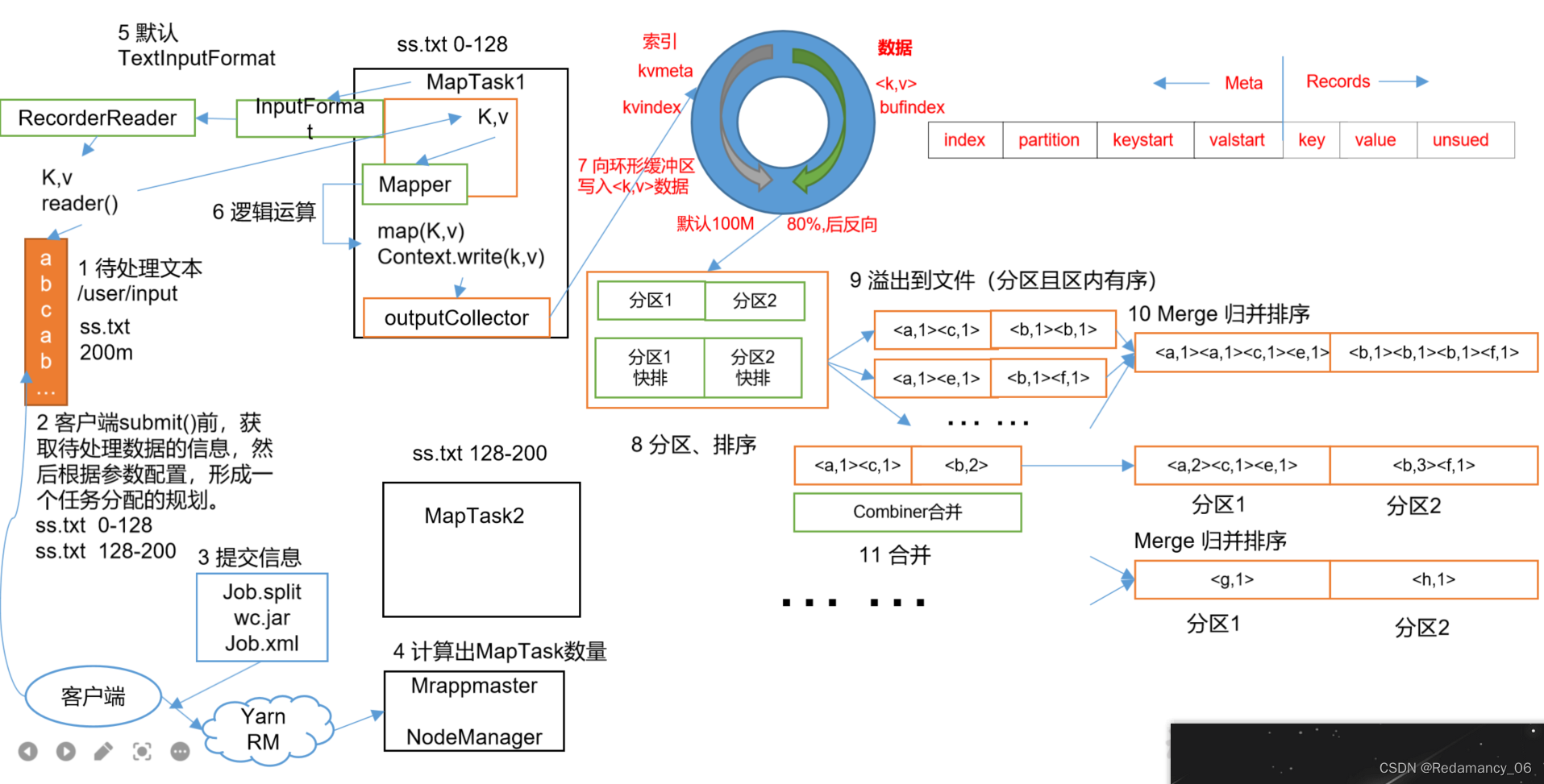

上面的流程是整个MapReduce最全工作流程,但是Shuffle过程只是从第7步开始到第16步结束,具体Shuffle过程详解,如下:

上面的流程是整个MapReduce最全工作流程,但是Shuffle过程只是从第7步开始到第16步结束,具体Shuffle过程详解,如下:

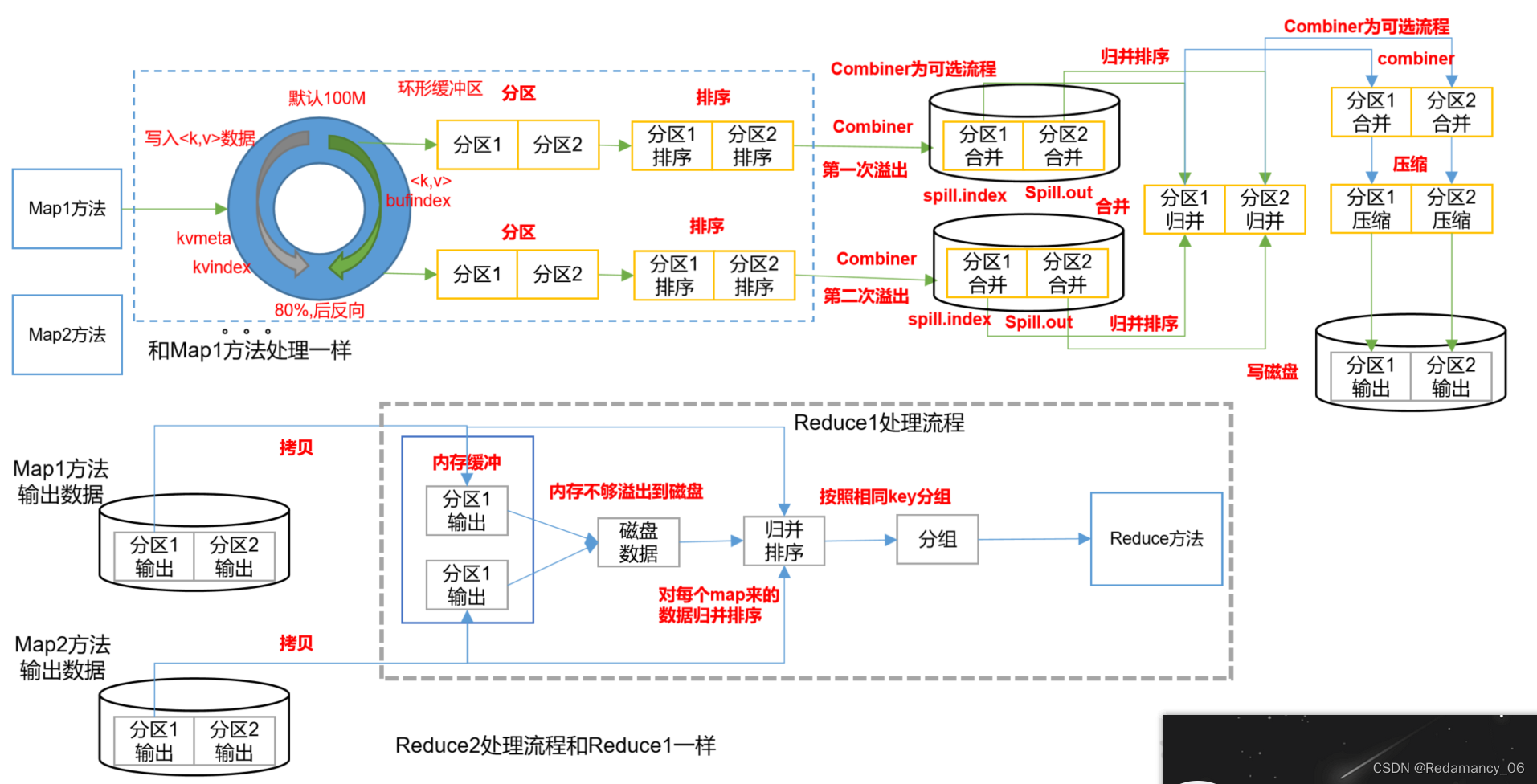

(1)MapTask收集我们的map()方法输出的kv对,放到内存缓冲区中

(2)从内存缓冲区不断溢出本地磁盘文件,可能会溢出多个文件

(3)多个溢出文件会被合并成大的溢出文件

(4)在溢出过程及合并的过程中,都要调用Partitioner进行分区和针对key进行排序

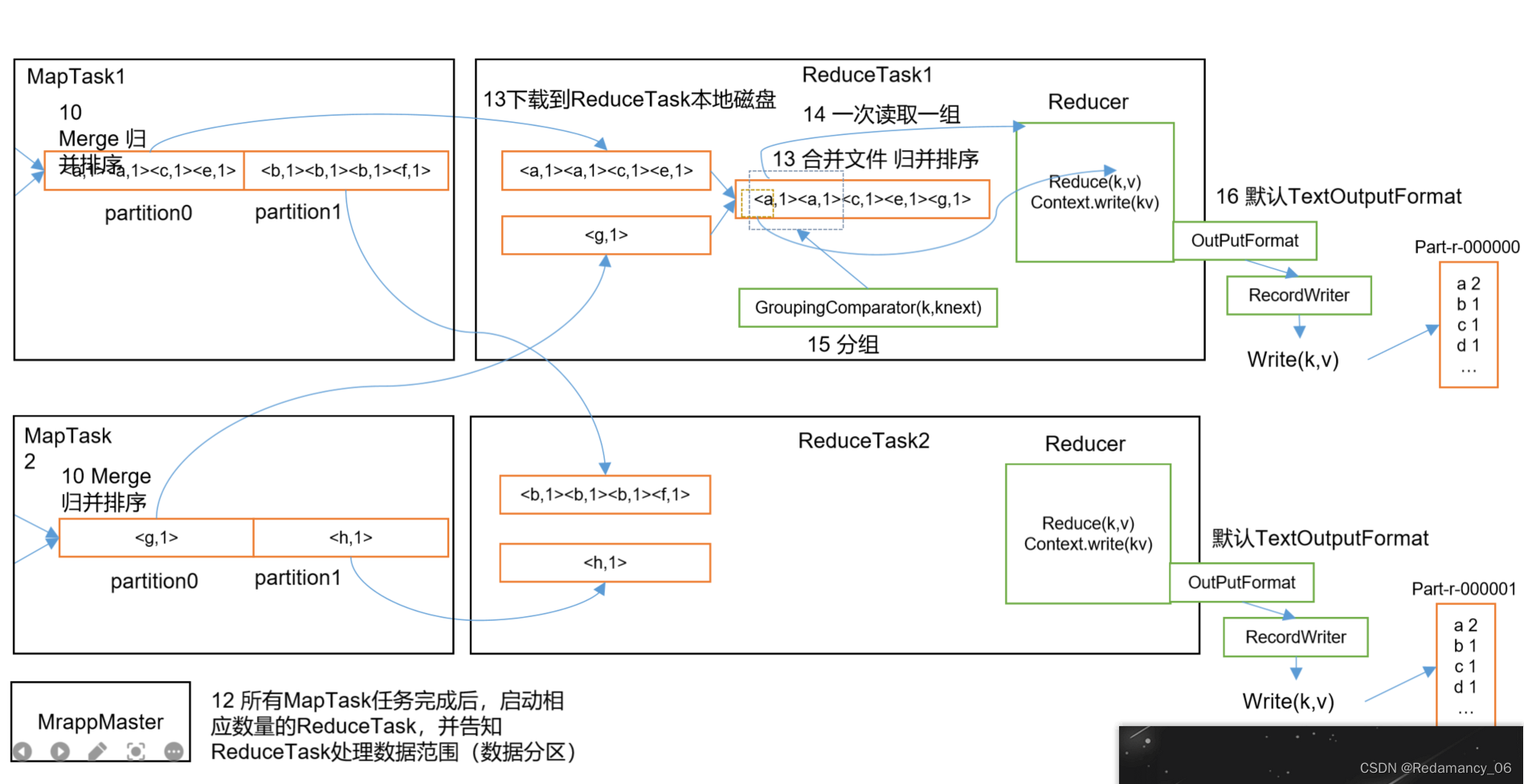

(5)ReduceTask根据自己的分区号,去各个MapTask机器上取相应的结果分区数据

(6)ReduceTask会抓取到同一个分区的来自不同MapTask的结果文件,ReduceTask

会将这些文件再进行合并(归并排序)

(7)合并成大文件后,Shuffle的过程也就结束了,后面进入ReduceTask的逻辑运算过程(从文件中取出一个一个的键值对Group,调用用户自定义的reduce()方法)

注意:

(1)Shuffle中的缓冲区大小会影响到MapReduce程序的执行效率,原则上说,缓冲区越大,磁盘io的次数越少,执行速度就越快。

(2)缓冲区的大小可以通过参数调整,参数:mapreduce.task.io.sort.mb默认100M。

13.3Shuffle机制

13.3.1Shuffle机制

Map方法之后,Reduce方法之前的数据处理过程称之为Shuffle。又称为混洗

13.3.2Partition分区

13.3.2.1问题引出

要求将统计结果按照条件输出到不同文件中(分区)。比如:将统计结果按照手机归属地不同省份输出到不同文件中(分区)

13.3.2.2默认Partitioner分区

public class HashPartitioner<K, V> extends Partitioner<K, V> {

public int getPartition(K key, V value, int numReduceTasks) {

return (key.hashCode() & Integer.MAX_VALUE) % numReduceTasks;

}

}

默认分区是根据key的hashCode对ReduceTasks个数取模得到的。用户没法控制哪个key存储到哪个分区。

13.3.2.2.1Partitioner分区调试

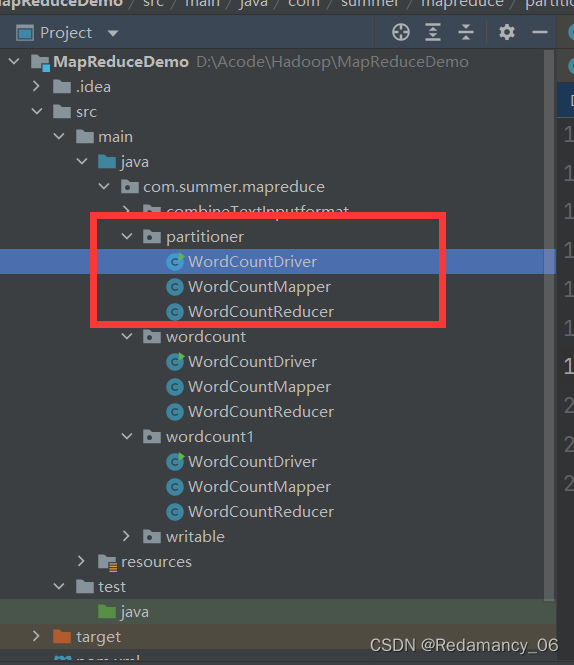

创建一个partitioner文件夹,然后将wordcount里面三个java代码一起复制到partitioner文件夹里面

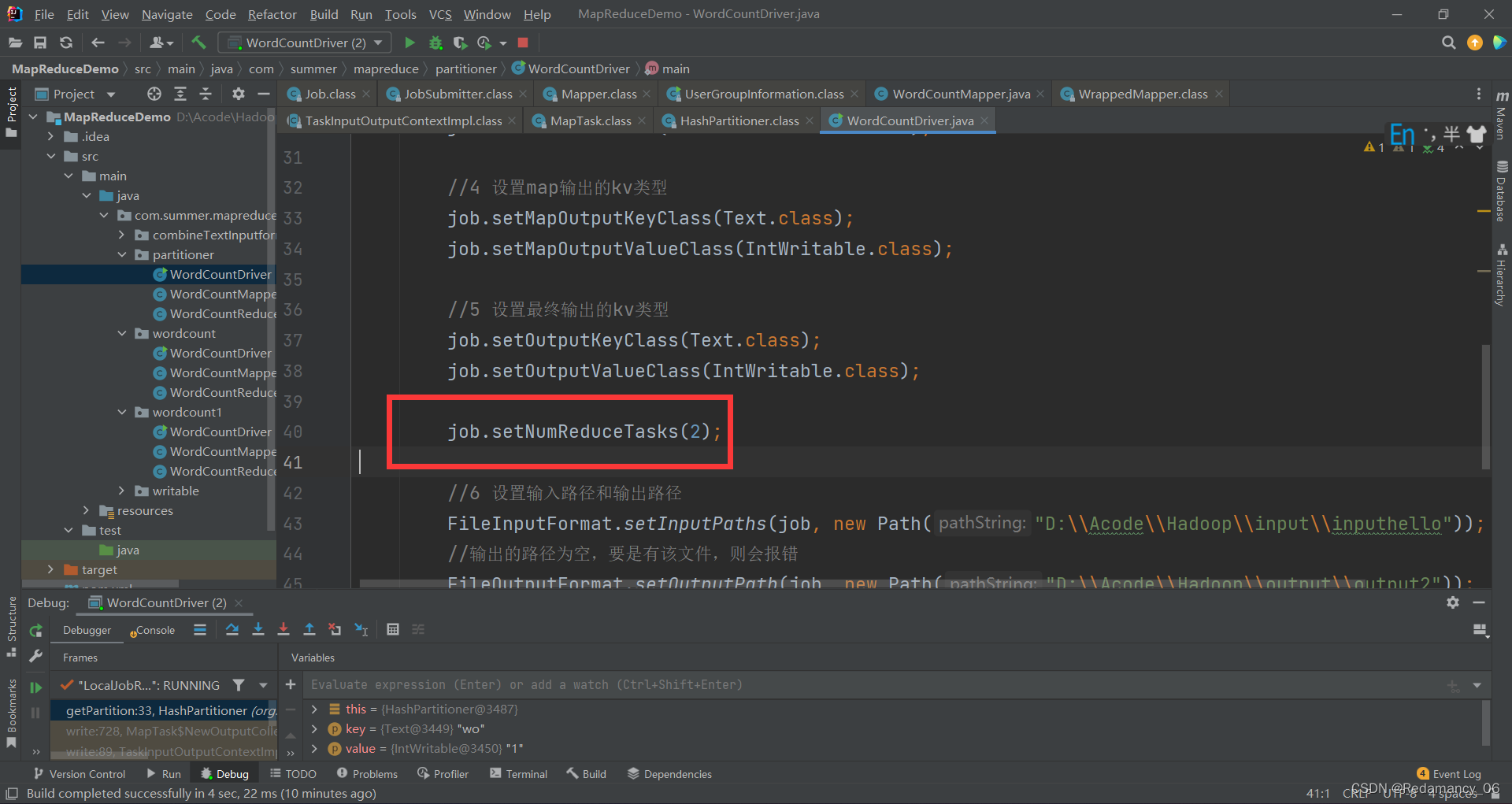

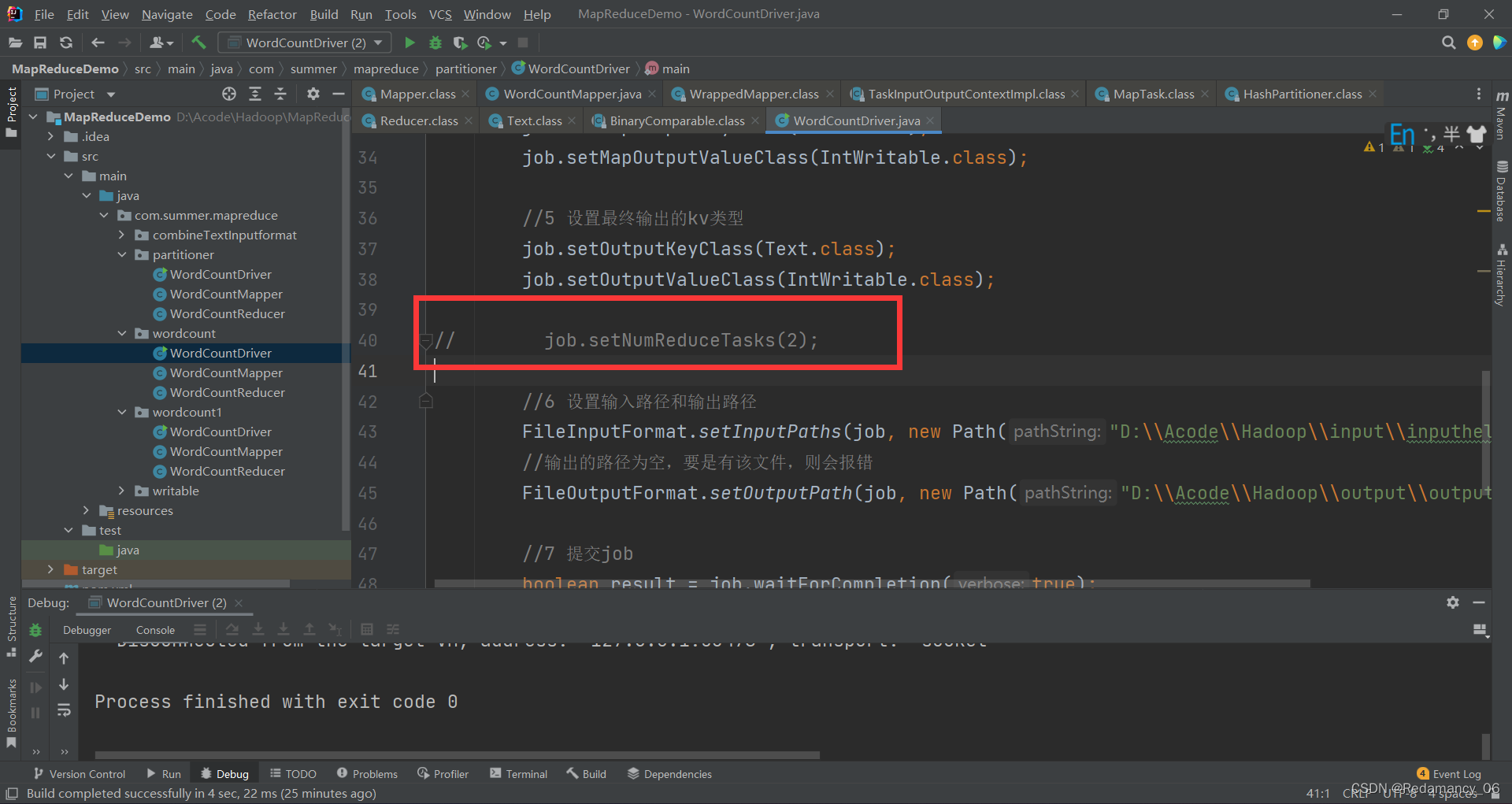

在代码里面加入job.setNumReduceTasks(2);这行代码,进行调试

在代码里面加入job.setNumReduceTasks(2);这行代码,进行调试

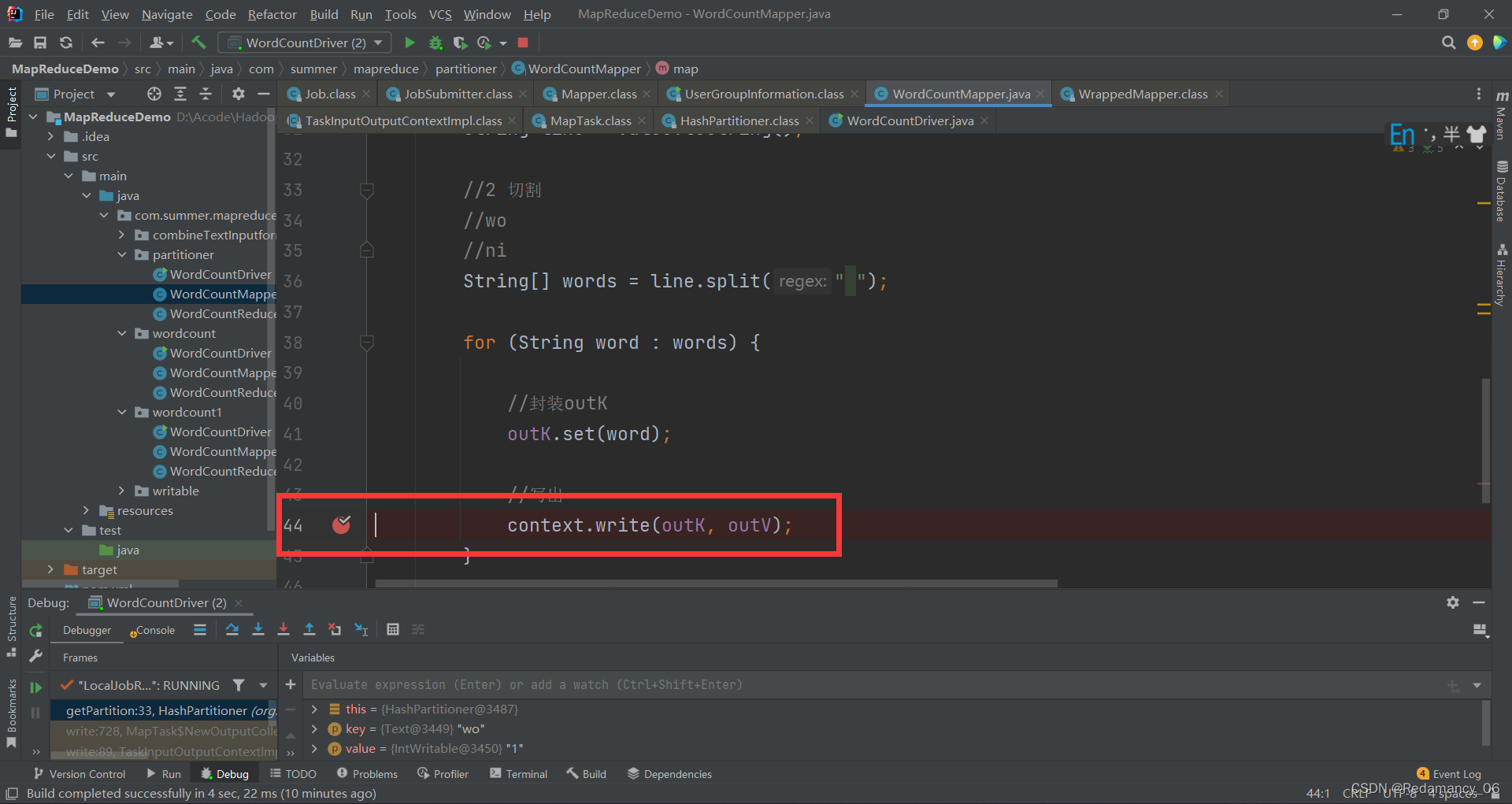

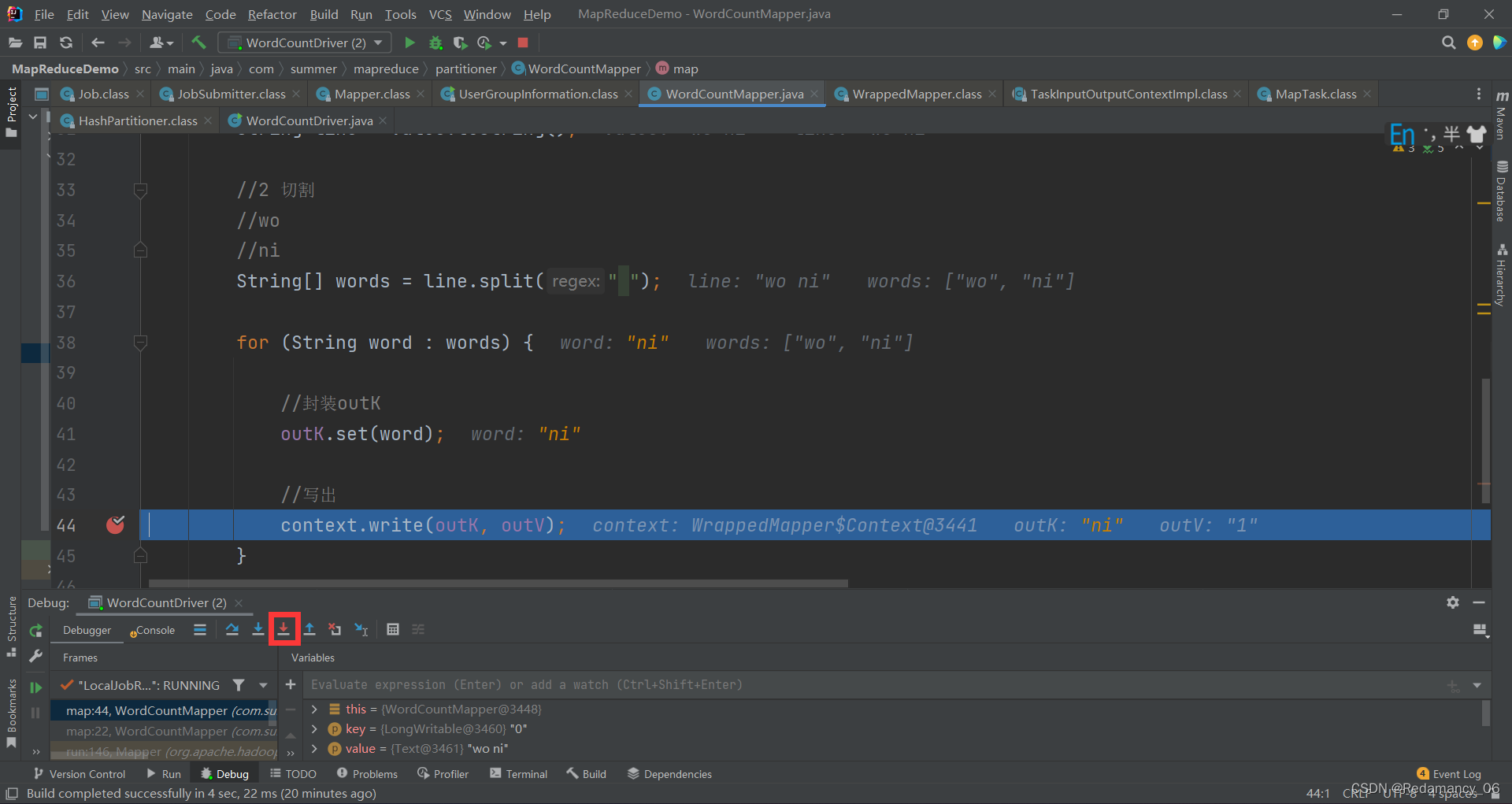

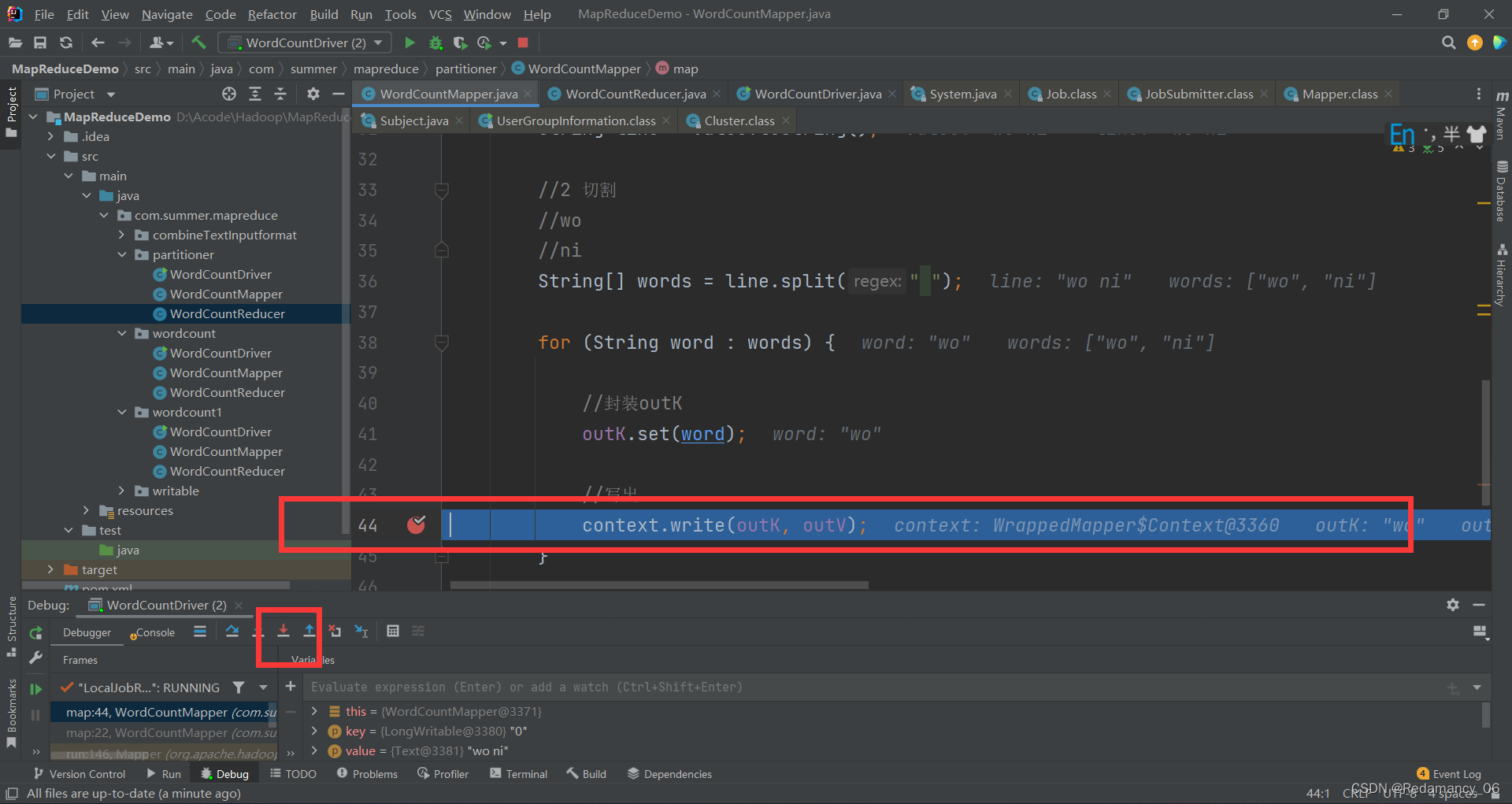

进行调试前先在mapper代码里面这里打上断点,因为进行分区的时候是在map阶段后,reduce阶段前,所以是在这里打断点。

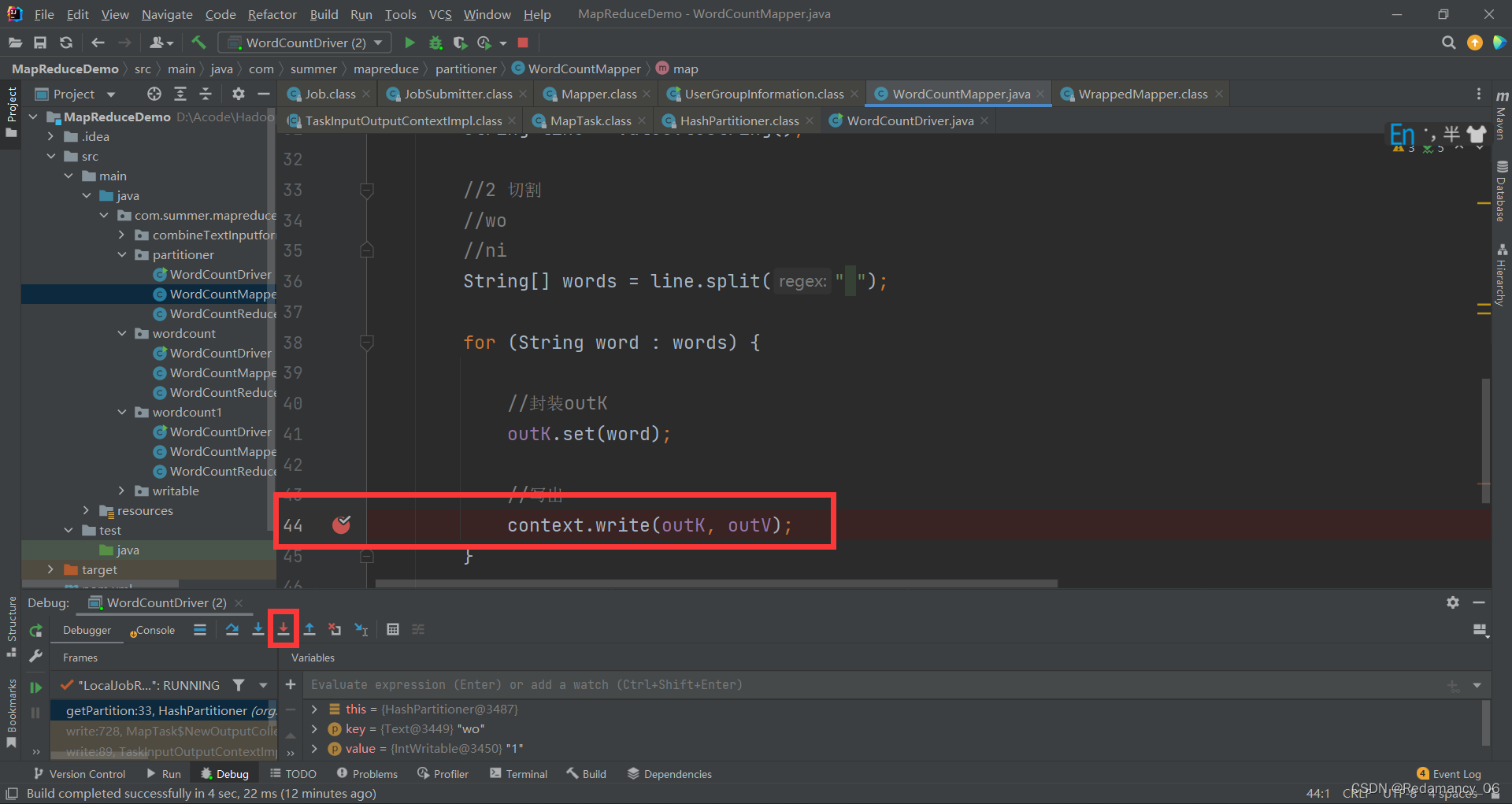

运行到这里的时候要强行进入

运行到这里的时候要强行进入

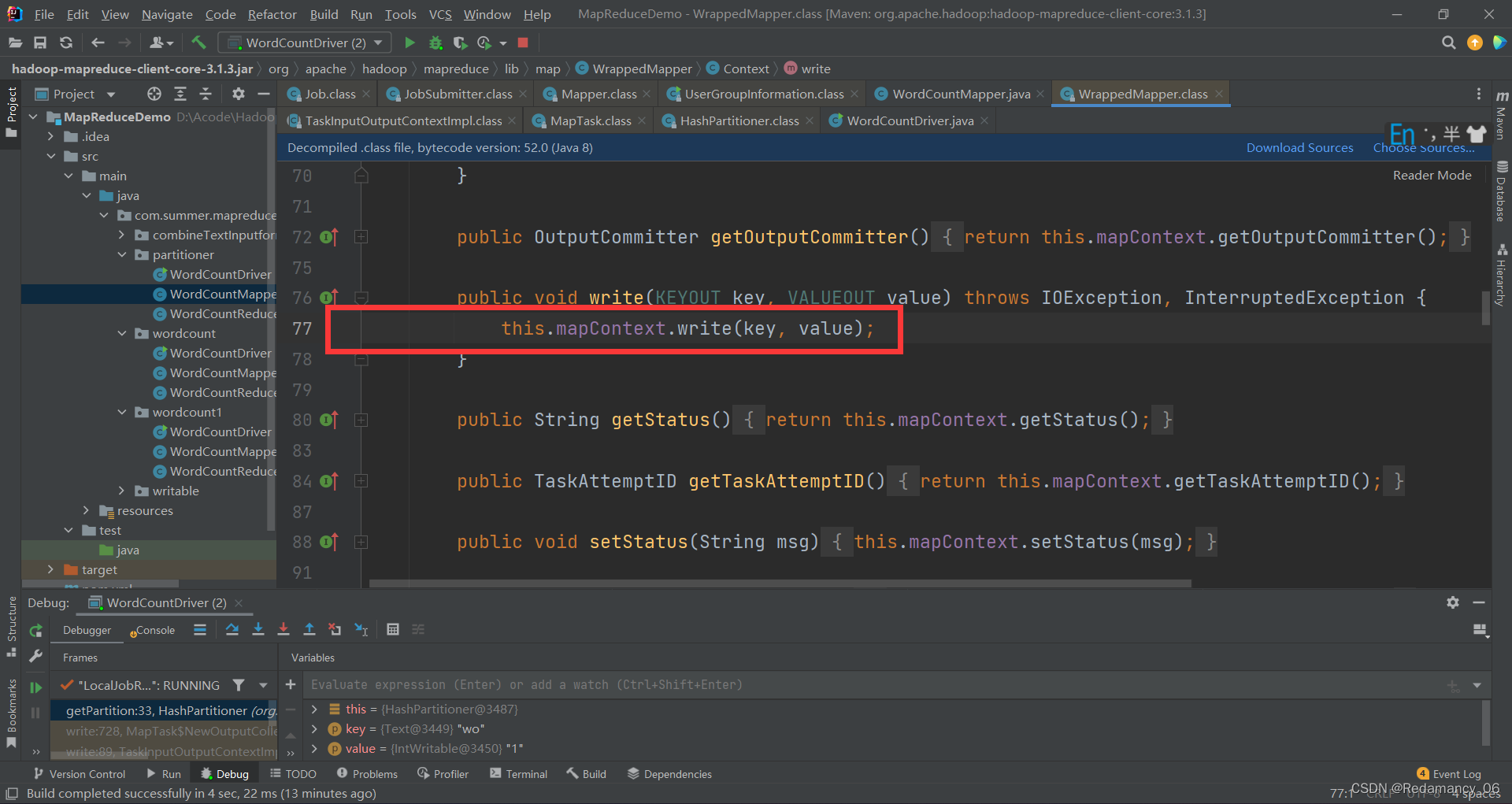

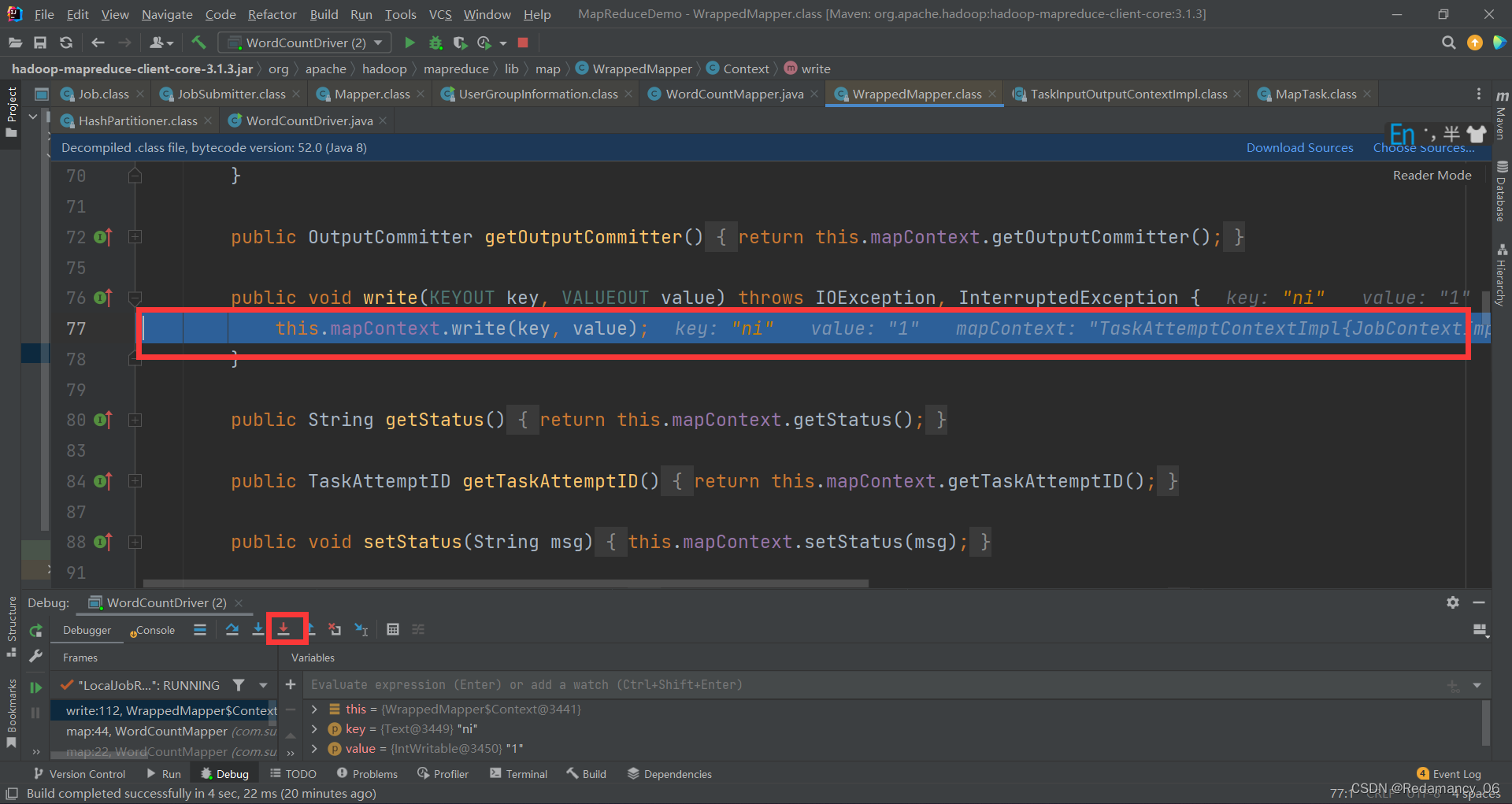

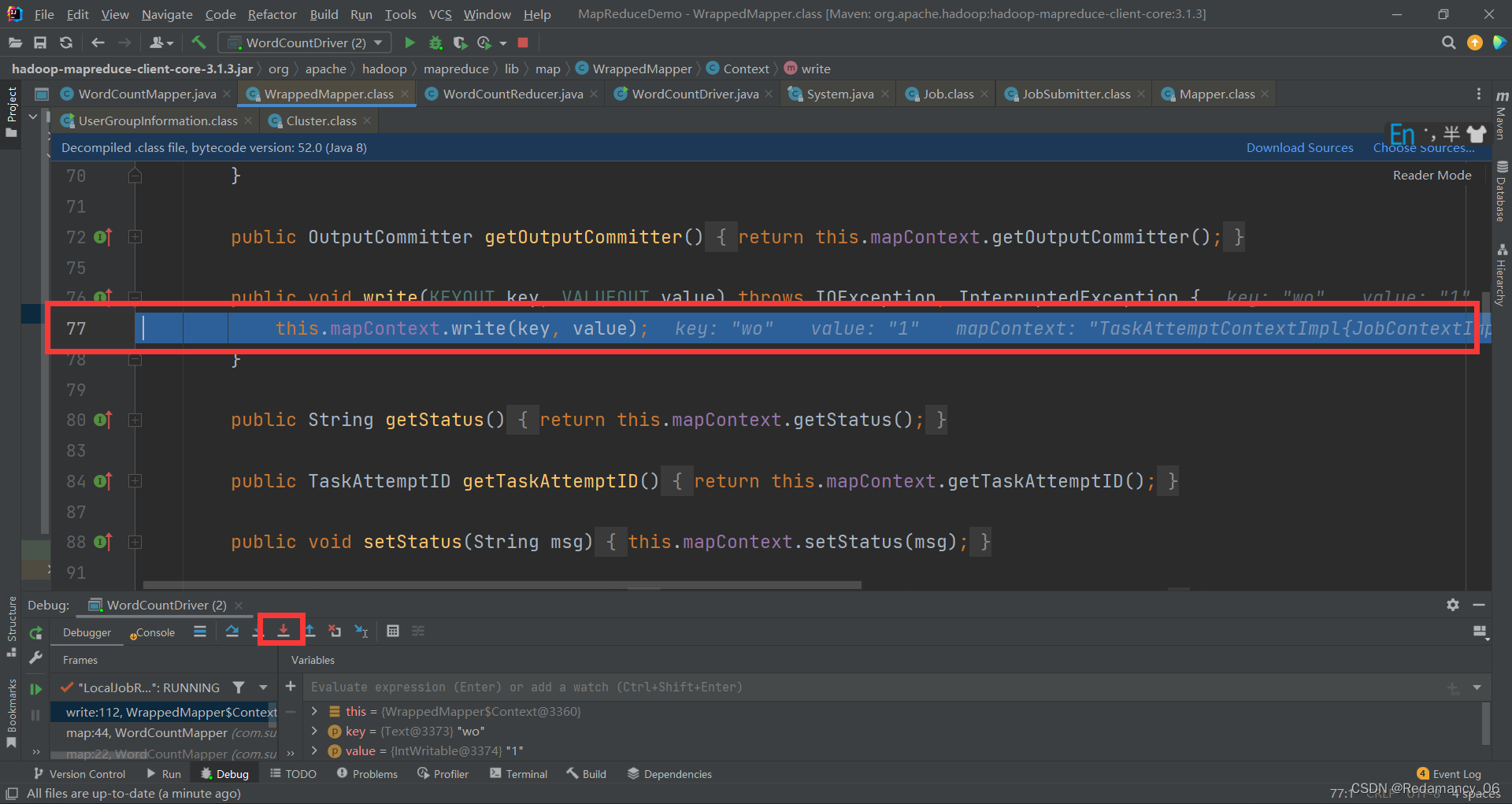

到this.mapContext.write(key, value);这里也要强行进入

到this.mapContext.write(key, value);这里也要强行进入

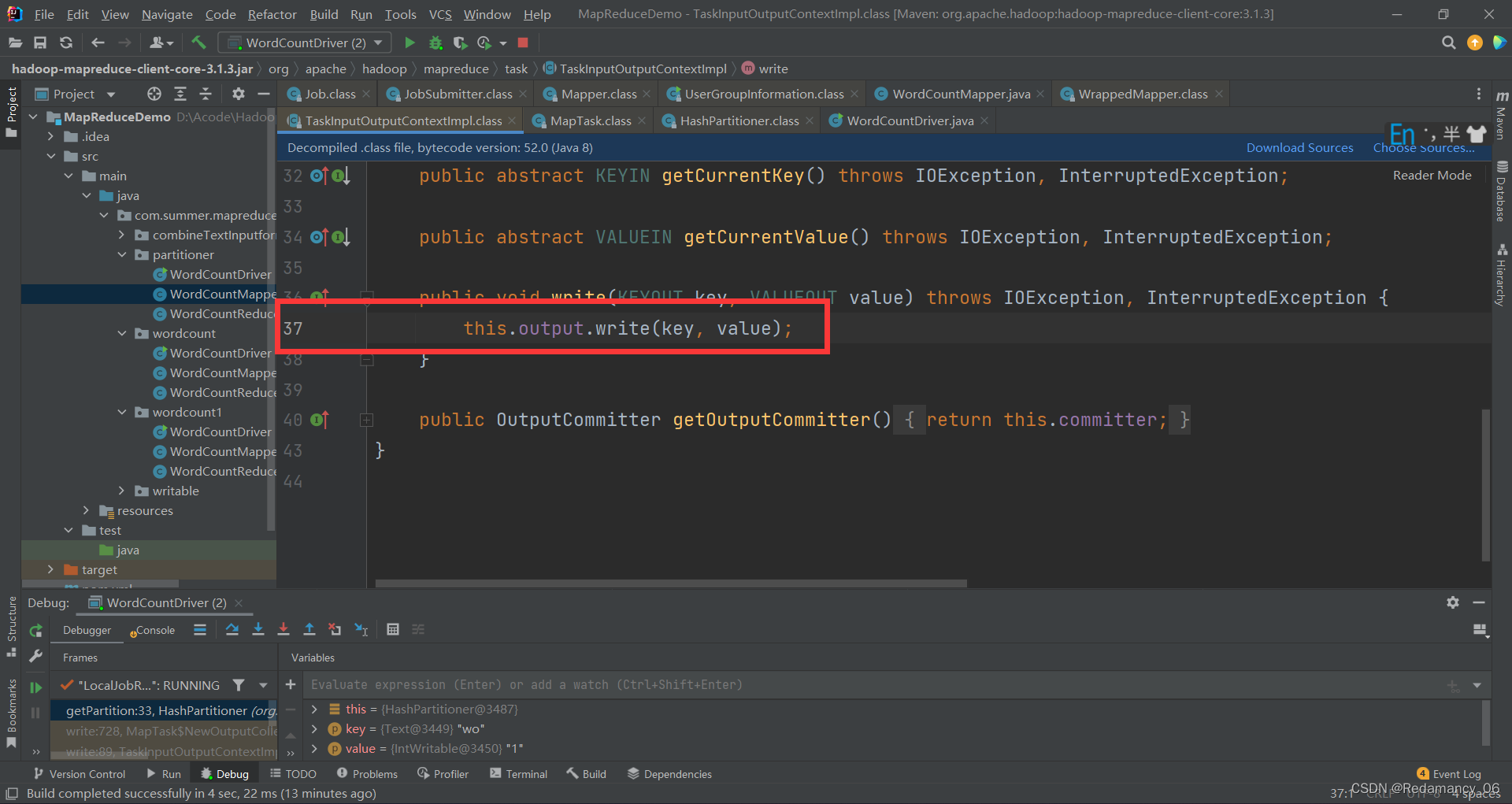

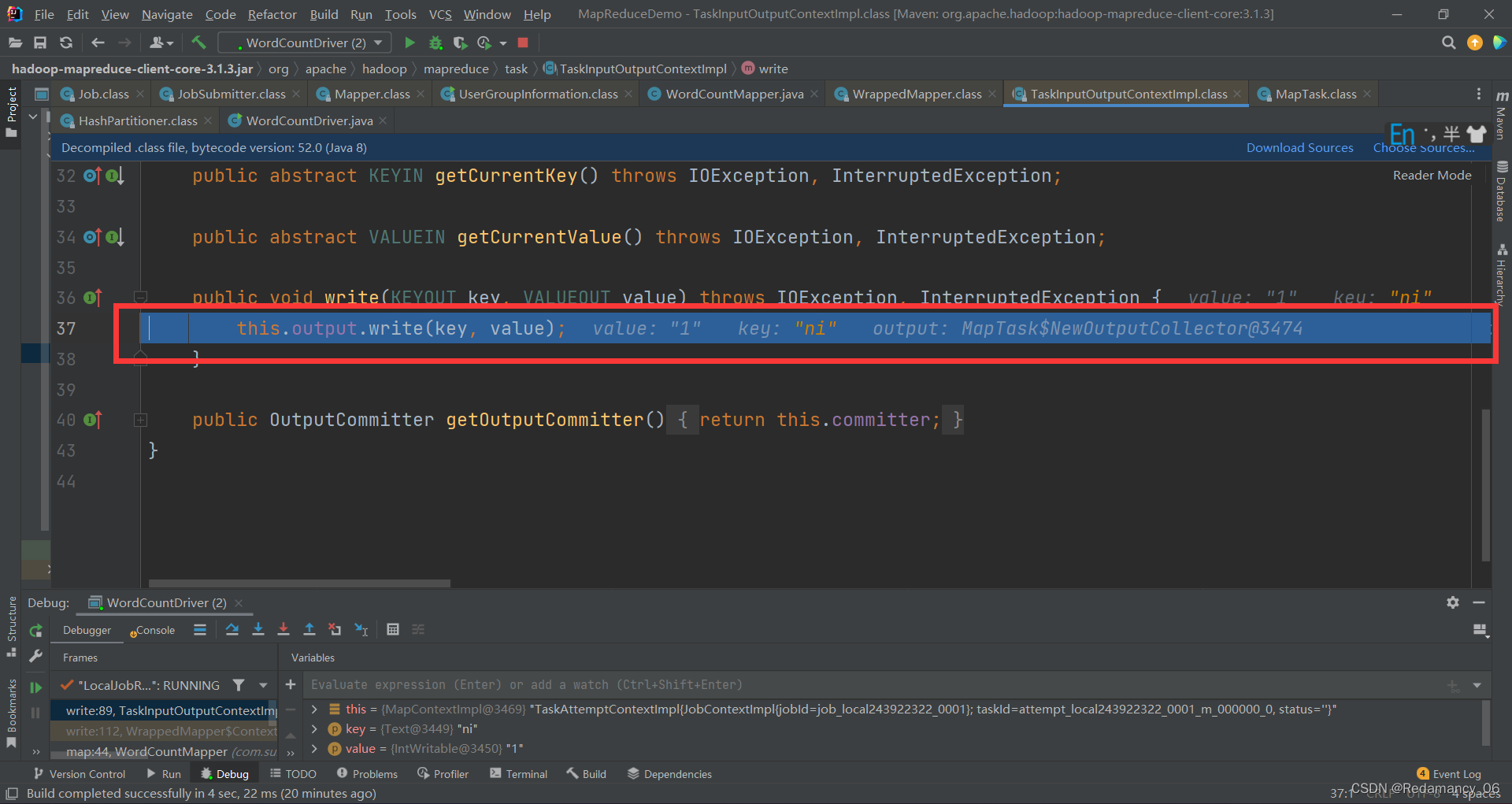

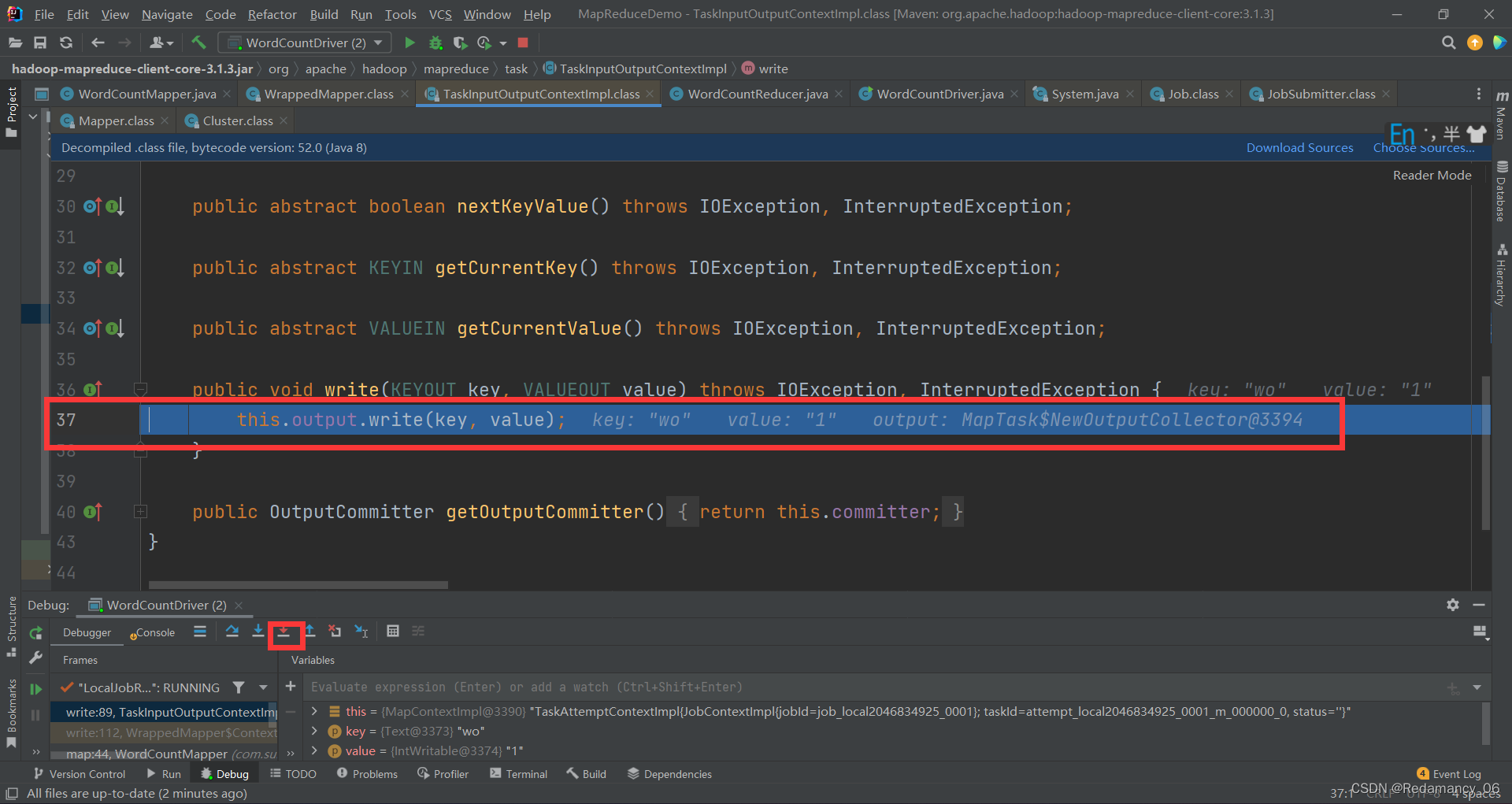

到this.output.write(key, value);这里也要强行进入

到this.output.write(key, value);这里也要强行进入

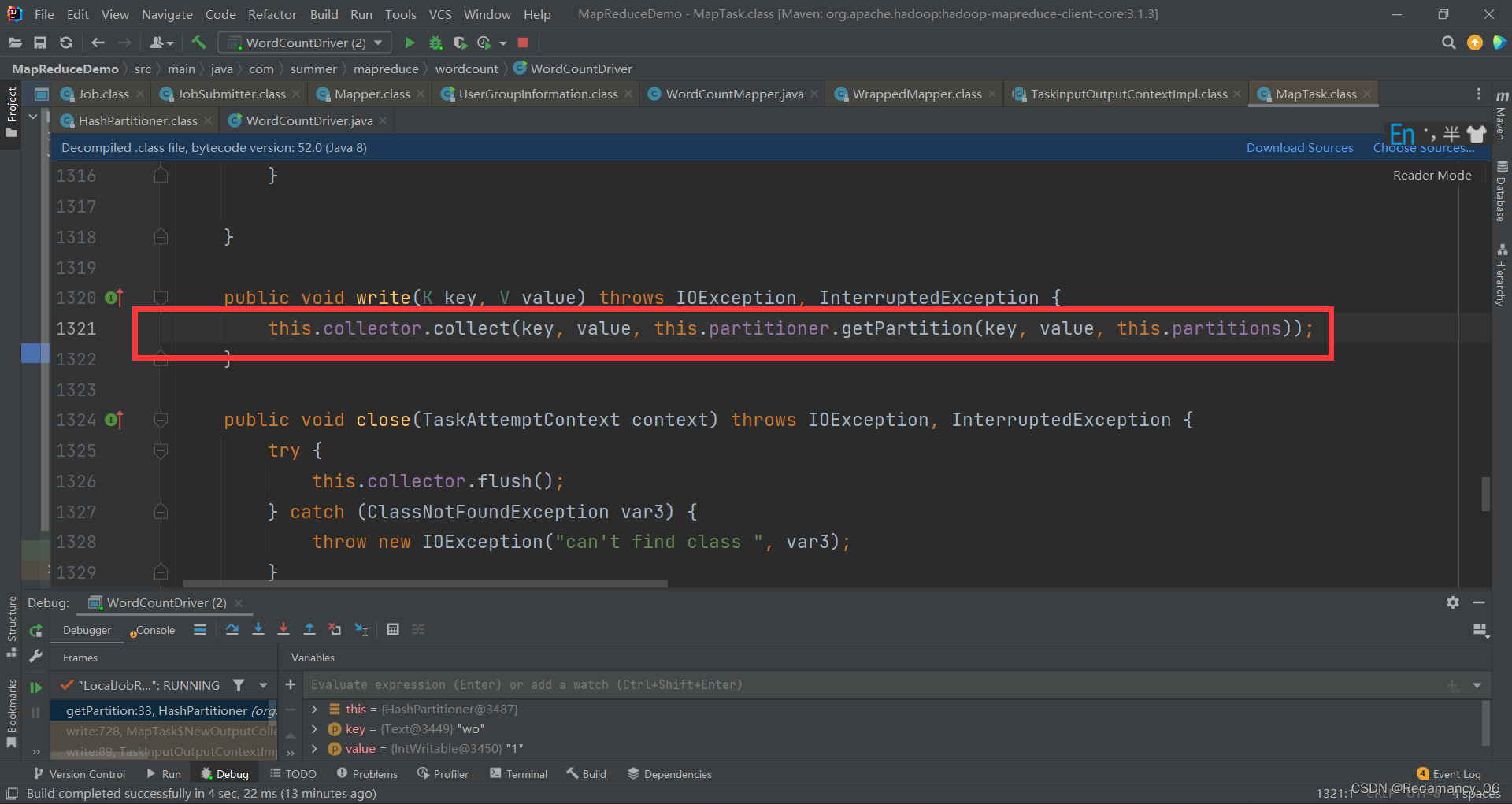

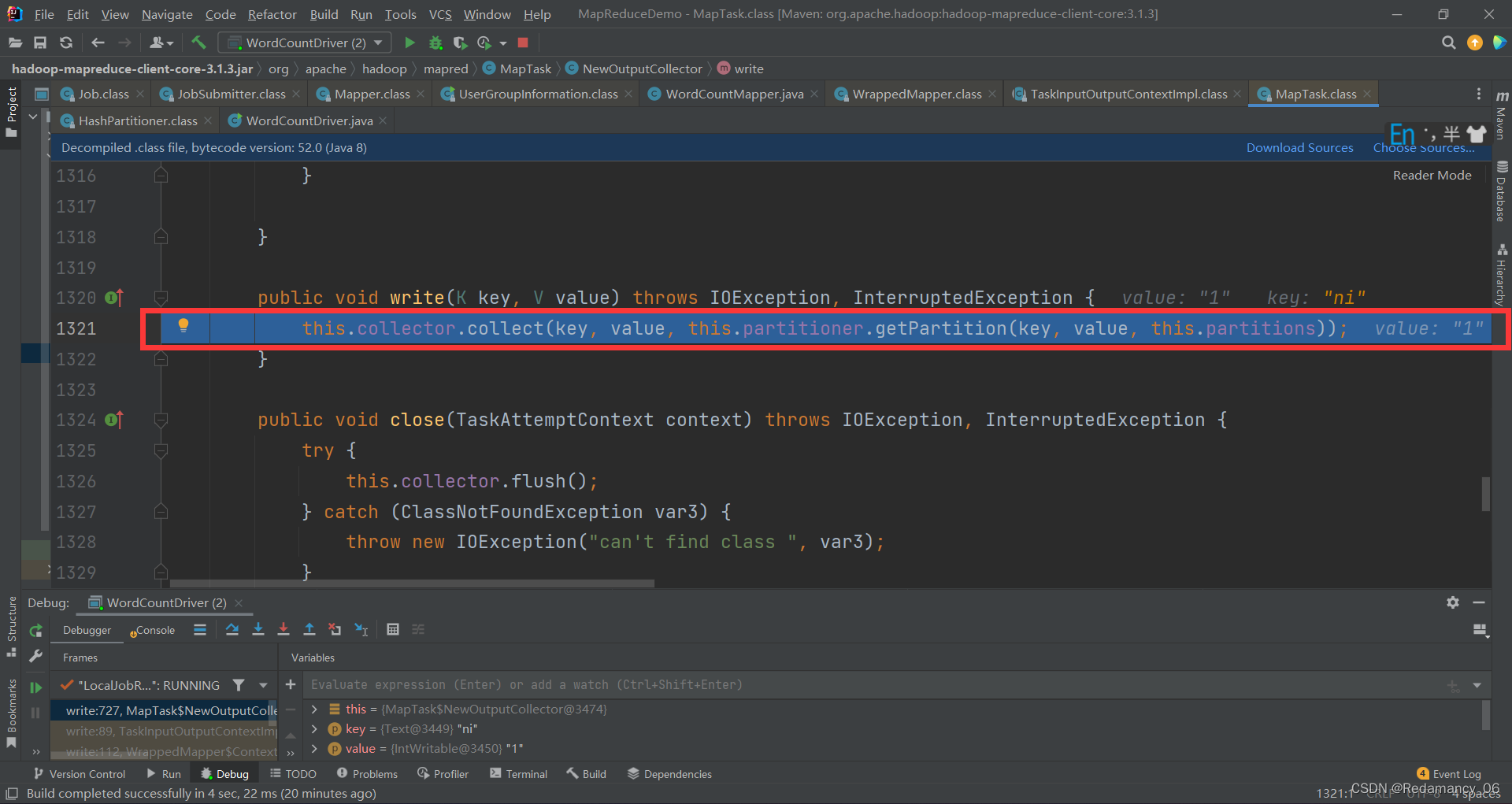

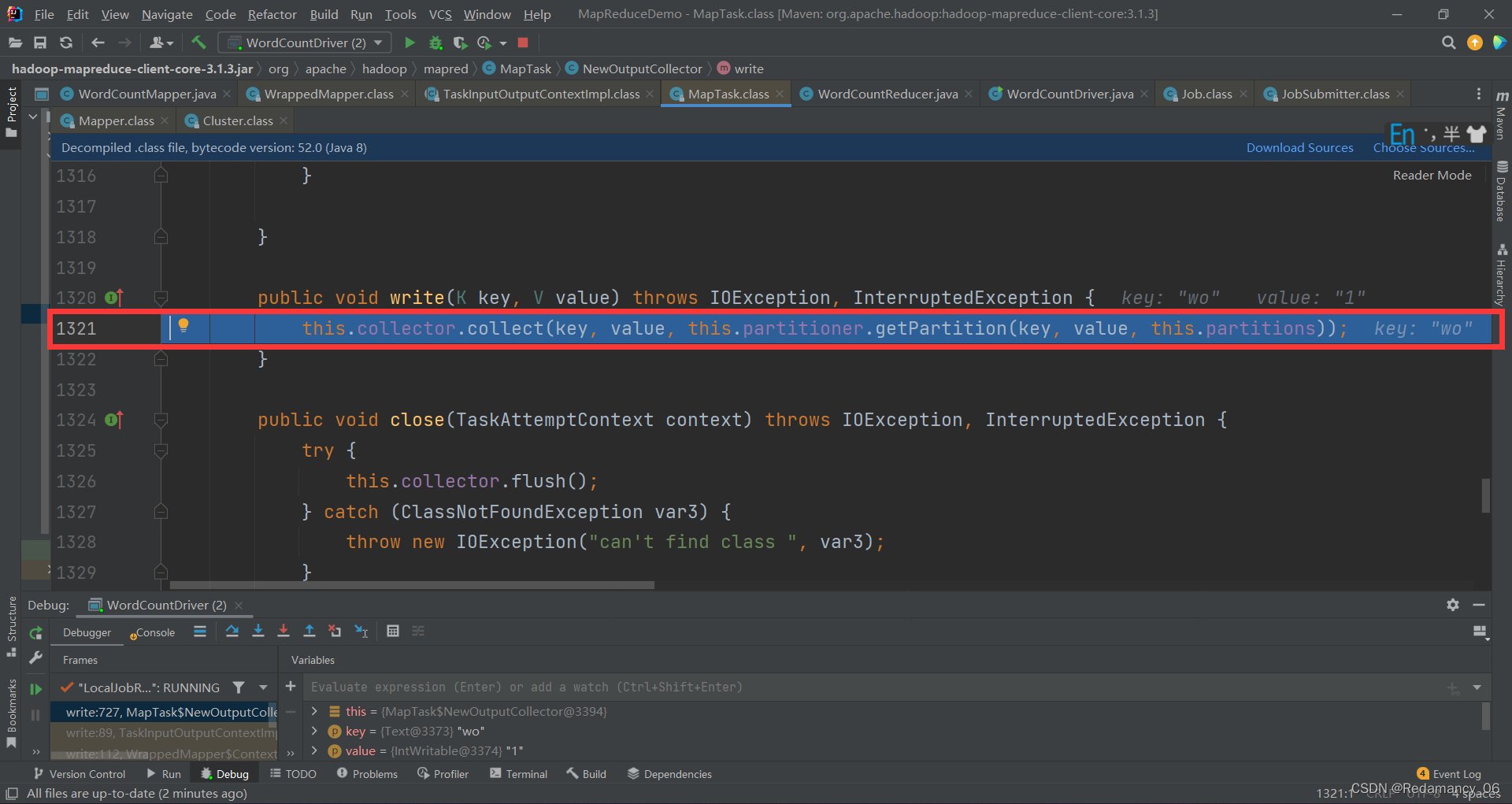

到this.collector.collect(key, value, this.partitioner.getPartition(key, value, this.partitions));这里在点两次强行进入

到this.collector.collect(key, value, this.partitioner.getPartition(key, value, this.partitions));这里在点两次强行进入

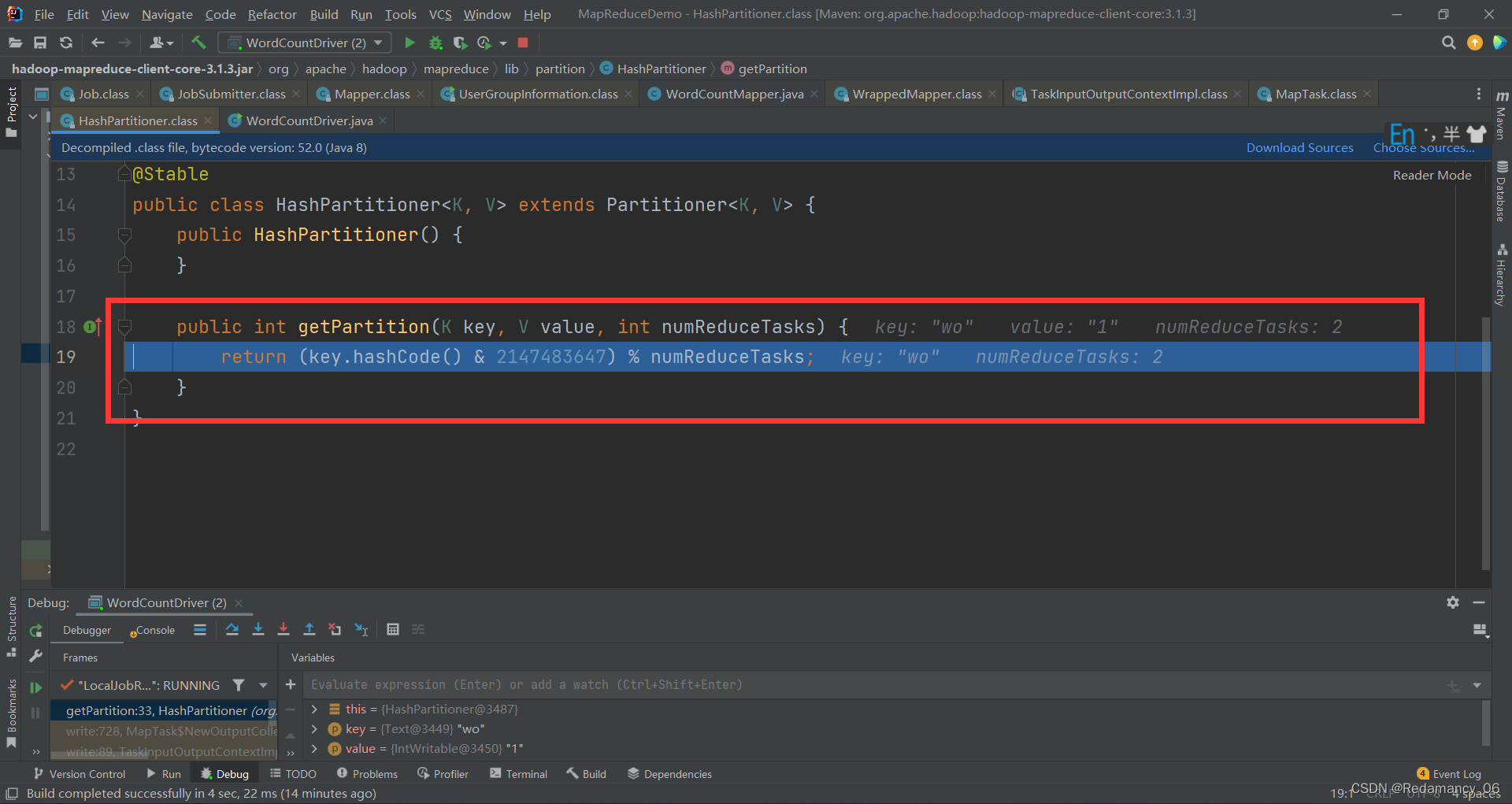

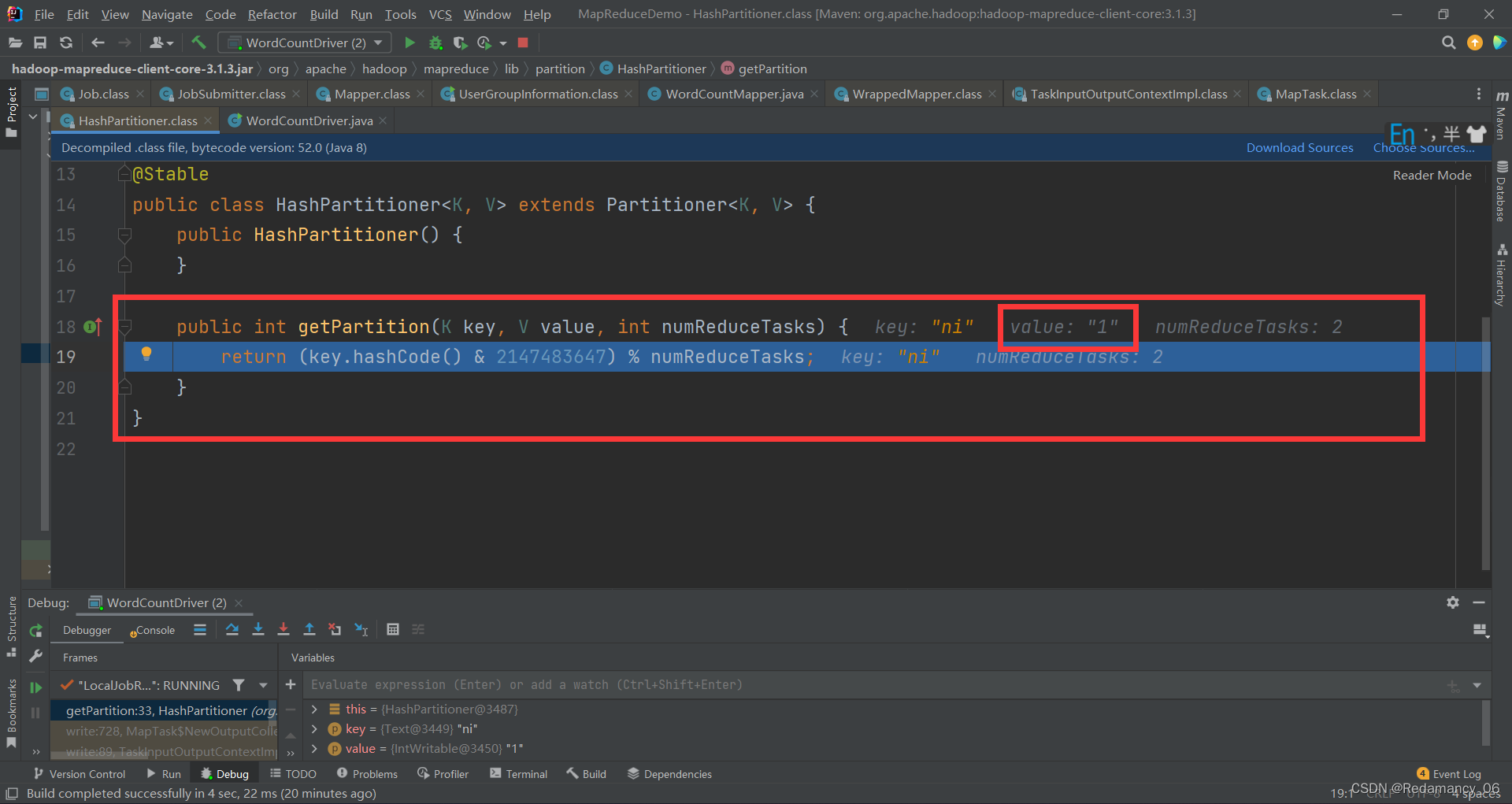

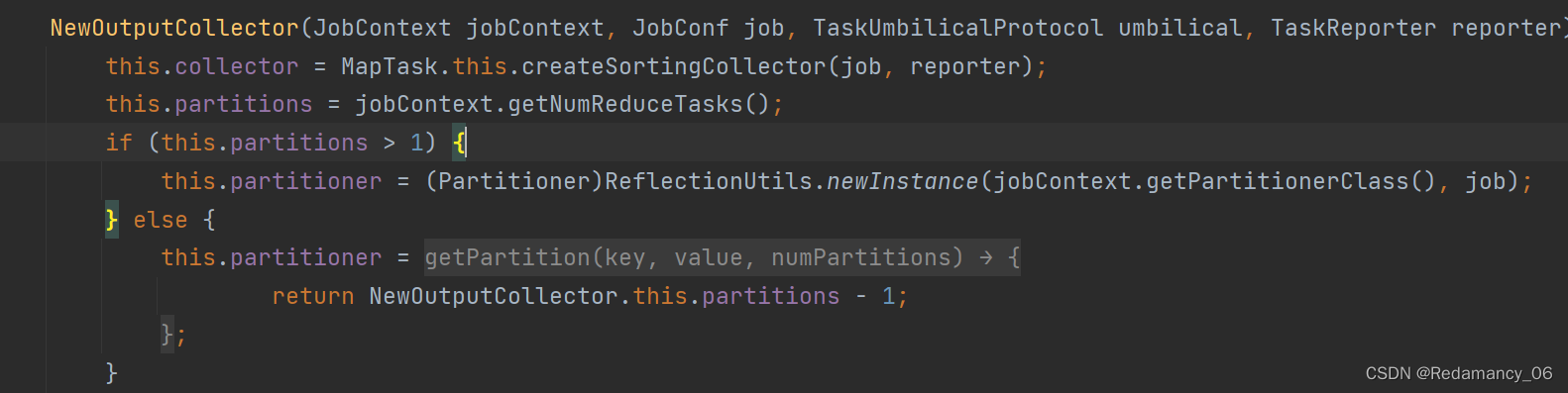

最终进入这里,这里是通过key值和全1的相与然后除以分区数取余进行分区的。

然后点全速看下一个值的key

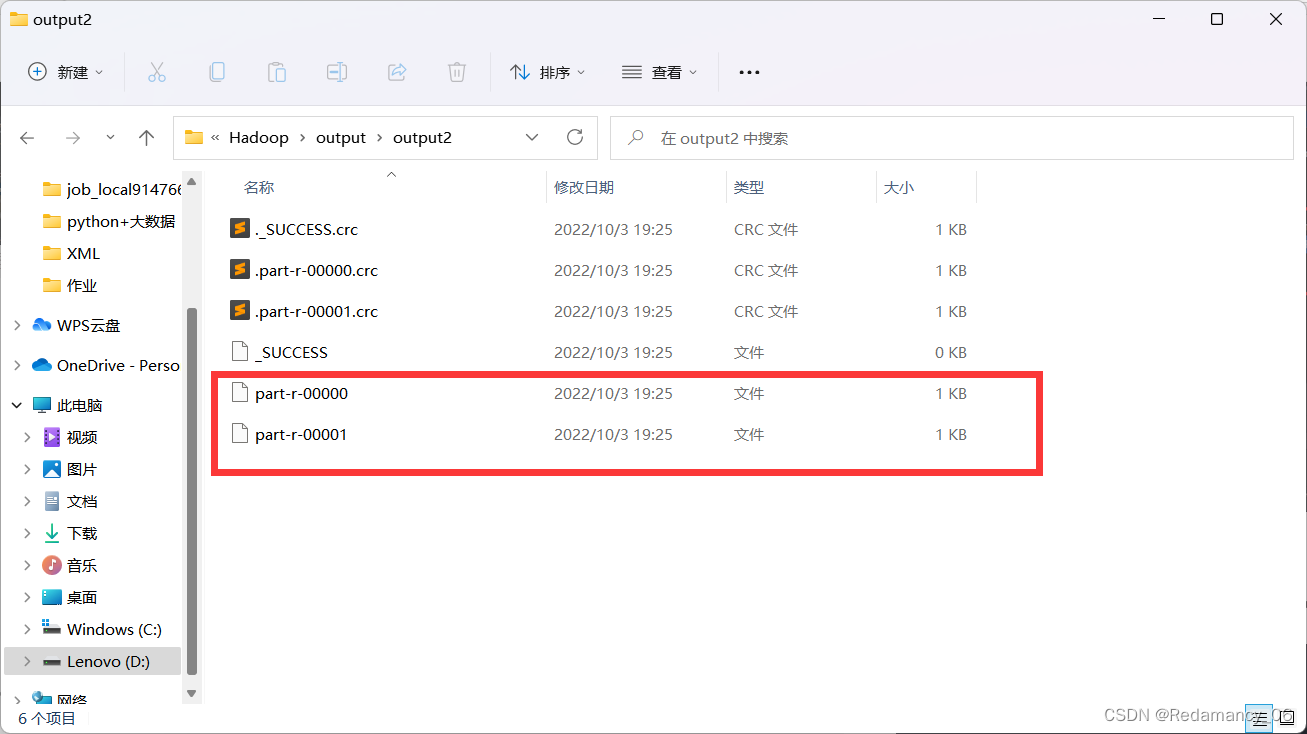

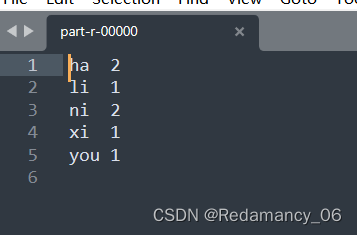

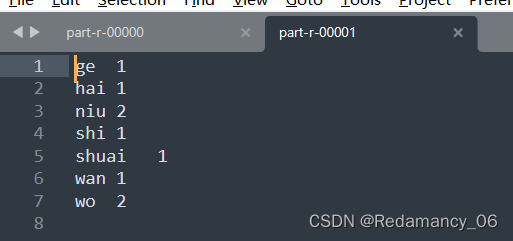

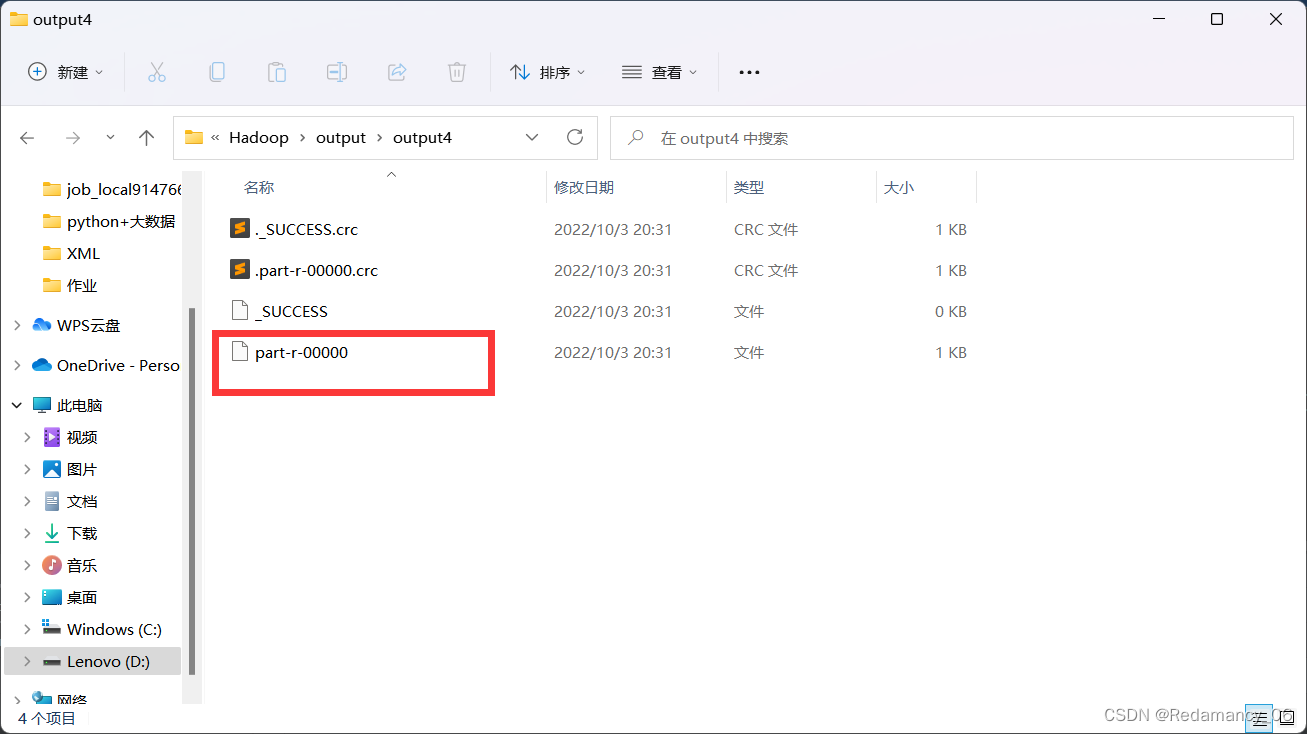

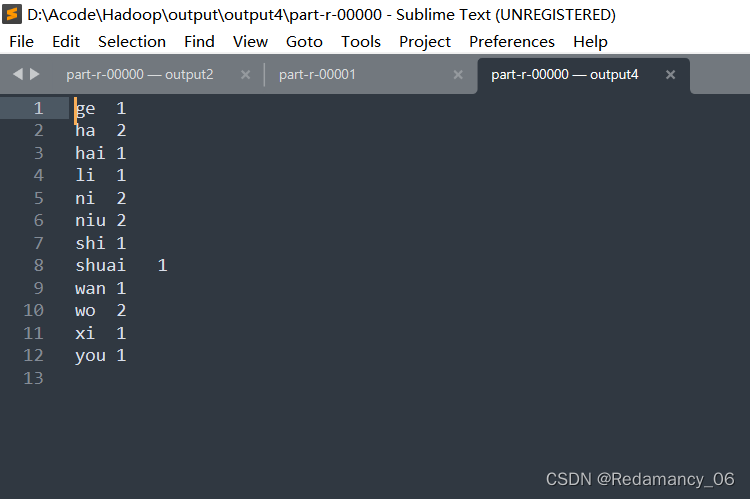

结束后就可以看到有两个分区了

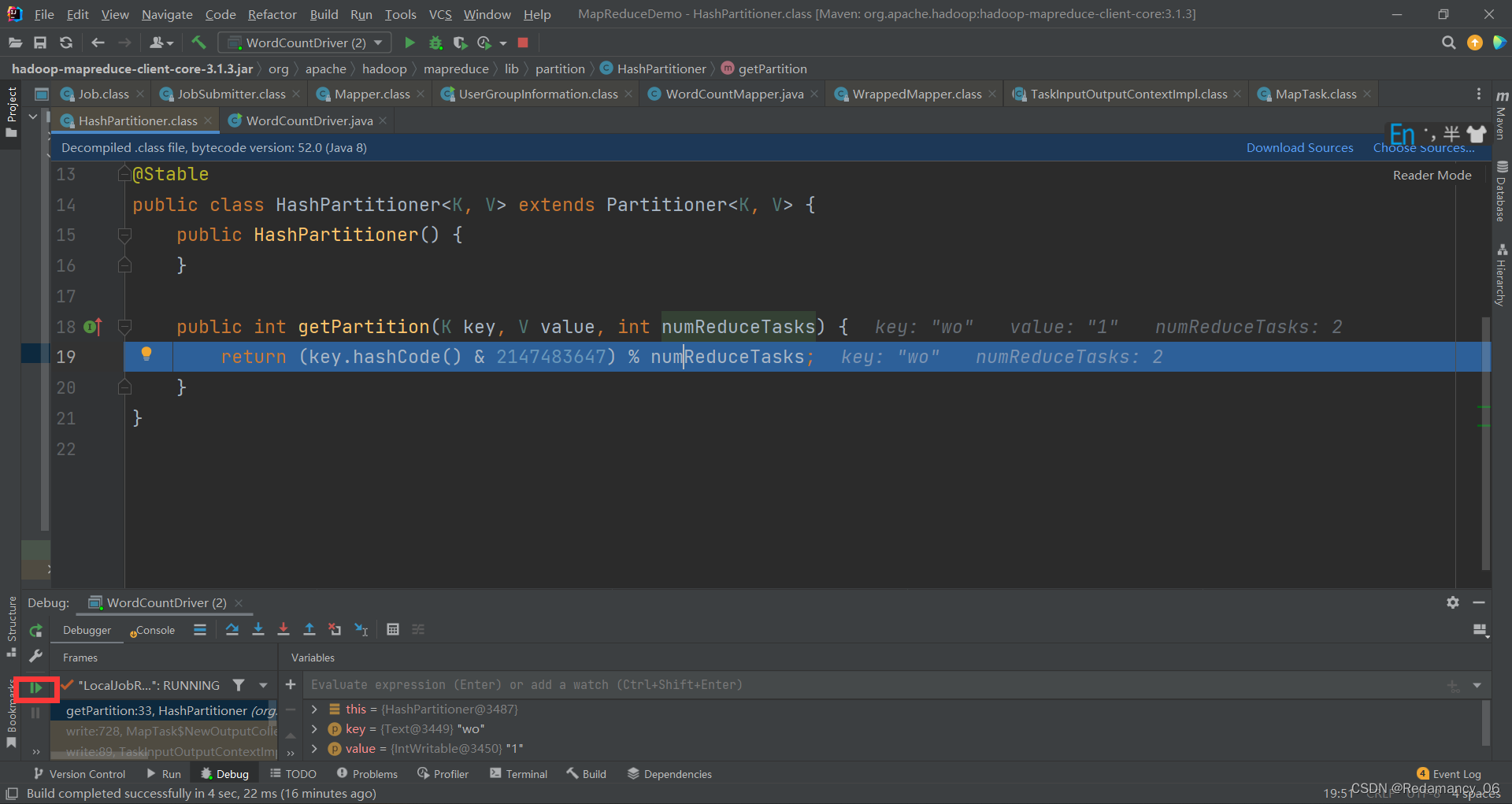

如果将job.setNumReduceTasks(2);这行代码注释掉,还能否进入HashPartitioner方法

如果将job.setNumReduceTasks(2);这行代码注释掉,还能否进入HashPartitioner方法

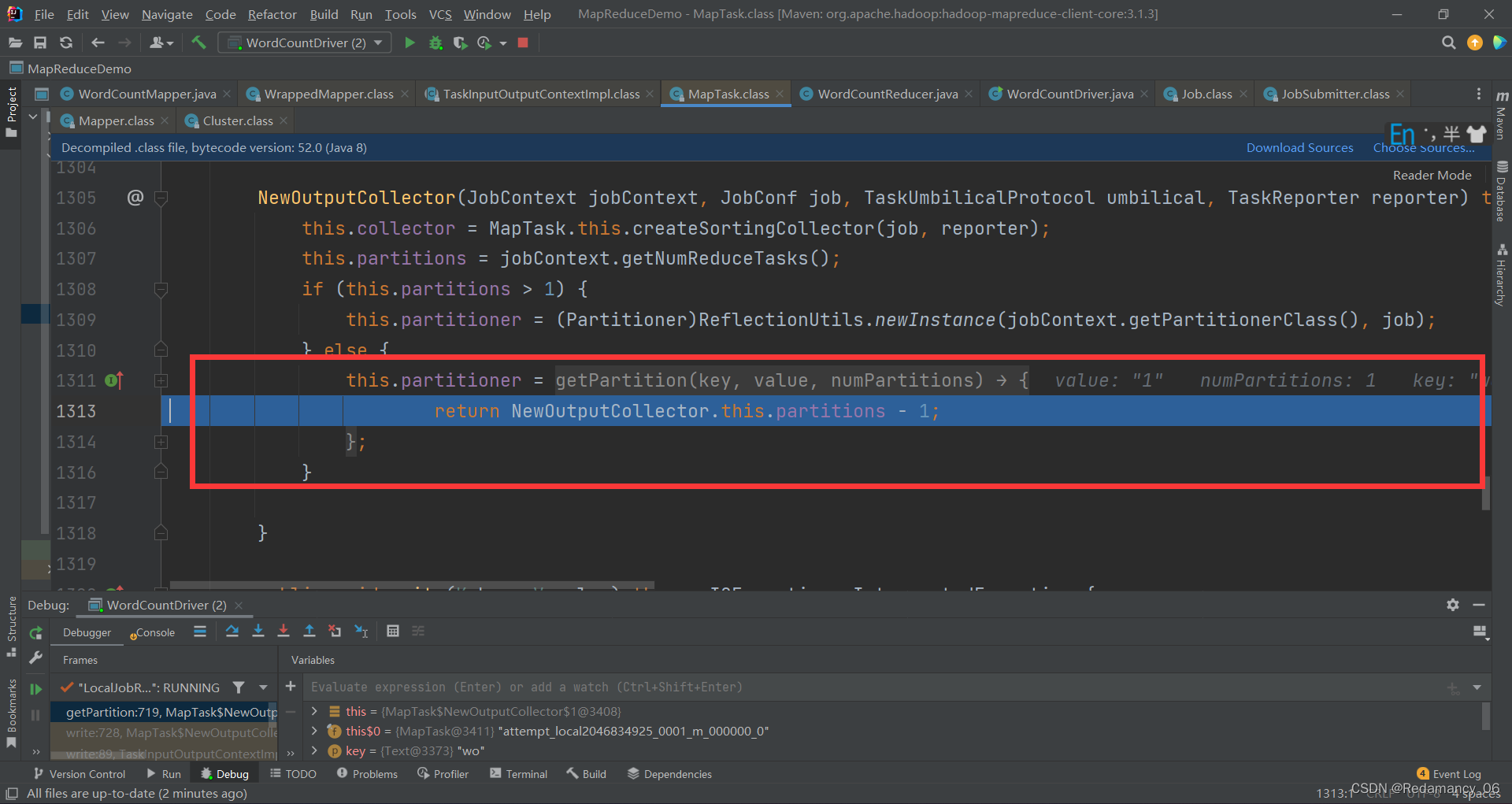

进行dug,到这一步强行进入

进行dug,到这一步强行进入

到这一步强行进入

到这一步强行进入

到这一步强行进入

到这一步强行进入

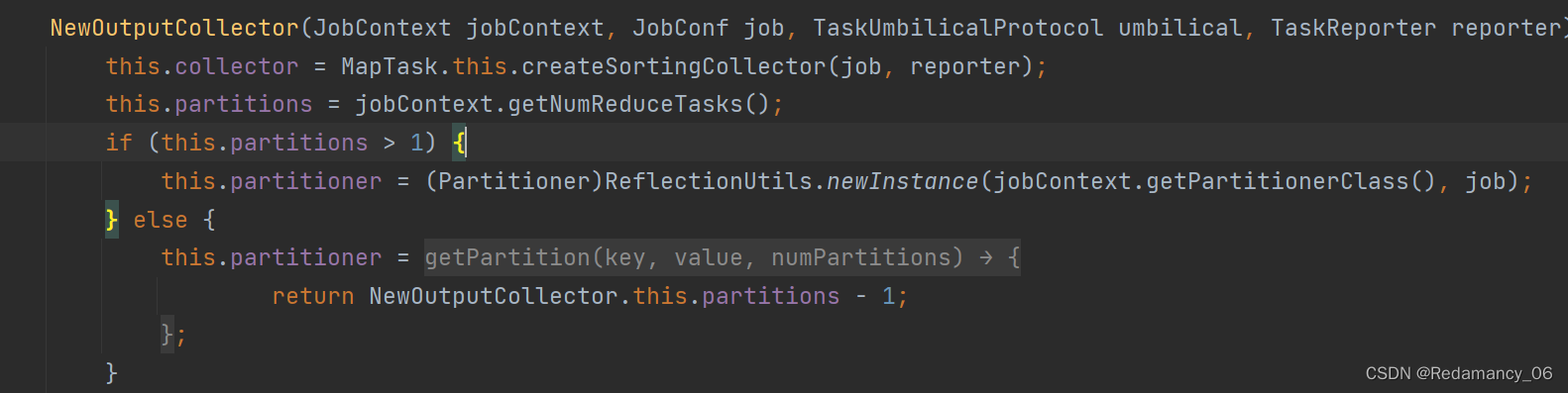

可以看出不能进入HashPartitioner方法

可以看出不能进入HashPartitioner方法

一个分区

如果分区partitions大于1,则走对应的分区,如果为默认值,则走内部类

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?