distinct

对RDD中的元素进行去重操作。

代码测试

测试数据准备

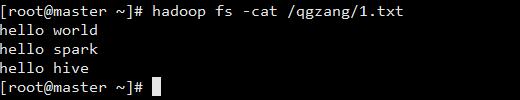

在hdfs上放一个文件1.txt

打开spark-shell

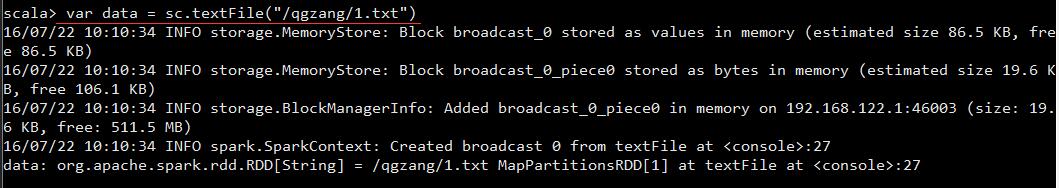

spark-shell --master spark://master:7077(重要的事情说多遍,spark-shell和spark-submit核心的参数是差不多的)创建RDD

var data = sc.textFile("/qgzang/1.txt") 测试distinct 算子

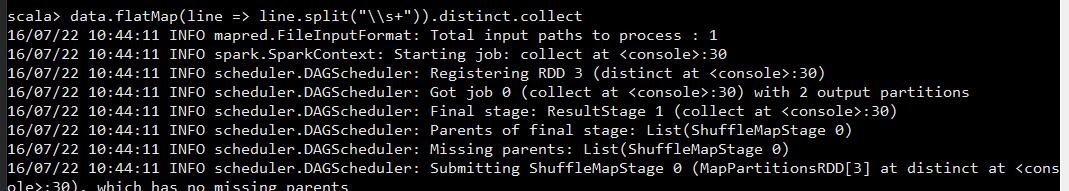

scala> data.flatMap(line => line.split("\\s+")).collect

res61: Array[String] = Array(hello, world, hello, spark, hello, hive, hi, spark)

scala> data.flatMap(line => line.split("\\s+")).distinct.collect

res62: Array[String] = Array(hive, hello, world, spark, hi)

17万+

17万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?