一、逻辑斯蒂回归概述

(1)逻辑斯蒂回归的目的:分类。

逻辑斯蒂回归常常解决分类问题,特别是二分类问题。

(2)逻辑斯蒂回归的过程:回归。

计算结果是0~1之间的连续值,代表发生的可能性(类概率)。

(3)阈值:通过可能性和阈值的比较完成分类。

如:算出违约的可能性,如果大于0.5,则将借款人分类为坏客户。

二、逻辑斯蒂回归模型

由于二分类问题中,标签只有是和否(1和0),如果用线性回归进行拟合,线性回归的值域不在0 ~ 1之间,预测结果难以作为可能性输出。而如果用分段函数进行拟合,由于分段函数并不连续,预测结果不是我们希望的可能性0 ~ 1的连续值。

解决办法就是将线性回归和sigmoid函数结合起来,即组成一个嵌套函数。

sigmoid函数图像:

组成的嵌套函数:

三、逻辑斯蒂回归的损失函数

如果直接将最小二乘法中的 y ^ \hat y y^ 替换成sigmoid函数作为逻辑斯蒂回归的损失函数来求最小值,会发现这个函数并不是凸函数,因此采用别的损失函数。

(1)二分类问题中y的概率

由于约定 y ^ = P ( y = 1 ∣ x ) \hat y=P(y=1|x) y^=P(y=1∣x) ,所以:

y = 1 y=1 y=1 时, P ( y ∣ x ) = y ^ P(y|x)=\hat y P(y∣x)=y^

y = 0 y=0 y=0 时, P ( y ∣ x ) = 1 − y ^ P(y|x)=1-\hat y P(y∣x)=1−y^

合并得到:

P ( y ∣ x ) = y ^ y ( 1 − y ^ ) ( 1 − y ) P(y|x)={\hat y}^y(1-\hat y)^{(1-y)} P(y∣x)=y^y(1−y^)(1−y)

(2)利用最大似然估计法估计模型参数

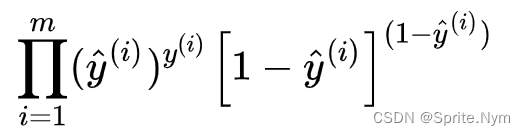

似然函数为:

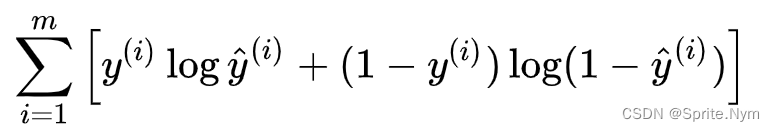

对数似然函数为:

对极大似然函数求极大值,即可得到最理想的参数值。因此对于整个训练集,可以将代价函数定义为:

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?