Hadoop平台安装

一.实验环境

服务器集群 :单节点,机器最低配置:双核 CPU、8GB 内存、100G 硬盘

运行环境: CentOS 7.4

服务和组件 :服务和组件根据实验需求安装

实验任务一:配置 Linux 系统基础环境

步骤一:查看服务器的 IP 地址

查看服务器的 IP 地址

[root@localhost ~]# ip add show

步骤二:设置服务器的主机名称

[root@localhost ~]# hostnamectl set-hostname mas

[root@localhost ~]# bash

[root@master ~]# hostname

骤步三:绑定主机名与 IP 地址

[root@master ~]# vi /etc/hosts

步骤四:查看 SSH 状态

[root@master ~]# systemctl status sshd

步骤五:关闭防火墙

[root@master ~]# systemctl stop firewalld

关闭防火墙后要查看防火墙的状态,确认一下。

[root@master ~]# systemctl status firewalld

执行如下命令可以永久关闭防火墙。

[root@master ~]# systemctl disable firewalld

步骤六:创建 hadoop 用户

[root@master ~]# useradd hadoop

[root@master ~]# echo "1" |passwd --stdin hadoop

实验任务二:安装 JAVA 环境

步骤一:下载 JDK 安装包

JDK 安 装 包 需 要 在 Oracle 官 网 下 载 , 下 载 地 址 为 : 20 https://www.oracle.com/java /technologies /javase-jdk8-downloads.html,本教材采用 的 Hadoop 2.7.1 所需要的 JDK 版本为 JDK7 以上,这里采用的安装包为 jdk-8u152-linuxx64.tar.gz。

步骤二:卸载自带 OpenJDK

[root@master ~]# rpm -qa | grep java

javapackages-tools-3.4.1-11.el7.noarch

java-1.8.0-openjdk-1.8.0.352.b08-2.el7_9.x86_64

tzdata-java-2022e-1.el7.noarch

python-javapackages-3.4.1-11.el7.noarch

java-1.8.0-openjdk-headless-1.8.0.352.b08-2.el7_9.x86_64

卸载相关服务,键入命令

[root@master ~]# rpm -e --nodeps javapackages-tools-3.4.1-11.el7.noarch

[root@master ~]# rpm -e --nodeps java-1.8.0-openjdk-1.8.0.352.b08- 2.el7_9.x86_64

[root@master ~]# rpm -e --nodeps tzdata-java-2022e-1.el7.noarch

[root@master ~]# rpm -e --nodeps python-javapackages-3.4.1-11.el7.noarch

[root@master ~]# rpm -e --nodeps java-1.8.0-openjdk-headless-1.8.0.352.b08- 2.el7_9.x86_64

[root@master ~]# rpm -qa | grep java

查看删除结果再次键入命令 java -version 出现以下结果表示删除功

[root@master ~]# java --version

bash: java: 未找到命令

步骤三:安装 JDK

[root@master ~]# tar -zxvf /opt/software/jdk-8u152-linux-x64.tar.gz -C /usr/local/src/

[root@master ~]# ls /usr/local/src/

[root@master ~]# vi /etc/profile

在文件的最后增加如下两行:

export JAVA_HOME=/usr/local/src/jdk1.8.0_152

export PATH=$PATH:$JAVA_HOME/bin

执行 source 使设置生效:

[root@master ~]# source /etc/profile

检查 JAVA 是否可用。

[root@master ~]# echo $JAVA_HOME

[root@master ~]# java -version

实验二 安装 Hadoop 软件

实验任务一:获取 Hadoop 安装包

Apache Hadoop 各 个 版 本 的 下 载 网 址 : https://archive.apache.org/dist/hadoop /common/。本教材选用的是 Hadoop 2.7.1 版本,安装包为 hadoop-2.7.1.tar.gz。需要先下载 Hadoop 安装包,再上传到 Linux 系统的/opt/software 目录。具体的方法见前一节“实验一 Linux 操作系统环境 设置”,这里就不再赘述

实验任务二:安装 Hadoop 软件

步骤一:安装 Hadoop 软件

安装命令如下,将安装包解压到/usr/local/src/目录下

[root@master ~]# tar -zxvf /opt/software/hadoop-2.7.1.tar.gz -C /usr/local/src/

[root@master ~]# ll /usr/local/src/

查看 Hadoop 目录,得知 Hadoop 目录内容如下:

[root@master ~]# ll /usr/local/src/hadoop-2.7.1/

步骤二:配置 Hadoop 环境变量

和设置 JAVA 环境变量类似,修改/etc/profile 文件。 [root@master ~]# vi /etc/profile

在文件的最后增加如下两行:

export HADOOP_HOME=/usr/local/src/hadoop-2.7.1

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

执行 source 使用设置生效:

[root@master ~]# source /etc/profile

检查设置是否生效:

[root@master ~]# hadoop

步骤三:修改目录所有者和所有者组

上述安装完成的 Hadoop 软件只能让 root 用户使用,要让 hadoop 用户能够 运行 Hadoop 软件,需要将目录/usr/local/src 的所有者改为 hadoop 用户。

[root@master ~]# chown -R hadoop:hadoop /usr/local/src/

[root@master ~]# ll /usr/local/src/

实验三 安装单机版 Hadoop 系统

实验任务一:配置 Hadoop 配置文件

[root@master ~]# cd /usr/local/src/hadoop-2.7.1/

[root@master hadoop-2.7.1]# ls

[root@master hadoop-2.7.1]# vi etc/hadoop/hadoop-env.sh

在文件中查找 export JAVA_HOME 这行,将其改为如下所示内容:

export JAVA_HOME=/usr/local/src/jdk1.8.0_152

实验任务二:测试 Hadoop 本地模式的运行

步骤一: 切换到 hadoop 用户 使用 hadoop 这个用户来运行 Hadoop 软件。

[root@master hadoop-2.7.1]# su - hadoop

[hadoop@master ~]$ id

步骤二: 创建输入数据存放目录

将输入数据存放在~/input 目录(hadoop 用户主目录下的 input 目录中)。

[hadoop@master ~]$ mkdir ~/input

[hadoop@master ~]$ ls

步骤三: 创建数据输入文件

创建数据文件 data.txt,将要测试的数据内容输入到 data.txt 文件中。

[hadoop@master ~]$ vi input/data.txt

输入如下内容,保存退出。

Hello World

Hello Hadoop

Hello Husan

步骤四: 测试 MapReduce 运行

[hadoop@master ~]$ hadoop jar /usr/local/src/hadoop2.7.1/share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.1.jar wordcount ~/input/data.txt ~/output

运行结果保存在~/output 目录中(注:结果输出目录不能事先存在),命令执 行后查看结果: [hadoop@master ~]$ ll output/

文件_SUCCESS 表示处理成功,处理的结果存放在 part-r-00000 文件中,查看该 文件。 [hadoop@master ~]$ cat output/part-r-00000

Hadoop平台环境配置

实验任务一:实验环境下集群网络配置

修改 slave1 机器主机名

[root@localhost ~]# hostnamectl set-hostname slave1

[root@localhost ~]# bash

[root@slave1 ~]#

修改 slave2 机器主机名

[root@localhost ~]# hostnamectl set-hostname slave2

[root@localhost ~]# bash

[root@slave2 ~]#

root@master ~]# vi /etc/hosts

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

192.168.47.140 master

192.168.47.141 slave1

192.168.47.142 slave2

[root@slave1 ~]# vi /etc/hosts

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

192.168.47.140 master

192.168.47.141 slave1

192.168.47.142 slave2

[root@slave2 ~]# vi /etc/hosts

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 28 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

192.168.47.140 master

192.168.47.141 slave1

192.168.47.142 slave2

实验二 SSH 无密码验证配置

步骤一:每个节点安装和启动 SSH 协议

[root@master ~]# rpm -qa | grep openssh

[root@master ~]# rpm -qa | grep rsync

步骤二:切换到 hadoop 用户

[root@master ~]# su - hadoop

[hadoop@master ~]$

[root@slave1 ~]# useradd hadoop

[root@slave1 ~]# su - hadoop

[hadoop@slave1 ~]$

[root@slave2 ~]# useradd hadoop

[root@slave2 ~]# su - hadoop

[hadoop@slave2 ~]$

步骤三:每个节点生成秘钥对

#在 master 上生成密钥

[hadoop@master ~]$ ssh-keygen -t rsa

#slave1 生成密钥

[hadoop@slave1 ~]$ ssh-keygen -t rsa

#slave2 生成密钥

[hadoop@slave2 ~]$ ssh-keygen -t rsa

步骤四:查看"/home/hadoop/"下是否有".ssh"文件夹,且".ssh"文件下是否有两个刚 生产的无密码密钥对。

[hadoop@master ~]$ ls ~/.ssh/

步骤五:将 id_rsa.pub 追加到授权 key 文件中

#master

[hadoop@master ~]$ cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

[hadoop@master ~]$ ls ~/.ssh/

authorized_keys id_rsa id_rsa.pub

#slave1

[hadoop@slave1 ~]$ cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

[hadoop@slave1 ~]$ ls ~/.ssh/

authorized_keys id_rsa id_rsa.pub

#slave2

[hadoop@slave2 ~]$ cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

[hadoop@slave2 ~]$ ls ~/.ssh/

authorized_keys id_rsa id_rsa.pub

步骤六:修改文件"authorized_keys"权限

#master

[hadoop@master ~]$ chmod 600 ~/.ssh/authorized_keys

[hadoop@master ~]$ ll ~/.ssh/

#slave1

[hadoop@slave1 ~]$ chmod 600 ~/.ssh/authorized_keys

[hadoop@slave1 ~]$ ll ~/.ssh/

#slave2

[hadoop@slave2 ~]$ chmod 600 ~/.ssh/authorized_keys

[hadoop@slave2 ~]$ ll ~/.ssh/

步骤七:配置 SSH 服务

#master

[hadoop@master ~]$ su - root

[root@master ~]# vi /etc/ssh/sshd_config PubkeyAuthentication yes

#找到此行,并把#号注释删除。

#slave1

[hadoop@ slave1 ~]$ su - root

[root@ slave1 ~]# vi /etc/ssh/sshd_config

PubkeyAuthentication yes #找到此行,并把#号注释删除。

#slave2

[hadoop@ slave2 ~]$ su - root

[root@ slave2 ~]# vi /etc/ssh/sshd_config

PubkeyAuthentication yes #找到此行,并把#号注释删除。

步骤八:重启 SSH 服务

设置完后需要重启 SSH 服务,才能使配置生效。

[root@master ~]# systemctl restart sshd

步骤九:切换到 hadoop 用户

[root@master ~]# su - hadoop

[hadoop@master ~]$

步骤十:验证 SSH 登录本机

[hadoop@master ~]$ ssh localhost

实验任务二:交换 SSH 密钥

步骤一:将 Master 节点的公钥 id_rsa.pub 复制到每个 Slave 点 hadoop 用户登录,通过 scp 命令实现密钥拷贝。

[hadoop@master ~]$ scp ~/.ssh/id_rsa.pub hadoop@slave1:~/

[hadoop@master ~]$ scp ~/.ssh/id_rsa.pub hadoop@slave2:~/

步骤二:在每个 Slave 节点把 Master 节点复制的公钥复制到authorized_keys 文件

hadoop 用户登录 slave1 和 slave2 节点,执行命令。

[hadoop@slave1 ~]$ cat ~/id_rsa.pub >>~/.ssh/authorized_keys

[hadoop@slave2 ~]$ cat ~/id_rsa.pub >>~/.ssh/authorized_keys

步骤三:在每个 Slave 节点删除 id_rsa.pub 文件

[hadoop@slave1 ~]$ rm -rf ~/id_rsa.pub

[hadoop@slave2 ~]$ rm -rf ~/id_rsa.pub

步骤四:将每个 Slave 节点的公钥保存到 Master

(1)将 Slave1 节点的公钥复制到 Master

[hadoop@slave1 ~]$ scp ~/.ssh/id_rsa.pub hadoop@master:~/

(2)在 Master 节点把从 Slave 节点复制的公钥复制到 authorized_keys 文件

[hadoop@master ~]$ cat ~/id_rsa.pub >>~/.ssh/authorized_keys

(3)在 Master 节点删除 id_rsa.pub 文件

[hadoop@master ~]$ rm -rf ~/id_rsa.pub

(4)将 Slave2 节点的公钥复制到 Master

[hadoop@slave2 ~]$ scp ~/.ssh/id_rsa.pub hadoop@master:~/

(5)在 Master 节点把从 Slave 节点复制的公钥复制到 authorized_keys 文件

[hadoop@master ~]$ cat ~/id_rsa.pub >>~/.ssh/authorized_keys

(6)在 Master 节点删除 id_rsa.pub 文件

[hadoop@master ~]$ rm -rf ~/id_rsa.pub

实验任务三:验证 SSH 无密码登录

步骤一:查看 Master 节点 authorized_keys 文件

[hadoop@master ~]$ cat ~/.ssh/authorized_keys

步骤二:查看 Slave 节点 authorized_keys 文件

[hadoop@slave1 ~]$ cat ~/.ssh/authorized_keys

[hadoop@slave2 ~]$ cat ~/.ssh/authorized_keys

步骤三:验证 Master 到每个 Slave 节点无密码登录

[hadoop@master ~]$ ssh slave1

Last login: Mon Nov 14 16:34:56 2022

[hadoop@slave1 ~]$

[hadoop@master ~]$ ssh slave2

Last login: Mon Nov 14 16:49:34 2022 from 192.168.47.140

[hadoop@slave2 ~]$

步骤四:验证两个 Slave 节点到 Master 节点无密码登录

[hadoop@slave1 ~]$ ssh master

Last login: Mon Nov 14 16:30:45 2022 from ::1

[hadoop@master ~]$

[hadoop@slave2 ~]$ ssh master

Last login: Mon Nov 14 16:50:49 2022 from 192.168.47.141

[hadoop@master ~]$

步骤五:配置两个子节点slave1、slave2的JDK环境。

[root@master ~]# cd /usr/local/src/

[root@master src]# ls

hadoop-2.7.1 jdk1.8.0_152

[root@master src]# scp -r jdk1.8.0_152 root@slave1:/usr/local/src/

[root@master src]# scp -r jdk1.8.0_152 root@slave2:/usr/local/src/

#slave1

[root@slave1 ~]# ls

/usr/local/src/ jdk1.8.0_152

[root@slave1 ~]# vi /etc/profile

#此文件最后添加下面两行

export JAVA_HOME=/usr/local/src/jdk1.8.0_152

export PATH=$PATH:$JAVA_HOME/bin

[root@slave1 ~]# source /etc/profile

[root@slave1 ~]# java -version

#slave2

[root@slave2 ~]# ls /usr/local/src/

jdk1.8.0_152

[root@slave2 ~]# vi /etc/profile #此文件最后添加下面两行

export JAVA_HOME=/usr/local/src/jdk1.8.0_152

export PATH=$PATH:$JAVA_HOME/bin

[root@slave2 ~]# source /etc/profile、

[root@slave2 ~]# java -version

Hadoop集群运行

实验任务一:在 Master 节点上安装 Hadoop

1. 将 hadoop-2.7.1 文件夹重命名为 Hadoop

[root@master ~]# cd /usr/local/src/

[root@master src]# mv hadoop-2.7.1 hadoop

[root@master src]# ls

2. 配置 Hadoop 环境变量

[root@master src]# yum install -y vim

[root@master src]# vim /etc/profile

[root@master src]# tail -n 4 /etc/profile

export JAVA_HOME=/usr/local/src/jdk1.8.0_152

export PATH=$PATH:$JAVA_HOME/bin

export HADOOP_HOME=/usr/local/src/hadoop

export PATH=$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

3. 使配置的 Hadoop 的环境变量生效

[root@master src]# su - hadoop

上一次登录:一 2 月 28 15:55:37 CST 2022 从 192.168.41.143pts/1 上

[hadoop@master ~]$ source /etc/profile

[hadoop@master ~]$ exit

登出

4. 执行以下命令修改 hadoop-env.sh 配置文件

[root@master src]# cd /usr/local/src/hadoop/etc/hadoop/

[root@master hadoop]# vim hadoop-env.sh

#修改以下配置

export JAVA_HOME=/usr/local/src/jdk1.8.0_152

任务二:配置 hdfs-site.xml 文件参数

[root@master hadoop]# vim hdfs-site.xml #编辑以下内容

[root@master hadoop]# tail -n 14 hdfs-site.xml

<configuration>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/src/hadoop/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir </name>

<value>file:/usr/local/src/hadoop/dfs/data</value>

</property>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

</configuration>

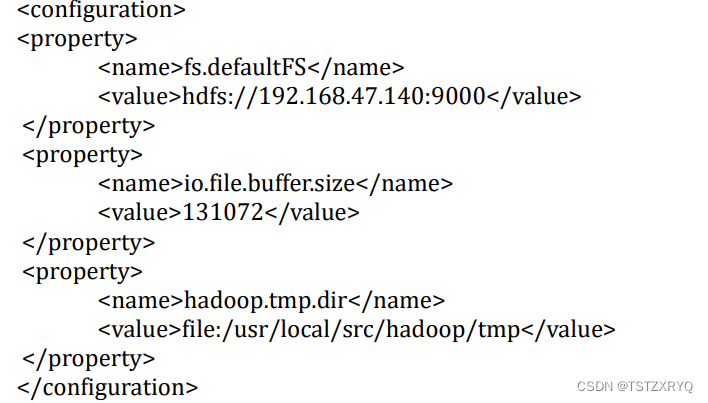

任务三:配置 core-site.xml 文件参数

[root@master hadoop]# vim core-site.xml

#编辑以下内容

[root@master hadoop]# tail -n 14 core-site.xml

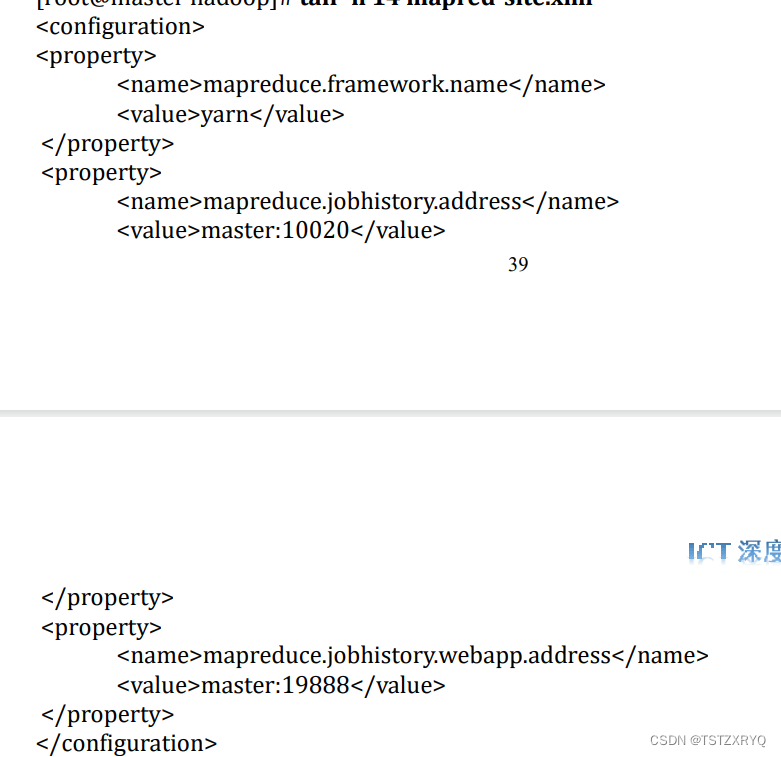

任务四:配置 mapred-site.xml

[root@master hadoop]# pwd /usr/local/src/hadoop/etc/hadoop

[root@master hadoop]# cp mapred-site.xml.template mapred-site.xml

[root@master hadoop]# vim mapred-site.xml #添加以下配置

[root@master hadoop]# tail -n 14 mapred-site.xml

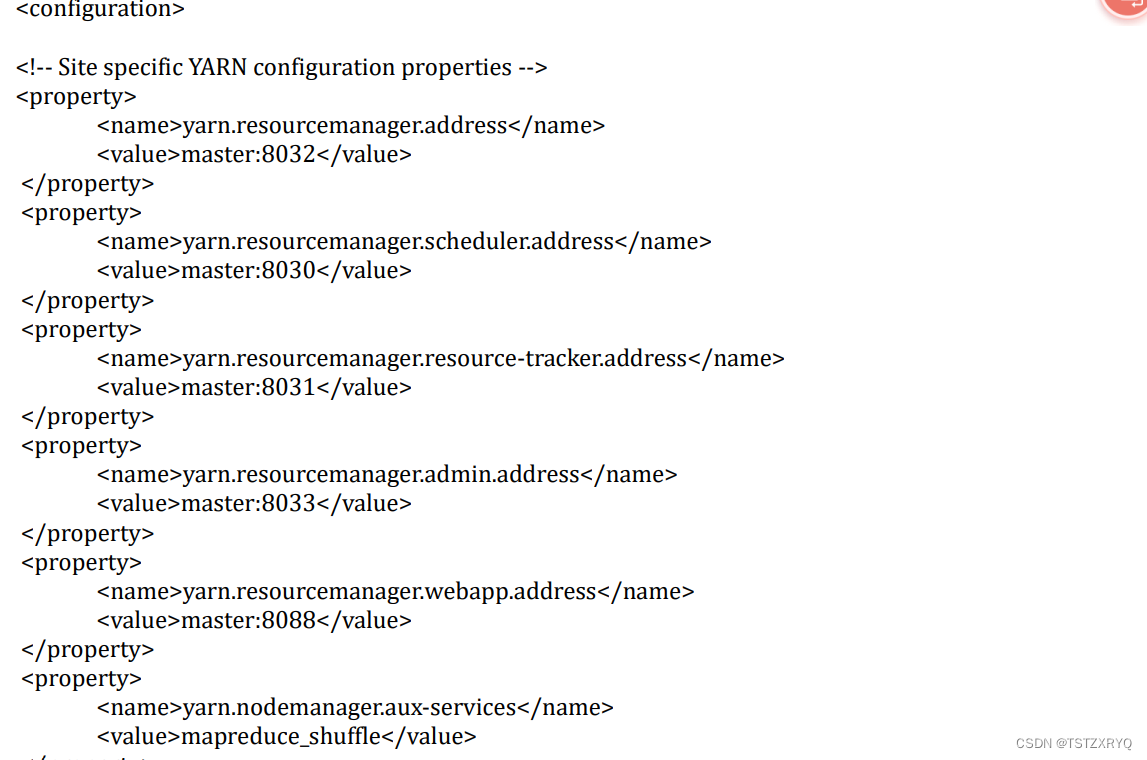

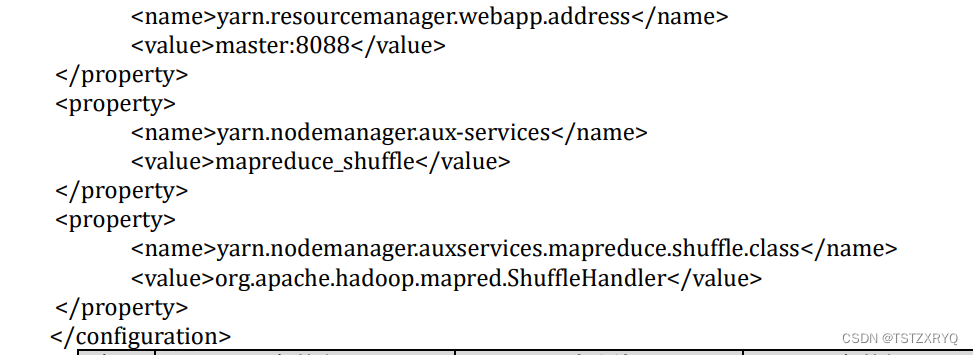

任务五:配置 yarn-site.xml

[root@master hadoop]# vim yarn-site.xml #添加以下配置

[root@master hadoop]# tail -n 32 yarn-site.xml

任务六:Hadoop 其他相关配置

1. 配置 masters 文件

[root@master hadoop]# vim masters

[root@master hadoop]# cat masters

192.168.47.140

2. 配置 slaves 文件

[root@master hadoop]# vim slaves

[root@master hadoop]# cat slaves

192.168.47.141

192.168.47.142

3. 新建目录

[root@master hadoop]# mkdir /usr/local/src/hadoop/tmp

[root@master hadoop]# mkdir /usr/local/src/hadoop/dfs/name -p

[root@master hadoop]# mkdir /usr/local/src/hadoop/dfs/data -p

4. 修改目录权限

[root@master hadoop]# chown -R hadoop:hadoop /usr/local/src/hadoop/

5. 同步配置文件到 Slave 节点

[root@master ~]# scp -r /usr/local/src/hadoop/ root@slave1:/usr/local/src/

[root@master ~]# scp -r /usr/local/src/hadoop/ root@slave2:/usr/local/src/

#slave1 配置

[root@slave1 ~]# yum install -y vim

[root@slave1 ~]# vim /etc/profile

[root@slave1 ~]# tail -n 4 /etc/profile

export JAVA_HOME=/usr/local/src/jdk1.8.0_152

export PATH=$PATH:$JAVA_HOME/bin

export HADOOP_HOME=/usr/local/src/hadoop

export PATH=$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

[root@slave1 ~]# chown -R hadoop:hadoop /usr/local/src/hadoop/

[root@slave1 ~]# su - hadoop

上一次登录:四 2 月 24 11:29:00 CST 2022 从 192.168.41.148pts/1 上

[hadoop@slave1 ~]$ source /etc/profile

#slave2 配置

[root@slave2 ~]# yum install -y vim

[root@slave2 ~]# vim /etc/profile

[root@slave2 ~]# tail -n 4 /etc/profile

export JAVA_HOME=/usr/local/src/jdk1.8.0_152

export PATH=$PATH:$JAVA_HOME/bin

export HADOOP_HOME=/usr/local/src/hadoop

export PATH=$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

[root@slave2 ~]# chown -R hadoop:hadoop /usr/local/src/hadoop/

[root@slave2 ~]# su - hadoop

上一次登录:四 2 月 24 11:29:19 CST 2022 从 192.168.41.148pts/1 上

[hadoop@slave2 ~]$ source /etc/profile

实验任务一:配置 Hadoop 格式化

步骤一:NameNode 格式化

[root@master ~]# su – hadoop

[hadoop@master ~]# cd /usr/local/src/hadoop/

[hadoop@master hadoop]$ bin/hdfs namenode –format

步骤二:启动 NameNode

执行如下命令,启动 NameNode:

[hadoop@master hadoop]$ hadoop-daemon.sh start namenode

实验任务二:查看 Java 进程

[hadoop@master hadoop]$ jps

3557 NameNode

3624 Jps

步骤一:slave节点 启动 DataNode

执行如下命令,启动 DataNode:

[hadoop@slave1 hadoop]$ hadoop-daemon.sh start datanode

[hadoop@slave2 hadoop]$ hadoop-daemon.sh start datanode

[hadoop@slave1 hadoop]$ jps

3557 DataNode

3725 Jps

[hadoop@slave2 hadoop]$ jps

3557 DataNode 3725 Jps

步骤二:启动 SecondaryNameNode

执行如下命令,启动 SecondaryNameNode:

[hadoop@master hadoop]$ hadoop-daemon.sh start secondarynamenode

[hadoop@master hadoop]$ jps

34257 NameNode

34449 SecondaryNameNode

34494 Jps

查看到有 NameNode 和 SecondaryNameNode 两个进程,就表明 HDFS 启动成 功。

步骤三:查看 HDFS 数据存放位置:

执行如下命令,查看 Hadoop 工作目录:

[hadoop@master hadoop]$ ll dfs/

实验任务三:查看 HDFS 的报告

[hadoop@master sbin]$ hdfs dfsadmin -report

实验任务四:使用浏览器查看节点状态

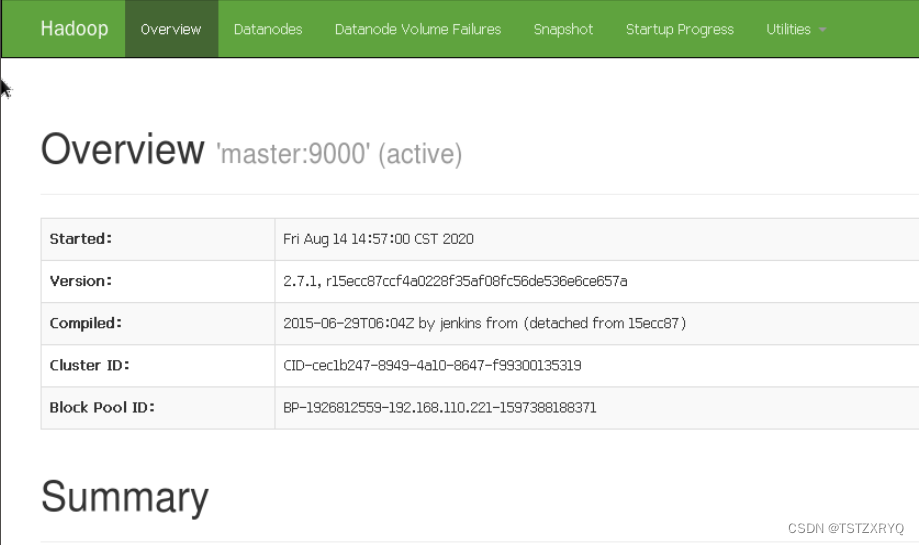

在浏览器的地址栏输入http://master:50070,进入页面可以查看NameNode和DataNode 信息。

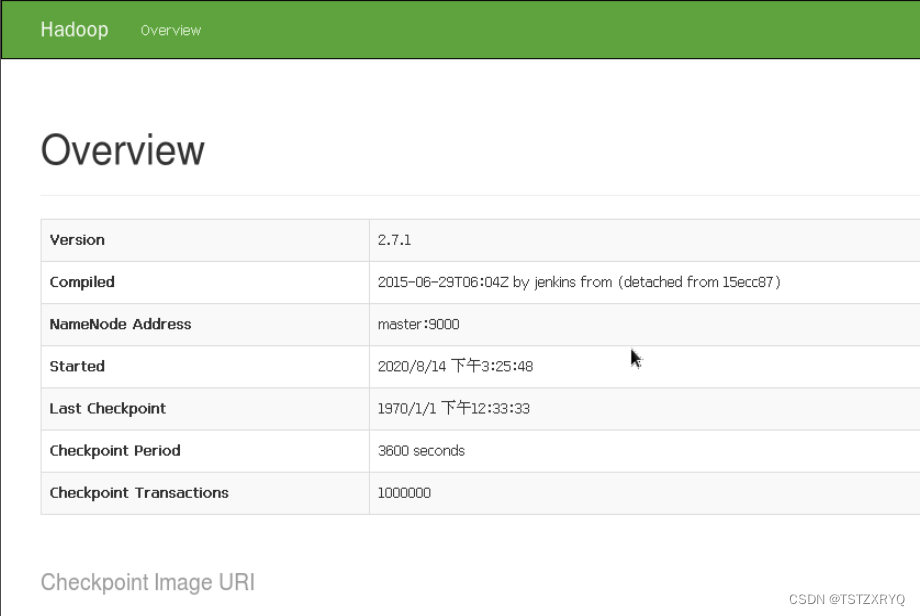

在浏览器的地址栏输入 http://master:50090,进入页面可以查看 SecondaryNameNode信息

可以使用 start-dfs.sh 命令启动 HDFS。这时需要配置 SSH 免密码登录,否则在 启动过程中系统将多次要求确认连接和输入 Hadoop 用户密码。

[hadoop@master hadoop]$ stop-dfs.sh

[hadoop@master hadoop]$ start-dfs.sh

运行测试: 下面运行 WordCount 官方案例,统计 data.txt 文件中单词的出现频度。这个案例可 以用来统计年度十大热销产品、年度风云人物、年度最热名词等。

步骤一:在 HDFS 文件系统中创建数据输入目录

确保 dfs 和 yarn 都启动成功

[hadoop@master hadoop]$ start-yarn.sh

[hadoop@master hadoop]$ jps

34257 NameNode

34449 SecondaryNameNode

34494 Jps

32847 ResourceManager

如果是第一次运行 MapReduce 程序,需要先在 HDFS 文件系统中创建数据输入目 录,存放输入数据。这里指定/input 目录为输入数据的存放目录。

执行如下命 令,在 HDFS 文件系统中创建/input 目录:

[hadoop@master hadoop]$ hdfs dfs -mkdir /input

[hadoop@master hadoop]$ hdfs dfs -ls /

步骤二:将输入数据文件复制到 HDFS 的/input 目录中

测试用数据文件仍然是上一节所用的测试数据文件~/input/data.txt,内容如下所示。 [hadoop@master hadoop]$ cat ~/input/data.txt

Hello World

Hello Hadoop

Hello Huasan

执行如下命令,将输入数据文件复制到 HDFS 的/input 目录中:

[hadoop@master hadoop]$ hdfs dfs -put ~/input/data.txt /input

确认文件已复制到 HDFS 的/input 目录:

[hadoop@master hadoop]$ hdfs dfs -ls /input

步骤三:运行 WordCount 案例,计算数据文件中各单词的频度。

[hadoop@master hadoop]$ hdfs dfs -mkdir /output

先执行如下命令查看 HDFS 中的文件:

[hadoop@master hadoop]$ hdfs dfs -ls /

上述目录中/input 目录是输入数据存放的目录,/output 目录是输出数据存放的目录。执 行如下命令,删除/output 目录。

[hadoop@master hadoop]$ hdfs dfs -rm -r -f /output

执行如下命令运行 WordCount 案例:

[hadoop@master hadoop]$ hadoop jar share/hadoop/mapreduce/hadoop mapreduce-examples-2.7.1.jar wordcount /input/data.txt /output

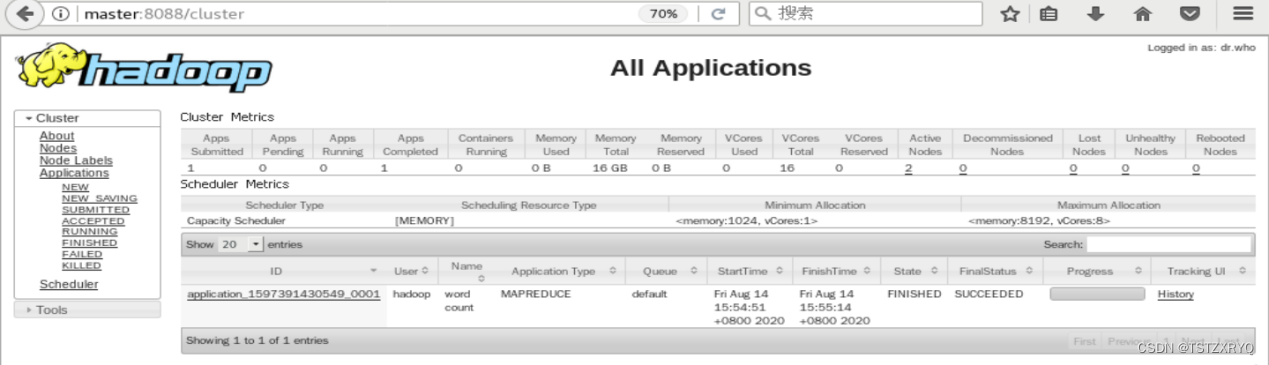

由上述信息可知 MapReduce 程序提交了一个作业,作业先进行 Map,再进行 Reduce 操作。 MapReduce 作业运行过程也可以在 YARN 集群网页中查看。

在浏 览器的地址栏输入:http://master:8088

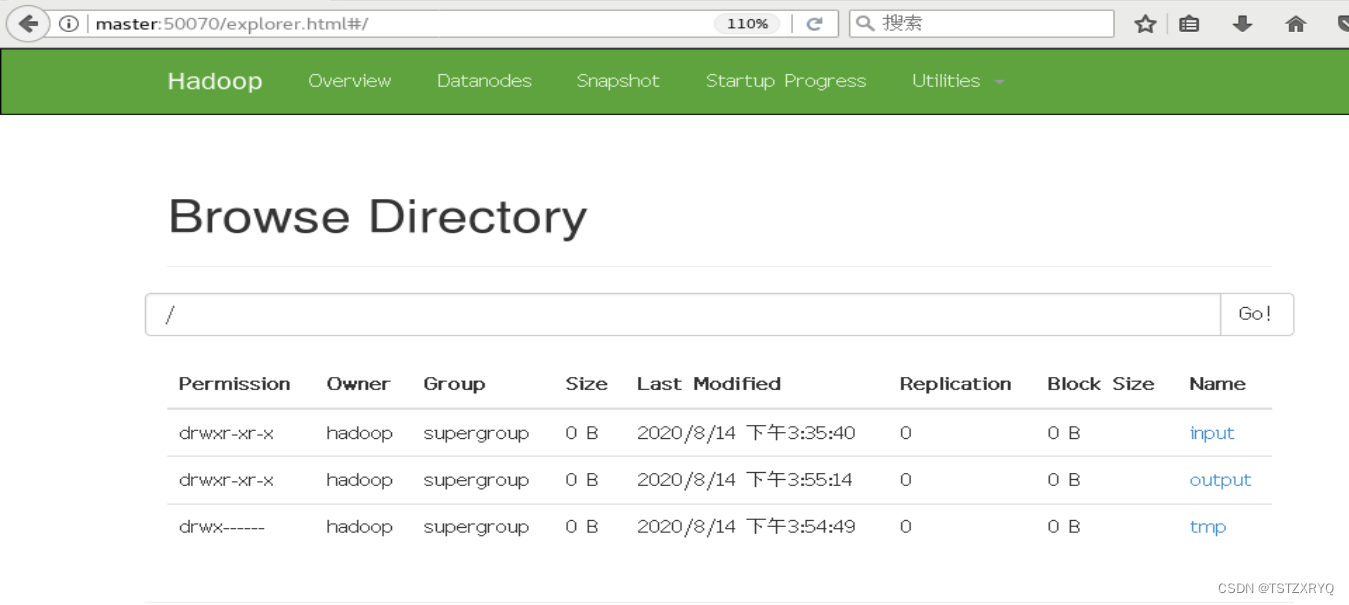

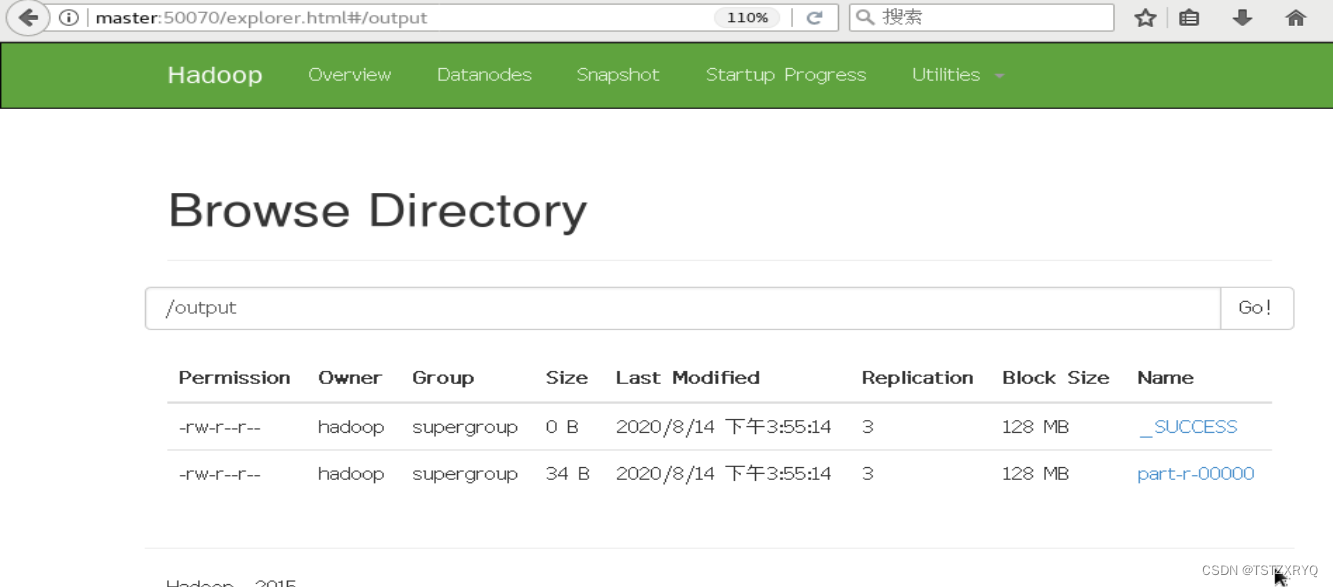

除了可以用 HDFS 命令查看 HDFS 文件系统中的内容,也可使用网页查看 HDFS 文件 系统。在浏览器的地址栏输入 http://master:50070,进入页面,在 Utilities 菜单中 选择 Browse the file system,可以查看 HDFS 文件系统内容。

查看 output 目录,发现有两个文件。文件_SUCCESS 表示处理成功,处理的结果 存放在 part-r-00000 文件中。在页面上不能直接查看文件内容,需要下载到本地系统才行

可以使用 HDFS 命令直接查看 part-r-00000 文件内容,

结果如下所示:

[hadoop@master hadoop]$ hdfs dfs -cat /output/part-r-00000

Hadoop 1

Hello 3

Huasan 1

World 1

可以看出统计结果正确,说明 Hadoop 运行正常。

1393

1393

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?