1、惰性机制

所谓的“惰性机制”是指,整个转换过程只是记录了转换的轨迹,并不会发生真正的计算,只有遇到行动操作时,才会触发“从头到尾”的真正的计算。

2、在Spark中,RDD采用惰性求值的机制,每次调用行动操作,都会触发一次从头开始的计算(就会生成一个Job),这对于迭代计算而言,代价很大,因为迭代计算经常需要多次重复使用同一组数据。

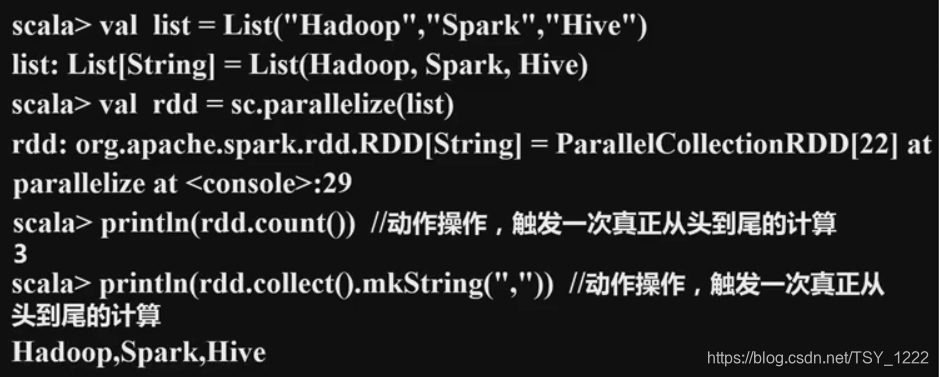

下面就是多次计算同一个RDD的例子:(2次行动操作,触发2次从头开始的计算)

实际上,可以通过持久化(缓存)机制来避免这种重复计算的开销。

具体方法:使用persist()方法对一个RDD标记为持久化,要等到遇到第一个行动操作触发真正的计算后,才会把计算结果进行持久化,持久化的RDD将会被保留在计算节点的内存中,被后面的行动操作重复使用。

3、persist()的圆括号中包含的是持久化级别参数:(有2种不同的级别)

| persist( |

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

588

588

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?