序列模型

分类问题与预测问题

⚫ 图像分类:当前输入−>当前输出

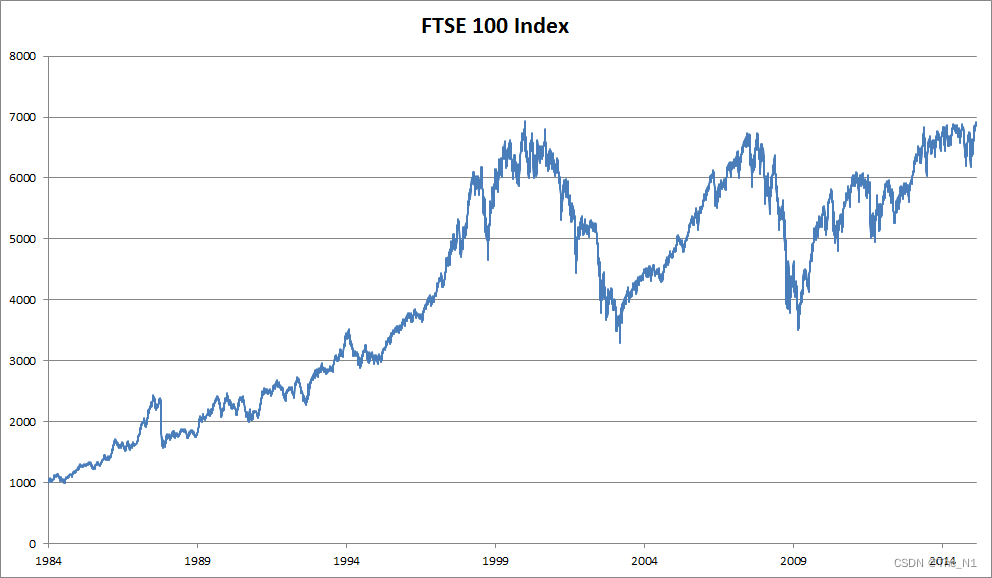

⚫ 时间序列预测:当前+过去输入−>当前输出

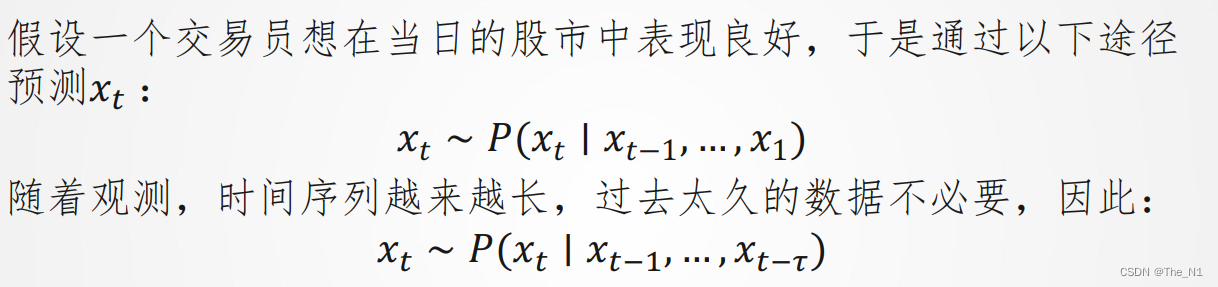

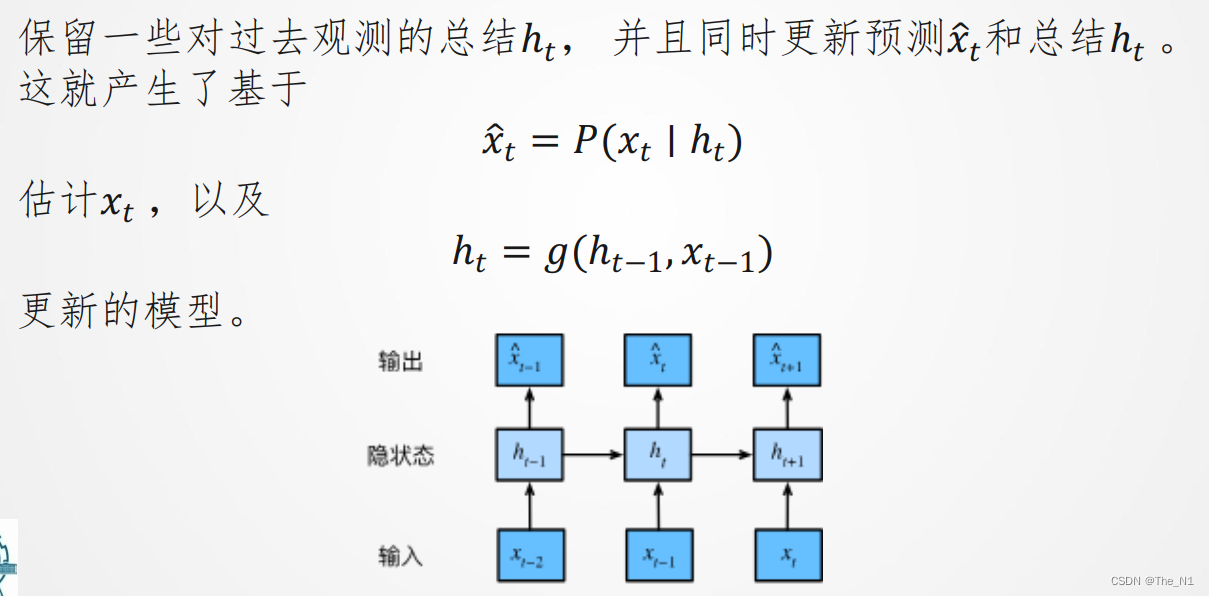

自回归模型

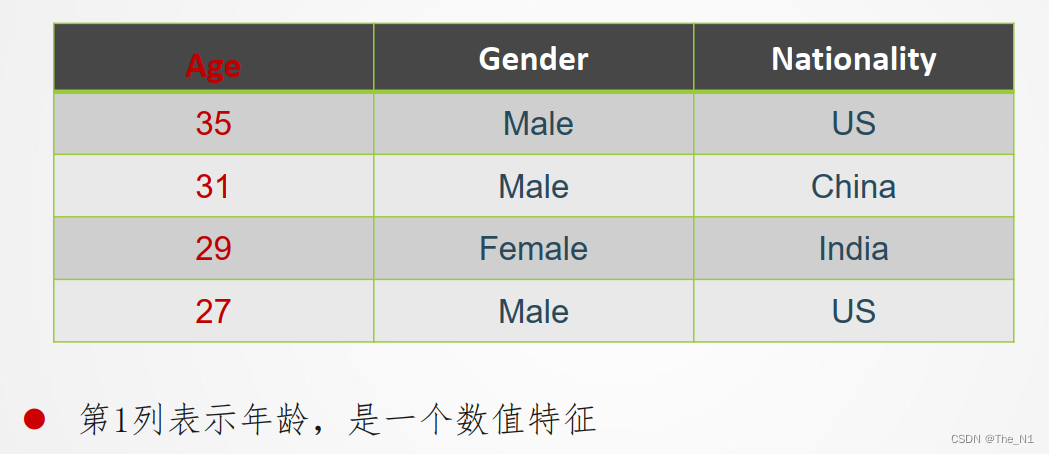

数据预处理

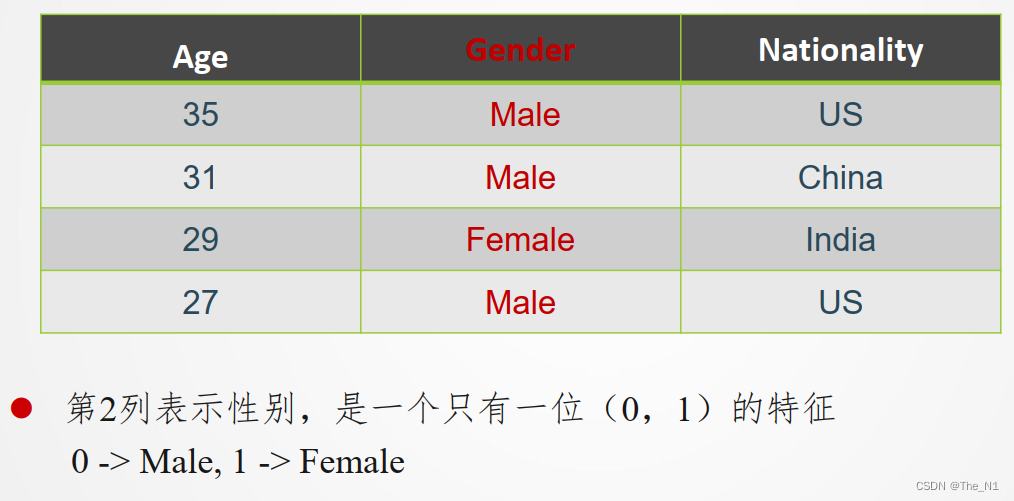

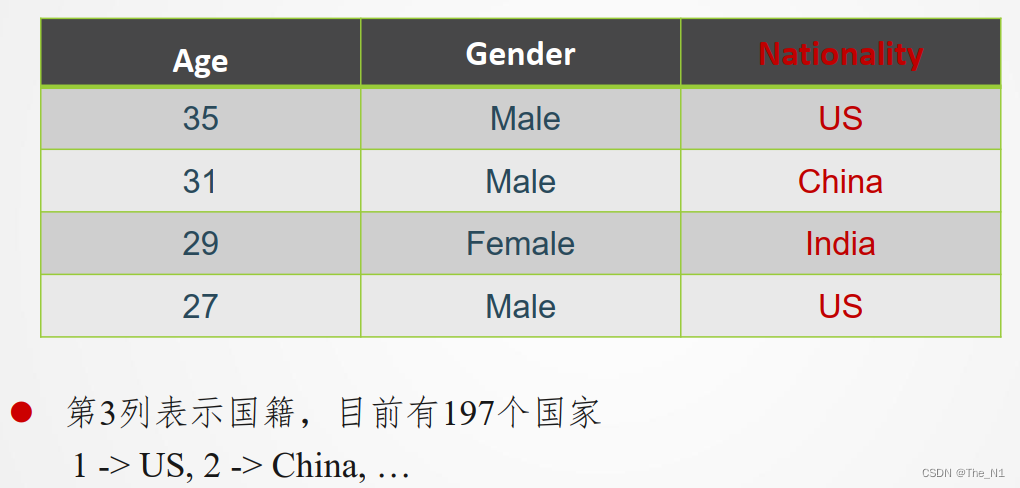

特征编码

文本处理

按字母处理

⚫ 给定文本片段,如:

S = “… to be or not to be…”.

⚫ 将文本切分为字母序列:

L = […, ‘t’, ‘o’, ‘ ’, ‘b’, ‘e’, …],

按单词处理(文本切分)

⚫ 给定文本片段,如:

S = “… to be or not to be…”.

⚫ 将文本切分为单词序列:

L = […, to, be, or, not, to, be, …],

文本预处理与词嵌入

文本预处理

一篇文章可以被简单地看作一串单词序列,甚至是一串字符序列。 我们将解析文本的常见预处理步骤。 这些步骤通常包括:

1.将文本作为字符串加载到内存中。

2.将字符串切分为词元(如单词和字符)。

3.建立一个字典,将拆分的词元映射到数字索引。

4.将文本转换为数字索引序列,方便模型操作。

第一步:读取数据集

第二步:词汇切分

第三步:构建词索引表

文本嵌入

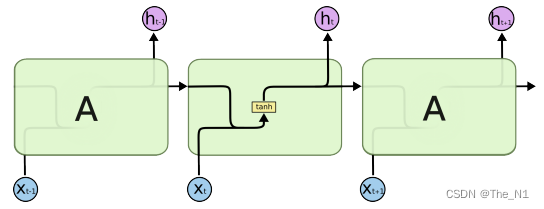

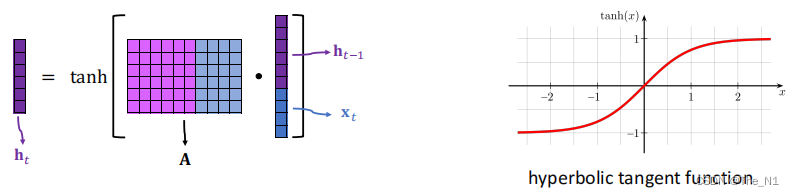

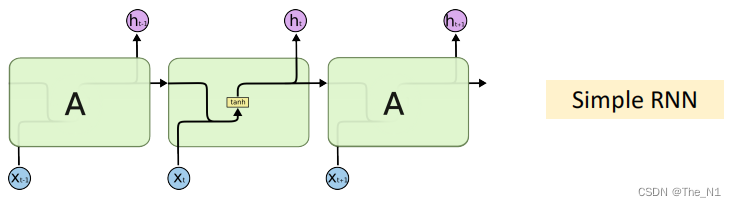

RNN模型

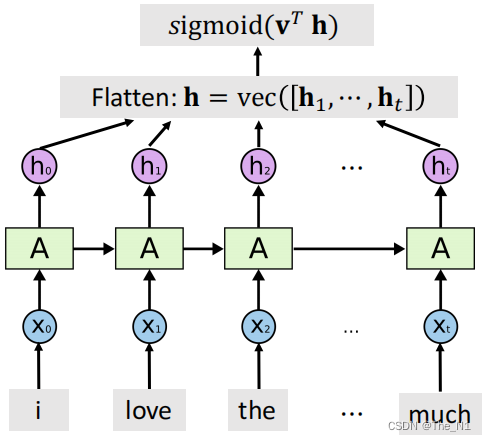

RNN示例

使用RNN进行IMDB评论:

门控循环单元(GRU)

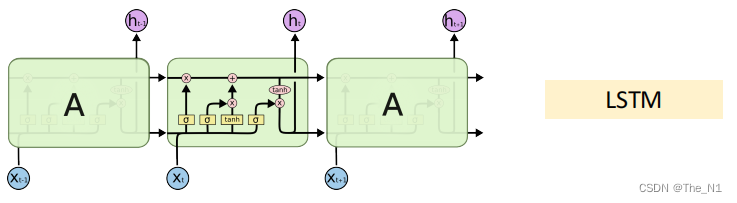

长短期记忆网络(LSTM)

模型

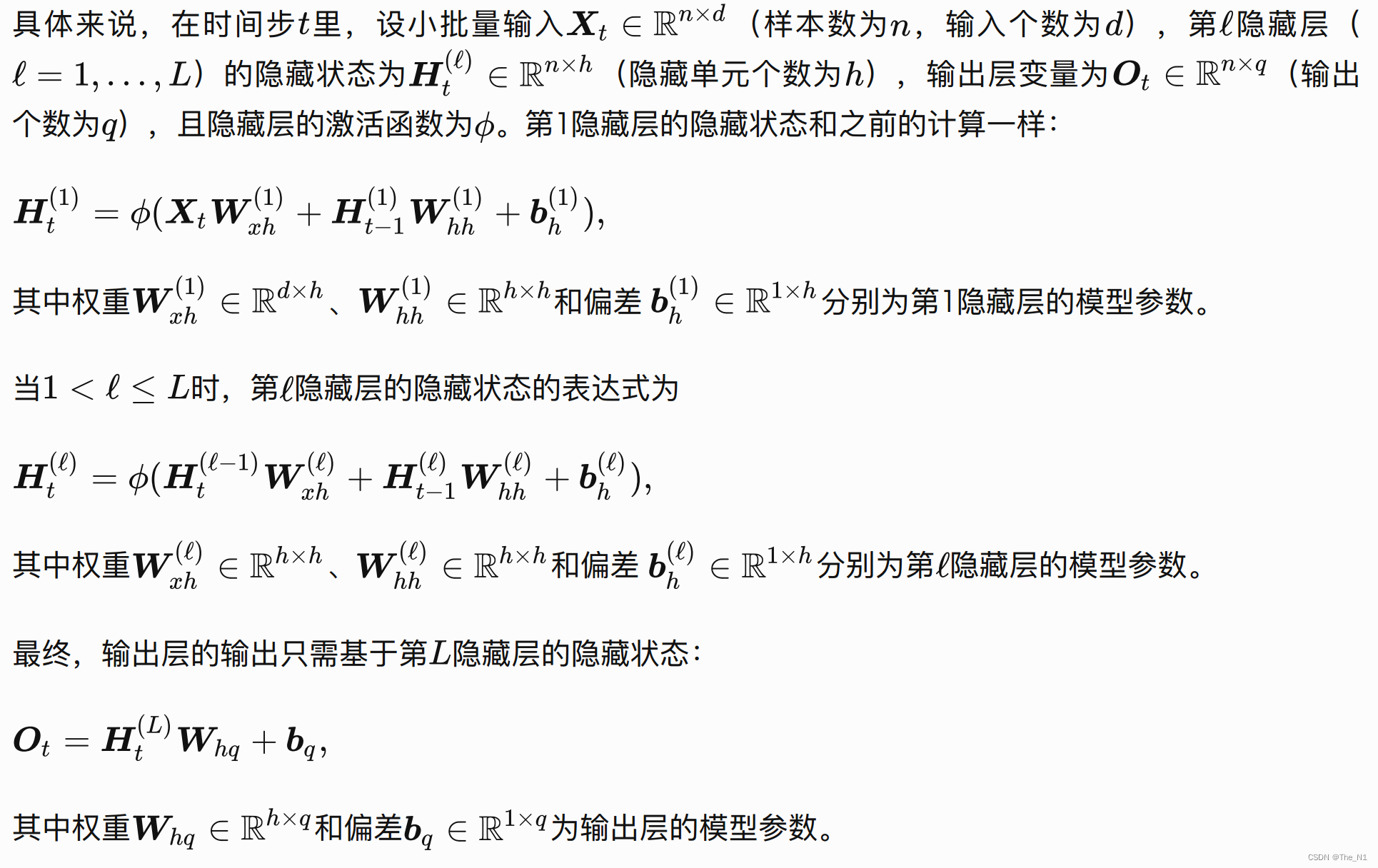

深度循环神经网络

双向循环神经网络

生成对抗网络(GAN)

生成对抗网络(GANs, generative adversarial networks)是由Ian Goodfellow等

人在2014年的Generative Adversarial Networks一文中提出。

模型通过框架中(至少)两个模块:生成模型(Generative Model)和判别

模型(Discriminative Model)的互相博弈学习产生相当好的输出。

原始 GAN 理论中,并不要求 G 和 D 都是神经网络,只需要是能拟合相应

生成和判别的函数即可。但实用中一般均使用深度神经网络作为 G 和 D

。

一个优秀的GAN应用需要有良好的训练方法,否则可能由于神经网络模型

的自由性而导致输出不理想。

整体结构

生成对抗网络(GAN)的初始原理十分容易理解,即构造两个神经网络,一

个生成器,一个鉴别器,二者互相竞争训练,最后达到一种平衡(纳什平

衡)。

GAN 启发自博弈论中的二人零和博弈(two-player game), GAN 模型中

的两位博弈方分别由生成式模型(generativemodel, G)和判别式模型(

discriminative model, D)充当。

⚫ 生成模型 G 捕捉样本数据的分布,用服从某一分布(均匀分布,高斯

分布等)的噪声 z 生成一个类似真实训练数据的样本,追求效果是越

像真实样本越好。

⚫ 判别模型 D 是一个二分类器,估计一个样本来自于训练数据(而非生

成数据)的概率,如果样本来自于真实的训练数据, D 输出大概率,

否则, D 输出小概率。

NeRF

NeRF(Neural Radiance Fields)最早在2020年ECCV会议上发表,作为Best

Paper,其将隐式表达推上了一个新的高度,仅用 2D 的 posed images 作为

监督,即可表示复杂的三维场景。 NeRF迅速发展起来,被应用到多个技

术方向上,例如新视点合成、三维重建等等,并取得非常好的效果。

Transformer

大语言模型

语言-图像模型

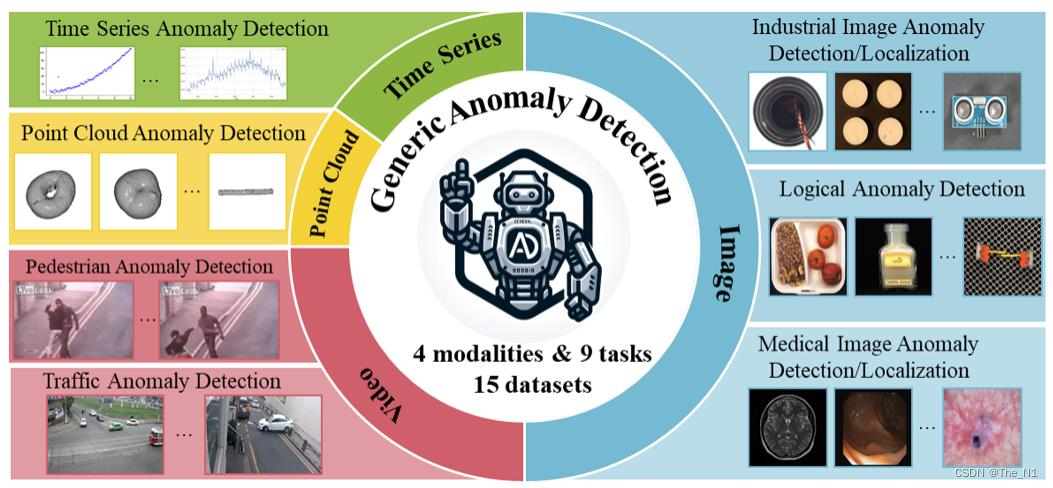

在多模态异常检测的背景下对GPT-4V进行了彻底的评估

➢ 考虑四个模式:图像、视频、点云和时间序列

➢ 探索九项特定任务,包括工业图像异常检测/定位、点云异常检测、医学

图像异常检测/定位,逻辑异常检测,行人异常检测、交通异常检测和时

间序列异常检测。

➢ 评估包括15个数据集的多样性。

956

956

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?