- AlexNet的主要影响:

AlexNet 推动了深度学习的发展,因为它在2012 ilvsrc上的获得第一名,并且比第二名的表现好很多。它的良好表现导致学术界再次开始研究深度学习。 - AlexNet 的主要结构:

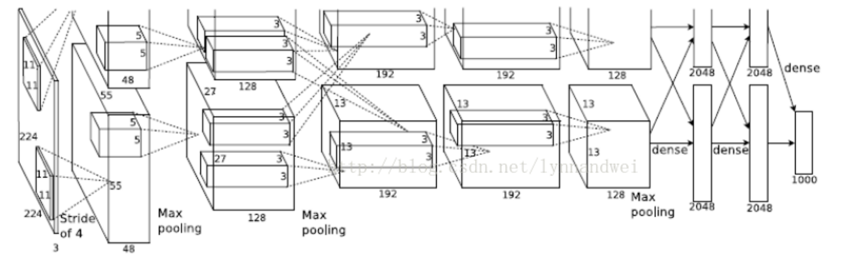

AlexNet 的结构主要有5个卷积层,3个全连接层组成。它的学习参数大概有6千万个,神经元有650,000多个。

因为imagenet给的数据集对于1000类的图像分类问题而言其实不是很大,但是深度神经网络的参数却很多,这样很容易出现过拟合的问题。这也是2006年之前深度学习不火的原因之一。在AlexNet 中,为了防止过拟合,它一开始对图像进行了crop,mirror等处理,使得原始数据增加了(256-224)*(256 - 224)*2 = 2048倍。

再加上它在卷积层之后的pooling,通过drop out随机减少特征的数量,很好的解决了过拟合的问题,使得神经网络可以go deeper,而不会出现原来由过深网络带来的庞大参数导致的难以解决的梯度消失或者 后面网络收敛,前面网络仍然随机的问题。

- AlexNet 的优化方法:

3.1此外,AlexNet 还使用了GPU加速并行化处理,用两个显存3G的GPU 同时并行化加快train 的速度。

3.2 AlexNet还使用了relu 激活函数,这个函数相比于原来的sigmoid 或者其他激活函数来说运算更加简便,因为relu 的函数是线性的,所以速度更快。而其他的函数都是带有指数或者

AlexNet在2012年ILSVRC比赛夺冠,推动了深度学习复兴。网络包含5个卷积层和3个全连接层,采用crop、mirror等数据增强及ReLU、LRN防止过拟合,利用GPU并行训练。其简洁结构适合初学者,对卷积网络和池化概念的理解有重要影响。

AlexNet在2012年ILSVRC比赛夺冠,推动了深度学习复兴。网络包含5个卷积层和3个全连接层,采用crop、mirror等数据增强及ReLU、LRN防止过拟合,利用GPU并行训练。其简洁结构适合初学者,对卷积网络和池化概念的理解有重要影响。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

556

556

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?