1、配置hdfs,现场演示配置结果和回答相关问题,并写出详细配置流程说明及相应的截图。

①在usr目录下创建hadoop文件夹:mkdir /usr/hadoop

②上传hadoop压缩包到hadoop目录下,解压:tar -zxvf hadoop-3.1.4.tar.gz

③配置 Hadoop 环境变量:vi /etc/profile

export HADOOP_HOME=/usr/hadoop/hadoop-3.1.4

export PATH=$PATH:$HADOOP_HOME/sbin:$HADOOP_HOME/bin

③是环境变量生效:source /etc/profile

④在/usr/hadoop/hadoop-3.1.4/etc/hadoop/目录下,修改配置文件hadoop-env.sh,添加以下内容:

export JAVA_HOME=/usr/java/jdk1.8.0_241

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

⑤修改core-site.xml文件:

<!-- HDFS的入口,将来会在这个机器上启动namenode,上传下载通过9000端口 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://master122:9000</value>

</property>

<!--配置 数据保存位置(hadoop的根目录下新建data目录,会自动创建)-->

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/hadoop/tmp</value>

</property>

⑥修改hdfs-site.xml

<!--配置副本个数-->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>master122:9868</value>

</property>

⑦修改workers

<!-- 配置从机datanode的ip-->

master122

⑧切换到目录:cd /usr/hadoop/hadoop-3.1.4/bin/

格式化:hdfs namenode -format

⑨切换到目录:cd /usr/hadoop/hadoop-3.1.4/sbin/

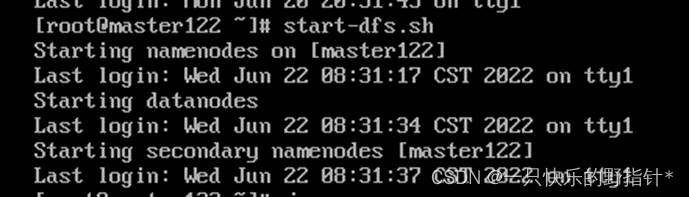

启动dfs:start-dfs.sh

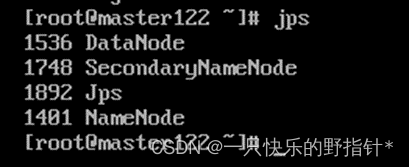

查看进程:jps

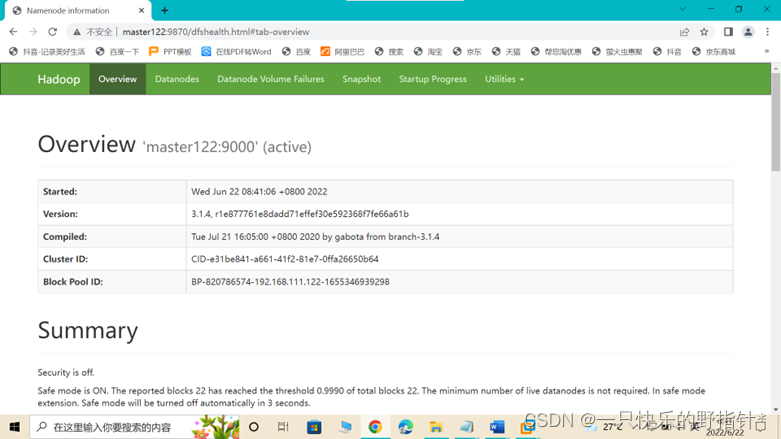

⑩浏览器查看namenode的web服务:http://master122:9870

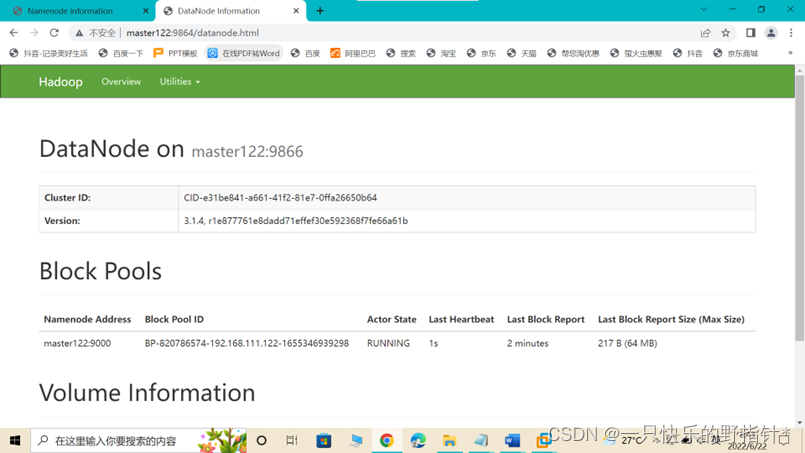

查看datanode的Web服务:http://master122:9864

655

655

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?