目标:

一、上传软件包到hadoop1中

二、解压hadoop

tar -zxvf /opt/software/ hadoop-3.3.4.tar.gz -C /opt/en/

三、构建软链接

然后cd到hadoop

四、配置workers文件

四、配置workers文件

进入到workers文件中按两下dd删除localhost

五、配置hadoop-env.sh文件

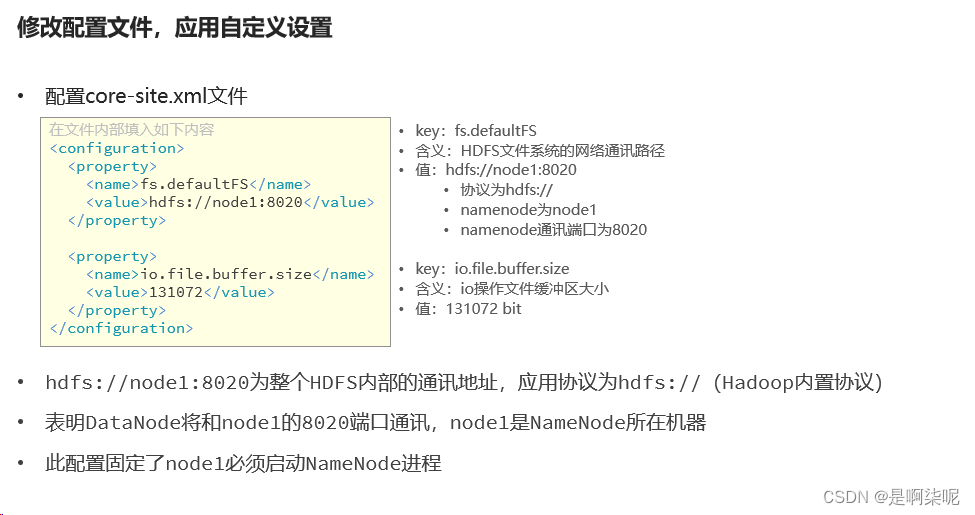

六、配置core-site.xml文件

vim core-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop1:8020</value>

</property>

<property>

<name>io.file.buffer.size</name>

<value>131072</value>

</property>

</configuration>

七、配置hdfs-site.xml文件

# 在文件内部填入如下内容

<configuration>

<property>

<name>dfs.datanode.data.dir.perm</name>

<value>700</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>/data/nn</value>

</property>

<property>

<name>dfs.namenode.hosts</name>

<value>hadoop1,hadoop2,hadoop3</value>

</property>

<property>

<name>dfs.blocksize</name>

<value>268435456</value>

</property>

<property>

<name>dfs.namenode.handler.count</name>

<value>100</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/data/dn</value>

</property>

</configuration>

八、准备数据目录

九、分发hadoop文件夹

创建软链接

十、配置环境变量

十一、格式化整个文件系统

十二、查看HDFSwebUI界面

十三、拍摄快照

2954

2954

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?