首先总结一下AudioTrack

AudioTrack字面意思是音轨,可以理解为一路音频的来源。

JAVA层也有AudioTrack的概念,但只是简单的封装,这里不介绍了。只介绍Native JNI的AT

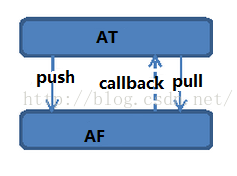

AT 向下传送数据,有两种方式:

1,主动push方式,(对AF来说是被动方式)

AT调用write函数把音频数据“push”到AudioTrack中。

2,被动pull方式,(对AF来说是主动方式)

AF调用callback,从AT获取数据

从另外一个维度来看,还有两种方式:

1,static方式,一次性把数据全传送给AF

延时大,简单高效,适用于提示音等操作

2,stream方式,数据一点点的传送给AF,一块一块的传送

延时小,不受文件大小限制。流媒体播放只能用这种。

下面结合代码总结一下AT的初始化,以及运行起来的流程问题。

开始播放时,JAVA层用JNI调用native函数

AudioTrack字面意思是音轨,可以理解为一路音频的来源。

JAVA层也有AudioTrack的概念,但只是简单的封装,这里不介绍了。只介绍Native JNI的AT

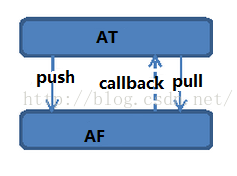

AT 向下传送数据,有两种方式:

1,主动push方式,(对AF来说是被动方式)

AT调用write函数把音频数据“push”到AudioTrack中。

2,被动pull方式,(对AF来说是主动方式)

AF调用callback,从AT获取数据

从另外一个维度来看,还有两种方式:

1,static方式,一次性把数据全传送给AF

延时大,简单高效,适用于提示音等操作

2,stream方式,数据一点点的传送给AF,一块一块的传送

延时小,不受文件大小限制。流媒体播放只能用这种。

下面结合代码总结一下AT的初始化,以及运行起来的流程问题。

开始播放时,JAVA层用JNI调用native函数

static int android_media_AudioTrack_native_setup(....)

{

sp<AudioTrack> lpTrack = new AudioTrack();//初始化track对象

switch (memoryMode) {

case MODE_STREAM:

lpTrack->set( //给track设置好参数

atStreamType,// stream type

sampleRateInHertz,

format,// word length, PCM

nativeChannelMask,

frameCount,

AUDIO_OUTPUT_FLAG_NONE,

audioCallback, &(lpJniStorage->mCallbackData),//callback, callback data (user)

0,// notificationFrames == 0 since not using EVENT_MORE_DATA to feed the AudioTrack

0,// shared mem //stream模式不用共享内存

true,// thread can call Java

sessionId);// audio session ID

break;

case MODE_STATIC:

// AudioTra

本文详细探讨了Android中AudioTrack的使用,包括主动push和被动pull两种数据传输方式,以及静态和流式两种操作模式。重点讲解了AudioTrack的初始化过程,通过AudioTrack::set函数设置参数,并通过AudioFlinger创建Track实例。文中还提到了AudioTrack线程如何处理callback事件,以及如何获取和管理音频数据缓冲区。

本文详细探讨了Android中AudioTrack的使用,包括主动push和被动pull两种数据传输方式,以及静态和流式两种操作模式。重点讲解了AudioTrack的初始化过程,通过AudioTrack::set函数设置参数,并通过AudioFlinger创建Track实例。文中还提到了AudioTrack线程如何处理callback事件,以及如何获取和管理音频数据缓冲区。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

967

967

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?