在爬虫时遇到

raise MaxRetryError(_pool, url, error or ResponseError(cause))

urllib3.exceptions.MaxRetryError: HTTPSConnectionPool(host='ssr1.scrape.center', port=443): Max retries exceeded with url: / (Caused by SSLError(SSLCertVerificationError(1, '[SSL: CERTIFICATE_VERIFY_FAILED] certificate verify failed: unable to get local issuer certificate (_ssl.c:1002)')))

During handling of the above exception, another exception occurred:错误。

是网站原因,没有证书认证,有三种解决方法

方法一:

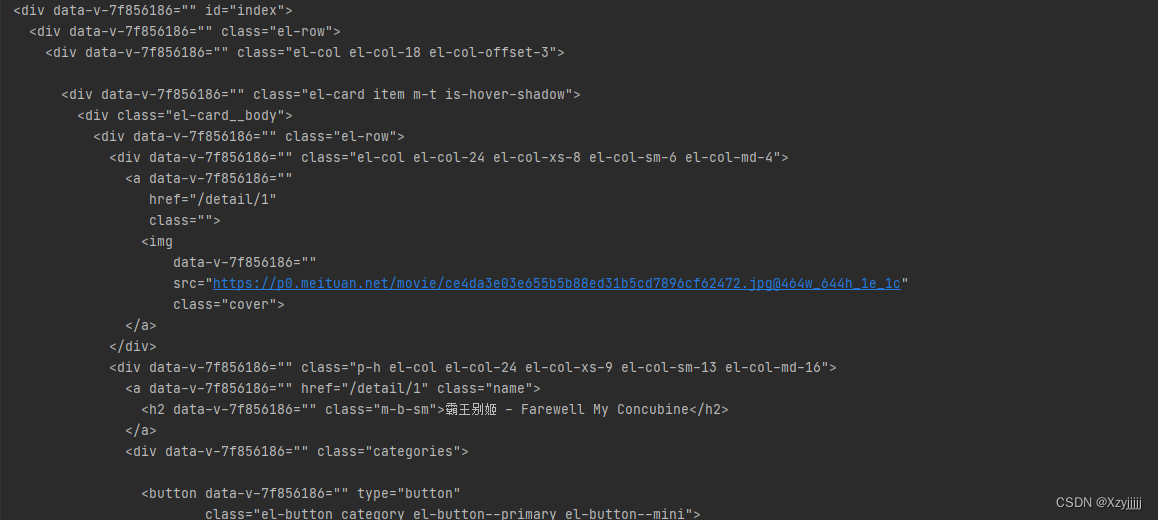

设置verify=False(我就是用这种方法解决的,很好用)

![]()

方法二:

全局取消证书验证。

方法三:

urllib2.urlopen 的传参

![]()

我用的第一种方法,他会警告,让你添加安全证书。

![]()

但是无所谓,我已经拿到数据了。

689

689

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?