分词

什么是分词

分词是 ⾃然语⾔理解 NLP 的重要步骤。分词就是将句⼦、段落、⽂章这种⻓⽂本,分解为以字词为单位的数据结构,⽅便后续的处理分析⼯作。

分词的作用

1、将复杂问题转化为数学问题

机器学习之所以看上去可以解决很多复杂的问题,是因为它把这些问题都转化为了数学问题。⽽ NLP 也是相同的思路,⽂本都是⼀些「⾮结构化数据」,我们需要先将这些数据转化为「结构化数据」,结构化数据就可以转化为数学问题了,⽽分词就是转化的第一步。

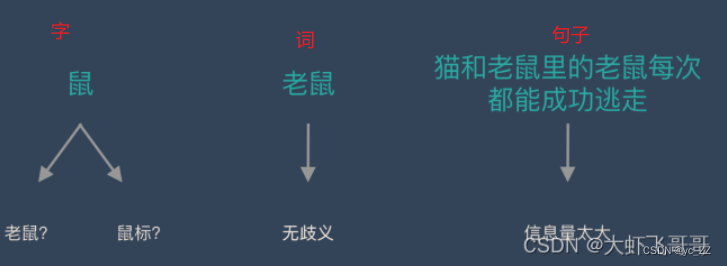

2、词是一个比较合适的粒度

词是表达完整含义的最⼩单位。字的粒度太⼩,⽆法表达完整含义,⽐如”⿏“可以是”⽼⿏“,也可以是”⿏标“。⽽句⼦的粒度太⼤,承载的信息量多,很难复⽤。⽐如”传统⽅法要分词,⼀个重要原因是传统⽅法对远距离依赖的建模能⼒较弱。”

中英文分词的区别

1.分词方式不同,中文更难

英⽂有天然的空格作为分隔符,但是中⽂没有。所以如何切分是⼀个难点,再加上中⽂⾥⼀词多意的情况⾮常多,导致很容易出现歧义。

2.英文单词有多种形态

英⽂单词存在丰富的变形变换。为了应对这些复杂的变换,英⽂NLP相⽐中⽂存在⼀些独特的处理步骤,我们称为词形还原(Lemmatization)和词⼲提取(Stemming);中⽂则不需要。

词性还原:does,done,doing,did 需要通过词性还原恢复成 do。

词⼲提取:cities,children,teeth 这些词,需要转换为 city,child,tooth这些基本形态。

3.中文分词需要考虑粒度问题

例如「中国科学技术⼤学」就有很多种分法:

中国科学技术⼤学

中国 \ 科学技术 \ ⼤学

中国 \ 科学 \ 技术 \ ⼤学

粒度越⼤,表达的意思就越准确,但是也会导致召回⽐较少。所以中⽂需要不同的场景和要求选择不同的粒度。这个在英⽂中是没有的。

4、分词⼯具

1118

1118

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?